Yapay Zekâ

Büyük Dil Modelleri ile Graf Nöral Ağlarını Süper Şarj Etme: Ultimate Rehber

Grafikler, sosyal ağlar, bilgi tabanları, biyolojik sistemler ve daha birçok alanda kompleks ilişkileri temsil eden veri yapılarıdır. Bu grafiklerde, varlıklar düğümler olarak temsil edilir ve ilişkileri kenarlar olarak gösterilir.

Bu karmaşık ilişkisel yapıları etkili bir şekilde temsil etme ve hakkında akıl yürütme yeteneği, ağ bilimi, kemoinformatik ve öneri sistemleri gibi alanlardaki ilerlemeleri mümkün kılmak için çok önemlidir.

Graf Nöral Ağları (GNN), grafik makine öğrenimi görevleri için güçlü bir derin öğrenme çerçevesi olarak ortaya çıkmıştır. Grafik topolojisini komşu birleştirme veya grafik konvolüsyonlar aracılığıyla sinir ağı mimarisine entegre ederek, GNN’ler hem düğme özelliklerini hem de yapısal rollerini kodlayan düşük boyutlu vektör temsilimleri öğrenebilir. Bu, GNN’lerin düğme sınıflandırma, bağlantı tahmini ve grafik sınıflandırma gibi görevlerde çeşitli uygulama alanlarında devlet-sanat performansını elde etmesini sağlar.

GNN’ler önemli ilerleme kaydetmiş olsa da, bazı ana zorluklar vẫn devam etmektedir. Denetimli GNN modelleri için yüksek kaliteli etiketli veri elde etmek pahalı ve zaman alıcı olabilir. Ayrıca, GNN’ler heterojen grafik yapıları ve test zamanında eğitim verisinden önemli ölçüde farklı olan grafik dağılımı (dağılım genellemesi) durumlarında mücadele edebilir.

Paralel olarak, GPT-4 ve LLaMA gibi Büyük Dil Modelleri (LLM), doğal dil anlama ve oluşturma yetenekleri ile dünyayı fethetmiştir. Milyarlarca parametre ile büyük metin corporalarına eğitim gören LLM’ler, birkaç örnek öğrenme yetenekleri, görevler arası genellemeler ve önceden çok zor olduğu düşünülen AI sistemleri için ortak akıl yürütme becerileri sergiler.

LLM’lerin muhteşem başarısı, onların gücünü grafik makine öğrenimi görevleri için kullanma araştırmalarını katalize etmiştir. Bir yandan, LLM’lerin bilgi ve akıl yürütme yetenekleri geleneksel GNN modellerini güçlendirme fırsatları sunar. Öte yandan, grafiklerdeki yapısal temsil ve gerçek bilgiler, LLM’lerin bazı kilit sınırlamalarını, chẳng hạn sebagai hallucinations ve yorumlanabilirlik eksikliğini, ele almasına yardımcı olabilir.

Graf Nöral Ağları ve Kendi Kendine Denetimsiz Öğrenme

Gerekli bağlamı sağlamak için, önce graf nöral ağları ve kendi kendine denetimsiz grafik temsil öğreniminin temel kavramları ve yöntemlerini kısaca gözden geçireceğiz.

Graf Nöral Ağ Mimarileri

Graf Nöral Ağ Mimarisi – kaynak

Geleneksel derin sinir ağları ve GNN’ler arasındaki ana fark, grafik yapılarındaki verilere doğrudan işlem yapma yeteneğinde yatmaktadır. GNN’ler, her düğümün komşularından özellikli vektörleri birleştirmek suretiyle bir komşu birleştirme şeması izler.

Çeşitli GNN mimarileri, farklı mesaj ve güncelleme fonksiyonu örneklemeleri ile önerilmiştir, chẳng hạn sebagai Graf Konvolüsyonel Ağlar (GCN), GraphSAGE, Graf Dikkat Ağları (GAT) ve Graf İzomorfizm Ağları (GIN) gibi.

Daha yakın zamanda, grafik dönüştürücüler, doğal dil dönüştürücülerden self-attention mekanizmasını grafik yapılarındaki verilere uyarlayarak popülerlik kazanmıştır. Bazı örnekler arasında GraphormerTransformer ve GraphFormers bulunur. Bu modeller, salt komşu tabanlı GNN’lerden daha iyi grafik boyunca uzun menzilli bağımlılıkları yakalayabilir.

Grafikler Üzerinde Kendi Kendine Denetimsiz Öğrenme

GNN’ler güçlü temsil modelleri olsa da, performansları genellikle büyük etiketli veri kümelerine ihtiyaç duyan denetimli eğitim tarafından sınırlıdır. Grafik verisinin içsel yapısını kullanarak yalnızca etiketli verilere gerek duymayan ön görevler tasarlayarak GNN’leri kendi kendine denetimsiz olarak eğitebilen kendi kendine denetimsiz öğrenme, umut verici bir paradigm olarak ortaya çıkmıştır.

Kendi Kendine Denetimsiz Graf – kaynak

GNN ön-eğitiminde kullanılan bazı ortak ön görevler şunlardır:

- Düğme Özellik Tahmini: Düğüm özniteliklerinin bir kısmını rastgele maskeleme veya bozma ve GNN’ye bunları yeniden oluşturma görevi verme.

- Kenar/Bağlantı Tahmini: Rastgele kenar maskeleme temelinde iki düğüm arasında bir kenar olup olmadığını öğrenme.

- Karşılaştırmalı Öğrenme: Aynı grafik örneğinin farklı görünümleri arasındaki benzerlikleri maksimize ederken, farklı grafiklerin görünümlerini uzaklaştırmak.

- Ortak Bilgi Maksimizasyonu: Yerel düğüm temsilimleri ile bir hedef temsil (örneğin, küresel grafik gömme) arasındaki ortak bilginin maksimize edilmesi.

Bu ön görevler, GNN’nin etiketsiz grafik verisinden anlamlı yapısal ve anlamsal kalıpları çıkarmasına izin verir. Ön-eğitilmiş GNN, daha sonra çeşitli aşağı akış görevlerinde mükemmelleşmek için küçük etiketli alt kümelerine fine-tune edilebilir.

Kendi kendine denetimsiz öğrenme yoluyla, büyük etiketsiz veri kümelerine eğitim gören GNN’ler, sıfırdan eğitim görenlere göre daha iyi genellemeye, dağıtım değişikliklerine karşı daha fazla dayanıklılığa ve verimliliğe sahiptir. Ancak, geleneksel GNN tabanlı kendi kendine denetimsiz yöntemlerin bazı kilit sınırlamaları masih devam etmektedir, bunları LLM’leri kullanarak ele almayı sonraki adımda keşfedeceğiz.

Büyük Dil Modelleri ile Grafik Makine Öğrenimini Geliştirme

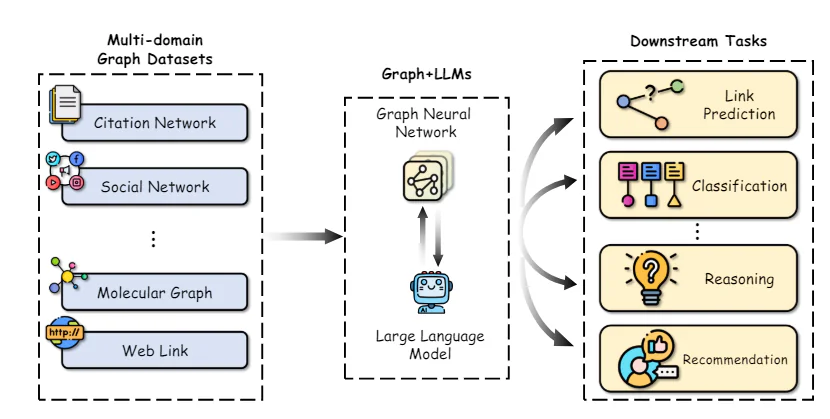

Grafik ve LLM Entegrasyonu – kaynak

LLM’lerin doğal dil anlama, akıl yürütme ve birkaç örnek öğrenme yetenekleri, grafik makine öğrenimi boru hatlarının çeşitli yönlerini geliştirme fırsatları sunar. Bu alanda bazı kilit araştırma yönlerini keşfedeceğiz:

GNN’leri uygulamadaki bir kilit zorluk, düğümler ve kenarlar için yüksek kaliteli özellikli temsil elde etmektir, özellikle bunlar zengin metin özniteliklerine sahipse. Geleneksel olarak, basit bir torba kelimeleri veya önceden eğitilmiş kelime gömme modelleri kullanılmıştır, ancak bunlar genellikle nüanslı anlamları yakalayamaz.

Son çalışmalar, metin düğümlü özniteliklerini GNN’ye geçmeden önce daha iyi düğümlü/kenar özellikli temsil oluşturmak için LLM’leri metin kodlayıcısı olarak kullanmanın gücünü göstermiştir. Örneğin, Chen et al., GPT-3 gibi LLM’leri kullanarak metin düğümlü özniteliklerini kodlamakta ve geleneksel kelime gömme modellerine kıyasla düğme sınıflandırma görevlerinde önemli performans kazançları elde etmektedir.

Metin kodlayıcısından daha öte, LLM’ler orijinal metin özniteliklerinden artırılmış bilgi üretebilir. TAPE, bir LLM kullanarak düğümler için potansiyel etiketler/açıklamalar üretir ve bunları ek artırılmış özellikler olarak kullanır. KEA, metin özniteliklerinden terimleri çıkarır ve bu terimlerin ayrıntılı açıklamalarını alır.

Giriş özellikleri kalitesini ve ifade edilebilirliğini iyştirerek, LLM’ler doğal dil anlama yeteneklerini GNN’lere aktarabilir ve aşağı akış görevlerinde performansı artırabilir.