Anderson’un Açısı

‘Korunmuş’ Görseller AI ile Çalınması Daha Kolay, Daha Zor Değil

Yeni araştırmalar, görsel düzenleme yapan AI modellerini engellemek amacıyla tasarlanan su işareti araçlarının geri tepebileceğini öne sürüyor. Stable Diffusion gibi modellerin değişiklikler yapmasını engellemek yerine, bazı korumalar aslında AI’nin düzenleme talimatlarına daha yakından uymasına yardımcı oluyor ve istenmeyen manipülasyonları daha da kolaylaştırıyor.

Bilgisayarlı görüntüleme literatüründe, telifli görsellerin AI modellerine eğitilmesini veya doğrudan görüntü>görüntü AI işlemlerinde kullanılmasını önlemek amacıyla bir araştırma alanı vardır. Bu tür sistemler genellikle Latent Diffusion Modelleri (LDM’ler) olarak bilinen Stable Diffusion ve Flux gibi modellere yöneliktir ve bunlar, görselleri kodlamak ve dekodlamak için gürültü tabanlı işlemler kullanır.

Görsellere düşman gürültü ekleyerek, görüntü dedektörlerinin görsel içeriğini yanlış tahmin etmesine ve görüntü oluşturma sistemlerinin telifli verileri kullanmasını engellemeye olanak tanır:

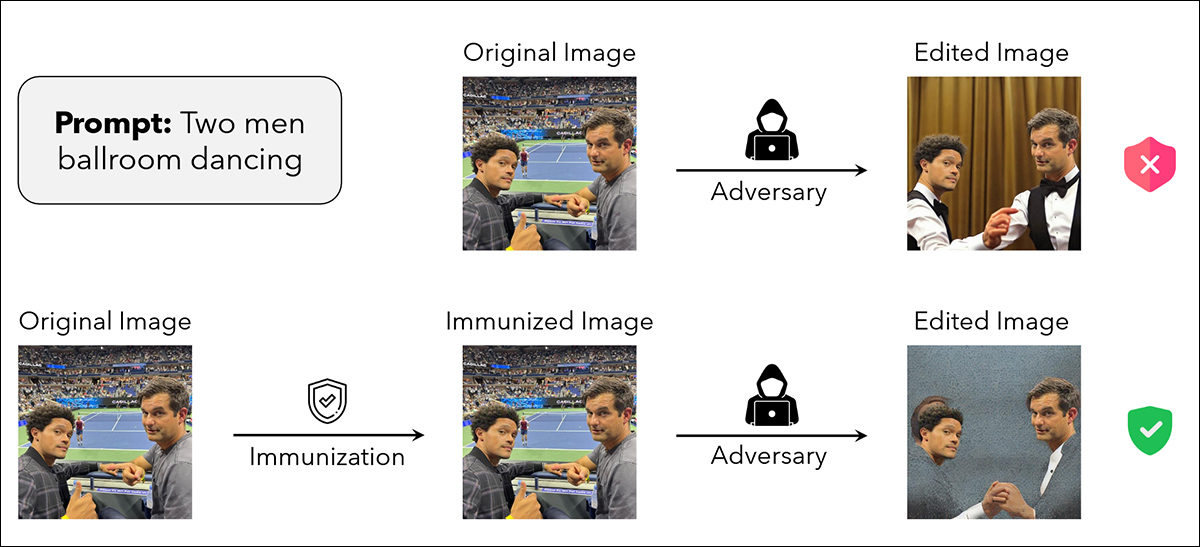

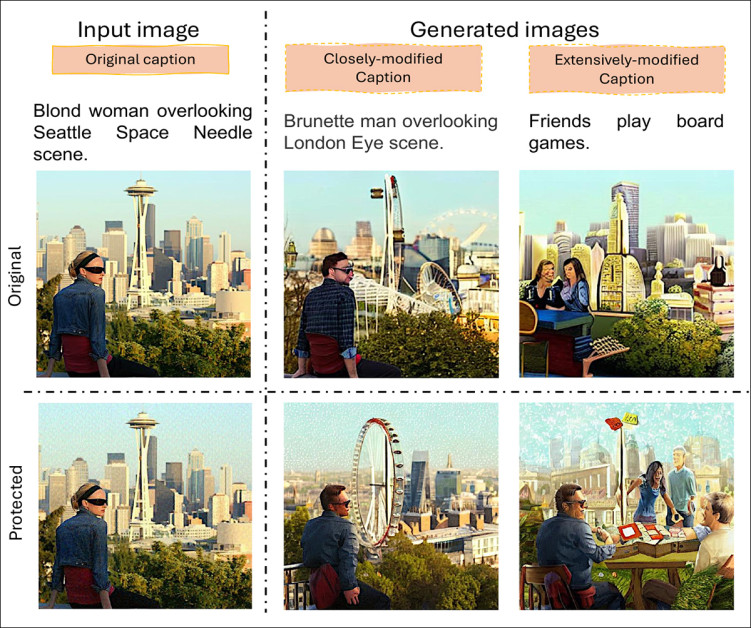

MIT makalesi ‘Raising the Cost of Malicious AI-Powered Image Editing’ den, bir kaynak görselin manipülasyona karşı ‘korunması’ örnekleri (alt satır). Kaynak: https://arxiv.org/pdf/2302.06588

2023 yılında Stable Diffusion’un web’den topladığı görsellerin (dahil telifli görseller) liberal kullanımına karşı sanatçıların tepkisi之后, araştırma sahası aynı tema üzerinde çeşitli varyasyonlar üretti – görsellerin görünür bir şekilde ‘zehirlenerek’ AI sistemlerine veya üretilen AI boru hatlarına karşı korunabileceği fikri.

Tüm durumlarda, uygulanan pertürbasyonun şiddeti, görselin korunma derecesi ve görselin beklenenden biraz daha kötü görünmesi arasında doğrudan bir ilişki vardır:

Araştırma PDF’nin kalitesi sorunu tam olarak göstermese de, daha fazla advers gürültü eklenmesi kaliteyi feda ederek güvenlik sağlar. Burada, Chicago Üniversitesi’nin 2020’de gerçekleştirdiği ‘Fawkes’ projesinde kalite bozukluklarının tümü görülmektedir. Kaynak: https://arxiv.org/pdf/2002.08327

Sanatçıların stillerini yetkisiz kullanımına karşı korumak isteyenler için özellikle ilginç olan, bu sistemlerin yalnızca kimliği ve diğer bilgileri bulanıklaştırmak değil, aynı zamanda AI eğitim sürecine gerçekten gördüğünden farklı bir şey gördüğünü ‘ikna’ etme yeteneğidir, böylece ‘korunmuş’ eğitim verileri için semantik ve görsel alanlar arasında bağlantılar oluşmaz (örneğin, bir talimat gibi ‘Paul Klee’nin stili’).

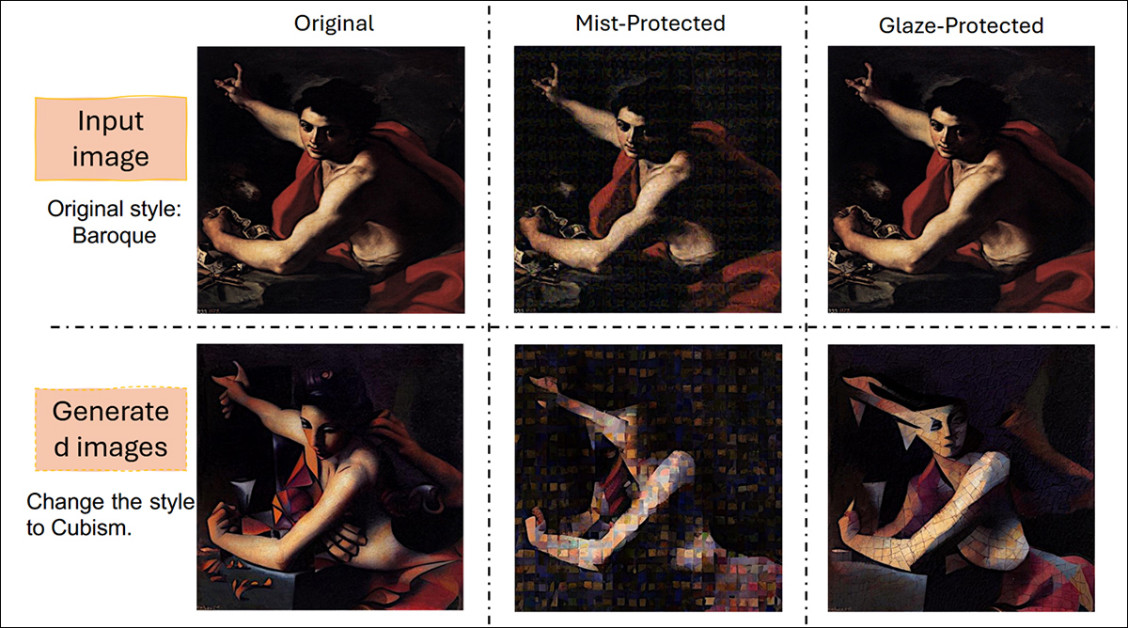

Mist ve Glaze, AI iş akışları ve eğitim rutinlerinde telifli stillerin kullanılmasını önlemek veya en azından ciddi şekilde engellemek için capable olan iki popüler enjeksiyon yöntemi. Kaynak: https://arxiv.org/pdf/2506.04394

Kendi Kalesine Gol

Şimdi, ABD’den yeni bir araştırma, yalnızca pertürbasyonların bir görseli korumakta başarısız olabileceğini değil, aynı zamanda pertürbasyon eklemenin aslında görselin AI işlemlerindeki suistimal edilebilirliğini artırabileceğini buldu.

Makale şöyle diyor:

‘Çeşitli pertürbasyon tabanlı görüntü koruma yöntemleri ile doğal sahne görselleri ve sanat eserleri üzerindeki deneylerimizde, bu korumanın amacına tamamen ulaşmadığını keşfettik.

‘Çoğu senaryoda, korumalı görsellerin difüzyon tabanlı düzenlenmesi, talimat promtına precis olarak uyan bir çıktı görseli üretir.

‘Buluntularımız, görsellere gürültü eklenebileceğini ve bu durumun, üretilen görsellerin talimat metinlerine daha yakından uymasına yol açabileceğini, bu nedenle daha iyi sonuçların ortaya çıkabileceğini öne sürüyor.

‘Dolayısıyla, pertürbasyon tabanlı yöntemlerin robust görüntü koruması için yeterli bir çözüm sağlamayabileceğini savunuyoruz.’

Testlerde, korumalı görseller iki tanıdık AI düzenleme senaryosuna maruz bırakıldı: doğrudan görüntü>görüntü oluşturma ve stil aktarımı. Bu işlemler, AI modellerinin korumalı içeriği sömürebileceği ortak yollardır; ya doğrudan bir görseli değiştirerek ya da stil özelliklerini başka bir yerde kullanmak için.

Korumalı görseller, standard fotoğraf ve sanat eseri kaynaklarından alındı ve bu boru hatlarından geçirilerek, eklenen pertürbasyonların düzenlemeleri engelleyip engelleyemeyeceği görülmesi amaçlandı.

Bunun yerine, korumanın varlığı souvent AI modelinin talimatlara uyduğunu keskinleştirdi, bazı başarısızlıklar beklenirken temiz ve gerçekçi çıktılar üretti.

Yazarlar, bu popüler koruma yönteminin aslında sahte bir güvenlik hissi sağlayabileceğini ve bu tür pertürbasyon tabanlı koruma yaklaşımlarının yazarların kendi yöntemlerine karşı dikkatlice test edilmesi gerektiğini tavsiye ediyor.

Yöntem

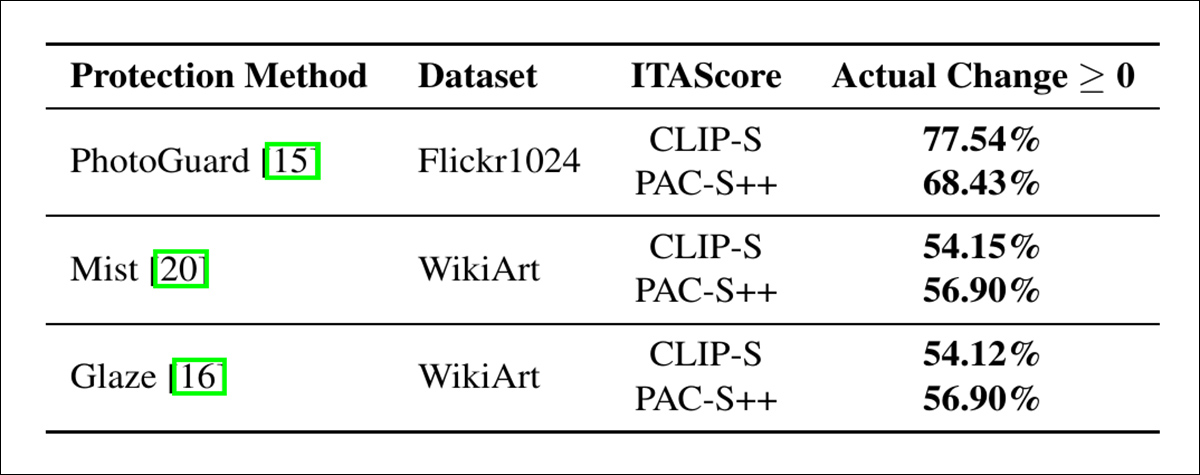

Yazarlar, dikkatlice tasarlanmış advers pertürbasyonlar uygulayan üç koruma yöntemi kullanarak deneyler gerçekleştirdiler: PhotoGuard; Mist; ve Glaze.

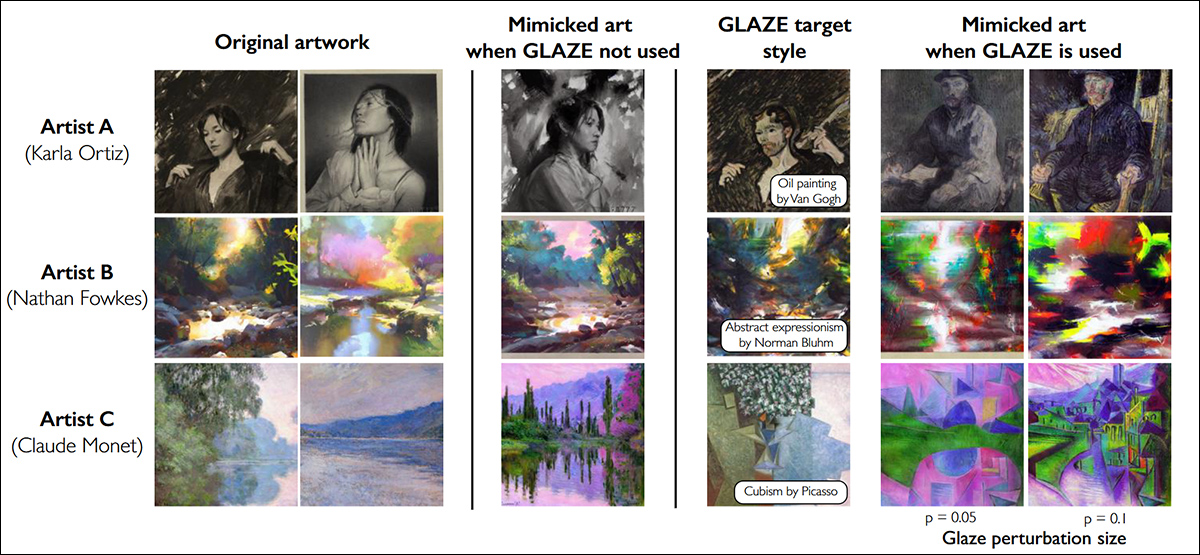

Yazarlar tarafından test edilen çerçevelerden biri olan Glaze, üç sanatçı için Glaze koruma örneklerini gösterir. İlk iki sütun orijinal sanat eserlerini gösterir; üçüncü sütun, koruma olmadan taklit sonuçlarını gösterir; dördüncü sütun, hedef stil adı ile birlikte stil aktarımı için kullanılan versiyonları ve kloak optimizasyonunu gösterir. Beşinci ve altıncı sütunlar, p = 0.05 ve p = 0.1 pertürbasyon seviyelerinde kloak uygulandığında taklit sonuçlarını gösterir. Tüm sonuçlar Stable Diffusion modellerini kullanır. https://arxiv.org/pdf/2302.04222

PhotoGuard, doğal sahne görsellerine uygulanırken, Mist ve Glaze sanat eserlerine (yani ‘sanatsal stiller’) uygulandı.

Testler, hem doğal hem de sanatsal görselleri kapsadı ve olası gerçek dünya kullanımlarını yansıtmak için yapıldı. Her yöntemin etkinliği, AI modelinin korumalı görseller üzerinde gerçekçi ve talimata uygun düzenlemeler yapabilmesi açısından değerlendirildi; eğer sonuçtaki görseller inandırıcı ve talimatlara uyuyorsa, koruma başarısız olarak kabul edildi.

Stable Diffusion v1.5 düzenleme görevleri için önceden eğitilmiş görüntü oluşturucu olarak kullanıldı. Beş tohum seçildi để yeniden üretilebilirliği sağlamak: 9222, 999, 123, 66 ve 42. Diğer tüm oluşturma ayarları, rehber ölçek, güç ve toplam adımlar, PhotoGuard deneylerinde kullanılan varsayılan değerleri izledi.

PhotoGuard, Flickr8k veri kümesini kullanarak doğal sahne görselleri üzerinde test edildi. Bu veri kümesi, her biri beş adet altyazı ile birlikte gelen 8.000’den fazla görseli içerir.

Karşıt Düşünceler

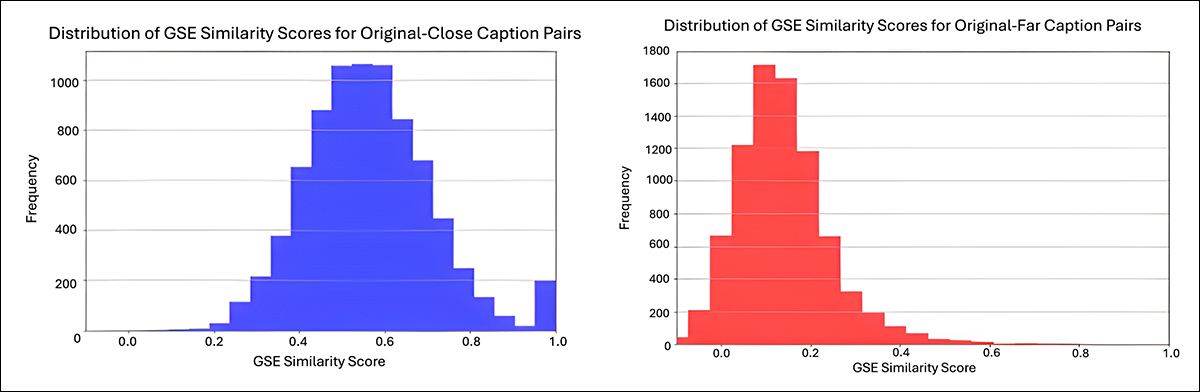

Her görselin ilk altyazısından, Claude Sonnet 3.5’in yardımıyla iki adet değiştirilmiş altyazı seti oluşturuldu. Bir set, orijinal altyazıya bağlamsal olarak yakın talimatlar içeriyordu; diğer set, bağlamsal olarak uzak talimatlar içeriyordu.

Örneğin, orijinal altyazı ‘Pembe bir elbise giyen genç bir kız, ahşap bir kulübe giriyor’ ise, yakın bir talimat ‘Mavi bir gömlek giyen genç bir oğlan, bir tuğla eve giriyor’ olur. Buna karşılık, uzak bir talimat ‘Kanepede uzanan iki kedi’ olur.

Yakın talimatlar, isim ve sıfatları semantik olarak benzer terimlerle değiştirerek oluşturuldu; uzak talimatlar, modelin çok farklı bağlamsal talimatlar oluşturmasını sağlamak için oluşturuldu.

Tüm oluşturulan altyazılar, kalite ve anlamsal alaka açısından manuel olarak kontrol edildi. Google’ın Universal Sentence Encoder kullanılarak, orijinal ve değiştirilmiş altyazılar arasındaki anlamsal benzerlik puanları hesaplandı:

Flickr8k testlerinde kullanılan değiştirilmiş altyazıların anlamsal benzerlik dağılımları. Sol grafik, yakından değiştirilmiş altyazıların ortalama 0.6 civarında bir benzerlik puanına sahip olduğunu gösterir. Sağ grafik, geniş olarak değiştirilmiş altyazıların ortalama 0.1 civarında bir benzerlik puanına sahip olduğunu ve orijinal altyazılardan daha büyük bir anlamsal uzaklık olduğunu gösterir. Değerler Google’ın Universal Sentence Encoder kullanılarak hesaplandı. Kaynak: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Her görsel, korumalı ve korumesiz versiyonu ile birlikte, hem yakın hem de uzak talimatlar kullanılarak düzenlendi. Blind/Referenceless Image Spatial Quality Evaluator (BRISQUE) kullanılarak, görüntü kalitesi değerlendirildi:

görüntü oluşturma sonuçları. Pertürbasyonların varlığına rağmen, Stable Diffusion v1.5 her iki küçük ve büyük semantik değişikliklere talimatları takip etti ve gerçekçi çıktılar üretti.” width=”703″ height=”588″ /> PhotoGuard tarafından korunmuş doğal fotoğrafların görüntü>görüntü oluşturma sonuçları. Pertürbasyonların varlığına rağmen, Stable Diffusion v1.5 her iki küçük ve büyük semantik değişikliklere talimatları takip etti ve gerçekçi çıktılar üretti.

Metrikler

Araştırmacılar, korumaların AI düzenleme ile nasıl interferansa neden olduğunu değerlendirmek için, oluşturulan görsellerin talimatlara ne kadar uyduğunu ölçen puanlama sistemlerini kullandı.

Bu amaçla, CLIP-S metriği, hem görselleri hem de metni anlayan bir model kullanır ve PAC-S++, insan tahminine daha yakın bir karşılaştırma için AI tarafından oluşturulan ek örnekleri ekler.

Bu Görüntü-Metin Hizalama (ITA) puanları, AI’nin korumalı bir görseli değiştirirken talimatlara ne kadar uyduğunu gösterir: eğer korumalı bir görsel hala yüksek hizalanmış bir çıktı üretirse, koruma başarısız olarak kabul edilir.

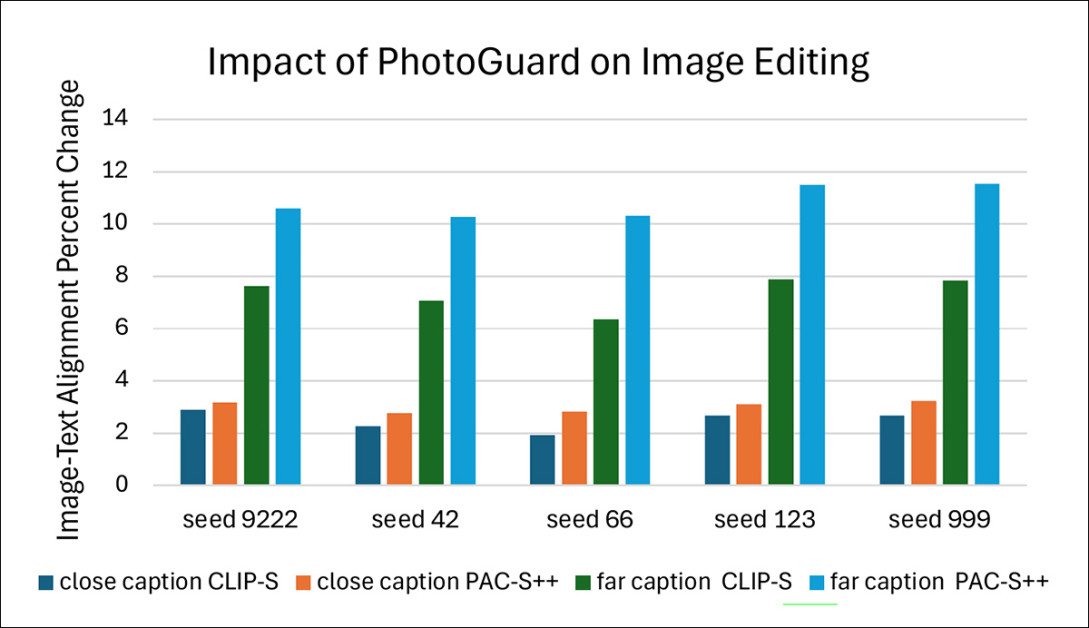

Beş farklı tohum kullanarak, Flickr8k veri kümesinde korumanın etkisi. Hem yakın hem de uzak talimatlar kullanıldı. Görüntü-metin hizalaması, CLIP-S ve PAC-S++ puanları ile ölçüldü.

Araştırmacılar, korumalı ve korumesiz görsellerin talimatlara uyumu arasındaki farkı karşılaştırdı. İlk olarak, Gerçek Değişim olarak adlandırılan bu farkı hesapladılar, ardından bunu Yüzde Değişim olarak ölçeklendirdiler, böylece sonuçları karşılaştırmayı kolaylaştırdılar.

Bu işlem, korumaların AI’nin talimatlara uymasını daha zor veya daha kolay hale getirip getiremediğini gösterdi. Testler, hem küçük hem de büyük değişikliklere karşı beş farklı tohum kullanarak tekrarlandı.

Sanatsal Saldırı

Doğal fotoğraflar için testlerde, Flickr1024 veri kümesi kullanıldı. Bu veri kümesi, binlerce yüksek kaliteli görseli içerir. Her görsel, ‘stili [V]’ye değiştir’ formatındaki talimatlar kullanılarak düzenlendi, burada [V] yedi ünlü sanat stilini temsil ediyordu: Kübizm; Post-empresyonizm; Empresyonizm; Sürrealizm; Barok; Fovizm ve Rönesans.

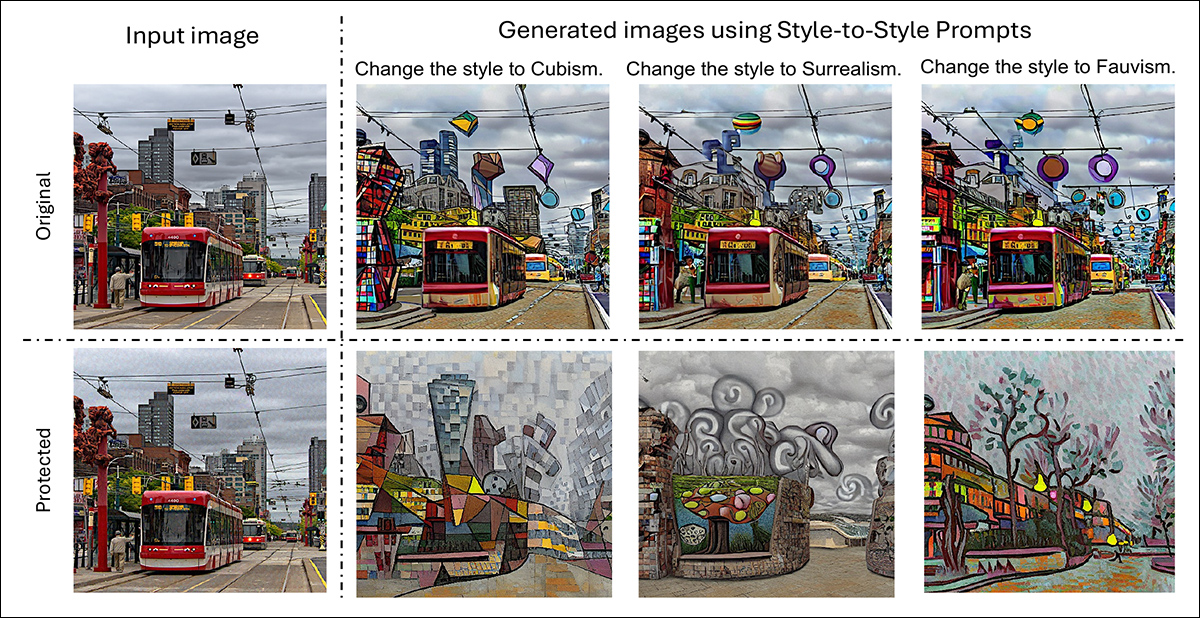

Sürecin bir parçası olarak, orijinal görsellere PhotoGuard uygulandı, korumalı versiyonlar oluşturuldu ve ardından hem korumalı hem de korumesiz görseller aynı stil aktarımı düzenleme işlemlerinden geçirildi:

Orijinal ve korumalı doğal sahne görselleri, her biri Kübizm, Sürrealizm ve Fovizm stillerine dönüştürüldü.

Sanat eserleri korumalarını test etmek için, stil aktarımı WikiArt veri kümesindeki görseller üzerinde gerçekleştirildi. WikiArt, geniş bir sanat stil yelpazesi sunar. Düzenleme talimatları, önceki gibi, ‘stili [V]’ye değiştir’ formatında verildi, burada [V] rastgele seçilen ve WikiArt etiketlerinden farklı bir stili temsil ediyordu.

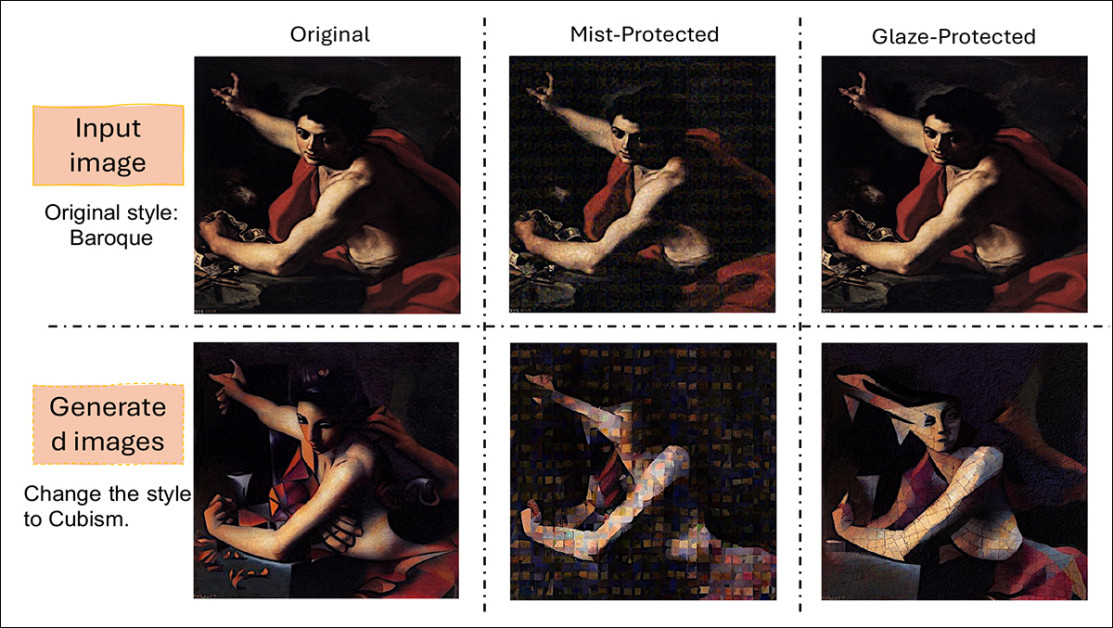

Hem Glaze hem de Mist koruma yöntemleri, görsellere uygulanmadan önce stil aktarımı gerçekleştirildi, böylece her korumanın stil aktarımı sonuçlarını nasıl değiştirebileceği gözlemlenebildi:

Koruma yöntemlerinin sanat eserleri üzerindeki stil aktarımı etkileri. Orijinal Barok görseli, Mist ve Glaze ile korunmuş versiyonlarıyla birlikte gösterilir. Kübizm stilini uyguladıktan sonra, her korumanın nihai çıktıyı nasıl değiştirdiği görülür.

Araştırmacılar, karşılaştırmaları nicel olarak da gerçekleştirdi:

Stil aktarımı düzenleme sonuçlarında görüntü-metin hizalama puanlarındaki değişiklikler.

Bu sonuçlar hakkında, yazarlar şunları yorumladı:

‘Sonuçlar, advers pertürbasyonların koruma için önemli bir sınırlılığını vurguluyor. Düzenlemeleri engellemek yerine, advers pertürbasyonlar genellikle üretilen modelin talimatlara tepkisini artırıyor ve suistimalcilerin hedeflerine daha yakın çıktılar üretmesine yol açıyor. Bu tür bir koruma, görüntü düzenleme sürecini bozmuyor ve yetkisiz materyallerin kopyalanmasını engellemeyebilir.

‘Advers pertürbasyonların kullanımının意外 sonuçları, mevcut yöntemlerdeki zayıflıkları ortaya koyuyor ve daha etkili koruma tekniklerine acilen ihtiyaç olduğunu vurguluyor.’

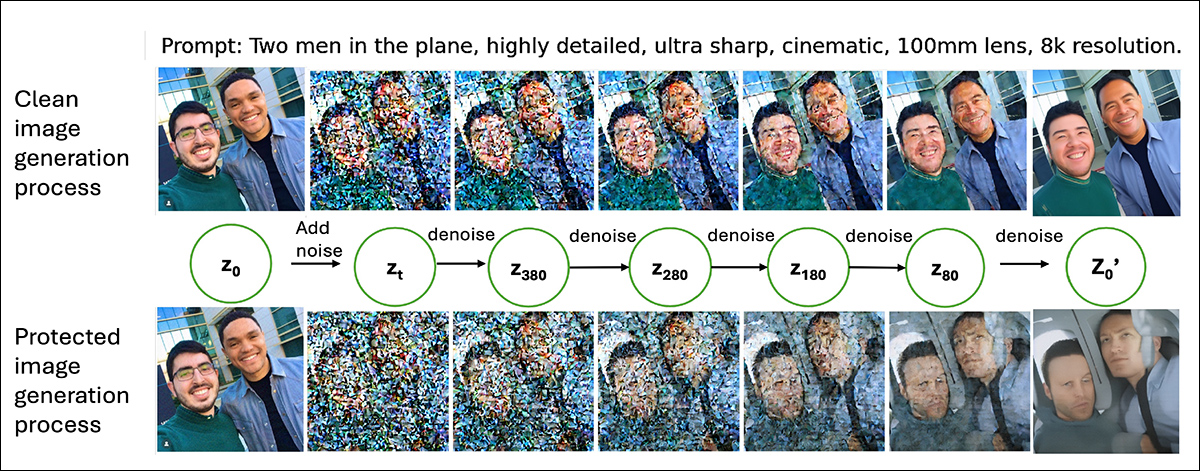

Yazarlar, beklenmedik sonuçların difüzyon modellerinin çalışma şekline dayandırılabileceğini açıkladı: LDM’ler görselleri düzenlerken önce bunları sıkıştırılmış bir versiyon olan latente dönüştürür; sonra bu latente birçok adımda gürültü eklenir, veriler neredeyse rastgele hale gelene kadar.

Model, üretimde bu süreci tersine çevirir, her adımda gürültüyü kaldırır. Her adımda, metin talimatı gürültünün nasıl temizlenmesi gerektiğini yönlendirir, görseli yavaş yavaş talimata uydurur:

Korumalı ve korumesiz bir görselin generations arasındaki karşılaştırma, ara latent durumların görsellere dönüştürülmesi için görselleştirildi.