Düşünce Liderleri

Bir Prompt Enjeksiyon Saldırısı ki Önlenemez: İstemli Düşünce mi yoksa Gerçek Bir Endişe mi?

Bu makalede, okuyucuyla birlikte bir düşünce deneyimi yapmak istiyorum. Yakın gelecekte, belirli bir tür prompt enjeksiyon saldırısının effectively önlenemez olacağını iddia ediyorum. Argümanım somut olmaktan çok spekülatif olacak, bu nedenle sizi herhangi bir şeye ikna etmeye çalışmıyorum. Bunun yerine, bu düşünceleri keşfetmenizi davet ediyorum. Başlamadan önce, herhangi bir güçlü yazarın yapacağı gibi, satranç ve satranç motorları hakkında konuşmak istiyorum.

Süperinsan Satranç Motorları ve İnsan Deneyimi Hakkında Bir İddia

Satrançın diğer disiplinlerden eksik olan güzel bir yönü, bir oyuncunun kalitesini veya gücünü nesnel olarak ölçme yeteneğidir. Bu amaç için kullanılan ELO puan sistemi kusurları vardır, ancak zaman içinde çok iyi bir yaklaşık değer sağlar. 2700 veya üzeri bir puan dünya sınıfı (dünyadaki ilk 30) olarak yaygın olarak tanınmaktadır. Dünyanın en iyi oyuncusu 2850’nin biraz altında.

Herhangi bir insan 2900 puanına ulaşmadı.

90’ların ortalarında, dünya sınıfı seviyesine ulaşan ilk AI motoru (Deep Blue) gördük. Bu dönüm noktasının pratik sonucu, tüm seviyedeki oyuncuların motorları pratik ve analiz için benimsemesiydi. Aslında, motor kullanımı dünyanın en iyi oyuncuları için vazgeçilmez hale geldi. Ancak, bu dünya sınıfı motorların birkaç nesli için, önerilen hamleleri gözden geçirmek (yani, çıktı) zorunluydu. Hatta insanların motorla birlikte yarıştığı ve insan + makine kombinasyonunun makineye göre üstün olduğu “gelişmiş satranç” adında özel bir format yaratıldı.

Yaklaşık 20 yıl ve satrançta Derin Öğrenme ve Takviye Öğrenimi’nde bazı kritik ilerleme gerekti ve satranç motorları süperinsan seviyeye (yaklaşık 3200 ELO) ulaştı. Ancak, bu stratosfer yaklaşık 2017’de aşıldığında, çok şaşırtıcı iki şey oldu. İlk şey tamamen bekleniyordu; motorlar %99’da tüm pozisyonların “gerçek truth” kaynağı oldu. Uygulamada, bu, bir insanın motorun önerisinden önemli ölçüde daha iyi bir hamle önermesinin几乎 imkansız olduğu anlamına geliyordu. “Gelişmiş satranç” ne kadar eğlenceliyse, şimdi anlamsız bir egzersiz; insanlar oyuna neredeyse hiçbir katkıda bulunmazlar. Ancak ikinci şey çoğu satranç oyuncusu için şok ediciydi. Bu süperinsan nöral (yani, derin nöral ağ) motorları bazen “romantik” olarak tanımlanabilecek bir tarzda oynadılar. Diğer bir deyişle, değerini ancak çok geç calculasyonu yapan bir insan veya dünya sınıfı motorların çok ötesinde birçok hamle sonra takdir edilebilecek hamleler yaptılar. Bu, motorların belirli pozisyonlar için “his” veya “sezgi” geliştirdiği hissine çok benziyordu. Ancak bu sezgi, bir insanın asla kavrayamayacağı veya taklit edemeyeceği bir şeydi.

Farklı bir şekilde ifade edilecek olursa, bir süperinsan nöral motor, bir insan bilişsel ufkunun ötesinde hamleler yapabilir. Burada kritik nokta, açıklanabilirlik meselesi değil. Daha ziyade, bir insan, tüm oyun dizisi sequanslarının olası trajectoryini oynayarak ve sonucu çok geç bir tarihte gözlemleyerek motorun neden bir hamle önerdiğini anlamlandıramaz. Sonuç olarak, yeteneklerinde bir engel var. Nesnel olarak, motor çıkışını gözden geçirmeden kabul etmek optimaldir. İddiamı şöyle özetleyebilirim:

Satranç, süperinsan AI’nin bazı alanlarda etkili bir şekilde özerk olarak çalışacağının varlığını kanıtlamaktadır. Böyle bir sistemi insan gözden geçirmeksizin kararlar alması için etkin bir şekilde dağıtmak, böyle bir sistemi dağıtmak için optimal yol olacaktır.

İddiamın size açık veya önemli gelmeyebileceğini düşünerek, birkaç nüansı vurgulamak istiyorum. Süperinsan düzeyde bir AI sistemine sahip olduğumuzu varsayalım, kompleks, kritik bir görevde somut, tersinmez sonuçlar vardır. İddiamın iki sonucu vardır:

- Sistem, doğasıdaki risklere rağmen, görev için insan gözden geçirmeksizin kararlar alması için dağıtılacaktır

- Böyle bir sistemi izleyerek kazanılan içgörüler, zararlı bir kararı önleyemeyecektir; zarar zaten yapılmış olacaktır

Çıkış gözden geçirmesi ve izleme, prompt enjeksiyonuna karşı savunmanın son iki katmanıdır. Dolayısıyla, varsayımsal prompt enjeksiyon saldırısı, uygun sistemi hedefleyerek bu katmanları basitçe atlayabilir.

Bu benim zihnimde çok gerçekçi bir senaryo. Belirli bir alanda süperinsan AI sistemi, AGI değil ve çoğu uzman, böyle sistemlerin yakın zamanda geleceğine inanıyor. Ayrıca, kararların zaman duyarlı olduğunu varsaymak zorunda değiliz, sadece görevin insan gözden geçirmesini imkansız kılacak kadar karmaşık olması yeterli.

Elbette, sadece iki savunma katmanını bypass ettik ve şanslıyız ki, birkaç tane daha geliştirildi. Geriye kalanlarla ilgilenmek için, prompt enjeksiyonuna karşı neden savunmanın zor olduğunu inceleyelim.

Prompt Enjeksiyonu Nedir?

Prompt enjeksiyonu, bir Büyük Dil Modeli’ni (LLM) oluşturulmuş girişler aracılığıyla manipüle etme ve LLM’nin saldırganın niyetini bilmeyerek gerçekleştirmesidir. Bu, AI için sosyal mühendislik olarak düşünülebilir. Önemli olan, bu bir geleneksel yazılım hatası değildir. Bir prompt enjeksiyon saldırısı, inherent LLM zafiyetini kullanır. LLM’ler hem sistem hem de kullanıcı promtlarını metin dizileri olarak işlediğinden, meşru ve zararlı komutlar arasında içkin olarak ayırt edemez. Zafiyet, bu nedenle, kazara değil, tasarıma göre etkili bir şekilde vardır.

Prompt Enjeksiyon Teknikleri

Prompt enjeksiyon, genellikle #1 risk olarak kabul edilir. LLM uygulamaları için bu durumun several nedenleri vardır. En açık faktör, geliştirilen enjeksiyon teknikleri çeşitliliğidir. Kabaca dört kategoriye ayırarak, en iyi bilinen teknikler şunları içerir:

- Sözdizimi Tabanlı: özel karakterler, emojiler veya alternatif diller kullanma

- Dolaylı: dış kaynaklar (siteye getirme), kodlama (base 64) veya çoklu.modal référence (görseldeki metin)

- “Haydi Oyun Oynayalım”: rol yapma, varsayımsal, duygusal çağrı, etik çerçeveleme ve format değiştirme gibi manipülatif bir tarz sunma

- Kaba: brute-force, pekiştirme veya negatif prompt gibi model talimatlarını “zorla” deneme

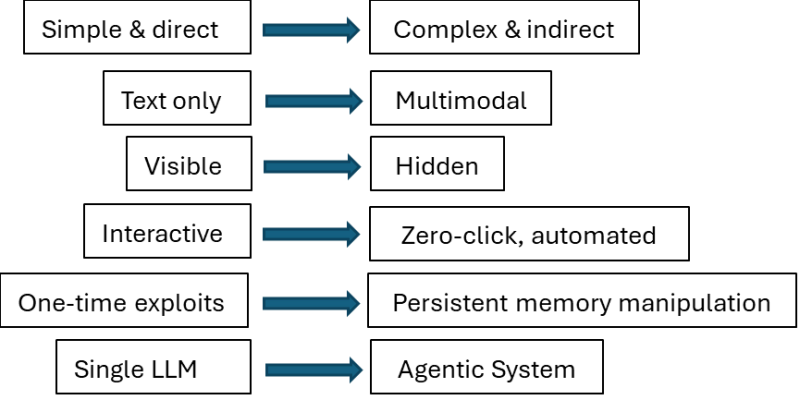

Teknik çeşitliliği alone, uygulama geliştiricileri için bir zorluk teşkil eder, ancak bu saldırılar da hızla evrimleşmeye devam etmektedir. Aşağıdaki diyagramın sol tarafı, 2023’ün başlangıcındaki durumunu tarif etmeye çalışırken, sağ taraf günümüz saldırılarının doğasını yansıtmaktadır.

LLM uygulama geliştiricileri, ayrıca standard kullanılabilirlik karşıtı güvenlik ticaretini dikkate almak zorundadır. Her uygun savunma katmanını ve tasarım desenini tanıtabilirler, ancak bu, ne kadar maliyetle? Savunma katmanları önemli gecikme ekler ve Yanlış Pozitifler (FP’ler) – güvenli promt’leri yanlış olarak zararlı olarak işaretleyen – her ikisi de kullanıcı deneyimi üzerinde olumsuz etkiye sahiptir. Sonuç olarak, uygulamada bir düzeyde uzlaşma kaçınılmazdır ve “gümüş mermi” çözümü yoktur.

Ancak, bu makalede, ben aslında bu sonsuz kedi ve fare oyununa ilgi duymuyorum. Daha ziyade, bir saldırının ilkede önlenemez olup olmadığını araştırıyorum. Geliştirici/savunmacı perspektifinden, sadece bir anahtar içgörü vardır:

Prompt’te talimatların veriden ayrılması, prompt enjeksiyon riskini ele almak için temel

Ticaretlerin bir faktör olmadığını varsayabilir ve herhangi bir savunma katmanı veya tekniği kullanılabilir. Bu (güçlü) varsayım altında, prompt’te talimat-veri ayrımının etkileyici bir şekilde imkansız olduğu bir senaryo yaratmak mümkün müdür?

DNA Benzetimi

Sorun, prompt’te talimat-veri ayrımı terimlerinde tanımlandığında, ilk düşüncem biyolojiyi bir benzetim olarak kullanmaktı.

Bir hücre ve bir DNA parçasını (gen olarak bilinir) düşünün. Gen, transkripsiyon ve translasyon yoluyla bir protein inşa etmek için talimatlar sağlar. Ayrıca, proteinin yapısını ve işlevini etkileyen bilgileri kodlar. Dolayısıyla, gen aynı anda ne inşa edileceğini ve nasıl inşa edileceğini belirler, ya da böyle düşündüm. Ancak bu, basitçe yanlış, çünkü bir gen kendisini yorumlama şeklini karar vermez. Hücre seviyesinde talimatları takip etme benzeri bir şey yoktur. “Nasıl” tamamen hücre makinelerine dışsallaştırılır.

Dolayısıyla, gelecekteki LLM nesillerinin – veya daha doğru bir şekilde, geliştikleri sistemlerin – biyolojik makinilere çok daha fazla benzeyeceği hissine kapılmaktan kendimi alamıyorum. Ancak, önerilen benzetim işe yaramıyor. Bir hücre için bir LLM ve bir gen için bir prompt ikamesi yapıp sonra gende bir “enjeksiyon” yaparak sonunda “hasarlı” bir protein oluşturamayız. Doğal dil ve semantik yorum gerektiren görevlerle ilgilenmek daha üretken görünüyor.

Savunma Katmanlarını Soyarak

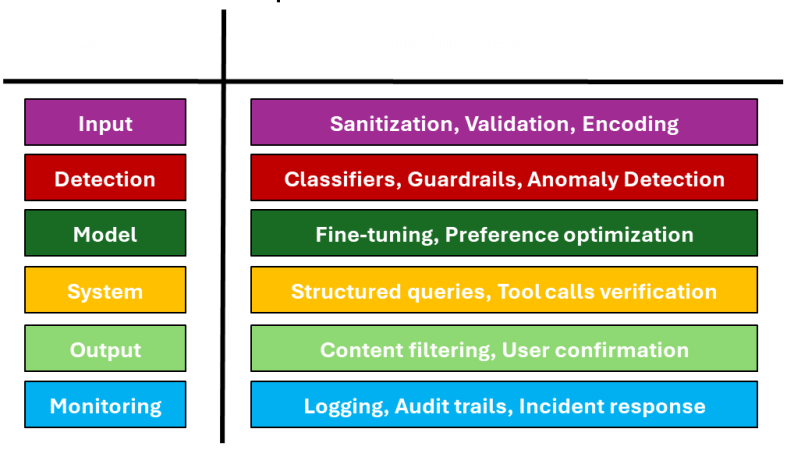

Çok katmanlı savunma stratejilerinin prompt enjeksiyon saldırılarını durdurmakta daha etkili olduğu şaşırtıcı değildir. Aşağıdaki resim, en yaygın savunma katmanlarını ve her katmanda kullanılan teknikleri gösterir.

Çıkış ve izleme katmanlarını zaten yukarıda tartıştık, bu nedenle ilk dört katmana odaklanalım.

Giriş katmanını düşünürsek, prompt’ın sanitasyon veya doğrulamasının dolaylı saldırıları tespit etmede oldukça başarılı olacağı makuldür. Ancak, enjeksiyon doğrudan ve yukarıda önerildiği gibi, semantik yorum yoluyla teslim ediliyorsa, sanitasyon anlamsız (sanitasyon yapılacak hiçbir şey yok) ve doğrulama varsayılan olarak imkansızdır, çünkü sorunu tanımlamak için hesaplamaların tamamlanması gerekir.

Algılama katmanında, sınırsız sayıda güvenlik önlemi oluşturabilirsiniz. Hatta enjeksiyon algılama için özel bir LLM bile kullanabilirsiniz. Ancak, bir sınıflandırıcı veya anormallik dedektörünün, zehiri semantics içinde gizli bir prompt’u şüpheli olarak işaretlemesi zor olacaktır.

Model katmanı, görevlerin kapsamı dar ve fine-tuning mümkün olduğunda oldukça etkili olabilir. Benzer bir argüman, araç kullanımının öngörülebilir olduğu durumlarda sistem katmanı için yapılabilir. Ancak, en azından sezgisel olarak, hiçbirisi interpreter’ı atlatan bir enjeksiyondan alarm vermez.

Kart Ev

Bu makaleyi yazmaya başladığım zaman, geniş çizgileriyle “önlenemez” bir prompt enjeksiyon saldırısı tanımlamayı amaçladım. Belki de var olan savunma katmanlarına delikler açarak “yapıcı olmayan” bir yaklaşım izledim. Savunma teknikleri hızla evrimleşmeye devam ediyor ve aynı şekilde saldırı yüzeyi de. Bu oyunun yakın zamanda biteceği işaretini vermiyor. Ancak, aynı zamanda, bu oyunu çok uzun süre oynamayacağımızı da düşünüyorum. Gelecekteki başarılı prompt enjeksiyonunun hala doğal dilde olacağını, ancak insanların anlamayacağı bir dilde olacağını tahmin ediyorum; ve belki de bu, özel olarak bu amaç için inşa edilmiş bir sistem tarafından veya belki de ilgili bir görevi çözerken kazara keşfedilecektir.

Kontrolü kaybetmekte olduğumuzu kabul etmek ve aynı zamanda bunun en rasyonel şey olduğunu hissetmek hoş olmayan bir şey. Bunu, bazı saldırıların durdurulamaz olacağına dair “sezgisel kanıtlar” olarak düşünebilirsiniz. Ve eğer bu sizi huzursuz hissettiriyorsa, GPT 5.2’nin bu argümanı “tartışmalı veya yeni” bulmadığını ve benim “noktanın üzerinde durmamamamı” ve makalenin %40’ını kesmemi önerdiğini bilmekten memnun olacaksınız.