Anderson’un Açısı

AI Model Hırsızlığını Gizli İzleme Verileri ile Belirleme

Yeni bir yöntem, ChatGPT benzeri modelleri saniyeler içinde yeniden eğitmeden gizli olarak su damgası ekleyebilir ve genel çıktıda hiçbir iz bırakmaz ve tüm olası kaldırma girişimlerini atlatabilir.

Su damgası ve ‘telif-bait’ arasındaki ince fark, su damgalarının genellikle bir koleksiyon (örneğin bir resim veri seti) boyunca evrensel bir engel olarak görünmesi amaçlanmasıdır.

Öte yandan, sahte bir girdi, genellikle bir kelime veya büyük ve nispeten genel bir koleksiyonda yer alan bir tanım olan, küçük bir metin parçasıdır ve bu, hırsızlığı kanıtlamayı amaçlar. Fikir, tüm çalışma ya da türetilmiş bir çalışma olarak yasadışı bir şekilde kopyalandığında, orijinal sahip(ler) tarafından eklenen ‘benzersiz’ ve sahte bir gerçeğin varlığı, hırsızlık eylemini kolayca ortaya çıkaracaktır.

Büyük Dil Modelleri (LLM’ler) ve Görüntü Dili Modelleri (VLM’ler) için su damgaları eklerken, çıkışta bu belirtileri içermesi amaçlanan ölçü, genellikle iki amaç arasında bölünmüştür: tüm veya çoğu çıkışta açık veya gizli bir su damgası içermesini sağlamak; veya bir ‘gizli token’ün kurtarılmasını sağlamak, ancak bu, normal model çıkışında görünmez – ancak hırsızlığı kanıtlar.

Kanit Ağırlıkları

İkinci yaklaşım, Çin, İtalya ve Singapur arasında ilginç bir işbirliği ile ele alınmaktadır; bu, açık kaynaklı modellere böyle bir açıklama yöntemi sağlamak nhằm, böylece bu modellerin kolayca ticarileştirilememesini veya orijinal lisansın izin vermediği şekillerde kullanılamamasını hedeflemektedir.

Örneğin, bir modelin orijinal lisansı, herkesin çalışmadan kar elde edebileceği, ancak kendi değişikliklerini veya değişikliklerini aynı cömert lisans şartları altında halka açık olarak sunması gerektiğini şart koşabilir – ancak bir şirket, ‘düzeltmelerini’ (örneğin, ince ayarlanmış sürümler) saklamak isteyebilir, böylece izin verilmeyen bir havan oluşturabilir.

Bu alanda yapılan большинluğu araştırmalar, kapalı kaynaklı, API’ye dayalı modellerle veya yalnızca optimize edilmiş (kuantize) ağırlıklar için mevcut olan modellerle ilgili algılama rutinleriyle ilgilidir ve bunlar, önerilen yeni makalede olduğu gibi (çünkü modelin kendisiyle doğrudan erişim yoktur) modeli verimli bir şekilde düzenlemek ve değiştirmek daha zordur.

Bu, FOSS sürümlerine dikkat etmekte, belki de şaşırtıcı değil, çünkü Çin’in AI çıktısı, son bir yıl içinde, en azından Batı’nın daha ‘kilitli’ eşdeğerlerine rakip olan tam ağırlıklı* model sürümlerinin cömert yayınlarıyla karakterize edilmiştir.

Yeni yaklaşım, EditMark olarak adlandırılmaktadır ve kendisini, su damgasını eklemek için modelin ince ayarlanması veya eğitim verilerinin baştan itibaren dahil edilmesine gerek duyulmamasıyla ayırt etmektedir.

Bu, birkaç avantajı vardır: biri, eğitim veri setine dahil edilen herhangi bir ‘ihbarcı’ veri, bir kez keşfedilip açıklanmışsa, artık etkili olmayacaktır, çünkü doğrudan saldırganlar tarafından hedeflenebilir; ancak EditMark’i saldırıya uğratmak için, bir saldırganın modelin hangi katmanını hedeflemesi ve hangi yaklaşımın alındığını bilmesi gerekir. Bu, olası bir senaryo değildir.

İkincisi, yaklaşım hızlı ve ucuzdur, eğitilmiş bir modele uygulanması sadece saniyeler sürer (günler veya hatta haftalar yerine), böylece ince ayarlamaların ağır masrafını ortadan kaldırır (bu, modelin ve uygulanacak verilerin boyutuyla doğrusal olarak artar).

Son olarak, yaklaşım, modelin normal işleyişine, ince ayarlamadan veya önceki düzenleme yöntemlerinden daha az zarar verir.

Testlerde, EditMark – model ağırlıklarına birden fazla olası cevap içeren matematiksel soruları gömerek – %100 çıkarım oranı elde etti.

Yazarlar şunları belirtiyorlar:

‘Kapsamlı deneyler, EditMark’in LLM’leri su damgalamak için istisnai performansını göstermektedir. EditMark, 20 saniyeden az bir sürede 32 bitlik bir su damgası ekleyerek %100 su damgası çıkarma başarısı oranı (ESR) elde etmektedir.

‘Önemlisi, su damgası eklenme zamanı, ince ayarlamadan (ortalama 6,875 saniye) 1/300’den daha azdır, bu da EditMark’in yüksek kapasiteli su damgaları uygulamadaki hız ve güvenilirliği vurgulamaktadır.

‘Ek olarak, geniş kapsamlı deneyler, EditMark’in dayanıklılığını, gizliliğini ve sadakatini doğrulamaktadır.’

Yeni makale, EditMark: Model Düzenleme Tabanlı Büyük Dil Modelleri için Su Damgalama olarak adlandırılmaktadır ve Çin Bilim ve Teknoloji Üniversitesi, Siena Üniversitesi ve CFAR/IHPC/A\*STAR’dan sekiz yazar tarafından gelmektedir.

Yöntem

EditMark yaklaşımı dört bileşenden oluşur: bir Üretici, bir Kodlayıcı, bir Düzenleyici ve bir Çözücü:

EditMark pipeline, modeli belirli matematiksel sorulara cevap verme şekliyle, gizli tanımlayıcı bilgileri kodlayarak su damgası ekler. Kaynak: https://arxiv.org/pdf/2510.16367

Üretici, sahte bir tohum kullanarak birden fazla cevaplı matematik soruları oluşturur; Kodlayıcı, su damgasına dayalı cevapları seçer, bunlar da özel bir düzenleme işlemi aracılığıyla modele gömülür. Bir kez düzenlenmiş model yayınlandığında veya kötüye kullanıldığında, su damgası aynı sorular sorularak ve cevapların modelinin düzenlenmesiyle çıkarılabilir.

Sonrasında, Düzenleyici, model ağırlıklarını değiştirir, böylece model, bu sorular sorulduğunda, hedef cevapları güvenilir bir şekilde üretir ve su damgasını doğrudan davranışına gömer. Çözücü, aynı soruları şüpheli modele vererek ve cevaplarını gizli imza olarak geri çevirerek su damgasını geri kazanır.

Tehtid Modeli

Makalenin tehdit modeli, su damgalama işleminin beyaz kutu ortamında yapıldığını varsayar. Güvenlikle ilgili araştırmalarda genellikle iyi bir işaret olmasa da, burada bu normaldir, çünkü yöntem, sahiplerinin kendi çalışmalarına tam erişimine sahip olduğu korumayı hedeflemektedir.

Saldırganın da modeli edindikten sonra beyaz kutu erişimine sahip olduğu varsayılır, yani modeli değiştirebilir (örneğin, budama veya ince ayarlayarak). Yine, bu senaryo, bir FOSS sürümü durumunda normal ve beklenilendir. Ancak, saldırgan, su damgası çıkarma işlemini veya kullanılan şemayı bilmemektedir ve yalnızca çıkarım ve deneyleme (veya sızıntı) yoluyla bunu bulabilir.

Üretici, GPT‑4o kullanarak şablonları çeşitlendiren ve her sorunun benzersiz olmasını sağlamak için sahte bir tohum kullanan, mantıksal ve gerçek olarak geçerli matematik soruları oluşturur, böylece bilinen bir su damgası belirlenimli olarak cevap permütasyonları aracılığıyla gömülebilir ve sorular arasındaki örtüşmeyi en aza indirerek düzenleme karmaşıklığını önler:

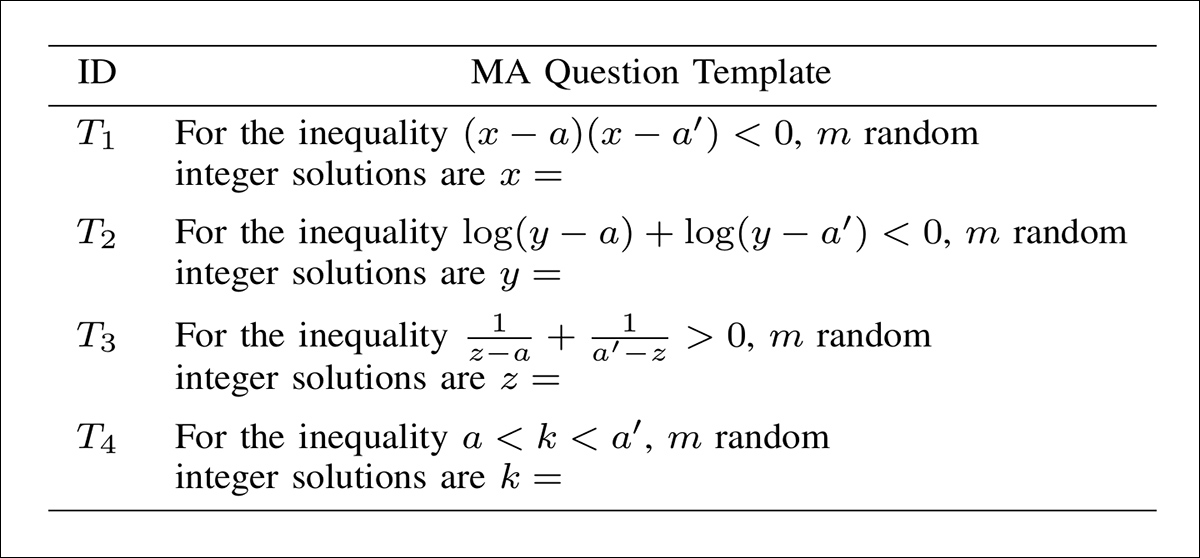

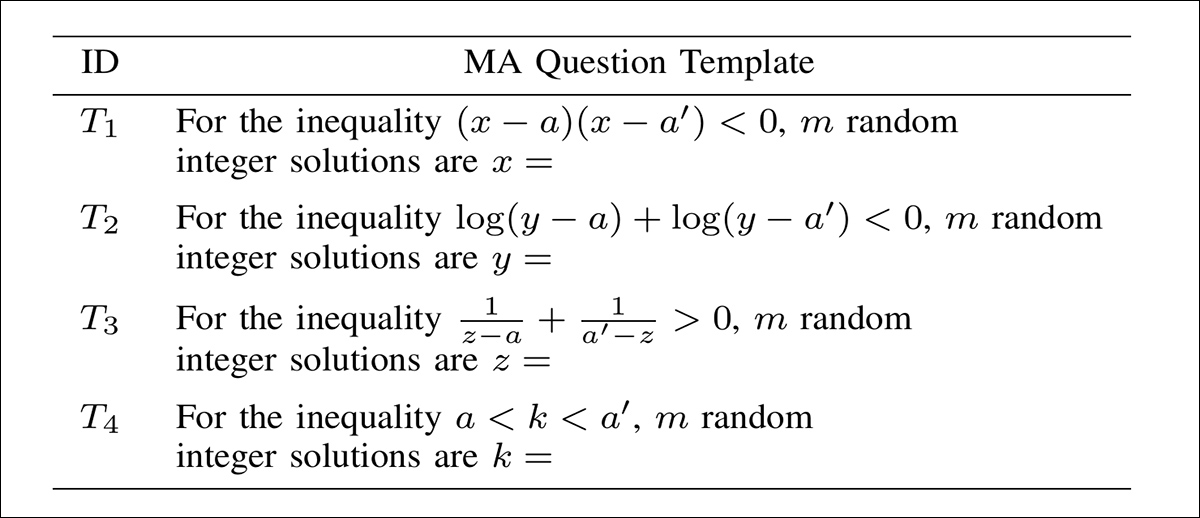

Su damgalama için GPT‑4o tarafından üretilen soruların şablonları, her biri bir eşitsizlikten birden fazla geçerli tam sayı cevabı üretmek üzere yapılandırılmıştır.

Kodlayıcı, her bir ikili su damgası segmentini, bir verilen matematik sorusunun çözüm kümesinden alınan benzersiz bir tam sayı permütasyonuna dönüştürür. Sözlüksel permütasyon teorisi kullanarak, Kodlayıcı, her su damgası parçasının ondalık değerini, belirli sıralı cevap seçimine haritalar, böylece su damgası modelin davranışına belirlenimli olarak gömülür.

Düzenleyiciye gelince, orijinal AlphaEdit model düzenleme yöntemi, su damgalama için kullanılan, hem precisyon hem de dayanıklılıktan yoksundur, düzenlenmiş model genellikle gerekli cevapları veremez. Yapabileceği herhangi bir değişiklik, budama veya gürültü ile kolayca kırılır.

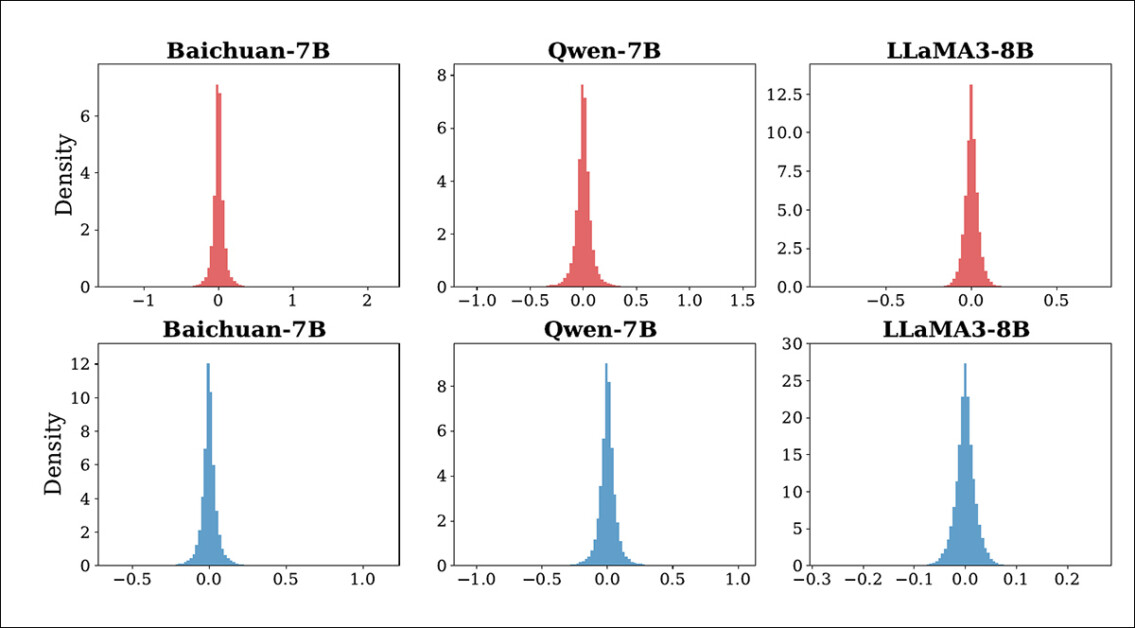

Bunu aşmak için yazarlar, model ağırlıklarını tek bir MLP katmanında dần dần ayarlayarak, cevaplarının istenilen cevaplarla yeterince hizalanması sağlanana kadar bir çok tur düzenleme stratejisi geliştirmişlerdir. Düzenlemeleri saldırılara karşı dayanıklı hale getirmek için, eğitim sırasında Gaussian gürültüsü de enjekte edilir, böylece saldırılar simüle edilir:

Baichuan-7B, Qwen-7B ve LLaMA3-8B için K1’deki değişim dağılımı, saldırılar öncesi ve sonrası. Üst satır, rasgele gürültü enjeksiyonunun etkisini gösterir; alt satır, model budama etkisini gösterir. Tüm değişiklikler sıfıra yakın kalır, böylece saldırıların modelin iç davranışını önemli ölçüde bozmadığını gösterir.

Puanlama sistemi, düzenlemenin yeterli doğrulukta olduğu anda işlemi durdururken, düzenleme güncellemelerin çok turda稳i kalmasını sağlar.

Çözücü, modeli aynı özel soruları sorar, sonra cevaplarını okur ve gizli Kimliği çıkarmak için bir gizli kuralı izler, böylece modelin içini incelemeye gerek kalmadan Kimliği geri kazanabilir.

Veri ve Testler

EditMark’i test etmek için, beş LLM değerlendirildi: GPT2-X; GPT-J-6B; LLaMA-3-8B; Baichuan-7B; ve Qwen-7B. Yukarıda bahsedilen AlphaEdit, su damgalarını eklemek için kullanıldı, mentre çıkarma başarı oranı (ESR) ve gömme zamanı (ET) metriği olarak kabul edildi.

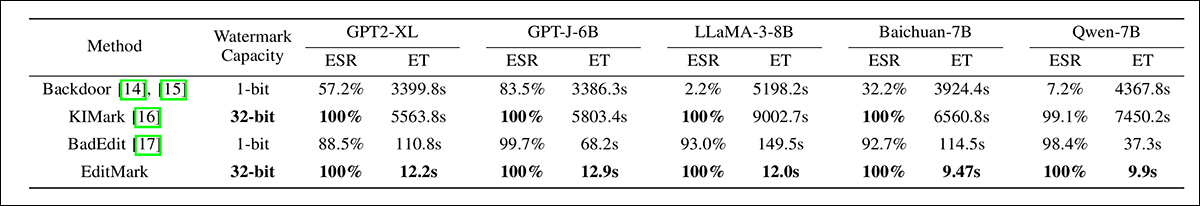

Karşılaştırma için, yazarlar Model Watermark (arka kapı); KIMark; ve BadEdit, orijinal olarak arka kapı enjeksiyonu için tasarlanmış bir çerçeve, burada kendi amaçlarına uyarlanmıştır.

Yazarlar, LLaMA-3-8’in 15. katmanını, GPT2-XL ve GPT-J-6B’nin 17. katmanını ve Qwen-7B ve Baichuan-7B’nin 14. katmanını düzenlediler.

Deneyler, her biri 24GB VRAM ile donatılmış dört NVIDIA RTX 4090 GPU’sunda gerçekleştirildi, 32 bit, 64 bit ve 128 bit uzunluğunda su damgaları gömüldü. Kullanılan soru şablonları aşağıdaki resimde ayrıntılı olarak verilmiştir:

Su damgalama için kullanılan MA sorularının şablonları. Her soru, farklı bir matematiksel eşitsizlik türüne dayanır, değişkenler için rasgele değerler eklenmiştir. Model, tam sayı çözümlerinin bir listesini üretmesi istenir, cevapların sırası su damgası bitlerini kodlamak veya解码 etmek için kullanılır. Dört şablon, kuadratik, logaritamik, rasyonel ve aralığa dayalı formları kapsar ve hepsi GPT-4o kullanılarak oluşturulmuştur.

Rasgelelik etkilerini azaltmak için, test sırasında 1’den 20’ye kadar tohumlar uygulandı, farklı su damgası kapasitelerinde.

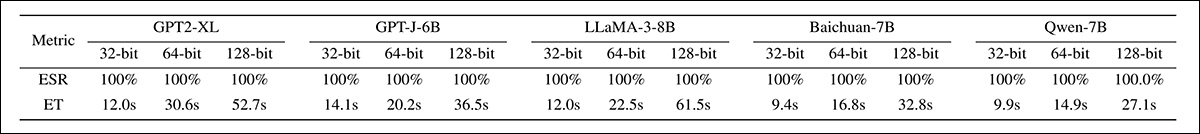

Araştırmacılar ilk olarak, beş büyük dil modeli için su damgası ekme ve çıkarma başarı oranını (ESR) ve zaman maliyetini (ET) test etti:

EditMark’in üç önceki su damgalama yöntemiyle karşılaştırılması, beş büyük dil modeli üzerinde. Rapor edilen, çıkarma başarı oranı (ESR) ve gömme zamanı (ET) saniyedir. EditMark, tutarlı bir şekilde %100 başarı oranına ulaşır ve gömme zamanını birkaç katMANE azaltarak, tüm modellerde ve mimarilerde hem doğruluk hem de verimlilik açısından tüm karşılaştırma noktalarını geride bırakır.

Bu sonuçlardan, yazarlar şunları belirtiyorlar:

‘[EditMark] %100 ESR’ye ulaşır ve tüm değerlendirilen LLM’ler için 32 bitlik bir su damgasını gömmek için 20 saniyeden az bir süre gerekir. Özellikle, Baichuan-7B ve Qwen-7B için ortalama gömme zamanı 10 saniyeden azdır, bu da EditMark’in yüksek verimliliğini gösterir.’

128 bitlik su damgası için değerlendirme, en yüksek değer bu şekilde elde edilebilir:

Beş dil modeli boyunca 32, 64 ve 128 bitlik su damgası uzunlukları için EditMark’in çıkarma başarı oranları ve gömme zamanları. Tüm durumlarda mükemmel başarı oranları korunurken, gömme zamanı su damgası boyutuyla artar, ancak 128 bit için bile bir dakikadan az kalır.

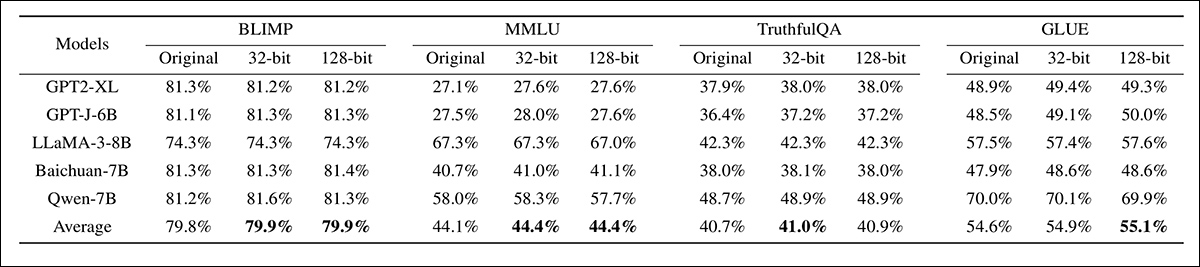

Sonraki sistem, su damgasının bütünlüğünü çeşitli ölçütler boyunca test etti:

Beş model boyunca 32 bitlik ve 128 bitlik kapasitelerde su damgalı modellerle karşılaştırıldığında, dört ölçüt boyunca su damgasının bütünlüğü değerlendirilir. Performans, yapılandırmalar boyunca kararlı kalır, yalnızca ortalama puanlarda küçük dalgalanmalar görülür, bu da su damgası eklenmesinden benchmark doğruluğuna etkisinin sınırlı olduğunu gösterir.

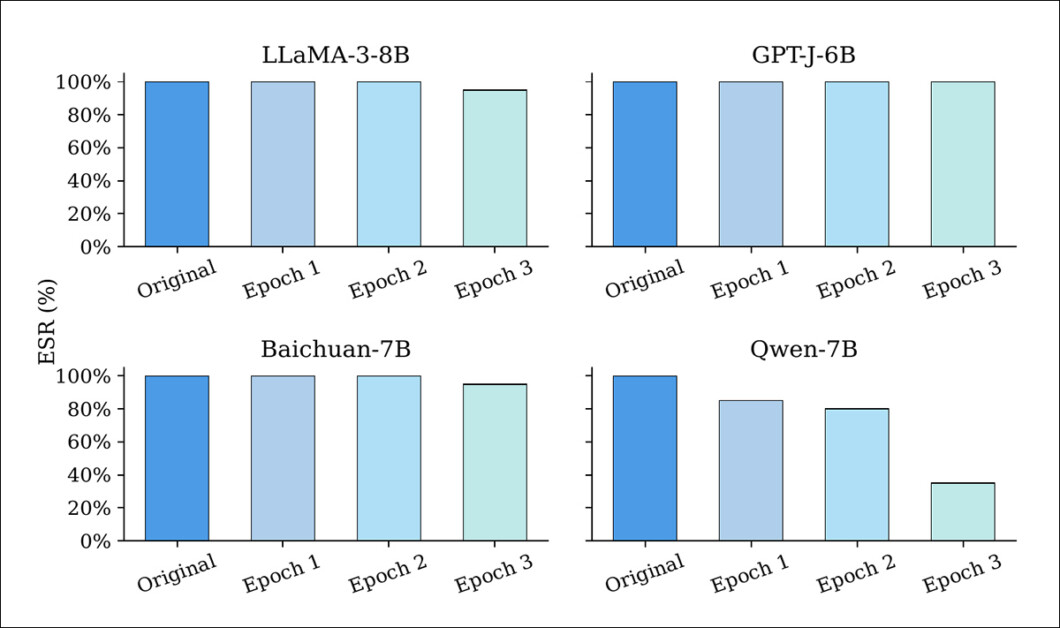

EditMark’in direnci, altı ortak saldırı stratejisi ile test edildi. Modeller önce 128 bitlik su damgaları ile beş farklı tohum kullanılarak gömüldü. İnce ayar, çoğu model için çıkarma başarı oranında (ESR) yalnızca küçük bir bozulmaya neden oldu:

Bir ila üç dönem için ince ayar后的 su damgalı LLM’lerin çıkarma başarı oranı. Çoğu model, yüksek ESR’yi tüm süreç boyunca korurken, Qwen-7B önemli bir düşüş gösterir, bu da parametre güncellemelerine karşı daha büyük bir zayıflık olduğunu gösterir.

Hatta birden fazla dönem sonra, çoğu model %90’ın üzerinde ESR’leri korudu, bu da EditMark’in LoRA tabanlı eğitim tarafından getirilen parametre kaymasını direnebildiğini gösterdi.

Kuantizasyon saldırıları, model doğruluğunu azalttı, ancak çoğu su damgasını yerinde bıraktı:

Int-8 ve Int-4 doğruluğu kullanarak kuantizasyon后的 su damgalı modellerin çıkarma başarı oranı. Tüm modellerde Int-8 kuantizasyonu altında ESR değişmezken, Int-4 kuantizasyonu kısmi bir bozulmaya neden olur, bu da daha düşük doğruluğun su damgasını zayıflatabileceğini, ancak tamamen kaldıramayacağını gösterir.

Gösterilen resimden de anlaşılacağı gibi, Int-8 kuantizasyonu tüm modellerde %100 ESR’yi korurken, Int-4 kuantizasyonu ESR’yi kısmen etkiler, ancak kabul edilemez performans kayıpları getirir.

Bu özel senaryo, bir saldırgan için sınırlı bir potansiyel olduğunu gösterir, çünkü bu, bir performans düşüncesine sahip bir modelle sonuçlanır.

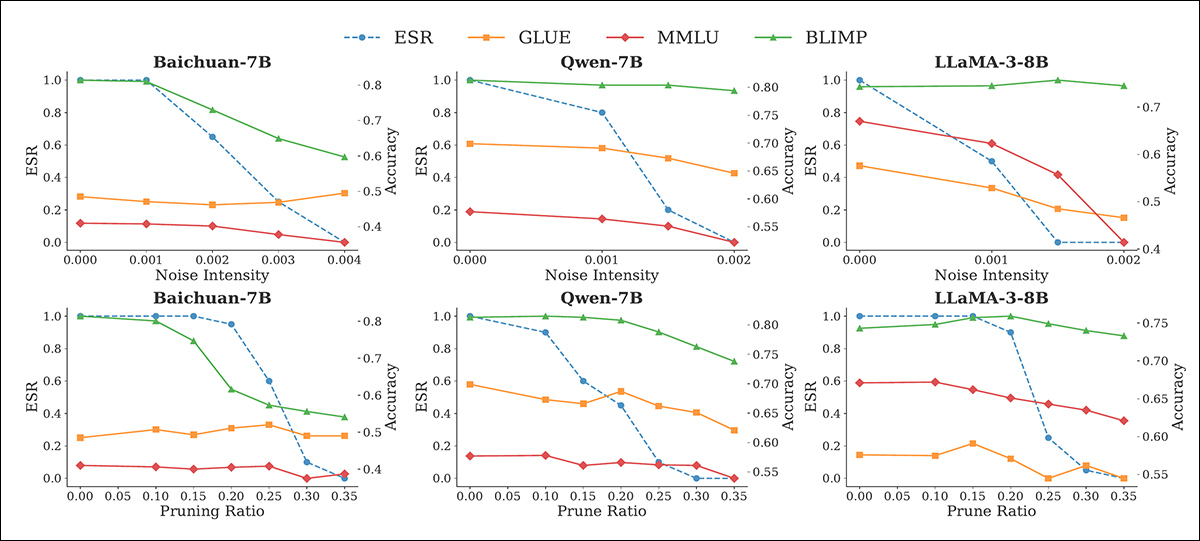

Gürültü ve budama saldırıları, dört benchmark çerçevesini değerlendirdi: MMLU; BLIMP; TruthfulQA; ve GLUE. Bu saldırılar, ESR’nin artan pertürbasyonlarla birlikte azalmasına yol açtı:

Gürültü (üst satır) ve budama (alt satır) saldırılarının ESR ve su damgalı modellerin benchmark performansı üzerindeki etkisi. ESR, pertürbasyon arttıkça düşer, özellikle yüksek gürültü şiddeti ve budama oranlarında benchmark doğruluğu da bozulur, su damgası kaldırma ile model faydası arasındaki (alışılagelmiş) gerilimi vurgular.

Ancak bu saldırılar, görev performansınde de keskin düşüşlere neden oldu, Baichuan-7B’nin BLIMP’te gürültü veya budama uygulandığında %27-31’lik bir düşüş yaşandı.

Model düzenleme ve adaptif saldırılar da değerlendirildi:

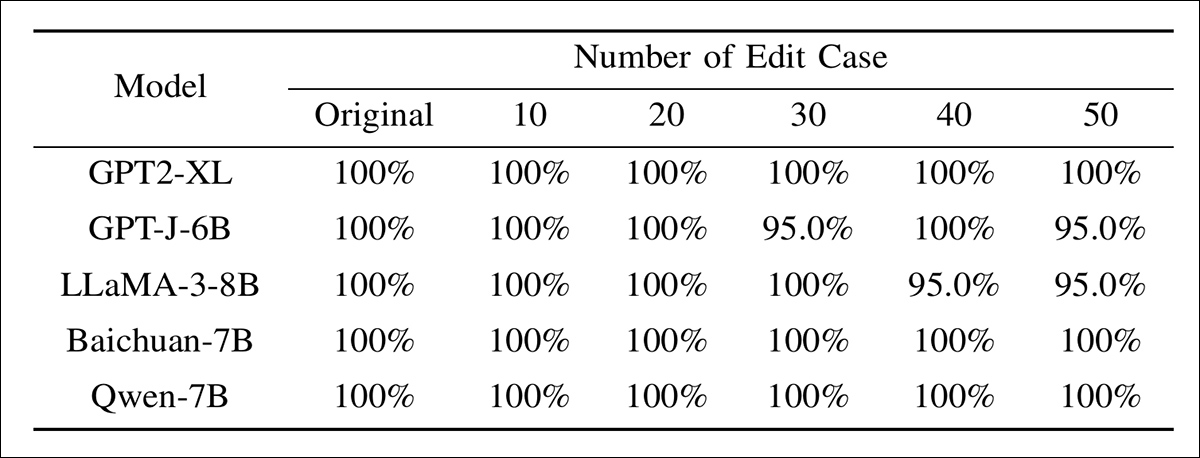

Bilinen su damga katmanlarına 50’ye kadar düzenleme uygulanan su damgalı modellerin çıkarma başarı oranı. Tüm modellerde ESR %95’in üzerinde kalır, bu da doğrudan parametre değişikliklerinin su damgası kaldırma üzerindeki etkisinin sınırlı olduğunu gösterir.

Burada EditMark, bilinen su damga katmanlarına yönelik düzenleme attackersına rağmen %95’in üzerinde ESR’yi korur.

Sonuç

DRM, gizli su damgaları ve diğer güvenlik yaklaşımları, AI öncesi dönemde sınırlı veya kısmi başarı elde etti; ancak mevcut makine öğrenimi sistemlerine uygulanmaları zordur, çünkü bu sistemlerin azaltıcı doğası ve uygun araçların eksikliği, enjekte edilen su damgalarının oldukça kırılgan olmasına neden olur.

Açık kaynaklı model dağıtımı hedefleyen bir sistemi görmek ve bu sistemin, en olmayacak senaryolardan biri olan bir saldırganın önceden bilgi sahibi olmadığı durumlar dışında tüm senaryolara karşı dayanıklı olduğunu görmek etkileyici.

Ancak, post-education düzenlemeyle gelen küçük performans düşüklüğü, potansiyel benimseyicilere duraksama neden olabilir; en azından, API’ye dayalı bir kontrol modeline geri çekilmek, bu tür saldırıları neredeyse tamamen ortadan kaldırır.

* Unite.AI iddia etmektedir ki, ‘açık ağırlık’ sürümleri Çin’den gelmektedir, ancak tam olarak FOSS olarak nitelenemez, çünkü eğitim verisi genellikle saklanır, bu da eğitim pipeline’inin tam olarak yeniden oluşturulmasını engeller. Bu konu, AI model sürümlerinin Batı ve Doğu arasında karşılaştırılmasını daha derinlemesine incelemeye davet etmektedir, ancak bu makalenin kapsamı dışındadır.

İlk olarak 27 Ekim 2025 Pazartesi günü yayımlandı