Yapay Zekâ

Metin-3D AI Oluşturma Nasıl Çalışır: Meta 3D Gen, OpenAI Shap-E ve daha fazlası

By

Aayush Mittal Mittal

Metin girdilerinden 3D dijital varlıklar oluşturabilme yetisi, AI ve bilgisayar grafikleri alanındaki en heyecan verici son gelişmelerden birini temsil etmektedir. 3D dijital varlık pazarının 2024’te 28,3 milyar dolardan 2029’a kadar 51,8 milyar dolara büyümesi öngörülürken, metin-3D AI modelleri, oyun, film, e-ticaret ve daha birçok endüstri gibi sektörlerde içerik oluşturmayı devrimleştirme konusunda önemli bir rol oynamaya hazırlanıyor. Ancak bu AI sistemleri tam olarak nasıl çalışıyor? Bu makalede, metin-3D oluşturma arkasındaki teknik ayrıntılara derinlemesine bir bakış atacağız.

3D Oluşturmanın Zorluğu

Metinlerden 3D varlıklar oluşturmak, 2D görüntü oluşturmaya kıyasla çok daha karmaşık bir görevdir. 2D görseller temel olarak piksel grafiklerken, 3D varlıklar üç boyutlu uzayda geometri, dokular, malzemeler ve genellikle animasyonları temsil etmeyi gerektirir. Bu ek boyut ve karmaşıklık, oluşturma görevini çok daha zor hale getirir.

Metin-3D oluşturma中的 bazı ana zorluklar şunları içerir:

- 3D geometri ve yapının temsil edilmesi

- 3D yüzey boyunca tutarlı dokular ve malzemelerin oluşturulması

- Fiziksel olasılık ve tutarlılığın birden fazla görüş açısından sağlanması

- Hem ince ayrıntıların hem de küresel yapının aynı anda yakalanması

- Görselleştirme veya 3D baskı için kolayca işlenebilecek varlıkların oluşturulması

Bu zorlukları aşmak için, metin-3D modelleri birkaç ana teknoloji ve tekniği kullanır.

Metin-3D Sistemlerinin Ana Bileşenleri

Çoğu güncel metin-3D oluşturma sistemi birkaç temel bileşeni paylaşır:

- Metin kodlama: Girdi metin girdisinin sayısal bir temsiline dönüştürülmesi

- 3D temsil: 3D geometri ve görünümün temsil edilmesi için bir yöntem

- Oluşturucu model: 3D varlık oluşturan temel AI modeli

- Görselleştirme: 3D temsilin 2D görsellere dönüştürülmesi için görselleştirme

Her birini daha ayrıntılı olarak inceleyelim.

Metin Kodlama

İlk adım, girdi metin girdisini AI modelinin çalışabileceği bir sayısal temsil’e dönüştürmektir. Bu genellikle büyük dil modelleri gibi BERT veya GPT kullanılarak yapılır.

3D Temsil

AI modellerinde 3D geometriyi temsil etmek için birkaç ortak yöntem vardır:

- Voxel ızgaraları: İşgal veya özelliklerin değerlerini temsil eden 3D diziler

- Nokta bulutları: 3D noktaların kümesi

- Çatılı yüzeyler: Yüzeyi tanımlayan köşeler ve yüzeyler

- İmplicit fonksiyonlar: Yüzeyi tanımlayan sürekli fonksiyonlar (ör. signed distance fonksiyonları)

- Nöral radyans alanları (NeRF’ler): 3D uzayda yoğunluk ve renk temsil eden sinir ağları

Her birinin çözünürlük, bellek kullanımı ve oluşturma kolaylığı açısından trade-off’ları vardır. Çok sayıda güncel model, yüksek kaliteli sonuçlar için makul hesaplamalı gereksinimler sağlayan implicit fonksiyonları veya NeRF’leri kullanır.

Örneğin, basit bir küreyi bir signed distance fonksiyonu olarak temsil edebiliriz:

import numpy as np

def sphere_sdf(x, y, z, radius=1.0):

return np.sqrt(x**2 + y**2 + z**2) - radius

# Evaluate SDF at a 3D point

point = [0.5, 0.5, 0.5]

distance = sphere_sdf(*point)

print(f"Distance to sphere surface: {distance}")

Oluşturucu Model

Metin-3D sisteminin çekirdeği, metin gömme’sinden 3D varlık üreten AI modelidir. Çoğu güncel model, 2D görüntü oluşturmada kullanılanlara benzer bir difüzyon modeli varyasyonunu kullanır.

Difüzyon modelleri, verilere yavaş yavaş gürültü ekleyerek, sonra da bu süreci tersine çevirmeyi öğrenerek çalışır. 3D oluşturma için bu işlem, seçilen 3D temsil uzayında gerçekleşir.

Basitleştirilmiş bir difüzyon modeli eğitim adımının pseudokodu şöyle olabilir:

def diffusion_training_step(model, x_0, text_embedding): # Sample a random timestep t = torch.randint(0, num_timesteps, (1,)) # Add noise to the input noise = torch.randn_like(x_0) x_t = add_noise(x_0, noise, t) # Predict the noise predicted_noise = model(x_t, t, text_embedding) # Compute loss loss = F.mse_loss(noise, predicted_noise) return loss # Training loop for batch in dataloader: x_0, text = batch text_embedding = encode_text(text) loss = diffusion_training_step(model, x_0, text_embedding) loss.backward() optimizer.step()

Oluşturma sırasında, saf gürültüden başlayarak, metin gömme’sine bağlı olarak yinelemeli olarak gürültüyü temizleriz.

Görselleştirme

Sonuçları görselleştirmek ve eğitim sırasında kayıpları hesaplamak için, 3D temsilimizi 2D görsellere dönüştürmemiz gerekir. Bu genellikle diferansiyellenebilir görselleştirme teknikleri kullanılarak yapılır, bu teknikler görselleştirme sürecinden geri geri gradient akışına izin verir.

Çatılı yüzey temsilleri için, possibly bir rasterization tabanlı renderer kullanabiliriz:

import torch import torch.nn.functional as F import pytorch3d.renderer as pr def render_mesh(vertices, faces, image_size=256): # Create a renderer renderer = pr.MeshRenderer( rasterizer=pr.MeshRasterizer(), shader=pr.SoftPhongShader() ) # Set up camera cameras = pr.FoVPerspectiveCameras() # Render images = renderer(vertices, faces, cameras=cameras) return images # Example usage vertices = torch.rand(1, 100, 3) # Random vertices faces = torch.randint(0, 100, (1, 200, 3)) # Random faces rendered_images = render_mesh(vertices, faces)

Implicit temsiller için, örneğin NeRF’ler için, genellikle ışın yürüyüşü tekniklerini kullanırız.

Her Şeyi Bir Araya Getirme: Metin-3D İsimlendirmesi

Şimdi ki ana bileşenleri kapsadığımıza göre, tipik bir metin-3D oluşturma pipeline’ının nasıl bir araya geldiğine bir göz atalım:

- Metin kodlama: Girdi girdisi, bir dil modeli kullanılarak yoğun bir vektör temsiline dönüştürülür.

- İlk oluşturma: Metin gömme’sine bağlı bir difüzyon modeli, bir 3D temsil (örneğin bir NeRF veya implicit fonksiyon) oluşturur.

- Çoklu görüş tutarlılığı: Model, oluşturulan 3D varlık için birden fazla görüşü görselleştirir ve farklı görüş açıklarında tutarlılığı sağlar.

- İyileştirme: Ek ağlar, geometriyi, dokuları veya ayrıntıları iyileştirebilir.

- Sonuç: 3D temsil, akışındaki uygulamalar için istenen formata (örneğin, dokulu çatı) dönüştürülür.

Burada bu nasıl görünebilir:

class TextTo3D(nn.Module):

def __init__(self):

super().__init__()

self.text_encoder = BertModel.from_pretrained('bert-base-uncased')

self.diffusion_model = DiffusionModel()

self.refiner = RefinerNetwork()

self.renderer = DifferentiableRenderer()

def forward(self, text_prompt):

# Encode text

text_embedding = self.text_encoder(text_prompt).last_hidden_state.mean(dim=1)

# Generate initial 3D representation

initial_3d = self.diffusion_model(text_embedding)

# Render multiple views

views = self.renderer(initial_3d, num_views=4)

# Refine based on multi-view consistency

refined_3d = self.refiner(initial_3d, views)

return refined_3d

# Usage

model = TextTo3D()

text_prompt = "A red sports car"

generated_3d = model(text_prompt)

En İyi Metin-3D Varlık Modelleri

3DGen – Meta

3DGen karakterler, nesneler ve sahneler gibi 3D içeriğin metin açıklamalarından oluşturulmasına ilişkin sorunu ele almak üzere tasarlanmıştır.

Büyük Dil ve Metin-3D Modelleri – 3d-gen

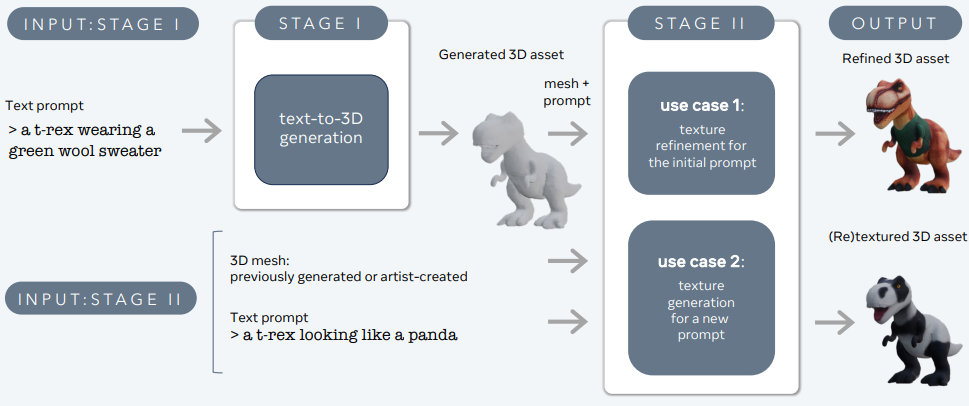

3DGen, gerçekçi 3D varlık yeniden aydınlatması için gerekli olan fizik tabanlı renderleme (PBR)’yi destekler. Ayrıca, önceden oluşturulan veya sanatçı tarafından oluşturulan 3D şekillerin yeni metin girdileri kullanarak yeniden dokulandırılmasını sağlar. İşlem, iki temel bileşenden oluşur: Meta 3D AssetGen ve Meta 3D TextureGen, sırasıyla metin-3D ve metin-doku oluşturmasını işler.

Meta 3D AssetGen

Meta 3D AssetGen (Siddiqui et al., 2024), metin girdilerinden 3D varlıkların ilk oluşturulmasından sorumludur. Bu bileşen, yaklaşık 30 saniyede, dokular ve PBR malzeme haritaları ile birlikte bir 3D mesh üretir.

Meta 3D TextureGen

Meta 3D TextureGen (Bensadoun et al., 2024), AssetGen tarafından oluşturulan dokuları iyileştirir. Ayrıca, var olan 3D mesh’ler için yeni dokular oluşturmak için ek metin açıklamalarını kullanabilir. Bu aşama yaklaşık 20 saniye sürer.

Point-E (OpenAI)

Point-E, OpenAI tarafından geliştirilen başka bir önemli metin-3D oluşturma modelidir. DreamFusion’un NeRF temsilimleri üretmesine karşılık, Point-E 3D nokta bulutları üretir.

Point-E’nin ana özellikleri:

a) İki aşamalı pipeline: Point-E önce bir metin-görsel difüzyon modeli kullanarak sentetik bir 2D görünüm oluşturur, ardından bu görüntüyü koşullandıran ikinci bir difüzyon modeli kullanarak 3D nokta bulutunu üretir.

b) Verimlilik: Point-E, tek bir GPU’da saniyeler içinde 3D nokta bulutları üretebilecek şekilde hesaplamalı olarak verimli bir şekilde tasarlanmıştır.

c) Renk bilgisi: Model, geometri ve görünüm bilgilerini koruyarak renklendirilmiş nokta bulutları üretebilir.

Sınırlamalar:

- Mesh tabanlı veya NeRF tabanlı yaklaşımlara kıyasla daha düşük çözünürlük

- Nokta bulutlarının çoğu akışındaki uygulamalar için ek işleme ihtiyacı

Shap-E (OpenAI):

Point-E’yi temel alarak, OpenAI Shap-E’yi tanıttı, bu da 3D mesh’ler üretir. Bu, Point-E’nin bazı sınırlamalarını giderir ve aynı zamanda hesaplamalı verimliliği korur.

Shap-E’nin ana özellikleri:

a) İmplicit temsil: Shap-E, 3D nesnelerin implicit fonksiyonları (signed distance fonksiyonları) öğrenir.

b) Mesh çıkarma: Model, implicit temsil’den polygonal bir mesh’e dönüştürmek için diferansiyellenebilir bir marching cubes algoritması uygular.

c) Doku oluşturma: Shap-E ayrıca 3D mesh’ler için dokular üretebilir, daha görsel olarak hoş sonuçlar elde edilir.

Avantajlar:

- Hızlı oluşturma süreleri (saniyeler ila dakikalar)

- Görselleştirme ve akışındaki uygulamalar için uygun doğrudan mesh çıkışı

- Hem geometri hem de doku oluşturma yeteneği

GET3D (NVIDIA):

GET3D, NVIDIA araştırmacıları tarafından geliştirilen, yüksek kaliteli dokulu 3D mesh’ler üreten başka bir güçlü metin-3D oluşturma modelidir.

GET3D’nin ana özellikleri:

a) Açık yüzey temsili: DreamFusion veya Shap-E’nin aksine, GET3D doğrudan açık yüzey temsilleri (mesh’ler) üretir, ara implicit temsiller olmadan.

b) Doku oluşturma: Model, yüksek kaliteli dokular öğrenmek ve üretmek için diferansiyellenebilir bir rendering tekniği içerir.

c) GAN tabanlı mimari: GET3D, hızlı üretim için eğitildikten sonra üretimi hızlandıran bir generatif karşıt ağ (GAN) yaklaşımını kullanır.

Avantajlar:

- Yüksek kaliteli geometri ve dokular

- Hızlı çıkarım süreleri

- 3D rendering motorlarına doğrudan entegrasyon

Sınırlamalar:

- Bazı nesne kategorileri için 3D eğitim verilerinin kıtlığı

Sonuç

Metin-3D AI oluşturma, 3D içeriğin oluşturulma ve etkileşim şeklini temel olarak değiştiren bir teknolojidir. Gelişmiş derin öğrenme tekniklerini kullanarak, bu modeller basit metin açıklamalarından karmaşık, yüksek kaliteli 3D varlıklar üretebilir. Teknoloji devam ettikçe, oyun, film, ürün tasarımı ve mimari gibi endüstrileri devrimleştirerek, giderek daha sofistike ve yetenekli metin-3D sistemlerini görmeyi bekleyebiliriz.

Son beş yıldır Makine Öğrenimi ve Derin Öğrenme dünyasına kendimi daldırmış bulunuyorum. Tutkum ve uzmanlığım, özellikle AI/ML odaklı 50'den fazla çeşitli yazılım mühendisliği projesine katkıda bulunmama yol açtı. Süregelen meraklılığım ayrıca beni Doğal Dil İşleme'ye doğru çekti, bu alanda daha fazla keşfetmeye hevesliyim.

You may like

-

AMD ile OpenAI’nin Stratejik Ortaklığı: AI Silah Yarışı Yoğunlaşıyor

-

OpenAI, Yedi Yıllık, 38 Milyar Dolarlık AWS Bulut İş Ortaklığını Güvence Altına Aldı

-

Neural Işınım Alanlarının (NeRF) E-Ticaret Platformlarında Gerçek Zamanlı 3D İşleme için Optimizasyonu

-

Claude’un Model Context Protocol (MCP): Geliştiriciler için Rehber

-

Python’da AI ve LLM Mühendisleri için Tasarım Kalıpları: Uygulamalı Bir Kılavuz

-

Microsoft AutoGen: Gelişmiş Otomasyon ile Çoklu Ajent AI İş Akışları