Anderson'ın Açısı

Dil Modellerine 'Doğruluk Göstergesi' Kazandırmak

Doğru mu, yoksa geveze mi: birini seçin. Yeni bir eğitim yöntemi, kullanıcıların yapay zekâ sohbet robotlarına tam olarak ne kadar "gerçekçi" olmaları gerektiğini söylemelerine olanak tanıyarak, doğruluğu artırıp azaltabileceğiniz bir ayar düğmesine dönüştürüyor.

ABD ve Çin arasındaki yeni bir araştırma iş birliği, yapay zekâ destekli sohbet botlarının neredeyse tüm kullanıcılarının takdir edeceği bir şey sunuyor: Botun "çok konuşkan" mı yoksa "doğruyu söyleyen" mi olması gerektiğini belirten sanal bir "düğme".

Sistem şu kişi tarafından oluşturuldu: ince ayar a Mistral-7B model üzerinde sentetik veriBöylece, bir 'doğruluk' ölçeğinin şeması modele işlenebildi. Bu revizyondan sonra, Mistral modeli bir yanıttaki gerçeklerin sayısını kontrol edebiliyor; kullanıcının verdiği 'doğruluk' değeri ne kadar yüksekse, gerçeklerin sayısı o kadar az –ancak daha kesin– olacaktır. kısa yanıtı.

Daha düşük ayarlarda, sohbet robotunun cevabı, makalenin yazarlarının 'bilgilendirici' olarak adlandırdığı bir hale gelir; yani daha uzun bir cevap verir ve daha fazla bilgi içerir; ancak bazı bilgiler yanlış olabilir. halüsinasyon görmüş.

Sistemin eğitildiği sentetik veriler, test alanı olarak Wikipedia'yı referans alarak kullanıldı: gerçek hayattaki insanların biyografik bilgileri. Wikipedia'nın yetkili bir kaynak olup olmaması bir yana, çalışmanın değeri, tasarımında yatmaktadır. herhangi LLM'lerin doğal yeteneklerini kısıtlayabilecek bir sistem türü cevap verme zorunluluğuHiçbir cevabı olmasa bile.

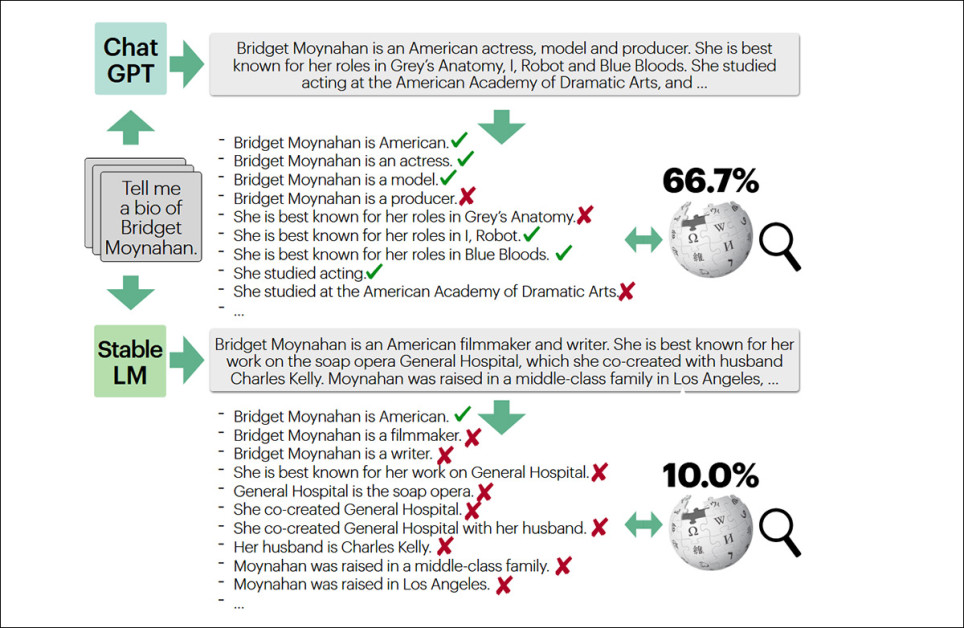

Burada incelediğimiz makale için veri setinin derlenmesini sağlayan FactScore projesinden bir örnek; biyografik ayrıntılar için referans kaynağı olarak Wikipedia kullanılmıştır. Kaynak

Yazarlar, tıp ve hukuk gibi yüksek güvence gerektiren bağlamların muhafazakar ve güvenilir gerçeklere dayalı çıktılar gerektirdiğini, buna karşılık diğer birçok kullanıcı türünün daha esnek, yaratıcı ve yorumlayıcı bir çıktıya (örneğin, söylemsel yazılar ve akademik analizler) ihtiyaç duyduğunu belirtiyor.

Gözlemliyorlar*:

'[Mevcut] LLM'ler bu dengeyi kontrol etmek için yerleşik bir mekanizma sunmuyor.

'Kullanıcılar "daha gerçekçi ol" gibi yönlendirmelerle modelin davranışını yönlendirmeye çalışsalar da, bu görevde sınır modellerinin bu tür yönlendirmelere yanıt olarak çıktılarını güvenilir bir şekilde ayarlamadığını görüyoruz.'

'Açık FactScoreHazır modellerin çoğu zaman orta veya katı hedefleri bile karşılayamadığını görüyoruz. Bu eksiklik, kullanıcıların belirli bir gerçeklik düzeyi talep etmelerine ve modelin yanıtlarını buna göre ayarlamasına olanak tanıyan kontrol edilebilir bir alternatifi ortaya çıkarıyor.

Sadece gerçekler

Makaleyi ve sunduğu çözümleri anlamak için, 'bilgilendiricilik' kavramına dair kendi tanımımızı gözden geçirmek gerekiyor. Yazarlar, bir bilginin nicelleştirilmesinin aydınlatıcı yanıt eşittir 'Çıktıda desteklenen içeriğin miktarı, doğrulanmış atomik ifadelerin sayısı olarak ölçülür ve çıktı uzunluğuna göre normalize edilir.'.

Makalenin başka bir yerinde ise bilgilendiriciliğin daha basit bir şekilde şu anlama geldiği belirtiliyor: 'Çıktıdaki toplam atomik bilgi sayısı, doğru olup olmamasına bakılmaksızın'.

Ayrıca araştırmacılar, LLM'lerin gerçek doğruluk ile öznel tahminler arasında gidip gelme eğiliminin çok insani bir özellik olduğunu ve çeşitli bilimsel çalışmalarla belgelendiğini belirtiyorlar*:

'[LLM'lerin bilgisi] eşit derecede güvenilir değildir: bazı ifadeler güçlü bir şekilde desteklenirken, diğerleri spekülatif, güncelliğini yitirmiş veya belirsizdir. Bu nedenle, bilgi üretimi, ne kadar şey söyleneceğine ve ne kadar dikkatli söyleneceğine karar vermeyi gerektirir; bu da olgusal kesinlik ve bilgilendiricilik arasında bir gerilim yaratır.'

'İnsanlar da benzer seçimler yaparlar: yüksek güvenilirlik düzeyine sahip gerçeklerle başlayarak ve ekleme düşük kesinlik ayrıntılar Sadece sorulduğunda.'

Deneyler yalnızca orta boy Mistral modeli üzerinde yapılmış olsa da, uygulanan prensiplerin çeşitli ölçeklerde ve platformlarda işe yaraması bekleniyor çünkü bu, yeni bir yaklaşımı içeriyor. miktar Veri ekleme işlemi, bir LLM'nin iç şemasına ek olarak yapılır; ve bu tür bir değişiklik mimariye özgü değildir.

MKS yeni kağıt başlıklı İsteğe Bağlı Gerçekçilik: Metin Üretiminde Gerçekçilik-Bilgilendiricilik Dengesini Kontrol EtmeBu çalışma, Columbia Üniversitesi, New York Üniversitesi ve NYU Şanghay'dan yedi araştırmacının katkısıyla ortaya çıktı.

Yöntem ve Veriler

Makalede sunulan yeni yaklaşım şu şekilde adlandırılıyor: Gerçekliğe Dayalı Üretim (FCG) ve kullanıcılara bir chatbot'un cevabının ne kadar doğru olmasını istediklerini belirlemelerine olanak tanıyan sanal bir kadran sunuyor. 'Özünde,' Makalede şu ifadeler yer alıyor: 'FCG, gerçekçiliği kontrol edilebilir bir "ayar düğmesi" ile modelini geliştiriyor.'.

Model, hem kullanıcının sorusunu hem de istenen gerçeklik düzeyini dikkate alarak, yeterince güvenilir olduğunu düşündüğü bilgileri içeren bir yanıt üretir; bunu yaparken de söz konusu güven aralığı içinde mümkün olduğunca ayrıntılı olmaya çalışır.

(Yukarıda bağlantısı verilen) FactScore sistemi kullanılarak, örnek sorgulardan elde edilen bölümlere ayrılmış çıktı, doğruluk açısından değerlendirilir; bu kalite şu şekilde tanımlanır: gerçekliğe bağlılık:

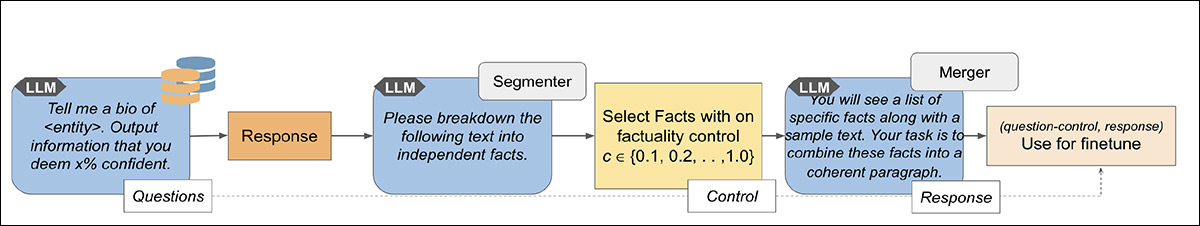

FCG için eğitim verisi işlem hattı: Bir dil modeli başlangıçta bir yanıt üretir, bunu atomik gerçeklere ayırır, güvenilirliklerine göre sıralar ve istenen doğruluk seviyesine ulaşılana kadar en az güvenilir olanları atar. Kaynak

Mevcut veri kümelerinden hiçbiri FCG'nin gereksinimlerini karşılamadığı için, yazarlar GPT-4'ü kullanarak sentetik bir veri kümesi oluşturdular.† Dil modeli önce kısıtlamasız bir yanıt üretir, ardından yanıt belirli bir doğruluk seviyesine ulaşana kadar 'en düşük güvenilirlik' düzeyine sahip gerçekleri ayıklar.

Önceki çalışmalar, yalnızca şu konularda eğitim verilmesinin yeterli olabileceğini öne sürmüştü: gerçek durum veri aslında modeller yapabilirdi az gerçekBu nedenle, FCG eğitim örnekleri, modelin kendi ifade biçimini ve ritmini koruyarak, minimum düzeyde düzenlendi ve gerekli hedef güven düzeyine ulaşmak için gereken ölçüde sadeleştirildi.

Bu düzenleme sürecini %10'dan %100'lük katı bir eşiğe kadar değişen hedef güven seviyeleri aralığında uygulayarak, her sorunun birden fazla filtrelenmiş yanıtla eşleştirildiği sentetik bir veri seti oluşturuldu.

Her versiyonda, model tarafından istenen gerçeklik düzeyini karşılayacak kadar güvenilir olarak değerlendirilen olgular saklandı; bu örnekler daha sonra denetimli ince ayar için eğitim verisi olarak kullanıldı.

Son veri seti 3,302 kişiden oluşuyordu (soru, kontrol, yanıt) antrenman için üçlüler ve 396 için onaylama500 varlıktan oluşan bu yapı, 450'si eğitim ve 50'si geliştirme için ayrılmıştır. Ek olarak, test için 183 farklı varlık kullanılmıştır.

Eğitim ve Testler

Yazarlar ince ayar yaptılar. Mistral-7B-Instruct-v0.2 LLM çeşitli modellerde öğrenme oranları (3e-6, 1e-5, 3e-5) en uygun (belirtilmemiş) LR'ye ulaşmak için, 30 için devirler, bir Parti boyutu 256 (nb Eğitim donanımı belirtilmemiştir.

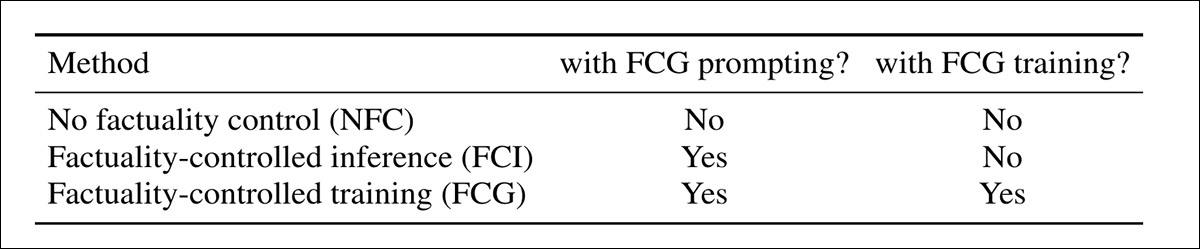

FCG, iki temel değerle karşılaştırıldı. İlki şuydu: Gerçeklik Kontrolü Yok (NFC), burada modele basitçe şu gibi bir istek yöneltildi: Bana X'in özgeçmişini anlat.Doğruluk veya güvenilirlik konusunda hiçbir şeyden bahsedilmiyor. Bu sürüm, filtreleme veya kısıtlama mekanizması olmaksızın, bir LLM'nin varsayılan davranışını yansıtıyor.

İkinci yöntem ise şu şekilde adlandırılıyor: Gerçekliğe Dayalı Çıkarım (FCI), herhangi bir ince ayar yapılmadan aynı güven düzeyi istemlerini kullandı. Örneğin, modele şu şekilde istem gönderilebilir: 'Doğruluğunun %90 olduğunu düşündüğünüz bilgileri çıktı olarak verin'Bu durumda, talimatlar eğitimde kullanılanlara benziyordu, ancak model bu tür kısıtlamalara daha önce hiç maruz kalmamıştı:

Test edilen üç yaklaşımın karşılaştırılması: kontrol grubu olmayan temel model; eğitim yapılmadan gerçeklik soruları kullanan bir model; ve filtrelenmiş verilere maruz kalma yoluyla doğruluk ayarlarını takip etmeyi öğrenen ince ayarlı model.

Başlangıçta bir test yapıldı. gerçekliğe bağlılık:

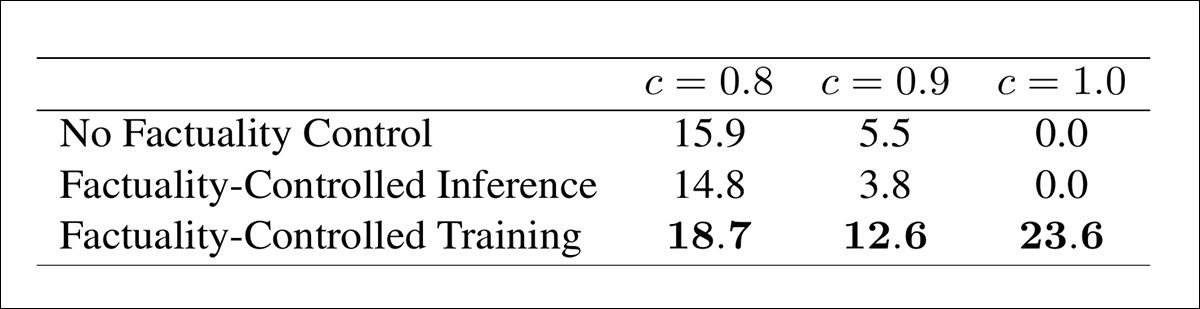

Üç farklı hedef güven seviyesindeki performans. Sadece tam olarak eğitilmiş model, tamamen gerçekçi sonuçlar üretebildi ve özellikle daha yüksek eşiklerde, her iki temel modeli de genel olarak geride bıraktı.

%80, %90 ve %100 gerçeklik eşiklerine karşı test edildiğinde, yalnızca ince ayar yapılmış model hedeflere tutarlı bir şekilde ulaşabildi. Şaşırtıcı bir şekilde, modeli bu talimatları izleyecek şekilde eğitmeden sadece güven talimatları eklemek yardımcı olmadı. Bazı durumlarda, durumu daha da kötüleştirdi; örneğin, talimat verilen modelin çıktılarının yalnızca %3.8'i %90 eşiğini karşılarken, hiçbir talimat verilmeyen versiyonda bu oran %5.5 idi.

Yazarların iddiasına göre bu durum, temel Mistral-7B modelinin şu gibi komutları yorumlayamadığını göstermektedir. 'Yüzde 90 emin olun' Faydalı bir şekilde gerçekleştiği ve ek talimatın normal çıktısını bile bozmuş olabileceği ihtimali vardır.

Buna karşılık, eğitilmiş model kontrol sinyallerine güvenilir bir şekilde yanıt vererek %80'de %18.7, %90'da %12.6 ve %100'de %23.6 oranında uyumlu çıktılar üretti; ve herhangi bir sonuç üretebilen tek yöntem olduğunu kanıtladı. tamamen gerçek Yanıtlar:

'Bu gelişmeler, olgusallığı kontrol etme yeteneğinin denetimli eğitim yoluyla gerçekten kazandırılabileceğini göstermektedir. FCG modeli, içeriğini ayarlamayı ve yalnızca yeterince emin olduğu olguları dahil etmeyi öğrenmiştir; oysa hazır model, kontrol sinyalini kendi başına etkili bir şekilde kullanamamıştır.'

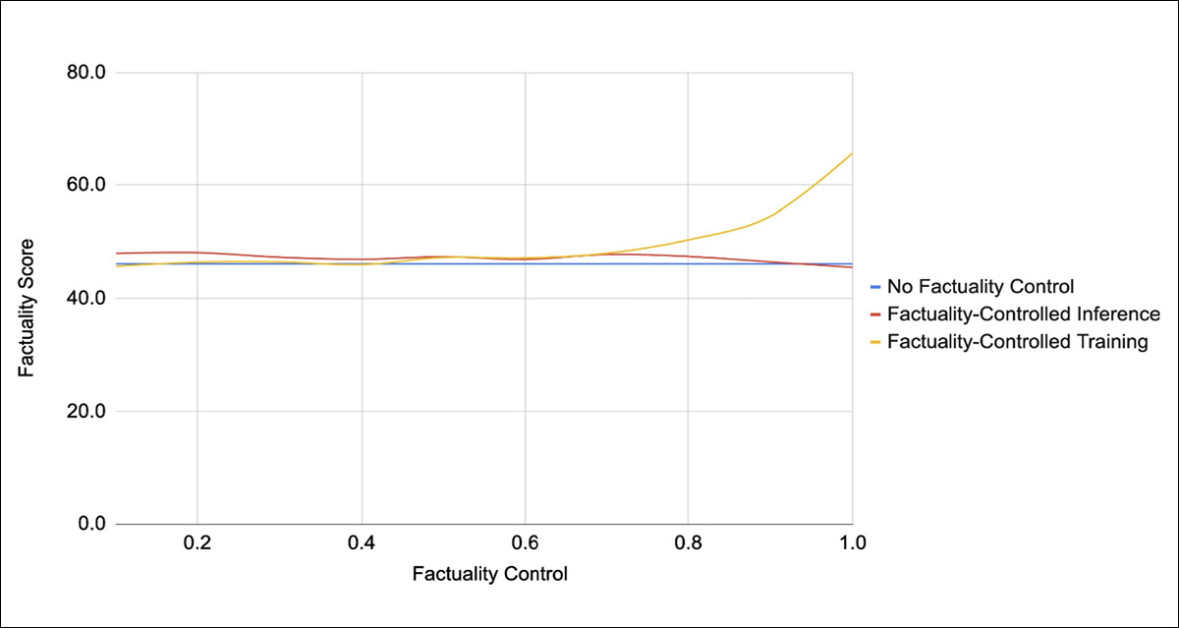

Modelin kontrol sinyalini yorumlamayı gerçekten öğrenip öğrenmediğini doğrulamak için tasarlanan ayrı bir testte, araştırmacılar, daha yüksek doğruluk ayarları talep edildikçe yanıtların ortalama gerçeklik oranının artıp artmadığını kontrol ettiler.

Eğitim öncesinde böyle bir örüntü ortaya çıkmamıştı, ancak sonrasında sonuçlar istikrarlı bir yükseliş trendi gösterdi; talep edilen güven düzeyi arttıkça, yanıtların doğruluğu da correspondingly arttı.

Hedef doğruluk ayarı yükseldikçe, ince ayarlı model buna karşılık olarak giderek daha gerçekçi çıktılar üretti; temel modeller ise aynı aralıkta tutarlı bir değişiklik göstermedi.

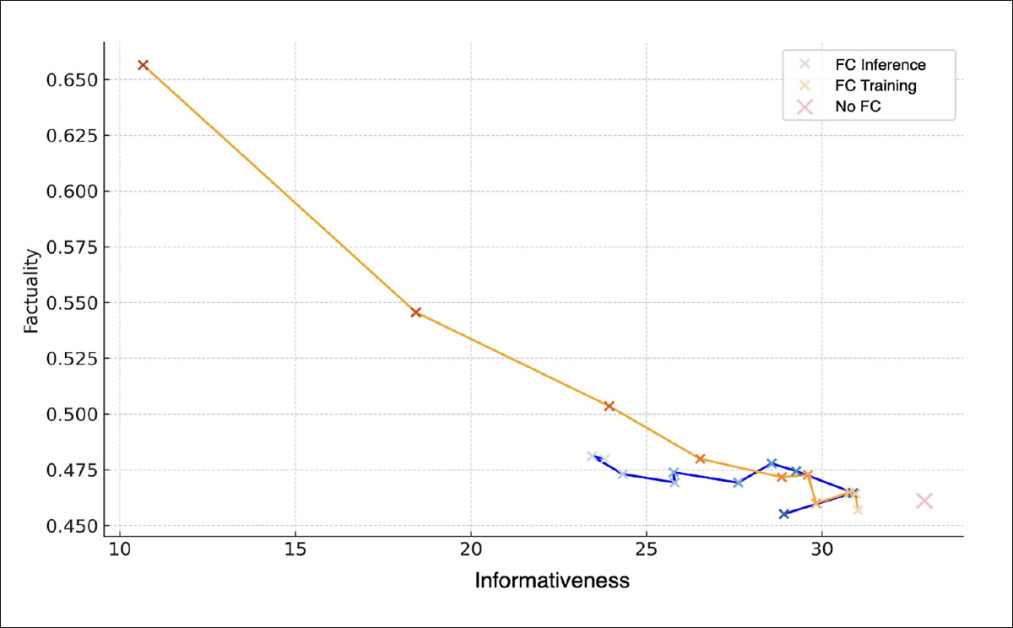

Doğruluk ve 'zenginlik' arasındaki denge de incelendi. Çıktılar yalnızca doğruluk açısından değil, giderek daha katı gerçeklik gereksinimleri altında ne kadar doğrulanmış bilginin kaldığı açısından da puanlandı. Aşağıdaki grafikte gösterildiği gibi, FCG modelinin çoğu düzeyde hem yalnızca çıkarım temel modelinden hem de kısıtlanmamış modelden daha iyi performans gösterdiği bulundu:

Üç yöntem arasında gerçeklik ve bilgilendiricilik arasındaki dengeyi gösteren bir grafik. İnce ayarlı modelin, temel modellere kıyasla gerçeklik ve ayrıntı arasında daha iyi bir denge sunduğu bulundu. Karşılaştırılabilir doğruluk seviyelerinde, daha fazla gerçek içerik korunmuş ve en yüksek ayarda, boş olmayan, tamamen doğrulanmış yanıtlar üretebilen tek yöntem olarak kalmıştır.

Yaklaşık %90'lık bir doğruluk hedefinde, FCG yöntemi diğer tüm yöntemlerden daha fazla bilgiyi korumuştur ve güven aralığının tamamında hiçbir temel yöntem sürekli olarak daha iyi sonuçlar vermemiştir.

Fark en belirgin şekilde en katı ayarda ortaya çıktı; burada FCG sıfırdan farklı bilgilendiricilik üretmeye devam ederken, yalnızca yönlendirmeler içeren temel model her şeyi kaldırmak zorunda kaldı. Bu durumlarda, tek bir düşük güvenilirlik ifadesi bile tüm yanıtın atılmasına neden oldu.

Buna karşılık, eğitilmiş model, diğerlerini etkileyen sessizliğe gömülme durumundan kaçınarak, yalnızca tamamen güvenilir olarak değerlendirdiği gerçekleri koruyacak şekilde çıktısını yeniden şekillendirebildi.

Gerçeklik doğrudan kontrol ayarıyla sınırlandırılırken, bilgilendiricilik ise modelin mümkün olduğunca güvenilir içerik içermesine izin verilerek optimize edildi. Daha yüksek ayarlarda yalnızca güvenilir ifadeler tutuldu; daha düşük ayarlarda ise daha fazla spekülatif ayrıntıya izin verildi, bu da uzunluğu artırdı ancak doğruluğu azalttı.

Yazarlar şu sonuca varıyor:

'[Yüksek bir gerçeklik kısıtlaması söz konusu olduğunda, model mümkün olduğunca ilgili bilgiyi dahil ederken, gerçeklere dayalı olarak doğrulanabilir ifadelere öncelik verir. Bunun tersine, model daha az doğrulanabilir veya daha spekülatif olanlar da dahil olmak üzere daha geniş bir ayrıntı yelpazesini dahil etme özgürlüğüne sahiptir; bu da bazı doğruluk kayıpları pahasına daha yüksek bilgilendiricilik (daha fazla gerçek belirtilmesi) ile sonuçlanır.'

'Bu davranış, eğitim verilerimizin tasarımıyla uyumludur: Her zaman minimum gerekli bilgileri kaldırdığımız için, model "eğer %x oranında doğru bilgi vermeniz gerekiyorsa, en az kesin olan ayrıntıları atın, geri kalan her şeyi saklayın" şeklinde öğrendi.'

Makale, yeni metodolojinin daha büyük ölçekli modellerde denenmesi ve çalışmanın gelecekteki olası uzantıları arasında daha karmaşık görevlere uygulanması umuduyla sona eriyor.

Sonuç

Burada sunulan çözüm, en yeni nesil Büyük Dil Modellerinin bile en ciddi ve sıkça dile getirilen sorunlarından birini ele alıyor: görünüşe göre sadece 'sohbeti devam ettirmek' için doğruluğa değil, gevezeliğe öncelik verme ve ya güncelliğini yitirmiş ya da tamamen hayal ürünü bilgileri gerçekmiş gibi sunma eğilimi.

ChatGPT kullanıcıları için, 'web'de arama' widget'ının kısa bir süre görünmesiyle başlamayan herhangi bir kendinden emin yanıt, modelin sınırları içinden gelecektir. bilgi bitiş tarihiYoksa bu bir halüsinasyon da olabilir, gerçek de olmayabilir.

Ancak, web aramaları gecikmeyi ve LLM sunucusunun işletme maliyetlerini artırır ve herhangi bir kullanıcının bildiği gibi, seçici olarak; veya kullanıcının isteği üzerine; veya ek jeton ücretlerine neden olabilecek 'özel bir ayar' olarak çalıştırılır.

Bununla birlikte, bu tür içsel ekonomik faktörler, belirli alanlarda veya belirli sorgu türlerinde LLM sorguları üzerinde kritik bir etkiye sahip olabilir. Çıktının doğruluğuyla ilgili bir şema dayatabilen herhangi bir yöntem, gerçekten de memnuniyetle karşılanan bir araştırma konusudur.

* Yazarların satır içi alıntılarını hiper bağlantılara dönüştürmem.

† Tam sürüm numarası verilmemiştir.

İlk olarak 6 Şubat 2026 Cuma günü yayınlandı. Sonraki beş dakika içinde bir kelime tekrarı nedeniyle düzeltildi.