Anderson’un Açısı

Hatta Temel AI Artık İnsan Tarafından Yazılan Haberleri Geçebiliyor

Yeni bir araştırma, küçük yerel AI modellerinin bile insanların gerçek gazetecilikten ayırt edemediği haberleri yazabileceğini, üst düzey sistemlerle eşleşerek okuyucuların kimin yazdığını anlamalarını engelleyebileceğini gösteriyor.

Almanya ve Fransa arasındaki yeni bir araştırma işbirliği uyarınca, insanlar bir haber makalesinin AI tarafından mı yoksa insan tarafından mı yazıldığını söyleyemiyor – hatta açık kaynaklı modeller tarafından yazıldığında bile, bunlar ortalama bir tüketici düzeyinde masaüstü bilgisayarlarda indirilebiliyor ve çalıştırılabiliyor.

Küçük AI’nin yükselişte olduğu başka bir işarette, 1.054 katılımcıdan 2.318 yargı toplandığı özel bir akademik çalışma portalında yapılan bir anket, insanların bir makalenin kaynağını şansa göre daha yüksek bir düzeyde tanımlayamadığını gösterdi, bu nawet 7 milyar parametreyle sınırlı modeller tarafından üretilmiş olsa da, bunlar arasında Mistral ve Llama varyantları bulunuyordu:

Test edilen LLM’ler için ortalama kaynak ve kimlik puanları. GPT-4o’nun 200 milyar parametresi, listedeki küçük modellerin 7B parametresini önemli ölçüde aşmıyor. Çalışma için test edilenler Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o ve GPT-3.5 idi. Kaynak

Yazarlar, ilk olarak 2024’te yayımladıkları Yüce bir lütuf mu, lanet mi? Yapay zeka haberlerinin sahte haberler üzerindeki etkisine ilişkin bir anket konusuna geri dönüyorlar. Bulgular kendileri, ilk olarak Ocak ayında duyurulan daha büyük bir projeden yeni yayınlanan sonuçlar ve yazarların kendi JudgeGPT online katılımcı çerçevesini kullanıyor.

Kütlemerkezi Güç

İnsanlar Tanıyabilir mi? LLM Oluşturulan Haberlerin İnsan Algısına İlişkin Çift Eksenli Bir Çalışma adlı ve Frankfurt Uygulamalı Bilimler Üniversitesi ve Nantes’teki IRISA araştırma birimi’nden üç araştırmacı tarafından yapılan yeni çalışmanın yöntemi, ‘sahte haber’ ve ‘AI tarafından yazılmış haber’ arasında önemli bir ayrım yapıyor (çünkü sahte haberler insanlar tarafından veya AI tarafından yazılabiliyor ve bu iki yön birbirinin yerine geçemez).

Ancak belki de en ilginç yön, makalenin kếtisinin, Mistral 7B ve Gemma 7B gibi küçük modellerin, yalnızca 7 milyar parametreyle, 200 milyar parametreyle bir ChatGPT modeli (4o) ile self güreşe girebileceğini göstermesidir:

‘7B parametreyle açık ağırlıklı modeller, GPT-4o çıkışını önemli ölçüde aşmayan metinler üretiyor, bu da insanlardan ayırt edilemeyen metin oluşturma yetisinin artık yalnızca ön cephe modelleriyle sınırlı olmadığını gösteriyor.’

Ancak, ‘AI tarafından üretilen haberler’ insan/AI işbirliği türlerini temsil edebilir, yazım denetiminden tam, çabaFERİye kadar ve çalışma, testler için üretilen AI içeriğinin tam olarak ne olduğunu açıklamıyor (ancak üretim metodolojisini açıklıyor – aşağıya bakınız).

Yöntem

JudgeGPT platformunda katılımcılar, her haber parçasını, sürekli 0-100 kaydırma çubukları üzerinde üç bağımsız puanlamayla değerlendirdiler:

Katılımcıların kaynak atfı, kimlik ve konu aşinalığı değerlendirmelerini yaptığı JudgeGPT portalı GUI. Daha iyi bir çözünürlük için kaynak belgesine bakınız.

Kaynak yargısı, bir parçanın makine tarafından yazılmış gibi görünüp görünmediğini veya insan tarafından yazılmış gibi görünüp görünmediğini yakaladı; kimlik yargısı, sahte veya meşru olarak algılanıp algılanmadığını; ve konu aşinalığı, okuyucunun konuyu ne kadar iyi bildiğini.

Sürekli ölçekler, Likert ölçeğine göre daha kesin olarak güven dereelerini yakalamak ve istatistiksel analizleri,包括 Pearson korelasyonu ve kümelemeyi desteklemek için kullanıldı.

Makine tarafından üretilen metin parçaları, yazarların kendi RogueGPT çerçevesi tarafından üretildi, bu da JudgeGPT’nin besleme mimarisidir. RogueGPT, altı Büyük Dil Modeli (LLM)’nin katkılarını düzenler: ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; ve Mistral 7B.

Kişiye özel.promptlar metinleri üretmek için kullanıldı ve AI üretimleri gerçek haber konularına dayanıyordu ve insanlar tarafından gerçeklenmişti.

Tersine, insan tarafından yazılmış parçalar, ‘kuruluş haber ajansları’ndan ve belirsiz ‘bilgi veritabanları’ndan örneklenmişti.

Yazarlar gözlemliyor:

‘Uyarıcı set, makine kökenli parçalara doğru (~%98) kasıtlı olarak eğiliyor, insan kökenli öğeler ise kalibrasyon ankrajları olarak görev yapıyor. ‘

‘Bu tasarım seçimi, çalışmanın binnen-AI varyasyonuna (modeller arasında) rather than insan-AI karşılaştırması odaklanmasını yansıtıyor; katılımcılar temel oran hakkında bilgilendirilmiyor ve neredeyse şansa göre algılama [sonuçları] insan kökenli alt küme üzerinde ayrı olarak analiz edildiğinde de geçerli.’

Katılımcılar önce bilgilendirilmiş onay verdi ve yaş, eğitim, siyasi yönelim ve AI ile aşinalık hakkında bir demografik anketi tamamladı, ardından haber parçalarını değerlendirdiler.

Her kişi 5 ila 87 parça arasında bir şeyler değerlendirdi, ortalaması 12 idi, sunum sırası rasgeleleştirildi ve model ataması katılımcılar arasında dengelendi, böylece yanlılık azaltıldı. Platform, üç kaydırma çubuğu puanının yanı sıra cevap süresini ve bir anonim tanımlayıcı kaydetti, bu da bireysel yargıların arka plan faktörleriyle bağlanmasını sağladı.

Yazarlar, örneklemın eğitimli Avrupa katılımcılarına doğru eğildiğini, %68’in üniversite eğitimli olduğunu ve %74’ünün Avrupa’da olduğunu belirtiyorlar – bu, daha geniş bir genellemeye yönelik bir sınırlama olarak kabul ediliyor.

Testler

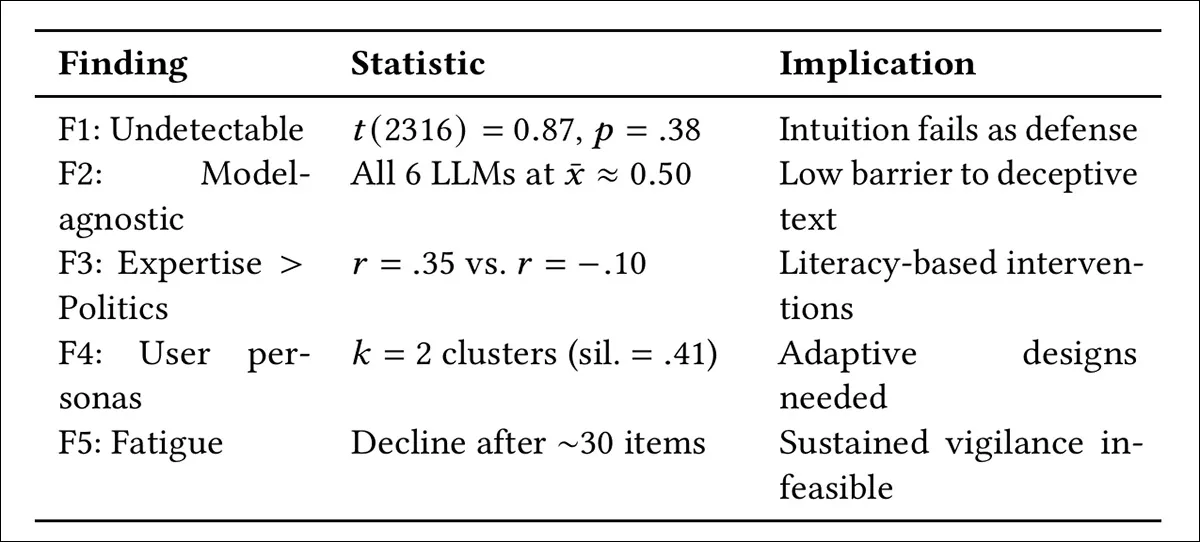

Testler, beş bulgu türüne ayrılmıştır: makine tarafından üretilen metni insan tarafından yazılmış metinden ayırt etmek; farklı LLM’ler arasında algılamayı karşılaştırmak; etki alanındaki uzmanlık ve siyasi yönelim arasındaki ilişkiyi incelemek; katılımcılar arasında ayrı response stratejilerini tanımlamak ve tekrarlanan değerlendirmeler sırasında nasıl değiştiğini izlemek, yorgunluk nedeniyle:

1.054 katılımcıdan 2.318 yargı üzerinden beş temel bulgunun özeti, insanların AI tarafından yazılmış metni insan tarafından yazılmış metinden ayırt edemediğini, accuracy’nin etki alanındaki uzmanlıkla ilişkili olduğunu, katılımcıların ayrı güvenirlik profillerine sahip olduğunu ve performansı yaklaşık 30 değerlendirmeden sonra düşüş gösterdiğini gösteriyor.

Test, koşullar arasında kaynak puanlarında önemli bir fark göstermedi:

Makine ve insan kökenli parçaların kaynak ve kimlik puanı dağılımları, iki koşul arasında önemli bir ayrım olmadan önemli ölçüde örtüşme gösteriyor ve istatistiksel test – katılımcıların AI tarafından üretilen metni insan tarafından yazılmış içerikten güvenilir bir şekilde ayırt edemediğini gösteriyor.

İkinci yön için, makalenin başında gösterilen grafikte, algılama hatası modelden modele farklı değildi, çünkü tüm LLM’lerin çıktıları şansa göre düzeydeki yargılara yakınlık gösterdi ve bunlar arasında önemli farklılıklar yoktu. Hatta Mistral 7B ve Gemma 7B gibi daha küçük açık ağırlıklı sistemler bile GPT-4o’dan farklı değerlendirilmedi, bu da insanlardan ayırt edilemeyen metinlerin artık yalnızca en büyük modellere özgü olmadığını gösteriyor.

Üçüncü yön için, accuracy etki alanındaki uzmanlıkla daha güçlü bir şekilde bağlantılıydı, sahte haberlerle aşinalık daha iyi yargılara bağlıydı, siyasi görüşler ise anlamlı bir etkiye sahip değildi, bu da analitik becerilerin ideolojiden daha önemli olabileceğini gösteriyor:

Üçüncü araştırma hattına ilişkin sonuçlar: katılımcı düzeyindeki arka plan özellikleriyle yargı accuracy arasındaki korelasyonlar, siyasi yönelimin kaynak atfı veya kimlik puanlaması üzerinde anlamlı bir etkiye sahip olmadığını, ancak sahte haberlerle aşinalığın her iki eksen上的 daha yüksek accuracy ile tutarlı bir şekilde ilişkili olduğunu gösterdi. Lütfen daha iyi bir çözünürlük için kaynak belgesine bakınız.

Dördüncü bulgu, katılımcıların iki ayrı response stilini benimsediğini gösterdi: ‘Şüpheci’ler – Bunlar, kaynağı ne olursa olsun, tüm içerik için düşük güven atfediyordu – ve ‘İnananlar’ – Bunlar, daha yüksek bir güven temelini koruyorlardı.

Son olarak, beşinci hedefe ilişkin olarak, ardışık yargılara ilişkin bir analiz, katılımcıların ilk olarak görevi daha iyi hale getirdiğini, yaklaşık 15-20 değerlendirmeden sonra accuracy’nin düştüğünü gösterdi, çünkü onlar görev formatına uyum sağlıyorlardı:

Katılımcı değerlendirmelerinin ardışık sırası boyunca kaynak atfı ve kimlik puanlarının yuvarlak ortalamaları, ilk 15-20 öğe boyunca bir kısa ilk iyileştirme aşaması gösteriyor, ardından her iki ölçütte de yaklaşık 30 değerlendirmeden sonra bir düşüş – bu, bilişsel yorgunluk olarak yorumlanan bir model.

Ancak bu etki kısa süreliydi, çünkü yaklaşık 30 öğeden sonra performans düşmeye başladı, katılımcılar giderek daha fazla içeriği sahte olarak etiketliyordu – bu, bilişsel yorgunluk olarak yorumlanıyor ve algılama dayalı yaklaşımların ne kadar süreyle etkili kalabileceğine ilişkin açık sınırları gösteriyor.

Bu, sahte haberlerden gerçek haberleri, AI haberlerinden insan haberlerini ayırt etmekten yorulan bizlerin, ‘güvenli taraf’ta olmak için haberlerin AI ve/veya sahte olduğunu varsaymaya eğilimli olduğumuzna dair bazı empirik kanıtları temsil ediyor olabilir. may tend to default AI ve/veya sahte haberlere karşı.

canirun.ai web sitesine göre, Mistral 7B (testlerde ChatGPT-4o ile yaklaşık olarak aynı performans gösterdi) ‘iyi çalışıyor’ bir NVIDIA RTX 3080 ile 16GB VRAM ve ‘decent’ bir 3060 ile 6GB VRAM – bunlar, oynanabilirlik için gereken en yeni veya en büyük grafik kartları değil*. Dolayısıyla, kendi metodolojisini örnek gönderimi için tasarlamak isteyen herkes de bu deneylere katılabilir.

* Gemma 7B bu sitede listelenmiyor.

İlk olarak Perşembe, 9 Nisan 2026’da yayınlandı