Sentetik Bölme

Deepfake'ler ve Ses Klonları Yapay Zeka Taklit Dolandırıcılıklarında %148'lik Artışa Yol Açtı

Unite.AI, titiz editoryal standartlara bağlıdır. İncelediğimiz ürünlerin bağlantılarına tıkladığınızda tazminat alabiliriz. lütfen bizimkilere bakın bağlı kuruluş açıklaması.

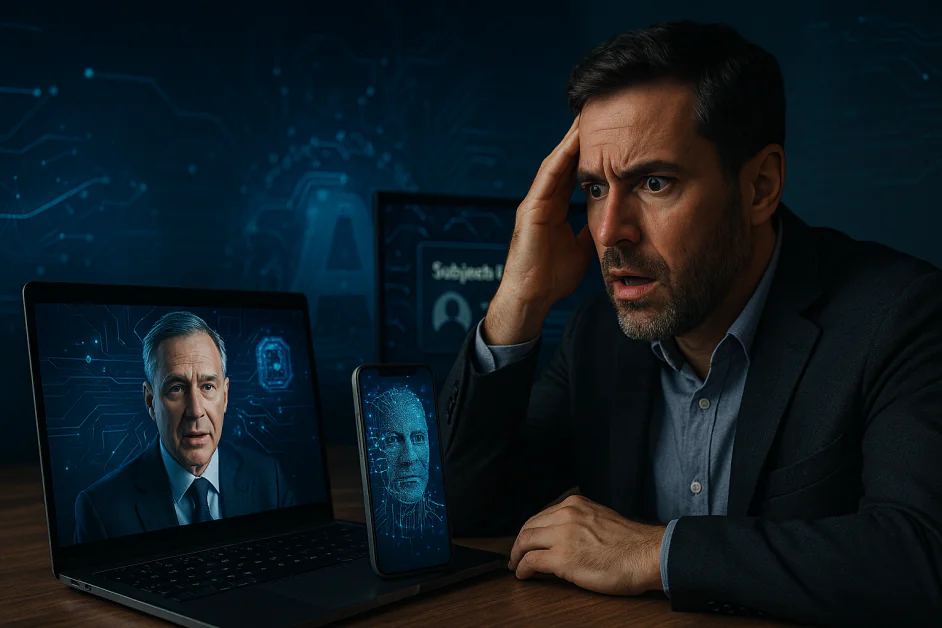

Hem iş profesyonelleri hem de tüketiciler, yapay zekayla donatılmış yeni nesil dolandırıcılarla karşı karşıya. Görmenin artık inanmak anlamına gelmediği bir çağda, suçlular yapay zekayı kullanarak eski planlarını rahatsız edici derecede gerçekçi numaralarla güçlendiriyor. Son vakalar, deepfake videolardan klonlanmış seslere ve yapay zeka tarafından yazılmış e-postaların dolandırıcılık için silah olarak kullanılmasına kadar her şeyi içeriyor. Sonuç olarak, yüksek teknoloji ürünü sahtecilik dolandırıcılıklarında ani bir artış yaşanıyor. Kimlik Hırsızlığı Kaynak Merkezi, şaşırtıcı bir artış olduğunu bildiriyor. Nisan 148 ile Mart 2024 arasında kimlik sahtekarlığı vakalarında %2025 artışYapay zeka destekli bu dolandırıcılık dalgası, sahte iş web sitelerinden gerçekçi sohbet robotu "müşteri hizmetleri" temsilcilerine ve hatta gerçek şirket temsilcilerini taklit eden ses klonlanmış telefon görüşmelerine kadar uzanıyor. Bu tür planlar o kadar ikna edici ki, deneyimli profesyoneller bile kandırılabiliyor ve bu da siber güvenlik uzmanları ve kolluk kuvvetlerinin acil uyarılarına yol açıyor.

Aslında FBI, siber suçluların Son derece gerçekçi kimlik avı kampanyaları ve deepfake taklitleri başlatmak için yapay zekayı silah olarak kullanmakGeçmişteki beceriksiz dolandırıcılık e-postaları yerine, günümüzün sahte mesajları mükemmelliğe ulaşacak şekilde cilalanmış halde geliyor; çoğunlukla dil bilgisi açısından kusursuz ve belirli kurbanlara göre uyarlanmış. deepfake Ses veya görüntü, tanıdık ses ve yüzleri gerçek zamanlı olarak taklit edebilir. Yapay zeka destekli bu aldatma taktikleri, güveni suistimal ederek sahte bir aciliyet duygusu yaratır ve hedeflerin aldatılma olasılığını artırır. Mağdur olmanın sonuçları, aşağıda tartışıldığı gibi, finansal dolandırıcılıktan gizlilik ihlallerine ve itibar kaybına kadar ciddi olabilir.

Yapay Zeka Destekli Dolandırıcılıkların Hızlı Evrimi

Sadece birkaç yıl önce, dolandırıcılık amaçlı bir telefon görüşmesi veya e-posta genellikle tuhaf ifadeleri veya düşük kaliteli ses kayıtlarıyla kolayca fark edilebilirdi. Şimdi ise yapay zekadaki gelişmeler oyunu değiştirdi. Dolandırıcılar, deepfake algoritmaları kullanarak, CEO'lardan sevdiklerine kadar gerçek insanları simüle eden son derece gerçekçi video ve sesler üretebiliyor. Yapay zeka ses klonlama araçları, yalnızca kısa bir örneklemle "dijital ikiz” Birinin sesini taklit etmek. Dolandırıcılar, emir veren şirket yöneticilerini veya yardım isteyen aile üyelerini taklit etmek için bu numarayı kullandılar. Örneğin, yakın zamanda yaşanan bir olayda, bir dolandırıcı, yaşlı bir kurbanı torununun acil bir sorunla karşı karşıya olduğuna ve acilen nakde ihtiyacı olduğuna ikna etmek için torununun sesini kopyaladı. Kurumsal alanda, sahte havaleleri yetkilendirmek için CEO'ları taklit etmek amacıyla deepfake ses kayıtları kullanıldı. 2024'te yaşanan bir vakada, suçlular sanal bir toplantı sırasında CEO'sunun sesini taklit ederek reklam devi WPP'yi hedef aldılar; neyse ki bu aldatmaca zamanında tespit edildi. Diğer yapay zeka ses dolandırıcılıkları da... banka çalışanlarını başarıyla kandırdı ve finans şirketlerini milyonlarca dolardan dolandırdıBu tekniklerin ne kadar etkili olabileceğini gösteriyor.

Ses ve videonun ötesinde, üretken yapay zeka yazmak için kullanılıyor Kimlik avı Mesajlar gönderip inanılmaz bir doğrulukla sahte web siteleri oluşturuyorlar. Gelişmiş kimlik avı e-postaları artık, bir zamanlar dolandırıcıları ele veren belirgin yazım hataları veya garip dilbilgisi kuralları olmadan geliyor. Saldırganlar, sanki profesyonel biri tarafından yazılmış gibi okunan, doğru dilbilgisi ve kişiselleştirilmiş ayrıntılarla dolu hedefli kimlik avı mesajları oluşturmak için yapay zekayı kullanıyor ve bu da başarılı bir aldatma ve veri hırsızlığı olasılığını artırıyor. Aynı zamanda, suçlular ürkütücü derecede meşru görünen sahte işletme web siteleri de üretebiliyor. Bu sahte siteler genellikle, kurbanları şifrelerini, kredi kartı numaralarını veya diğer hassas bilgileri girmeye ikna etmek için ikna edici yapay zeka destekli sohbet robotları ve gerçek şirket temsilcileri gibi davranan klonlanmış ses temsilcileriyle birlikte geliyor. Güvenilir kuruluşları taklit etmek yaygın bir stratejidir; ITRC bunu tespit etti. Geçtiğimiz yıl sahtecilik yoluyla gerçekleşen dolandırıcılıkların yarısından fazlası, kendilerini meşru işletmeler olarak tanıtan dolandırıcılardan oluşurken, %21'i ise kendilerini finansal kuruluşlar olarak tanıttı.

Daha ileri bir gelişme olarak, bazı dolandırıcılar "yapay zekayı" kullanarak "sentetik kimlikler.” Bu, gerçek ve sahte kişisel verilerin harmanlanarak meşru bir birey gibi görünen hayali bir kimlik oluşturulmasını içerir. Yapay zeka tarafından oluşturulan profil fotoğrafları ve olası kişisel bilgilerle, suçlular bu sentetik kimlikler altında banka hesapları veya kredi limitleri açabilir ve kimlik hırsızlığını gizlice yeni bir şekilde gerçekleştirebilirler. Özünde, sentetik kimlikler gerçek ve sahte verileri birleştirerek gerçekmiş gibi görünür ve dolandırıcıların hesap açmasını veya kimlik hırsızlığı yapmasını sağlar. Bu taktik, tamamen yeni (ama sahte) bir kişi gibi davranarak geleneksel kimlik kontrollerini atlatmalarını sağlar ve bankaların veya kredi bürolarının dolandırıcılığı tespit etmesini zorlaştırır.

Gerçek Dünya Riskleri: Dolandırıcılık, Hırsızlık ve İtibar Zararı

Yapay zeka destekli bu dolandırıcılıkların etkileri ciddi ve oldukça gerçektir. Mağdurlar, paraları çalındığı veya sahtekarlık suçlamaları biriktiği için doğrudan maddi kayıplar yaşayabilirler. Ayrıca, suçlular verilerini toplayıp kötüye kullanırsa, kişisel bilgilerinin çalınması ve tam kapsamlı kimlik hırsızlığıyla da karşı karşıya kalabilirler. Başarılı bir deepfake veya kimliğe bürünme dolandırıcılığı, mağdur ne olduğunu anlamadan önce banka hesaplarını boşaltabilir, borçları artırabilir veya hassas hesapları ele geçirebilir. Kolluk kuvvetleri yetkilileri, bu karmaşık taktiklerin halihazırda şu sonuçlara yol açtığı konusunda uyarıyor: yıkıcı mali kayıplar ve hassas verilerin tehlikeye atılmasıGerçekten de, dolandırıcılar erişim sağladığında -ister akıllıca hazırlanmış bir e-posta isterse ikna edici bir sesli arama yoluyla olsun- parasal ve gizlilik açısından ortaya çıkan sonuçlar felaket olabilir.

İşletmeler için riskler de aynı derecede yüksektir. İyi tasarlanmış bir CEO deepfake dolandırıcılığı, çalışanları yetkisiz havale işlemleri başlatmaya veya gizli bilgileri ifşa etmeye kandırarak şirketlere büyük meblağlara ve hukuki sorunlara yol açabilir. Anlık mali darbenin yanı sıra, kuruluşlar itibarlarına ve müşteri güvenine de zarar verme riskiyle karşı karşıyadır. Bir şirketin yöneticisinin taklit edildiği veya markasının bir dolandırıcılıkta kullanıldığı haberi yayılırsa, müşteriler tedirgin olabilir. Bir dolandırıcılık girişimi zamanında tespit edilse bile, bu sahteciliklerin varlığı bile kafa karışıklığına yol açar. Şirketler, müşterilerini ve çalışanlarını kendi adlarına dolaşan sahte iletişimler konusunda uyarmak zorunda kalmıştır. Örneğin, dünyanın en büyük reklam şirketi olan WPP, şirket markasını taklit eden sahte web siteleri ve mesajlarla uğraştığını ve bu sahtekarları kapatmak için yetkililerle birlikte çalıştığını açıkladı.

Yapay zekâ sahtekarlığı, bireylerin itibarını kalıcı olarak zedeleyebilir. İkna edici bir şekilde sahte bir video veya ses kaydı, gerçek ortaya çıkmadan önce çevrimiçi olarak yayılabilir ve bir kişinin itibarını zedeleyebilir. Rahatsız edici bir olayda, Baltimore'da bir okul müdürü, saldırgan yorumlar yaptığı bir ses kaydının ortaya çıkmasının ardından görevden alındı; ancak araştırmacılar, bunun bir meslektaşı tarafından oluşturulmuş kötü niyetli bir deepfake olduğunu keşfetti. Bu tür olaylar ürkütücü bir gerçeği gözler önüne seriyor: Yapay zekâ tarafından üretilen yalanlar yalnızca para veya veri çalmakla kalmaz, aynı zamanda masum bir kişinin karakterine de zarar verebilir. Kamuoyunun önde gelen isimleri ve sıradan vatandaşlar için, deepfake'lerin neden olduğu güven erozyonu ciddi bir endişe kaynağıdır. Herkes videoda herhangi bir şeyi "söylemeye" veya "yapmaya" zorlanabildiğinde, gördüğümüz ve duyduğumuz şeylere güvenmek çok daha zorlaşır ve bu da meşru iletişimlere olan güveni zedeler.

Yapay Zeka Dolandırıcılıklarını Nasıl Tanıyabilir ve Önleyebilirsiniz?

Yapay zeka dolandırıcılıkları giderek daha karmaşık hale gelse de, bu dolandırıcılıkları engellemeye yardımcı olabilecek belirgin uyarı işaretleri ve koruyucu önlemler hâlâ mevcut. Güvenlik uzmanları, bir şeylerin yolunda gitmediğine dair ipuçlarına karşı dikkatli olmanızı tavsiye ediyor. Dolandırıcılar genellikle yanlış bir aciliyet hissi yaratır; örneğin, arayan kişi (belki de patronunuzu veya aile üyenizi taklit ederek) bir sorun hakkında derhal harekete geçmenizi talep edebilir. Doğrulamayı atlayıp "hemen yap" baskısı klasik bir uyarı işaretidir. Meşru kurumlar, tüm standart prosedürleri anında atlamanız konusunda nadiren ısrar eder. Gereksiz bir aciliyet hissediyorsanız, herhangi bir işlem yapmadan önce durup ikinci bir kanaldan doğrulama yapın.

Ayrıca, sesli veya görüntülü bir etkileşim tuhaf geliyorsa içgüdülerinize güvenin. En iyi deepfake teknolojilerinde bile bazen ince hatalar olabilir. Klonlanmış bir ses, doğal olmayan bir şekilde düz veya robotik bir tonda gelebilir ve yapay zeka tarafından sentezlenmiş bir videoda dudak senkronizasyonu, tuhaf ışıklandırma veya doğal olmayan göz hareketleri olabilir. Benzer şekilde, fazla kusursuz görünen e-postalara veya mesajlara dikkat edin. Yapay zeka tarafından oluşturulan birçok kimlik avı mesajı kusursuz bir biçimde biçimlendirilmiş ve dil bilgisi açısından doğrudur; ortalama bir insan e-postasından çok daha iyi yazılmıştır; ancak garip bir şekilde genel görünebilir ve gerçek bir tanıdık veya meslektaşın ekleyeceği kişisel bilgilerden yoksun olabilir. Bir mesajın dil açısından kusursuz ancak içerik açısından kişisel olmaması paradoksu, yapay zeka tarafından oluşturulmuş bir dolandırıcılıkla karşı karşıya olduğunuzun habercisi olabilir.

Bir diğer büyük kırmızı bayrak ise herhangi bir hassas bilgi veya ödeme için istenmeyen talep E-posta, kısa mesaj veya beklenmedik bir telefon görüşmesi yoluyla gelen mesajlara karşı son derece dikkatli olun. Sizden şifrelerinizi, hesap giriş kodlarınızı, Sosyal Güvenlik numaralarınızı veya diğer kişisel verilerinizi vermenizi isteyen mesajlara karşı son derece dikkatli olun. Aynı şekilde, alışılmadık yöntemlerle ödeme talepleri — Kripto para transferleri, ön ödemeli banka kartları veya hediye kartı kodları gibi — dolandırıcılığın bilinen bir özelliğidir, çünkü bu ödeme biçimleri gönderildikten sonra izlenmesi veya geri alınması zordur. Saygın bir şirketten veya devlet kurumundan olduğunu iddia eden biri sizi Bitcoin veya hediye kartlarıyla ödeme yapmaya yönlendirirse, bu neredeyse kesinlikle dolandırıcılıktır. Talep eden kişinin kimliğini her zaman resmi kanallar aracılığıyla iki kez kontrol edin. Örneğin, bankanızdan gelmiş gibi görünen ve hesabınızı güncellemenizi isteyen bir e-posta alırsanız, hiçbir bağlantıya tıklamayın. Bunun yerine, onaylamak için kredi kartınızın arkasındaki numarayı kullanarak bankayı arayın veya doğrulanmış web sitelerini ziyaret edin. Yapay zeka dolandırıcılıkları genellikle bankaları, devlet kurumlarını, hatta arkadaşlarınızı ve ailenizi taklit eder, bu nedenle bağımsız doğrulama çok önemlidir. İki dakikalık bir arama sizi maliyetli bir hatadan kurtarabilir.

Önleme açısından, birkaç pratik adım riskinizi önemli ölçüde azaltabilir. Çevrimiçi ortamda paylaştığınız kişisel bilgileri sınırlayın; dolandırıcılar, taklitlerini daha inandırıcı kılmak için doğum gününüz, işvereniniz veya aile üyelerinizin isimleri gibi bilgileri sosyal medyada tararlar. Ne kadar az bilgi ifşa ederseniz, o kadar az uğraşmak zorunda kalırlar. Önemli hesaplarınızda güçlü bir güvenlik önlemi uygulayın: çok faktörlü kimlik doğrulama (MFA) Mümkün olan her yerde, böylece bir parola çalınsa bile, bir hırsızın içeri girmek için ikinci bir koda veya onaya ihtiyacı olur. Yazılımınızı ve cihazlarınızı düzenli olarak güncellemek de önemlidir, çünkü güncellemeler genellikle bilgisayar korsanlarının istismar ettiği güvenlik açıklarını kapatır. Karmaşık ve benzersiz parolalar oluşturmak ve saklamak için bir parola yöneticisi kullanmayı da düşünün; bu şekilde, bir sitenin ihlali tüm dijital yaşamınızın anahtarlarını açığa çıkarmaz.

İşletmeler, çalışan eğitimine ve teknik savunmaya yatırım yapmalıdır. Düzenli eğitimler, çalışanlara kimlik avı girişimlerini ve deepfake hilelerini nasıl tespit edeceklerini öğreterek "güven ama doğrula" kültürünü güçlendirebilir. Aynı zamanda, modern e-posta güvenlik araçları, birçok kimlik avı e-postasını gelen kutularına ulaşmadan önce filtreleyebilir. Şirketler ayrıca, para transferi veya hassas veri paylaşımı taleplerini doğrulamak için katı politikalar belirleyebilir; örneğin, bilinen bir numarayla ikinci bir onay veya telefon onayı gerekebilir. Bu tür önlemler, ilk temas birini kandırmış olsa bile, bir yapay zeka dolandırıcılığını başlangıcında durdurabilir. Kısacası, insan dikkatini akıllı güvenlik teknolojisiyle birleştirmek, güvende kalmak için en iyi reçetedir.

Ne kadar dikkatli olursanız olun, bazı kişisel verilerinizin yine de tehlikeye girebileceği ihtimaline karşı hazırlıklı olmanız akıllıca olacaktır; ister veri ihlali, ister sızdırılan bir parola, isterse savunmaları aşan bir yapay zeka dolandırıcılığı olsun. İşte tam da bu noktada... kimlik hırsızlığı koruma ve izleme hizmetleri ekstra bir güvenlik ağı sağlayabilir.

NordProtect ile Savunmaları Güçlendirme

İç huzuru için umut vadeden bir çözüm, güvenilir bir kimlik koruma hizmeti Kişisel bilgilerinizin kötüye kullanılmasını izleyen bir kuruluş. Örneğin, NordVPNNordProtect, yapay zeka dolandırıcılıklarının yaşandığı çağa uygun olarak tasarlanmış kapsamlı bir güvenlik paketi sunuyor. NordProtect 7/24 karanlık web izleme, suç forumlarını ve veri dökümlerini tarayarak kişisel verilerinizin (e-posta adresleri, parolalar veya Sosyal Güvenlik numarası gibi) olmaması gereken yerlerde dolaştığını tespit ederseniz sizi uyarır. Ayrıca kredi ve kimlik takibi de içerir; kredi dosyalarınızı ve kamu kayıtlarınızı, kimliğinizin dolandırıcılık amacıyla kullanıldığını gösterebilecek ani değişiklikler veya yeni hesaplar açısından takip eder. Kullanıcılar, bir tehdit veya düzensiz bir etkinlik tespit edildiği anda anında güvenlik uyarıları alır ve bu sayede hasar oluşmadan önce hesapları kilitlemek için hızlı bir şekilde harekete geçebilirler.

Daha da önemlisi, NordProtect gibi hizmetler yalnızca izleme yapmaz; aynı zamanda müdahale etmenize de yardımcı olur. NordProtect, kimlik suçu mağdurlarına yardımcı olmak için özel destek ve hatta finansal koruma sağlar. Hatta, en kötü senaryonun gerçekleşmesi halinde yasal ücretler veya çalınan fonlar gibi masrafların karşılanmasına yardımcı olmak için 1 milyon dolara kadar kimlik hırsızlığı kurtarma sigortası kapsamı sunar. Bu tür bir destek, yapay zeka dolandırıcılığının sonuçlarından kurtulmada hayat kurtarıcı olabilir. NordProtect gibi bir çözümü iyi güvenlik alışkanlıklarıyla birlikte kullanarak, bireyler ve işletmeler deepfake ve yapay zeka destekli dolandırıcılıklara karşı savunmalarını önemli ölçüde güçlendirebilirler.

Sonuç olarak, yapay zeka destekli dolandırıcılığın önüne geçmek hem dikkatli olmayı hem de doğru araçları kullanmayı gerektirir. Dolandırıcılık dünyası, deepfake'ler, ses klonları ve sentetik kimliklerle baş döndürücü bir hızla gelişiyor olabilir, ancak farkındalık ve hazırlık, dengeyi savunucuların lehine çevirebilir. Bu yeni dolandırıcılıkların kırmızı bayraklarını bilerek, doğrulama ve şüphecilik uygulayarak ve aşağıdaki gibi güvenilir koruma hizmetlerinden yararlanarak: NordProtect, kurban olma riskinizi azaltabilirsiniz. Teknolojinin kötü niyetli kişileri silahlandırdığı bir dünyada, iyi adamların da zırh giymesi hiç bu kadar kritik olmamıştı. Bir şeyler ters gittiğinde, sağlıklı bir doz şüphenin en iyi dostunuz olduğunu unutmayın. Bilgi sahibi olun, dikkatli olun; en zeki dolandırıcıları bile alt etmek için iyi bir konumda olacaksınız.