Anderson’un Açısı

Kodlama AI’ları Dunning-Kruger Etkisinden Mustarip Olma Eğilimindedir

Yeni bir araştırmaya göre, ChatGPT gibi kodlama AI’ları Dunning-Kruger Etkisinden mustarip olma eğilimindedir ve genellikle en az yetkin oldukları durumlarda en fazla güvenle hareket ederler. Tanımadıkları veya az kullanılan programlama dillerini ele alırken, cevaplarının bozulmasına rağmen yüksek bir güvenle iddia ederler. Çalışma, modelin aşırı güvenini zayıf performans ve eğitim verisi eksikliği ile bağlantılı olarak ortaya koyarak, bu sistemlerin gerçekten bilmedikleri şeyleri ne kadar bildiklerine ilişkin yeni endişeler yaratmaktadır.

Herhangi bir kimse, gerçek konular hakkında Büyük Dil Modelleri ile etkileşime girdiğinde, bu modellerin genellikle güvenle yanlış cevaplar verdiğini bilir.

Bunun yanı sıra, halüsinasyon gibi daha açık formlarla birlikte, bu boş böbürlenmenin nedeni %100 rõ değildir. Yaz過 summer yayınlanan bir araştırma, modellerin yanlış olduklarını bildikleri halde güvenle cevaplar verdiklerini öne sürerken; diğer teoriler aşırı güveni mimari seçimlere bağlar.

Kullanıcı, bir coisa hakkında emin olabilir: deneyim son derece sinir bozucudur, çünkü bizler insanların kendi yeteneklerine ilişkin değerlendirmelerine güvenmek için kodlanmışızdır (en azından, bir kişinin abartılı vaatlerde bulunması ve vaatlerini yerine getirememesinin yasal ve diğer sonuçları vardır); ve bir tür antropomorfik aktarım, bu davranışı konuşma AI sistemleriyle tekrarlamamıza neden olur.

Ancak, bir LLM, hesaba çekilemeyen bir varlık olup, ‘Whoops! Butterfingers…’ diyebilir ve kullanıcının kazaen bir şeyi yok edebilir veya en azından kullanıcının bir öğleden sonrası zamanını boşa harcatabilir; eğer sorumluluğu kabul edecekse.

Kötü, bu dikkatsizlik eksikliği, en azından ChatGPT’de, kullanıcının öğleden sonrası zamanını boşa harcatabilir ve zararı yapıldıktan sonra düşünce kusurlarını açıklar. Sistemlerin sürekli belleği güncellemek veya tekrarlı promt’ler kullanmak, bu sorun üzerinde fazla bir etkisi yoktur.

İnsanlar da aynı şekilde inatçı ve kendini aldatıcı olabilir – ancak bu kadar derin ve sık hatalar yapan biri muhtemelen erken dönemde işten çıkarılacaktır. Bu gibi kişiler, ‘sahtekar sendromu’ndan (bir çalışanın kendini yeteneklerinin üzerinde terfi almış hissetmesi) farklı olarak, Dunning Kruger etkisinden mustarip olurlar, burada bir kişi yeteneklerini önemli ölçüde abartır.

Enflasyonun Maliyeti

Microsoft’tan yeni bir çalışma, Dunning-Kruger etkisinin AI destekli kodlama mimarilerinin (Redmond’un kendi Copilot gibi) etkili performansıyla ilişkisini incelemektedir ve bu alt-alanda özel olarak bu konuya odaklanan ilk çalışmadır.

Çalışma, bu kod yazan AI’ların kendi cevaplarına karşı nasıl güvendiklerini, karşılaştığı programlama dilleri açısından analiz etmektedir. Sonuçlar, bir insan benzeri modeli ortaya koyar: modeller en az yetkin olduklarında en fazla güvendiklerini ortaya koyar.

Etki, özellikle eğitim verisi ince olan az kullanılan veya nadir dillerde daha güçlüdür – model ne kadar zayıf veya dil ne kadar nadirse, beceri illüzyonu o kadar büyüktür:

GPT-4o’nun gerçek ve algılanan performansı, programlama dilleri açısından, gerçek performansa göre sıralanmıştır. Kaynak: https://arxiv.org/pdf/2510.05457

Dört yazar, Microsoft’ta eşit katkıda bulunanlar, çalışmanın bu araçların kendi çıktılarını değerlendirmelerine güvenebileceğimiz konusunda yeni sorular ortaya çıkardığını ve şunları belirtiyorlar:

‘Çeşitli programlama dilleri boyunca model güvenini ve performansı analiz ederek, AI modellerinin insanlardaki aşırı güven kalıplarını yansıttığını, özellikle de tanımadıkları veya düşük kaynaklı alanlarda ortaya çıkardığını gösteriyoruz.

‘Deneylerimiz, daha az yetkin modellerin ve nadir programlama dillerinde çalışanların daha güçlü DKE benzeri yanlılığa sahip olduğunu gösteriyor, bu da yanlılığın modèlelerin yetkinliği ile orantılı olduğunu gösteriyor. Bu, insan deneyleri için yanlılık ile uyumlu.

Araştırmacılar, bu çalışma çizgisini, model güveninin zayıf performans durumunda nasıl güvensiz hale geldiğini anlamak ve AI sistemlerinin insanlardaki aynı tür aşırı güveni sergileyip sergilemediğini test etmek için bir yol olarak bağlamlar.

Bu yeni makale, Betteridge’ın başlık yasasına meydan okumaktadır, ancak Do Code Models Suffer from the Dunning-Kruger Effect? olarak adlandırılmıştır. Yazarlar, çalışmanın kodunun yayınlandığını belirtiyorlar, ancak mevcut ön baskı bu konuda hiçbir ayrıntı içermemektedir.

Yöntem

Çalışma, kodlama AI’larının kendi cevaplarını nasıl değerlendirdiğini test etmek için, binlerce çoklu-seçimli programlama sorusu verdi, her soru belirli bir dil alanına ait:

Çalışmada kullanılan programlama dil alanları ve her alan için örneklenen çoklu-seçimli kodlama sorularının sayısı.

Modeller, doğru seçeneği seçmekle görevlendirildi ve ardından seçimleri için ne kadar güvendiklerini değerlendirmeleri istendi – gerçek performansları, cevaplarının ne kadar sık doğru olduğuyla ölçüldü ve kendi güvenlilik değerlendirmeleri, ne kadar iyi olduklarına inandıklarını gösterdi. Bu iki ölçütü karşılaştırarak, araştırmacılar güven ve yetkinlik arasındaki uyumsuzluğu görebildiler.

Modelin görünür güvenini ölçmek için çalışma, iki yöntem kullandı: mutlak güven ve göreceli güven. İlk methodda, model her cevap için 0 ile 1 arasında bir puan vermesi istendi, güveni belirli bir dil için, o dildeki sorular boyunca verilen puanların ortalaması olarak tanımladı.

İkinci method, modelin iki soru arasında seçim yapmasını gerektiriyordu; her çift için, model hangi sorudan daha emin olduğunu söylemeliydi. Bu seçimler, orijinal olarak rekabetçi oyunlar için tasarlanmış sıralama sistemleri kullanılarak puanlandı. Son puanlar her dil için normalize edildi ve ortalamalandı.

İki kurulmuş Dunning-Kruger Etkisi formu incelenmiştir: biri, tek bir modelin farklı alanlardaki performansını yanlış değerlendirmesini izler; diğeri, zayıf ve güçlü modeller arasındaki güven seviyelerini karşılaştırır.

İlk form, intra-participant DKE, bir modelin zayıf performans gösterdiği dillerde daha fazla aşırı güven sergileyip sergilemediğini sorar. İkincisi, inter-participant DKE, genel olarak daha zayıf performans gösteren modellerin kendilerini daha yüksek değerlendirmeye eğilimliler mi diye sorar.

Her iki durumda da, güven ile gerçek performans arasındaki boşluk, aşırı güveni ölçmek için kullanılır, düşük performans ayarlarında daha büyük boşluklar DKE benzeri davranışa işaret eder.

Sonuçlar

Çalışma, altı büyük dil modeli boyunca Dunning-Kruger Etkisini test etmektedir: Mistral; Phi‑3; DeepSeek‑Distill; Phi‑4; GPT‑0.1, ve GPT‑4o.

Her model, kamu dostup CodeNet veri setinden çoklu-seçimli programlama sorularına tabi tutuldu, 37 dil* temsil edildi ve güven ile doğruluk nasıl değişti.

Ara-model analizi, açık bir Dunning-Kruger kalıbını gösterir:

Altı kod modeli boyunca gerçek ve algılanan performans, düşük performans gösteren modellerin (Mistral ve Phi‑3 gibi) yüksek güvene rağmen zayıf doğruluk gösterdiğini, güçlü modellerin (GPT‑4o gibi) ise daha dengeli veya hatta güvensiz davranış sergilediğini gösterir.

Daha az doğru olan modeller, Mistral ve Phi‑3 gibi, yeteneklerini abartma eğilimindeyken, daha yüksek performans gösteren sistemler, GPT‑4o gibi, güven seviyeleri gerçek performanslarıyla daha iyi uyumludur, özellikle göreceli güven açısından.

Sonuçlar ayrıca, en yetkin modellerin bazen kendilerini küçümsediklerini gösterir (mutlak güven puanları bunu yakalamaz).

Araştırma ayrıca, intra-model analizi de Dunning-Kruger Etkisinin varlığını destekler. Sonuç grafiğinde, her modelin farklı programlama dilleri boyunca nasıl performans gösterdiğini, gerçek performanslarına göre sıralanmış olarak görüyoruz.

Modeller, özellikle nadir veya düşük kaynaklı dillerde (COBOL, Prolog ve Ceylon gibi) zayıf performans gösterdiklerinde, güvenleri haklı çıkarmayan ölçüde daha yüksek görünmektedir. İyi bilinen dillerde (Python ve JavaScript gibi), güvenleri gerçek doğruluklarıyla daha yakın uyumludur ve bazen sogar daha düşük.

Bu kalıp, hem mutlak hem de göreceli güven ölçümlerinde ortaya çıkıyor, modellerin tanımadıkları kodlama alanlarında kendi sınırlarından less bilinçli olduklarını gösteriyor.

Modelleri katılımcı olarak ele almak bazı sınırlılıklar getirdi, çünkü küçük model sayısı çeşitliliği etkiler; tek bir modelin içindeki farklılıklar göz ardı edilir ve veri dağılımı gerçek insan katılımcılarınınkine benzemeyebilir.

Bunu telafi etmek için çalışma, üç alternatif kurulum test etti: önce, her modele ayrı bir kişilik verildi; ikincisi, cevaplar daha yüksek sıcaklıkta örneklenerek daha fazla varyasyon yaratıldı; üçüncüsü, promt’ler birden fazla kez yeniden yazıldı ve her bir versiyon ayrı bir katılımcı olarak ele alındı:

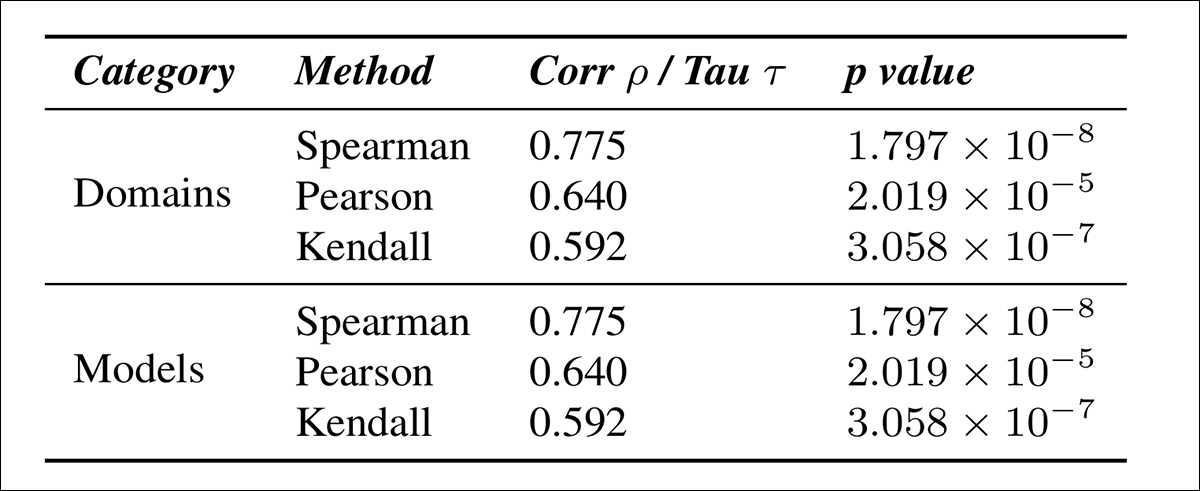

Farklı deneysel kurulumlar boyunca aşırı güven ve gerçek performans arasındaki korelasyon, Dunning-Kruger kalıbının tüm koşullarda tutarlı olduğunu ve aynı modelden çok çeşitli cevaplar örneklenince en güçlü olduğunu gösterir.

Yukarıdaki sonuç tablosu, Dunning-Kruger Etkisinin her durumda nasıl ortaya çıktığını ve aynı modelden yüksek sıcaklıkta örneklenen birden fazla cevap olduğunda en güçlü olduğunu gösterir.

Araştırmacılar, algılanan performansın gerçek performanstan nasıl farklılaştığını daha iyi anlamak için, her modelin kendi yeteneklerini nasıl abarttığını hesapladı (özellikle, güven puanı ile gerçek doğruluk arasındaki farkı) ve bu abartmanın gerçek performansı ile nasıl ilişkili olduğunu ölçtü:

Aşırı güven (mutlak güven – göreceli güven olarak ölçülür) ve gerçek doğruluk arasındaki korelasyon, programlama alanları ve model türleri boyunca, daha fazla abartmanın daha düşük performansla tutarlı olarak ilişkili olduğunu gösterir.

Yukarıdaki sonuç tablosu, abartmanın gerçek performansa nasıl relacionlu olduğunu hem programlama alanları hem de modeller boyunca gösterir. Her iki durumda da, daha az doğru olan modellerin daha fazla abartma gösterdiğini görebiliriz.

Ayrıca, özel modeller, daha dar alanlara odaklanarak, genelci modellere göre daha güçlü DKE etkileri gösterirler:

Temel, tek-alan ve çok-alan uzmanlaşmış modeller için abartma ve gerçek performans arasındaki korelasyon, uzmanlaşmanın artmasıyla DKE etkisinin güçlendiğini gösterir.

MultiPL-E veri setini sekiz programlama dili boyunca kullanarak, yazarlar, tek-alan eğitimlerinin çok-alan veya temel kurulumlardan daha fazla abartmaya yol açtığını buldular, bu da DKE’nin uzmanlaşmayla birlikte kötüleştiğini öne sürer.

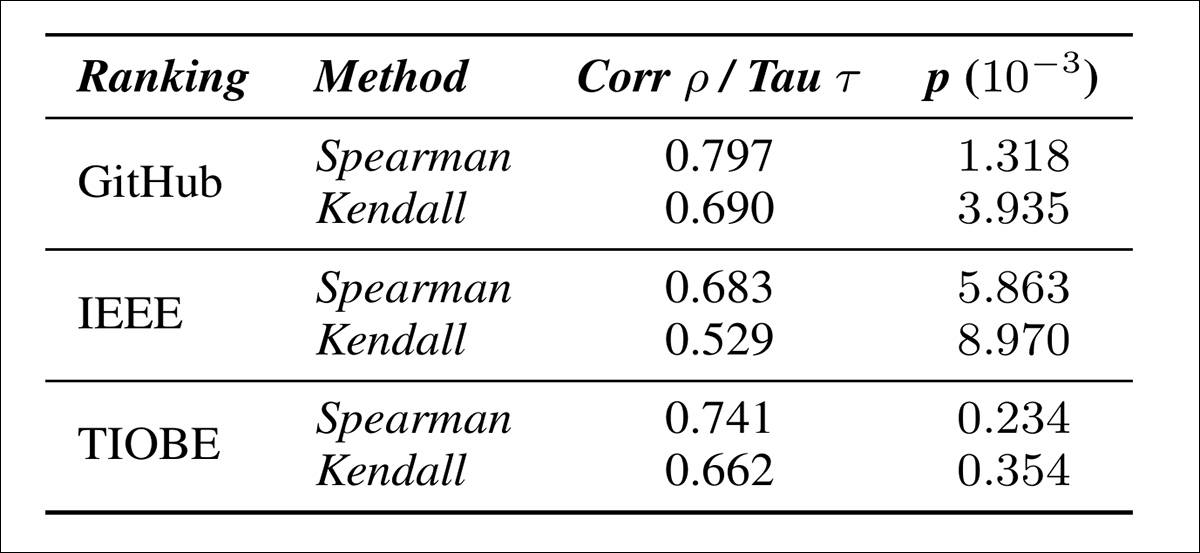

Testler ayrıca, modellerin nadir programlama dillerinde daha fazla abartma gösterdiğini buldu. GitHub, IEEE ve TIOBE sıralamalarında, nadirlik güçlü bir şekilde daha yüksek algılanan performansla korelasyon gösterir, zirve 0.797’de:

Üç popülerlik sıralaması kullanarak model aşırı güveni ve dil nadirliği arasındaki korelasyon, daha az kullanılan dillerin daha yüksek algılanan performansla ilişkili olduğunu gösterir.

Son olarak, yazarlar, Dunning-Kruger Etkisinin kod oluşturma görevlerinde de ortaya çıkıp çıkmadığını test etmek için, modelleri MultiPL-E veri seti boyunca sekiz dilde değerlendirdiler.

Etki hala mevcuttu, ancak açık uçlu görevlerde çoklu-seçimli sorulara göre daha zayıftı, bu da açık uçlu görevlerde güven ve doğruluğun değerlendirilmesinin daha zor olabileceğini yansıtabilir:

Açık uçlu kod oluşturma görevlerinde, sekiz dil boyunca abartma ve gerçek performans arasındaki korelasyon, MultiPL‑E sonuçlarına dayanarak.

Dunning-Kruger Etkisinin hala tartışmalı açıklamasını dikkate alarak, yazarlar şöyle sonuca varırlar:

‘Hem insanlar hem de AI modelleri için ortak bir açıklama, meta-bilişsel açıklamadır, bu da bir becerinin kalitesini değerlendirmenin, o beceriyi edinmenin önemli bir parçası olduğunu söyler.

‘Bu açıklama, AI modellerinde farklı eğitim stratejilerinin ve bunların hem performans hem de performans kalitesini değerlendirmede aynı anda iyileşmelerine yol açıp açmadığını test ederek deneysel olarak sınanabilir. Ancak bu çalışma, bu makalenin kapsamı dışında kalıyor ve gelecekteki çalışmalara bırakıyoruz.’

Sonuç

Dunning-Kruger Etkisi, kendi alanlarında bile, istatistiksel veya bilişsel bir nedene atfedilebilir. İstatistiksel bir nedense, bu sendromun benzersiz olarak insanlara özgü olduğu düşünülürse, makine öğrenimi bağlamına uygulanması oldukça geçerlidir.

Yazarlar, nedenin ‘bilişsel’ olabileceğini öne sürseler de, bu, biraz daha metafiziksel bir bakış açısı gerektirir.

Belki de çalışmanın en ilginç bulgusu, birkaç kodlama LLM’sinin en az favorable koşullarda, yani en az bilinen dillerle çalışırken, güvenlerini en üst düzeye çıkarma eğiliminde olmalarıdır – bu, gerçek bir iş ortamında hemen kendini gösteren bir strateji olurdu.

* Kullanılan programlama dilleri şunlardı: Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript ve Visual Basic.

İlk olarak 8 Ekim 2025’te yayınlandı.