Yapay Zekâ

Yapay Zeka Modelleri Temel Saat Okumada Takıldı, İnsanlar Mükemmel Performans Gösterdi

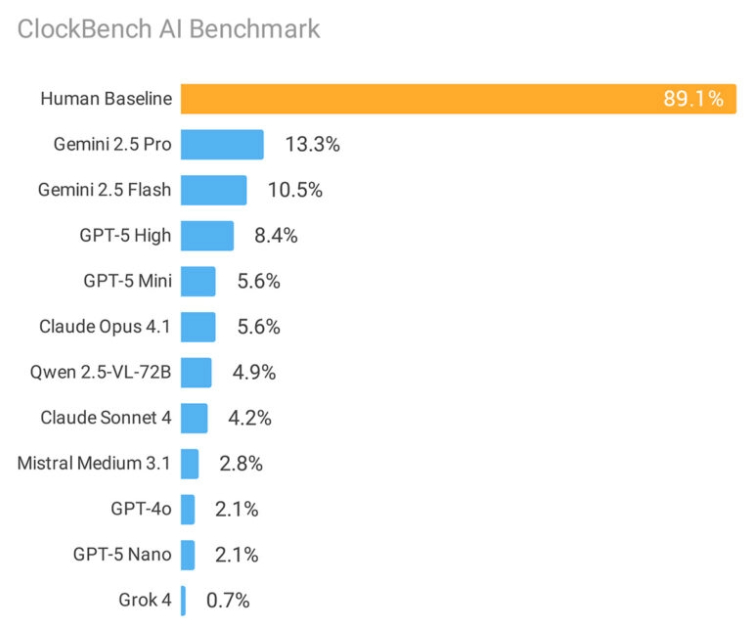

Bir kapsamlı çalışma 11 önde gelen yapay zeka modelini analoq saat okumada insanlarla karşılaştırarak mevcut yapay zeka sistemlerinde şaşırtıcı bir zayıflık ortaya çıkardı. İnsanlar saat okumada %89,1 doğruluk oranı elde ederken, Google’ın en iyi modeli aynı teste yalnızca %13,3 doğruluk oranıyla cevap verebildi.

ClockBench çalışması, araştırmacı Alek Safar tarafından yürütüldü ve hatta en gelişmiş yapay zeka sistemlerinin de çocuklar tarafından kolayca halledilen görsel görevlerle mücadele ettiğini gösterdi. Test, Google, OpenAI, Anthropic ve diğer büyük yapay zeka laboratuvarlarından sistemleri 180 özel tasarlanmış analoq saat kullanarak test etti.

Bu, saatlerin ötesine geçer. Sonuçlar, yapay zeka sistemlerinin görsel bilgileri işleme ve akıl yürütme konusunda temel sınırlılıkları vurgular. “Analoj saat okumak, görsel alanda akıl yürütme yapmak için yüksek bir standart belirler” diye not eder Safar araştırma makalesinde. Görev, modellerin saat iğnelerini tanımlamasını, ilişkilerini anlamasını ve görsel konumlarını sayısal zamana çevirmesini gerektirir.

Hata kalıplarını incelediğinizde performans açığı daha da çarpıcı hale gelir. İnsanlar hata yaptıklarında, median hata yalnızca üç dakika oldu. Yapay zeka modelleri ise bir ila üç saat arasında hata yaptılar – yaklaşık olarak 12 saatlik bir saatte rastgele tahmin etmeye eşdeğer.

Özel Zayıflıklar Açığa Çıktı

Yapay zeka sistemleri özellikle aşağıdaki konularda zorluk yaşadı:

- Roma rakamları (%3,2 doğruluk oranı)

- Yansıtılmış veya ters saat yüzleri

- Renkli arka planlar veya karmaşık tasarımlar

- Saniye iğnesi gerektiren saatler

İlginç bir şekilde, yapay zeka modelleri bir saati başarıyla okuduğunda, zaman eklemek veya saat dilimlerini dönüştürmek gibi takip görevlerinde iyi performans gösterdiler. Bu, temel zorluğun ilk görsel tanıma değil, matematiksel akıl yürütme değil, daha çok görsel tanıma olduğunu öne sürer.

Endüstri Performans Ayrıntıları

Google modelleri önde gitti, Gemini 2.5 Pro %13,3 doğruluk oranıyla ve Gemini 2.5 Flash %10,5 doğruluk oranıyla. OpenAI’nin GPT-5 %8,4 puan aldı, Anthropic’in Claude modelleri daha düşük performans gösterdi, Claude 4 Sonnet %4,2 ve Claude 4.1 Opus %5,6.

xAI’nin Grok 4’ü %0,7 doğruluk oranıyla şaşırtıcı derecede kötü sonuçlar elde etti, ancak bu, modelin yalnızca %20,6’sının gerçekten imkansız zamanları gösterdiği halde tüm saatlerin %63’ünü imkansız zamanları gösterdiği şeklinde yanlış şekilde işaretlemesinden kaynaklandı.

Kaynak: Alek Safar

Genişletilmiş AI Geliştirme İmpilikasyonları

Çalışma, ARC-AGI ve SimpleBench testlerinde görüldüğü gibi “insan için kolay, yapay zeka için zor” benchmark yaklaşımını takip ediyor. Yapay zeka sistemleri bilgi yoğun görevleri nhanh bir şekilde fethettiler ve birçok standart testte insan performansı aşmalarına rağmen, temel görsel akıl yürütme hala sorunlu görünüyor.

Araştırma, mevcut ölçekleme yaklaşımlarının görsel akıl yürütme zorluklarını çözemeyebileceğini öne sürüyor. Safar, analoj saatlerin eğitim verisinde temsil edilmeyebileceğini ve görsel saat temsilinin akıl yürütme için metne çevrilmesinin ek karmaşıklıklar yaratabileceğini varsayar.

ClockBench, yapay zeka kısıtlamalarını belirlemek için tasarlanmış bir dizi benchmarkın büyüyen koleksiyonuna katılır – bunlar geleneksel testlerde hemen görünmeyen sınırlamalar. Tam veri seti, gelecekteki yapay zeka eğitimini kontamine etmekten kaçınmak için özel tutuluyor, yalnızca küçük örnekler test için halka açık hale getiriliyor.

Sonuçlar, mevcut yapay zeka geliştirme paradigmalarının bu görsel akıl yürütme açıklarını ele alabileceği konusunda şüpheler yaratıyor – diğer alanlardaki ilerlemeye benzer şekilde, test zamanı hesaplama gibi yeni yaklaşımlar gerekli olabilir.

Şimdilik, mütevazi analoj saat,几乎 her insan tarafından okunabilen ancak dünyanın en gelişmiş yapay zeka sistemlerini şaşırtan bir kale olarak duruyor.