Anderson’un Açısı

Yeni Nesil Derin Sahtecilik için Adli Veri Yöntemi

Özel kişilerin derin sahteciliği, artık bir büyüyen kamu endişesi haline gelmiş ve çeşitli bölgelerde artan bir şekilde yasaklanmaktadır. Ancak, bir kullanıcı tarafından oluşturulan bir modelin – örneğin intikam pornosu ermögeyen bir modelin – belirli bir kişinin görüntüleri üzerinde özel olarak eğitildiğini kanıtlamak son derece zor olmaya devam etmektedir.

Sorunu bağlamında ele almak için: bir derin sahtecilik saldırısının temel unsurlarından biri, bir görüntüde veya videoda belirli bir kişinin göründüğünü yanlış bir şekilde iddia etmektir. Sadece bir videodaki kişinin kimlik #A olduğunu, sadece bir benzerine benzeyen değil, söylemek zarar yaratmak için yeterli, ve bu senaryoda hiçbir AI gerekli değildir.

Ancak, bir saldırgan gerçek bir kişinin verilerini kullanarak AI görüntüleri veya videolar oluştururrsa, sosyal medya ve arama motoru yüz tanıma sistemleri, faked içeriği otomatik olarak kurbanla bağlayacaktır – posta veya meta verilerinde adlar gerektirmeden. AI tarafından oluşturulan görseller alone, ilişkilendirmeyi sağlar.

Bir kişinin görünümü ne kadar belirginse, bu o kadar kaçınılmaz hale gelir, sonunda sahte içerik görüntü aramalarında görünür ve sonunda kurbana ulaşır.

Yüz yüze

Kimlik odaklı modelleri yaymanın en yaygın yolu şu anda Düşük Sıralı Uyum (LoRA) aracılığıyla, burada kullanıcı birkaç saat boyunca daha büyük bir temel modelin ağırlıklarına karşı birkaç görüntüyü eğitir, örneğin Stable Diffusion (çoğunlukla statik görüntüler için) veya Hunyuan Video için video derin sahtecilikleri.

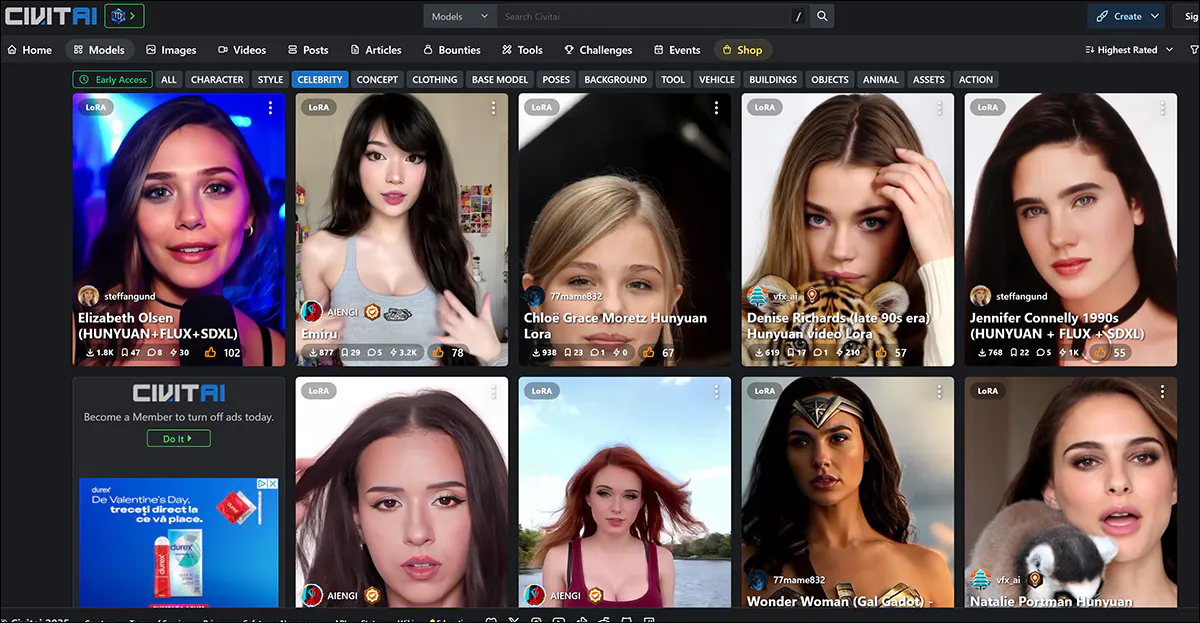

LoRA’ların en yaygın hedefleri, yeni video tabanlı LoRA’ların da dahil olduğu, kadın ünlülerdir. Ünlüler, bu tür türetilmiş eserlerin ‘adil kullanım’ altında (en azından ABD ve Avrupa’da) kapsandığı varsayımı nedeniyle, ‘bilinmeyen’ kurbanlara kıyasla daha az kamu eleştirisi ile maruz kalmaktadırlar.

Kadın ünlüler, civit.ai portalındaki LoRA ve Dreambooth listelerinde hakimiyet kuruyor. Şu anda en popüler LoRA, 66.000’den fazla indirmeye sahip, bu kullanım AI’nin hala ‘kenar’ bir faaliyet olarak görülmesi dikkate alındığında önemli.

Derin sahtecilik kurbanı olan non-ünlüler için böyle bir kamu forumu yoktur, bunlar sadece dava prosedürleri ortaya çıktığında veya kurbanlar popüler mecralarda konuşmaya başladıklarında ortaya çıkar.

Her iki senaryoda da, hedef kimliklerin sahteciliğini sağlayan modeller, eğitim verilerini modelin latent uzayına o kadar iyi bir şekilde ‘distilled’ etmiştir ki, kullanılan kaynak görüntülerini tanımlamak zor hale gelir.

Eğer bu eğer yapılabilirse, kabul edilebilir bir hata payı içinde, bu, LoRA’ları paylaşanların kovuşturulmasını mümkün kılacaktır, çünkü bu, sadece belirli bir kimliği (yani, özel bir kişinin, adını defamation prosedürü sırasında hiç kullanmasa da) sahtecilik niyetini kanıtlamakla kalmaz, aynı zamanda yükleyiciyi telif hakkı ihlali suçlamalarına maruz bırakır, ilgili durumlarda.

Sonuncusu, derin sahtecilik teknolojilerinin yasal düzenlemesinin eksik veya yavaş olduğu yargı bölgelerinde faydalı olacaktır.

Aşırı Maruz Kalma

Bir temel modeli eğitmek objetivo, örneğin Hugging Face’den indirilebilecek çok gigabaytlık bir model, modelin iyi genelleştirilmiş ve esnek olmasıdır. Bu, yeterli sayıda çeşitli görüntüler üzerinde eğitim görmek ve uygun ayarlarla eğitim yapmak ve modelin ‘overfit’ olmasına başlamadan önce eğitimi sonlandırmak anlamına gelir.

Bir overfitted model, eğitim prosedürü sırasında verileri çok fazla (aşırı) görmüş ve çok benzer görüntüler üretecektir, böylece eğitim verilerinin kaynağını ortaya çıkaracaktır.

Kimlik ‘Ann Graham Lotz’ Stable Diffusion V1.5 modelinde neredeyse mükemmel bir şekilde yeniden üretiliyor. Rekonstrüksiyon, eğitim verilerine (yukarıdaki resmin solunda) neredeyse aynı. Kaynak: https://arxiv.org/pdf/2301.13188

Ancak, overfitted modeller genellikle yaratıcıları tarafından dağıtılmak yerine atılır, çünkü onlar zaten amaç için uygun değillerdir. Bu nedenle bu, olası bir adli ‘rüzgar’ değildir. Her halükarda, prensip, daha çok temel modellerin pahalı ve yüksek hacimli eğitimine uygulanır, burada aynı büyük kaynak veri setine girmiş olan aynı görüntünün birden fazla sürümü, belirli eğitim görüntülerini kolayca çağırmaya neden olabilir (yukarıdaki resim ve örnek).

LoRA ve Dreambooth modelleri (Dreambooth, büyük dosya boyutları nedeniyle modadan çıkmıştır) durumunda şeyler biraz farklıdır. Burada, kullanıcı, bir konunun çok sınırlı ve çeşitli görüntülerini seçer ve bunları bir LoRA eğitmek için kullanır.

Solda, Hunyuan Video LoRA’nın çıktısı. Sağda, benzerliği mümkün kılan veriler (görüntüler, betimlenen kişinin izniyle kullanılmıştır).

Sık sık, LoRA, [ünlü ismi] gibi bir tetikleme kelimesiyle eğitilir. Ancak, genellikle, özellikle eğitilen konu, böyle bir.prompt olmadan da oluşturulan çıktı içinde görünür, çünkü iyi dengelenmiş (yani, overfitted olmayan) bir LoRA bile eğitildiği materyale biraz ‘bağlıdır’ ve çıktı içinde onu içerecektir.

Bu eğilim, LoRA veri setindeki sınırlı görüntü sayısının birleşimiyle, modeli adli analize maruz bırakır, zoals görülecektir.

Verileri Maskesizleştirme

Bu konular, Danimarka’dan yeni bir makalede ele alınmaktadır, bu makale, bir black-box Üyelik Tahmin Saldırısı (MIA)中的kaynak görüntüleri veya görüntü gruplarını tanımlamak için bir metodoloji sunar. Teknik, kısmen, kaynak verilerini ortaya çıkarmaya yardımcı olmak için özel olarak eğitilmiş modeller oluşturmak için kullanılır:

Yeni yaklaşımın oluşturduğu ‘sahte’ görüntülerin örnekleri, artan Classifier-Free Guidance (CFG) seviyelerinde, yok olma noktasına kadar. Kaynak: https://arxiv.org/pdf/2502.11619

Bu çalışma, Yüz Görüntüleri için Fine-Tuned Latent Diffusion Modellerine Karşı Üyelik Tahmin Saldırıları başlığını taşır, ve bu konuya ilişkin literatürdeki en ilginç katkıdır, ancak aynı zamanda erişilemeyen ve kısaltılmış bir makale olarak yazılmıştır ve önemli bir ‘şifreleme’ gerektirir. Bu nedenle, temel prensipleri burada ve bazı sonuçları kapsayacağız.

Aslında, biri AI modelini yüzünüzde fine-tune ederse, yazarların yöntemi, modelin oluşturduğu görüntülerdeki bellek izlerini arayarak kanıtlamaya yardımcı olabilir.

İlk olarak, bir hedef AI modeli, yüz görüntüleri veri setine fine-tune edilir, bu da modelin çıktılarında bu görüntülerden detayları yeniden üretmesini daha olası hale getirir. Ardından, bir sınıflandırma saldırısı modu, hedef modelin AI tarafından oluşturduğu görüntülerini ‘pozitif’ örnekler (şüpheli üyeler) olarak ve başka bir veri setinden görüntüleri ‘negatif’ örnekler (üyeler değil) olarak kullanarak eğitilir.

Bu gruplar arasındaki ince farklılıkları öğrenerek, saldırı modeli, bir görüntünün orijinal fine-tune veri setinin bir parçası olup olmadığını tahmin edebilir.

Saldırı, özellikle bir AI modelinin belirli bir görüntüleri kümesiyle fine-tune edildiğinde en etkili olur. Ancak, modelin bir veri setini kullandığını belirleyebilir, ancak o veri setindeki bireysel görüntüleri tanımlamakta zorluk çeker.

Pratik olarak, bu, böyle bir yaklaşımın adli olarak kullanılmasına engel değildir; ünlü bir veri setinin kullanıldığını belirlemenin relativ olarak az değeri olsa da, özel bir kişiye (ünlü olmayan) saldıran bir kişi, genellikle daha az veri seti seçeneğine sahip olacaktır ve sosyal medya albümleri ve diğer online koleksiyonlar gibi mevcut veri gruplarını tam olarak kullanmak zorunda kalacaktır. Bunlar, belirtilen yöntemlerle keşfedilebilecek bir ‘hash’ oluşturur.

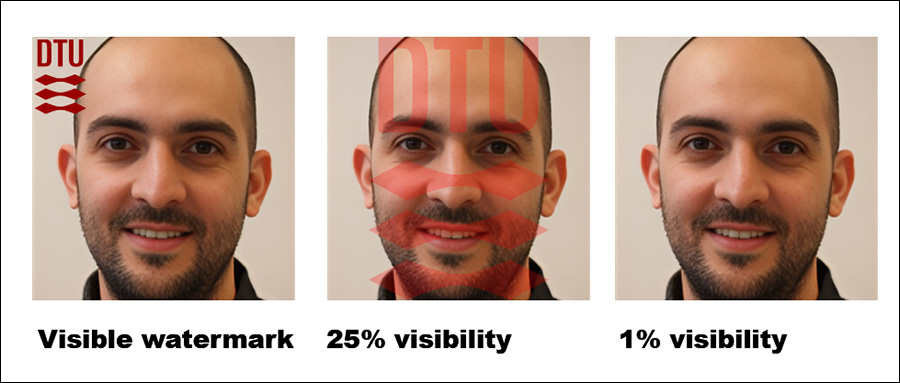

Makale, ayrıca, görüntülere görünür su işaretleri eklemenin algılamayı daha da kolaylaştırdığını belirtir – gizli su işaretleri ise çok az veya hiç fayda sağlamaz.

Sağdaki resim, testlerde kullanılan ‘gizli’ su işareti.

Son olarak, metin-görüntü oluşturma rehberliği düzeyi de bir rol oynar, ideal dengenin yaklaşık 8 rehberlik ölçeğinde bulunduğu tespit edilir. Doğrudan bir.prompt kullanılmadığında bile, fine-tune edilmiş bir model hala eğitim verilerine benzeyen çıktılar üretme eğilimindedir, saldırının etkinliğini güçlendirir.

Yöntem/Veri

Çalışmada, Technical University of Denmark (DTU, makalenin üç araştırmacısının ev sahibi kurumu) tarafından türetilen birkaç veri seti kullanılmıştır, hedef modeli fine-tune etmek ve saldırı modunu eğitmek ve test etmek için.

Kullanılan veri setleri DTU Orbit:

DseenDTU Temel görüntü kümesi.

DDTU DTU Orbit’ten alınan görüntüler.

DseenDTU Hedef modeli fine-tune etmek için kullanılan DDTU’nun bir bölümü.

DunseenDTU DDTU’nun, hiçbir görüntü oluşturma modelini fine-tune etmek için kullanılmayan bir bölümü ve bunun yerine saldırı modelini test etmek veya eğitmek için kullanılır.

wmDseenDTU DDTU’nun, görünür su işaretleri ile fine-tune edilen bir bölümü.

hwmDseenDTU DDTU’nun, gizli su işaretleri ile fine-tune edilen bir bölümü.

DgenDTU DseenDTU görüntü setine fine-tune edilmiş bir Latent Diffusion Model (LDM) tarafından oluşturulan görüntüler.

Hedef modeli fine-tune etmek için kullanılan veri setleri, BLIP kaptiyonlama modeli tarafından kaptiyonlanmış görüntü-metin çiftlerinden oluşur (muhtemelen kedi AI topluluğundaki en popüler sansürsüz modellerden biri).

BLIP, her açıklamaya ‘a dtu headshot of a’ ifadesini eklemiştir.

Ayrıca, Aalborg Üniversitesi’nden (AAU) türetilen birkaç veri seti de testlerde kullanılmıştır, hepsi AU VBN corpus:

DAAU AAU vbn’den alınan görüntüler.

DseenAAU DAAU’nun, hedef modeli fine-tune etmek için kullanılan bir bölümü.

DunseenAAU DAAU’nun, hiçbir görüntü oluşturma modelini fine-tune etmek için kullanılmayan bir bölümü ve bunun yerine saldırı modelini test etmek veya eğitmek için kullanılır.

DgenAAU DseenAAU görüntü setine fine-tune edilmiş bir LDM tarafından oluşturulan görüntüler.

Önceki setlere benzer şekilde, tüm etiketler DTU veri setinin temel özelliklerini pekiştirmek için ‘a aau headshot of a’ ifadesini kullanır.

Testler

Saldırıların hedef modeline karşı nasıl performans gösterdiğini değerlendirmek için birden fazla deney yapılmıştır. Her test, bir görüntü verisi setini yetkisiz olarak elde edilmiş bir hedef modeli fine-tune etmek için kullanıldığında, başarılı bir saldırı yapılıp yapılamayacağını belirlemeyi amaçlamaktadır.

Yaklaşımın şeması.

Fine-tune edilmiş model, çıktı görüntüleri oluşturmak için sorgulanır, bu görüntüler sonra saldırı modeli için pozitif örnekler olarak kullanılır, ayrıca başka görüntüler de negatif örnekler olarak dahil edilir.

Saldırı modeli, gözetimli öğrenme kullanarak eğitilir ve sonra yeni görüntülerde test edilir, bu görüntülerin orijinal fine-tune veri setinin bir parçası olup olmadığını belirlemek için.

Saldırının doğruluğunu değerlendirmek için, test verilerinin %15’i doğrulama için ayrılmıştır.

Hedef modelin fine-tune edildiği veri seti bilinen bir veri seti olduğu için, saldırı modeli için eğitim verisi oluşturulurken her görüntünün üyelik durumu zaten belirlenmiştir. Bu kontrol edilen kurulum, saldırının üyelik durumunu ne kadar etkili bir şekilde belirleyebileceğini net bir şekilde değerlendirmeye izin verir.

Testlerde, Stable Diffusion V1.5 modeli kullanılmıştır. Bu model, LoRA oluşturma için Stable Diffusion topluluğu arasında popülerliğini korumuştur, çünkü model tamamen sansürsüzdür.

Araştırmacıların saldırı modeli, Resnet-18 modeline dayanmaktadır, modelin önceden eğitilmiş ağırlıkları korunmuştur. ResNet-18’in son 1000 nöronlu katmanı, iki nöronlu bir tam bağlantılı katmanla değiştirilmiştir. Eğitim kaybı, kategorik cross-entropy idi ve Adam optimizer kullanıldı.

Her test için, saldırı modeli beş kez farklı rastgele tohumlar kullanarak eğitildi, anahtar metriklere %95 güven aralıkları hesaplandı. Zero-shot sınıflandırma, CLIP modeli kullanılarak temel olarak kullanıldı.

(Lütfen unutmayın ki orijinal makaledeki ilk sonuçlar tablosu kısaltılmış ve通常 difícül anlaşılabilir. Bu nedenle, daha kullanıcı dostu bir formatta yeniden formüle edilmiştir. Lütfen daha iyi bir çözünürlükte görüntülemek için resme tıklayınız)

Araştırmacıların saldırı yöntemi, özellikle fine-tune edilmiş modellere karşı en etkili oldu, özellikle bir kişinin yüzü gibi belirli bir görüntü kümesi üzerinde eğitilenler. Ancak, while saldırı, bir veri setinin kullanıldığını belirleyebilir, o veri setindeki bireysel görüntüleri tanımlamakta zorluk çeker.

Pratik olarak, bu, böyle bir yaklaşımın adli olarak kullanılmasına engel değildir; ünlü bir veri setinin kullanıldığını belirlemenin relativ olarak az değeri olsa da, özel bir kişiye (ünlü olmayan) saldıran bir kişi, genellikle daha az veri seti seçeneğine sahip olacaktır ve sosyal medya albümleri ve diğer online koleksiyonlar gibi mevcut veri gruplarını tam olarak kullanmak zorunda kalacaktır. Bunlar, belirtilen yöntemlerle keşfedilebilecek bir ‘hash’ oluşturur.

Makale, ayrıca, görüntülere görünür su işaretleri eklemenin algılamayı daha da kolaylaştırdığını belirtir – gizli su işaretleri ise çok az veya hiç fayda sağlamaz.

Ayrıca, AI tarafından oluşturulan görüntülerin ‘non-üyeler’ olarak kullanılması, gerçek görüntülerine kıyasla daha yüksek başarı oranlarına yol açar.

Görünür su işaretlerinin kullanımı, algılama oranlarını önemli ölçüde artırır.

Son olarak, metin-görüntü oluşturma rehberliği düzeyi de bir rol oynar, ideal dengenin yaklaşık 8 rehberlik ölçeğinde bulunduğu tespit edilir. Doğrudan bir.prompt kullanılmadığında bile, fine-tune edilmiş bir model hala eğitim verilerine benzeyen çıktılar üretme eğilimindedir, saldırının etkinliğini güçlendirir.

Sonuç

Bu ilginç makalenin, böyle bir erişilemeyen şekilde yazılmış olması üzücüdür, çünkü bu, hem gizlilik savunucuları hem de AI araştırmacıları için ilgi çekici olmalıdır.

Üyelik tahmini saldırıları, belki de ilginç ve verimli bir adli araç olabilir, ancak daha da önemli olan, bu araştırma kolunun, derin sahtecilik algılama gibi genel bir ‘çekiç ve çekiç” oyununa düşmemek için, uygulanabilir geniş ilkeler geliştirmesidir.

Bu yeni araştırmada daha yüksek düzeyde bir ilkenin temizlendiğine dair bazı kanıtlar olduğuna göre, bu yönde daha fazla çalışma görmeyi umabiliriz.

Cuma, 21 Şubat 2025 tarihinde ilk kez yayımlandı