Artificiell intelligens

Självuppmärksamhetsvägledning: Förbättring av provkvaliteten på diffusionsmodeller

Denoising Diffusion Models är generativa AI-ramverk som syntetiserar bilder från brus genom en iterativ denoising-process. De är hyllade för sina exceptionella bildgenereringsmöjligheter och mångfald, till stor del tillskrivna text- eller klassvillkorade vägledningsmetoder, inklusive klassificerarevägledning och klassificerarefri vägledning. Dessa modeller har varit särskilt framgångsrika när det gäller att skapa olika bilder av hög kvalitet. Nyligen genomförda studier har visat att vägledningstekniker som klasstexter och etiketter spelar en avgörande roll för att förbättra kvaliteten på bilder som dessa modeller genererar.

Dock möter diffusionsmodeller och vägledningsmetoder begränsningar under vissa yttre förhållanden. Klassificerare-fri vägledning (CFG)-metoden, som använder etikettborttagning, lägger till komplexitet till utbildningsprocessen, medan klassificerarevägledning (CG)-metoden kräver ytterligare klassificerareutbildning. Båda metoderna är något begränsade av deras beroende av hårt förvärvade yttre förhållanden, vilket begränsar deras potential och begränsar dem till villkorliga inställningar.

För att komma till rätta med dessa begränsningar har utvecklare formulerat en mer generell strategi för diffusionsvägledning, känd som Self-Attention Guidance (SAG). Denna metod utnyttjar information från intermediära prover av diffusionsmodeller för att generera bilder. Vi kommer att utforska SAG i den här artikeln och diskutera dess arbetssätt, metodik och resultat jämfört med nuvarande state-of-the-art ramverk och pipelines.

Självuppmärksamhetsvägledning: Förbättring av provkvaliteten på diffusionsmodeller

Denoising Diffusion Models (DDM) har vunnit popularitet för sin förmåga att skapa bilder från brus via en iterativ denoising-process. Bildsyntesförmågan hos dessa modeller beror till stor del på de använda diffusionsvägledningsmetoderna. Trots sina styrkor står diffusionsmodeller och vägledningsbaserade metoder inför utmaningar som ökad komplexitet och ökade beräkningskostnader.

För att övervinna de nuvarande begränsningarna har utvecklare introducerat metoden Self-Attention Guidance, en mer allmän formulering av diffusionsvägledning som inte förlitar sig på extern information från diffusionsvägledning, vilket underlättar ett tillståndsfritt och flexibelt tillvägagångssätt för vägledning. diffusionsramar. Tillvägagångssättet som valts av Self-Attention Guidance hjälper i slutändan till att förbättra användbarheten av de traditionella diffusionsvägledningsmetoderna för fall med eller utan externa krav.

Självuppmärksamhetsvägledning bygger på den enkla principen om generaliserad formulering, och antagandet att intern information som finns i mellanprover också kan fungera som vägledning. På grundval av denna princip introducerar SAG-metoden först Blur Guidance, en enkel och okomplicerad lösning för att förbättra provkvaliteten. Oskärpa vägledning syftar till att utnyttja de godartade egenskaperna hos Gaussisk oskärpa för att ta bort finskaliga detaljer naturligt genom att styra mellanprover med hjälp av den eliminerade informationen som ett resultat av Gaussisk oskärpa. Även om oskärpa vägledningsmetoden ökar provkvaliteten med en måttlig vägledningsskala, lyckas den inte replikera resultaten på en stor vägledningsskala eftersom den ofta introducerar strukturell tvetydighet i hela regioner. Som ett resultat har metoden för oskärpa vägledning det svårt att anpassa den ursprungliga ingången till förutsägelsen av den försämrade ingången. För att förbättra stabiliteten och effektiviteten hos Blur-vägledningsmetoden i en större vägledningsskala, försöker Self-Attention Guidance att utnyttja diffusionsmodellernas självuppmärksamhetsmekanism eftersom moderna diffusionsmodeller redan innehåller en självuppmärksamhetsmekanism inom sin arkitektur.

Med antagandet att självuppmärksamhet är avgörande för att fånga framträdande information i sin kärna, använder Self-Attention Guidance-metoden självuppmärksamhetskartor över diffusionsmodellerna för att på ett motsatt sätt sudda ut regionerna som innehåller framträdande information, och vägleder i processen diffusionsmodeller med erforderlig restinformation. Metoden utnyttjar sedan uppmärksamhetskartorna under diffusionsmodellernas omvända process, för att öka kvaliteten på bilderna och använder självkonditionering för att minska artefakterna utan att kräva ytterligare utbildning eller extern information.

För att sammanfatta det, metoden Self-Attention Guidance

- Är ett nytt tillvägagångssätt som använder interna självuppmärksamhetskartor av diffusionsramar för att förbättra den genererade provbildkvaliteten utan att kräva ytterligare utbildning eller förlita sig på yttre förhållanden.

- SAG-metoden försöker generalisera villkorliga vägledningsmetoder till en tillståndsfri metod som kan integreras med vilken diffusionsmodell som helst utan att kräva ytterligare resurser eller externa villkor, vilket förbättrar användbarheten av vägledningsbaserade ramverk.

- SAG-metoden försöker också visa sina ortogonala förmågor mot befintliga villkorade metoder och ramverk, vilket underlättar en prestandahöjning genom att underlätta flexibel integration med andra metoder och modeller.

Självuppmärksamhetsvägledningsmetoden går vidare och lär sig av resultaten av relaterade ramverk inklusive denoising-diffusionsmodeller, samplingsvägledning, generativa AI-självuppmärksamhetsmetoder och diffusionsmodellers interna representationer. Men i sin kärna implementerar metoden självuppmärksamhetsvägledning lärdomarna från DDPM eller Denoising Diffusion Probabilistic Models, Classifier Guidance, Classifier-free Guidance och Self-Attention i diffusionsramverk. Vi kommer att prata om dem på djupet i det kommande avsnittet.

Självuppmärksamhetsvägledning : Förberedelser, metodik och arkitektur

Denoising Diffusion Probabilistic Model eller DDPM

DDPM eller Denoising Diffusion Probabilistic Model är en modell som använder en iterativ avbrusningsprocess för att återställa en bild från vitt brus. Traditionellt tar en DDPM-modell emot en ingångsbild och ett variansschema vid ett tidssteg för att erhålla bilden med hjälp av en framåtprocess känd som Markovian-processen.

Klassificerare och klassificerarefri vägledning med GAN-implementering

GAN eller Generative Adversarial Networks har unik handelsdiversitet för trohet, och för att föra denna förmåga hos GAN-ramverk till spridningsmodeller, föreslår Self-Attention Guidance-ramverket att använda en klassificerare-vägledningsmetod som använder en extra klassificerare. Omvänt kan en klassificerarefri vägledningsmetod också implementeras utan användning av en extra klassificerare för att uppnå samma resultat. Även om metoden ger de önskade resultaten, är den fortfarande inte beräkningsmässigt genomförbar eftersom den kräver ytterligare etiketter, och begränsar också ramverket till villkorade spridningsmodeller som kräver ytterligare villkor som en text eller en klass tillsammans med ytterligare utbildningsdetaljer som ökar komplexiteten av modellen.

Generaliserande diffusionsvägledning

Även om klassificerare och klassificerare-fria vägledningsmetoder ger önskade resultat och hjälper till med villkorad generering i diffusionsmodeller, är de beroende av ytterligare input. För varje givet tidssteg omfattar indata för en diffusionsmodell ett generaliserat tillstånd och ett stört prov utan det generaliserade tillståndet. Dessutom omfattar det generaliserade tillståndet intern information inom det störda provet eller ett externt tillstånd, eller till och med båda. Den resulterande vägledningen formuleras med användning av en imaginär regressor med antagandet att den kan förutsäga det generaliserade tillståndet.

Förbättra bildkvaliteten med hjälp av självuppmärksamhetskartor

Den allmänna diffusionsvägledningen innebär att det är möjligt att ge vägledning till den omvända processen för diffusionsmodeller genom att extrahera framträdande information i det generaliserade tillståndet i det störda provet. Med utgångspunkt från samma sak, fångar metoden Self-Attention Guidance den framträdande informationen för omvända processer effektivt samtidigt som den begränsar riskerna som uppstår som ett resultat av problem utanför distributionen i förutbildade diffusionsmodeller.

Suddig vägledning

Suddighetsvägledning i självuppmärksamhetsvägledning är baserad på Gaussisk oskärpa, en linjär filtreringsmetod där insignalen konvolveras med ett Gaussiskt filter för att generera en utsignal. Med en ökning av standardavvikelsen reducerar Gaussisk oskärpa detaljerna i finskala i ingångssignalerna, och resulterar i lokalt oskiljbara insignaler genom att utjämna dem mot konstanten. Vidare har experiment indikerat en informationsobalans mellan insignalen och den Gaussiska oskärpa utsignalen där utsignalen innehåller mer finskalig information.

På grundval av denna inlärning introducerar ramverket för självuppmärksamhetsvägledning Blur guidance, en teknik som avsiktligt utesluter informationen från mellanliggande rekonstruktioner under diffusionsprocessen, och istället använder denna information för att vägleda sina förutsägelser mot att öka bildernas relevans för mata in information. Suddig vägledning gör att den ursprungliga förutsägelsen avviker mer från den suddiga ingångsförutsägelsen. Dessutom förhindrar den godartade egenskapen i Gaussisk oskärpa att utsignalerna avviker avsevärt från den ursprungliga signalen med en måttlig avvikelse. I enkla ord uppstår oskärpa naturligt i bilderna, vilket gör den Gaussiska oskärpan till en mer lämplig metod att tillämpa på förtränade diffusionsmodeller.

I Self-Attention Guidance-pipelinen suddas insignalen först ut med ett gaussiskt filter, och den sprids sedan med ytterligare brus för att producera utsignalen. Genom att göra detta mildrar SAG-pipelinen bieffekten av den resulterande oskärpan som minskar Gaussiskt brus och gör att vägledningen förlitar sig på innehåll snarare än att vara beroende av slumpmässigt brus. Även om suddighetsstyrning ger tillfredsställande resultat på ramverk med måttlig vägledningsskala, lyckas den inte replikera resultaten på befintliga modeller med en stor vägledningsskala eftersom den blir benägen att ge brusiga resultat som visas i följande bild.

Dessa resultat kan vara ett resultat av den strukturella oklarheten som introduceras i ramverket av global oskärpa som gör det svårt för SAG-pipelinen att anpassa förutsägelserna för den ursprungliga ingången med den försämrade ingången, vilket resulterar i bullriga utsignaler.

Självuppmärksamhetsmekanism

Som nämnts tidigare har diffusionsmodeller vanligtvis en inbyggd självuppmärksamhetskomponent, och det är en av de mer väsentliga komponenterna i ett diffusionsmodellramverk. Självuppmärksamhetsmekanismen är implementerad i kärnan av diffusionsmodellerna, och den tillåter modellen att uppmärksamma de framträdande delarna av inmatningen under den generativa processen som visas i följande bild med högfrekventa masker i den översta raden, och självuppmärksamhetsmasker i den nedre raden av de slutligen genererade bilderna.

Den föreslagna metoden för självuppmärksamhetsvägledning bygger på samma princip och utnyttjar förmågan hos självuppmärksamhetskartor i diffusionsmodeller. Sammantaget suddar Self-Attention Guidance-metoden de självbetjänade patcharna i insignalen eller i enkla ord döljer informationen om patchar som sköts av diffusionsmodellerna. Dessutom innehåller utsignalerna i Self-Attention Guidance intakta delar av ingångssignalerna, vilket innebär att det inte resulterar i strukturell tvetydighet hos ingångarna, och löser problemet med global oskärpa. Pipelinen erhåller sedan de aggregerade självuppmärksamhetskartorna genom att utföra GAP eller Global Average Pooling för att aggregera självuppmärksamhetskartor till dimensionen, och uppsampling av närmaste granne för att matcha upplösningen på insignalen.

Självuppmärksamhetsvägledning: experiment och resultat

För att utvärdera dess prestanda samplas pipelinen Self-Attention Guidance med hjälp av 8 Nvidia GeForce RTX 3090 GPU: er och är byggd på förtränad IDDPM, ADM och Stabila diffusionsramar.

Ovillkorlig generation med självuppmärksamhetsvägledning

För att mäta effektiviteten av SAG-pipelinen på ovillkorliga modeller och visa den tillståndsfria egenskapen som inte innehas av Classifier Guidance, och Classifier Free Guidance-metoden, körs SAG-pipelinen på villkorslöst förutbildade ramverk på 50 tusen prover.

Som det kan observeras förbättrar implementeringen av SAG-pipelinen FID-, sFID- och IS-måtten för ovillkorlig inmatning samtidigt som återkallningsvärdet sänks. Dessutom är de kvalitativa förbättringarna som ett resultat av implementeringen av SAG-pipeline uppenbara i följande bilder där bilderna på toppen är resultat från ADM- och Stable Diffusion-ramverk medan bilderna längst ner är resultat från ADM- och Stable Diffusion-ramverken med SAG pipeline.

Villkorsgenerering med SAG

Integreringen av SAG-pipeline i befintliga ramverk ger exceptionella resultat i ovillkorlig generering, och SAG-pipelinen är kapabel till tillstånds-agnosticitet som gör att SAG-pipelinen också kan implementeras för villkorlig generering.

Stabil spridning med självuppmärksamhetsvägledning

Även om det ursprungliga Stable Diffusion-ramverket genererar bilder av hög kvalitet, kan en integration av Stable Diffusion-ramverket med Self-Attention Guidance-pipeline förbättra resultaten drastiskt. För att utvärdera dess effekt använder utvecklare tomma meddelanden för stabil spridning med slumpmässigt utsäde för varje bildpar, och använder mänsklig utvärdering på 500 par bilder med och utan självuppmärksamhetsvägledning. Resultaten visas i följande bild.

Dessutom kan implementeringen av SAG förbättra kapaciteten hos ramverket för stabil diffusion, eftersom sammanslagning av klassificerarefri vägledning med självuppmärksamhetsvägledning kan bredda utbudet av stabila diffusionsmodeller till text-till-bild-syntes. Dessutom är de genererade bilderna från den stabila diffusionsmodellen med självuppmärksamhetsvägledning av högre kvalitet med mindre artefakter tack vare den självkonditionerande effekten av SAG-pipelinen som visas i följande bild.

Aktuella begränsningar

Även om implementeringen av pipeline för självuppmärksamhet kan förbättra kvaliteten på de genererade bilderna avsevärt, har den vissa begränsningar.

En av de stora begränsningarna är ortogonaliteten med Classifier-Guidance och Classifier-Free Guidance. Som det kan observeras i följande bild förbättrar implementeringen av SAG FID-poängen och prediktionspoängen, vilket innebär att SAG-pipelinen innehåller en ortogonal komponent som kan användas med traditionella vägledningsmetoder samtidigt.

Det kräver dock fortfarande att diffusionsmodeller tränas på ett specifikt sätt som ökar komplexiteten såväl som beräkningskostnaderna.

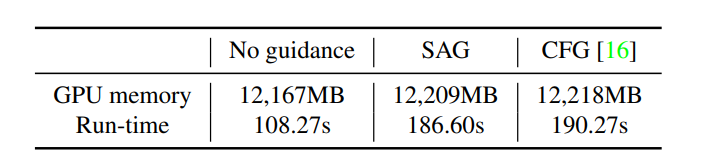

Dessutom ökar inte implementeringen av Self-Attention Guidance minnet eller tidsåtgången, en indikation på att omkostnaderna till följd av operationer som maskering och oskärpa i SAG är försumbar. Det ökar dock fortfarande beräkningskostnaderna eftersom det inkluderar ett extra steg jämfört med metoder utan vägledning.

Avslutande tankar

I den här artikeln har vi pratat om Self-Attention Guidance, en ny och generell formulering av vägledningsmetod som använder sig av intern information tillgänglig inom diffusionsmodellerna för att generera bilder av hög kvalitet. Självuppmärksamhetsvägledning bygger på den enkla principen om generaliserad formulering, och antagandet att intern information som finns i mellanprover också kan fungera som vägledning. Self-Attention Guidance pipeline är ett tillståndsfritt och träningsfritt tillvägagångssätt som kan implementeras över olika diffusionsmodeller, och använder självkonditionering för att minska artefakterna i de genererade bilderna och höjer den övergripande kvaliteten.