Artificiell intelligens

Multimodalt AI utvecklas när ChatGPT får syn med GPT-4V(ision)

I den pågående ansträngningen att göra AI mer lik människor har OpenAI:s GPT-modeller kontinuerligt pressat gränserna. GPT-4 kan nu acceptera prompt av både text och bilder.

Multimodalitet i generativ AI betecknar en modells förmåga att producera varierade utdata som text, bilder eller ljud baserat på indata. Dessa modeller, tränade på specifik data, lär sig underliggande mönster för att generera liknande ny data, vilket berikar AI-applikationer.

Senaste framstegen inom multimodalt AI

En nylig anmärkningsvärd språng i detta område ses med integrationen av DALL-E 3 i ChatGPT, en betydande uppgradering av OpenAI:s text-till-bild-teknik. Denna blandning möjliggör en smidigare interaktion där ChatGPT hjälper till att skapa exakta prompt för DALL-E 3, vilket omvandlar användaridéer till livfull AI-genererad konst. Så, medan användare kan interageraekt med DALL-E 3, gör ChatGPT-processen att skapa AI-konst mycket mer användarvänlig.

Läs mer om DALL-E 3 och dess integration med ChatGPT här. Detta samarbete visar inte bara framstegen inom multimodalt AI, utan gör också AI-konstskapande till en barnlek för användare.

Google’s health på andra sidan introducerade Med-PaLM M i juni i år. Det är en multimodalt generativ modell som är skicklig på att koda och tolka olika biomedicinska data. Detta uppnåddes genom att finjustera PaLM-E, en språkmodell, för att anpassa sig till medicinska domäner med hjälp av en öppen källkod, MultiMedBench. Denna benchmark består av över 1 miljon prover över 7 biomedicinska datatyper och 14 uppgifter som medicinska frågesvar och generering av radiologirapporter.

Olika branscher antar innovativa multimodala AI-verktyg för att driva affärsutveckling, strömlinjeforma verksamheten och höja kundengagemanget. Framsteg inom röst-, video- och text-AI-förmågor driver multimodalt AI:s tillväxt.

Företag söker efter multimodala AI-applikationer som kan omvandla affärsmodeller och processer, öppna tillväxtvägar över hela den generativa AI-ekosystemet, från dataverktyg till nya AI-applikationer.

Efter GPT-4:s lansering i mars observerade vissa användare en nedgång i dess svars kvalitet över tid, en oro som ekades av noterade utvecklare och på OpenAI:s forum. Initialt avfärdades det av OpenAI, men en senare studie bekräftade problemet. Den avslöjade en minskning av GPT-4:s noggrannhet från 97,6% till 2,4% mellan mars och juni, vilket indikerar en nedgång i svarkvalitet med efterföljande modelluppdateringar.

Hajpen kring Open AI:s ChatGPT är tillbaka nu. Den kommer nu med en visionsfunktion GPT-4V, som tillåter användare att låta GPT-4 analysera bilder som de tillhandahåller. Detta är den senaste funktionen som har öppnats upp för användare.

Att lägga till bildanalys till stora språkmodeller (LLM) som GPT-4 ses av vissa som ett stort steg framåt i AI-forskning och utveckling. Denna typ av multimodalt LLM öppnar upp nya möjligheter, tar språkmodeller bortom text för att erbjuda nya gränssnitt och lösa nya typer av uppgifter, skapar färska upplevelser för användare.

Träningen av GPT-4V slutfördes 2022, med tidig tillgång som rullades ut i mars 2023. Den visuella funktionen i GPT-4V drivs av GPT-4-teknik. Träningsprocessen förblev densamma. Initialt tränades modellen för att förutsäga nästa ord i en text med hjälp av en massiv dataset av både text och bilder från olika källor, inklusive internet.

Sedan finjusterades den med mer data, med hjälp av en metod som kallas förstärkt inlärning från mänsklig feedback (RLHF), för att generera utdata som människor föredrog.

GPT-4 Vision Mechanics

GPT-4:s remarkabla visionspråksförmåga, även om den är imponerande, har underliggande metoder som förblir på ytan.

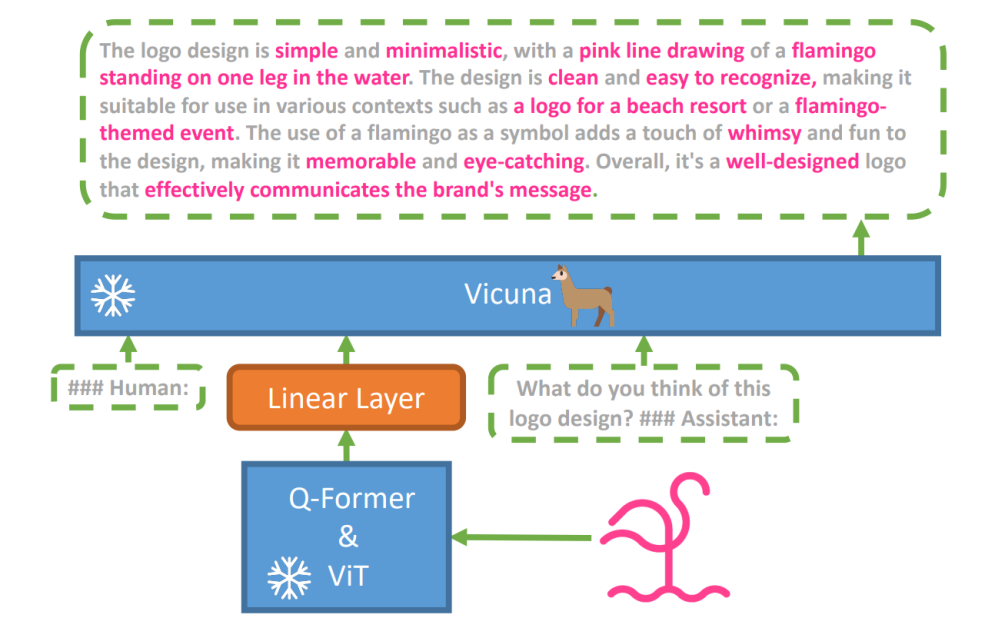

För att utforska denna hypotes introducerades en ny visions-språksmodell, MiniGPT-4, som använder en avancerad LLM som kallas Vicuna. Denna modell använder en visionskodare med förtränade komponenter för visuell perception, som justerar visuella funktioner med Vicuna-språkmodellen genom ett enda projiceringsskikt. Arkitekturen för MiniGPT-4 är enkel men effektiv, med fokus på att justera visuella och språkliga funktioner för att förbättra visuell konversationsförmåga.

MiniGPT-4:s arkitektur innehåller en visionskodare med förtränad ViT och Q-Former, ett enda linjärt projiceringsskikt och en avancerad Vicuna-stor språkmodell.

Trenden med autoregressiva språkmodeller i visions-språksuppgifter har också vuxit, kapitaliserar på cross-modalt överföring för att dela kunskap mellan språk och multimodala domäner.

MiniGPT-4 brottar visuella och språkliga domäner genom att justera visuell information från en förtränad visionskodare med en avancerad LLM. Modellen använder Vicuna som språkavkodare och följer en tvåstegsträningsansats. Initialt tränas den på en stor dataset av bild-textpar för att förvärva visions-språkkunskap, följt av finjustering på en mindre, högkvalitativ dataset för att förbättra generations tillförlitlighet och användbarhet.

För att förbättra den naturliga och användarvänliga genererade språket i MiniGPT-4 utvecklade forskare en tvåstegsjusteringsprocess, som hanterar bristen på tillräckliga visions-språksjusteringsdataset. De kuraterade ett specialiserat dataset för detta ändamål.

Initialt genererade modellen detaljerade beskrivningar av ingångsbilder, förbättrade detaljerna genom att använda en konversationsprompt justerad med Vicuna-språkmodellens format. Detta skede syftade till att generera mer omfattande bildbeskrivningar.