Tankeledare

Avkodning av möjligheter och utmaningar för LLM-agenter i generativ AI

Vi ser en utveckling av generativa AI-applikationer som drivs av stora språkmodeller (LLM) från prompter till retrieval-augmenterad generering (RAG) till agenter. Agenter diskuteras flitigt i branschen och forskningskretsar, främst för den kraft som denna teknik ger för att transformera företagsapplikationer och ge överlägsna kundupplevelser. Det finns vanliga mönster för att bygga agenter som möjliggör de första stegen mot artificiell allmän intelligens (AGI).

I min förra artikel, såg vi en steg-för-steg-intelligens för mönster för att bygga LLM-aktiverade applikationer. Början med prompter som fångar problemområdet och använder LLM:s interna minne för att generera utdata. Med RAG, förstärker vi prompten med extern kunskap som söks från en vektordatabas för att kontrollera utdata. Nästa steg är att bygga arbetsflöden genom att kedja LLM-samtal för att förverkliga komplexa applikationer. Agenter tar detta till en ny nivå genom att automatiskt bestämma hur dessa LLM-kedjor ska bildas. Låt oss titta närmare.

Agenter – Under huven

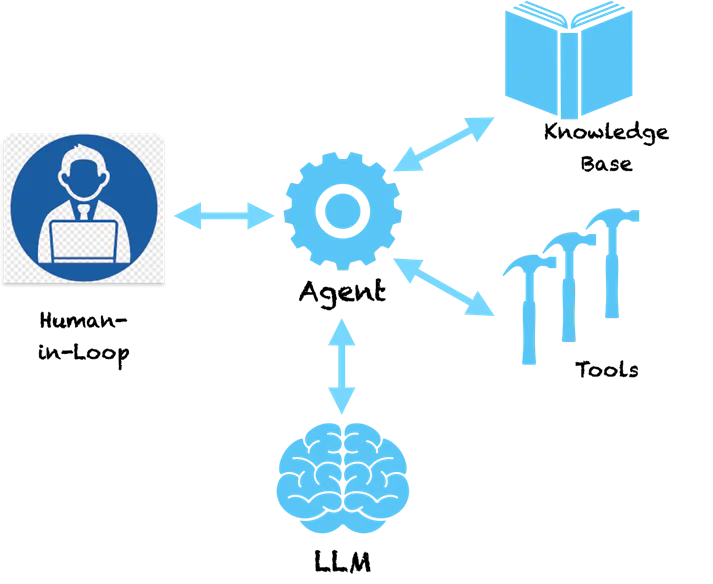

Ett viktigt mönster med agenter är att de använder språkförståelsen hos LLM för att skapa en plan för att lösa ett givet problem. LLM förstår problemet och ger oss en sekvens av steg för att lösa problemet. Men det slutar inte där. Agenter är inte ett rent stödsystem som kommer att ge dig rekommendationer för att lösa problemet och sedan lämna över stafettpinnen till dig för att vidta de rekommenderade stegen. Agenter är utrustade med verktyg för att gå vidare och vidta åtgärder. Låter det farligt!?

Om vi ställer en agent en grundläggande fråga som denna:

Människa: Vilket företag startade uppfinnaren av telefonen?

Följande är ett exempel på tanke-steg som en agent kan ta.

Agent (TÄNKANDE):

- Tanke: Jag behöver söka efter uppfinnaren av telefonen.

- Åtgärd: Sök [uppfinnare av telefon]

- Observation: Alexander Graham Bell

- Tanke: Jag behöver söka efter ett företag som grundades av Alexander Graham Bell

- Åtgärd: Sök [företag grundat av Alexander Graham Bell]

- Observation: Alexander Graham Bell co-grundade American Telephone and Telegraph Company (AT&T) 1885

- Tanke: Jag har funnit svaret. Jag kommer att returnera.

Agent (SVAR): Alexander Graham Bell co-grundade AT&T 1885

Du kan se att agenten följer en metodisk väg för att bryta ner problemet i underproblem som kan lösas genom att vidta specifika åtgärder. Åtgärderna här rekommenderas av LLM och vi kan mappa dessa till specifika verktyg för att implementera dessa åtgärder. Vi kunde aktivera ett sökverktyg för agenten så att när den inser att LLM har tillhandahållit sökning som en åtgärd, kommer den att anropa detta verktyg med parametrarna som tillhandahålls av LLM. Sökningen här är på internet men kan också omdirigeras till en intern kunskapsbas som en vektordatabas. Systemet blir nu självförsörjande och kan lista ut hur man löser komplexa problem genom att följa en serie steg. Ramverk som LangChain och LLaMAIndex ger dig ett enkelt sätt att bygga dessa agenter och ansluta till verktyg och API. Amazon lanserade nyligen sin Bedrock Agents-ramverk som tillhandahåller ett visuellt gränssnitt för att designa agenter.

Under huven följer agenter en speciell stil för att skicka prompter till LLM som gör dem generera en åtgärdsplan. Ovanstående tanke-åtgärd-observation-mönster är populärt i en typ av agent som kallas ReAct (Reasoning and Acting). Andra typer av agenter inkluderar MRKL och Plan & Execute, som främst skiljer sig i sin prompt-stil.

För mer komplexa agenter kan åtgärderna vara kopplade till verktyg som orsakar förändringar i källsystem. Till exempel kunde vi ansluta agenten till ett verktyg som kontrollerar semesterbalans och ansöker om ledighet i ett ERP-system för en anställd. Nu kunde vi bygga en trevlig chatbot som skulle interagera med användare och via en chat-kommando ansöka om ledighet i systemet. Inga fler komplexa skärmar för att ansöka om ledighet, ett enkelt enhetligt chatsystem. Låter det spännande!?

Varningar och behov av Ansvarsfull AI

Vad händer om vi har ett verktyg som utlöser transaktioner på aktiehandel med en förauktoriserad API. Du bygger en applikation där agenten studerar aktieförändringar (med verktyg) och fattar beslut om köp och försäljning av aktier. Vad om agenten säljer fel aktie för att den hallucinerade och fattade ett felaktigt beslut? Eftersom LLM är enorma modeller, är det svårt att peka ut varför de fattar vissa beslut, och hallucinationer är vanliga i avsaknad av lämpliga skydd.

Medan agenter är allt fascinerande, har du förmodligen gissat hur farliga de kan vara. Om de hallucinerar och tar en felaktig åtgärd som kunde orsaka stora ekonomiska förluster eller stora problem i företagssystem. Därför blir Ansvarsfull AI allt viktigare i tidsåldern av LLM-aktiverade applikationer. Principerna för Ansvarsfull AI kring reproducerbarhet, transparens och ansvar, försöker sätta skydd på beslut som fattas av agenter och föreslår riskanalys för att bestämma vilka åtgärder som behöver en mänsklig loop. När mer komplexa agenter designas, behöver de mer granskning, transparens och ansvar för att säkerställa att vi vet vad de gör.

Avslutande tankar

Förmågan hos agenter att generera en väg av logiska steg med åtgärder får dem att komma riktigt nära mänskligt resonemang. Att ge dem mer kraftfulla verktyg kan ge dem superkrafter. Mönster som ReAct försöker efterlikna hur människor löser problem, och vi kommer att se bättre agentmönster som kommer att vara relevanta för specifika sammanhang och domäner (bank, försäkring, hälsovård, industri, etc.). Framtiden är här, och tekniken bakom agenter är redo för oss att använda. Samtidigt måste vi hålla ett nära öga på Ansvarsfull AI-skydd för att säkerställa att vi inte bygger Skynet!