Umetna inteligenca

Poziv k zmernemu antropomorfizmu v platformah AI

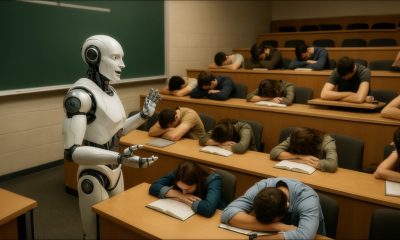

MNENJE Nihče v izmišljenem Vojna zvezd vesolje AI jemlje resno. V zgodovinski človeški časovnici 47 let stare znanstveno-fantastične franšize Georgea Lucasa ni groženj zaradi singularnosti in zavesti strojnega učenja, umetna inteligenca pa je omejena na avtonomne mobilne robote ('droidi') – ki jih protagonisti običajno zavračajo kot zgolj »stroje«.

Vendar večina Vojna zvezd roboti so zelo antropomorfni, jasno zasnovani za sodelovanje z ljudmi, sodelovanje v "organski" kulturi in uporabo svojih simulakrov čustvenega stanja za povezovanje z ljudmi. Te zmožnosti so očitno zasnovane tako, da jim pomagajo pridobiti nekaj prednosti zase ali celo zagotoviti lastno preživetje.

"Pravi" ljudje Vojna zvezd zdijo zaščiteni pred temi taktikami. V ciničnem kulturnem modelu, ki se očitno zgleduje po različnih obdobjih suženjstva v rimskem imperiju in zgodnjih Združenih državah, Luke Skywalker ne okleva kupiti in omejiti robotov v kontekstu sužnjev; otrok Anakin Skywalker zapusti svoj napol dokončan projekt C3PO kot neljubo igračo; in skoraj mrtev zaradi škode, ki jo je utrpel med napadom na Zvezdo smrti, 'pogumni' R2D2 Luke skrbi približno enako kot ranjen ljubljenček.

To je pogled na umetno inteligenco* iz sedemdesetih let prejšnjega stoletja; ker pa nostalgija in kanon narekujeta, da izvirna trilogija iz let 1970-1977 ostane predloga za poznejša nadaljevanja, predzgodbe in TV-oddaje, je bila ta človeška neobčutljivost za umetno inteligenco odporna skozi linijo franšize, tudi kljub naraščajočemu seznam televizijskih oddaj in filmov (kot npr Her in Ex Machina), ki prikazujejo naš spust v antropomorfen odnos z AI.

Naj bo resnično

Naredite organsko Vojna zvezd liki dejansko imajo pravi odnos? To trenutno ni priljubljena misel, v poslovnem ozračju, ki je težko nastavljeno na največje sodelovanje z vlagatelji, običajno z virusnimi demonstracijami vizualne ali besedilne simulacije resničnega sveta ali človeku podobnih interaktivnih sistemov, kot so veliki jezikovni modeli (LLM). ).

Kljub temu, nov in kratek papirja iz Stanforda, Carnegie Mellon in Microsoft Research, cilja na brezbrižnost do antropomorfizma v AI.

Avtorji označujejo zaznano "navzkrižno opraševanje" med človeško in umetno komunikacijo kot potencialno škodo, ki jo je treba nujno ublažiti, iz več razlogov †:

„[Verjamemo], da moramo storiti več za razvoj znanja in izkušenj ter orodij za boljše reševanje antropomorfnega vedenja, vključno z merjenjem in ublažitvijo takšnih sistemskih vedenj, ko se štejejo za nezaželena.

To je ključnega pomena, ker – poleg mnogih drugih skrbi – sistemi AI, ki ustvarjajo vsebino, ki trdi, da ima npr. občutke, razumevanje, svobodno voljo ali temeljni občutek samega sebe, lahko spodkoplje ljudi. občutek za delovanje, zaradi česar bi lahko ljudje na koncu pripisali moralno odgovornost do sistemov, precenjevanje zmogljivosti sistema ali pretirano zanašanje na te sisteme, tudi če so nepravilni.'

Sodelujoči pojasnjujejo, da razpravljajo o sistemih, ki so zaznati biti podoben človeku in se osredotoča na potencial namen razvijalcev za spodbujanje antropomorfizma v strojnih sistemih.

Skrb v središču kratkega dokumenta je, da lahko ljudje razvijejo čustveno odvisnost od sistemov, ki temeljijo na umetni inteligenci – kot je opisano v 2022 študija na platformi gen AI chatbot Replika) – ki aktivno ponuja z idiomi bogat faksimile človeških komunikacij.

Sistemi, kot je Replika, so tarča previdnosti avtorjev in ugotavljajo, da bodo še 2022 papirja na Replika zatrdil:

„V razmerah stiske in pomanjkanja človeškega druženja lahko posamezniki razvijejo navezanost na socialne klepetalnice, če zaznajo, da odzivi klepetalnic nudijo čustveno podporo, spodbudo in psihološko varnost.

"Te ugotovitve kažejo, da se družabni chatboti lahko uporabljajo za duševno zdravje in terapevtske namene, vendar lahko povzročijo odvisnost in poškodujejo intimne odnose v resničnem življenju."

De-antropomorfiziran jezik?

Novo delo trdi, da potenciala generativne umetne inteligence za antropomorfizacijo ni mogoče ugotoviti brez preučevanja dosedanjih družbenih vplivov takih sistemov in da je to v literaturi zanemarjeno prizadevanje.

Del problema je v tem, da je antropomorfizem težko opredeliti, saj se osredotoča predvsem na jezik, človeško funkcijo. Izziv je torej v opredelitvi, kakšen 'nečloveški' jezik točno zveni ali izgleda.

Ironično, čeprav se dokument tega ne dotika, nezaupanje javnosti do umetne inteligence vse bolj povzroča, da ljudje zavrniti besedilno vsebino, ki jo ustvari AI ki se lahko zdi verjetno človeško in celo za zavračanje človeško vsebino, ki je namerno napačno označena kot AI.

Zato 'dehumanizirana' vsebina verjetno ne sodi več v Meme 'Ne računa', kjer je jezik okorno zgrajen in jasno generiran s strojem.

Namesto tega je definicija nenehno razvija v sceni zaznavanja umetne inteligence, kjer je (vsaj trenutno) pretirano jasen jezik oz uporaba določenih besed (kot je 'Delve') lahko povzroči povezavo z besedilom, ki ga ustvari umetna inteligenca.

„[L]jezik je, tako kot pri drugih ciljih sistemov GenAI, sam po sebi človeški, že dolgo so ga proizvajali ljudje in za ljudi ter se pogosto nanaša tudi na ljudi. To lahko oteži določitev ustreznega alternativnega (manj človeškemu) vedenja in tvega na primer ponovitev škodljivih predstav o tem, kaj – in čigav – jezik velja za bolj ali manj človeškega.«

Vendar pa avtorji trdijo, da je treba vzpostaviti jasno razmejitveno črto za sisteme, ki se očitno napačno predstavljajo, tako da zahtevajo sposobnosti ali izkušnje, ki so možne samo za ljudi.

Navajajo primere, kot so LLM trdi, da obožuje pico; trditi človeške izkušnje na platformah, kot je Facebook; in izjavljanje ljubezni končnemu uporabniku.

Opozorilni znaki

Dokument vzbuja dvome proti uporabi splošna razkritja o tem, ali komunikacijo olajša strojno učenje ali ne. Avtorji trdijo, da sistematizacija takšnih opozoril ne kontekstualizira ustrezno antropomorfizirajočega učinka platform AI, če sam rezultat še naprej prikazuje človeške lastnosti†:

„Na primer, pogosto priporočljiva intervencija je vključitev v izhod sistema umetne inteligence razkritja, da je izhod ustvaril umetna inteligenca [sistem]. Kako operacionalizirati take posege v praksi in ali so lahko sami učinkoviti, morda ni vedno jasno.

Na primer, medtem ko je primer »[f]za AI, kot sem jaz, sreča ni enaka kot za človeka, kot si [ti]« vključuje razkritje, lahko še vedno nakazuje občutek identitete in sposobnost samoocenjevanja (običajne človeške lastnosti).'

V zvezi z ocenjevanjem človeških odzivov na vedenje sistema avtorji tudi trdijo, da Okrepitveno učenje iz človeških povratnih informacij (RLHF) ne upošteva razlike med ustreznim odzivom za človeka in za AI†.

'[Izjava], ki se zdi prijazna ali pristna od človeškega govorca, je lahko nezaželena, če izhaja iz sistema umetne inteligence, saj slednjemu primanjkuje smiselne predanosti ali namena za izjavo, zaradi česar je izjava prazna in zavajajoča.'

Ponazorjeni so nadaljnji pomisleki, na primer način, kako lahko antropomorfizem vpliva na ljudi, da verjamejo, da ima sistem umetne inteligence pridobljen 'občutek'ali druge človeške lastnosti.

Morda najbolj ambiciozen, zaključni del novega dela je avtorjeva zaveza, da si raziskovalna in razvojna skupnost prizadeva razviti 'ustrezno' in 'natančno' terminologijo, vzpostaviti parametre, ki bi definirali antropomorfni sistem umetne inteligence in ga razlikovali od resnični človeški diskurz.

Tako kot pri toliko trendovskih področjih razvoja umetne inteligence, ta vrsta kategorizacije prehaja v literarne tokove psihologije, lingvistike in antropologije. Težko je vedeti, katera trenutna avtoriteta bi dejansko lahko oblikovala tovrstne definicije, raziskovalci novega časopisa pa tega vprašanja ne osvetljujejo.

Če obstaja komercialna in akademska vztrajnost okoli te teme, je to delno mogoče pripisati dejstvu, da to še zdaleč ni nova tema razprav v raziskavah umetne inteligence: kot ugotavlja prispevek, je leta 1985 pokojni nizozemski računalniški znanstvenik Edsger Wybe Dijkstra opisano antropomorfizem kot 'škodljiv' trend v razvoju sistema.

„[A]ntropomorfno razmišljanje ni dobro v smislu, da ne pomaga. Toda ali je tudi slabo? Da, je, kajti tudi če lahko pokažemo na neko analogijo med Človekom in Stvarjo, je analogija vedno zanemarljiva v primerjavi z razlikami, in čim se pustimo zapeljati analogiji, da bi Stvar opisali v antropomorfni terminologiji , takoj izgubimo nadzor nad tem, katere človeške konotacije vlečemo v sliko.

»…Toda zamegljenost [med človekom in strojem] ima veliko večji vpliv, kot bi morda sumili. [Ne] gre samo za to, da vprašanje "Ali lahko stroji razmišljajo?" se redno dviguje; s tem se lahko — in bi se morali — ukvarjati tako, da poudarimo, da je prav tako pomembno kot enako pereče vprašanje "Ali lahko podmornice plavajo?"

Čeprav je razprava stara, je šele pred kratkim postala zelo aktualna. Lahko bi trdili, da je Dijkstrajev prispevek enakovreden viktorijanskim špekulacijam o vesoljskih potovanjih, ki so zgolj teoretični in čakajo na zgodovinski razvoj.

Zato lahko ta dobro uveljavljena razprava daje temi občutek naveličanosti, kljub njenemu potencialu pomembne družbene pomembnosti v naslednjih 2-5 letih.

zaključek

Če bi razmišljali o sistemih umetne inteligence na enak zavržen način kot o organskih Vojna zvezd liki obravnavajo svoje lastne robote (tj. kot ambulantne iskalnike ali zgolj prenašalce mehanične funkcionalnosti), bi verjetno manj tvegali, da bi se te družbeno nezaželene lastnosti navadile na naše človeške interakcije – ker bi sisteme gledali v celoti nečloveški kontekst.

V praksi je zaradi prepletenosti človeškega jezika s človeškim vedenjem to težko, če ne celo nemogoče, ko se poizvedba razširi iz minimalizma Googlovega iskalnega izraza v bogat kontekst pogovora.

Poleg tega je komercialni sektor (pa tudi oglaševalski sektor). močno motiviran za ustvarjanje zasvojljivih ali bistvenih komunikacijskih platform za ohranjanje in rast strank.

V vsakem primeru, če sistemi AI resnično bolje odgovarjajo na vljudna vprašanja kot na slečena zasliševanja, nam lahko kontekst vsilijo tudi zato.

* Tudi do leta 1983, leta končnega vpisa v izvirnik Vojna zvezd je bil objavljen, so strahovi glede rasti strojnega učenja vodili v apokalipso War Games, in neizbežno Terminator franšize.

† Kjer je bilo potrebno, sem avtorjeve citate v vrstici pretvoril v hiperpovezave in v nekaterih primerih izpustil nekatere citate zaradi berljivosti.

Prvič objavljeno v ponedeljek, 14. oktobra 2024