Угол Андерсона

Удаление объектов и людей с видео с помощью ИИ.

Нет, ребёнок не останется в кадре, если к этому причастен искусственный интеллект.

Удаление людей и объектов с изображений и видео — популярное направление исследований в литературе по искусственному интеллекту, ориентированной на визуальные эффекты, и всё большее число специализированных наборов данных и фреймворков решают эту задачу. Последний из них, разработанный Институтом больших данных Фуданьского университета в Китае, — это... EffectErase, система удаления видеообъектов с учетом эффектов, которая, по мнению авторов, значительно превосходит существующие аналоги в ходе тестирования:

Примеры использования метода EffectErase собраны из материалов веб-сайта проекта (обратите внимание, что, хотя мы предоставляем ссылку, исходный сайт содержит так много видеороликов высокого разрешения и неоптимизированных видеороликов с автовоспроизведением, что это может повлиять на стабильность вашего веб-браузера. Сопутствующее видео на YouTube является более простым и полным справочным материалом и встроено в конце этой статьи). Источник

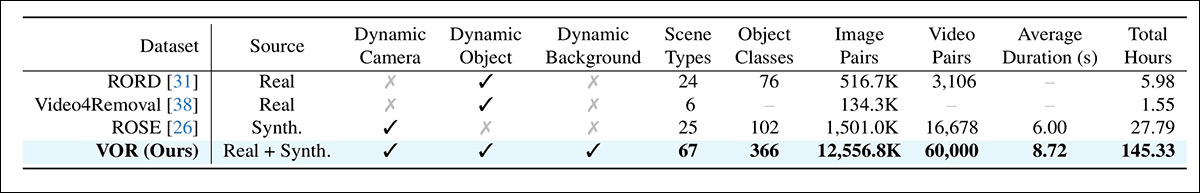

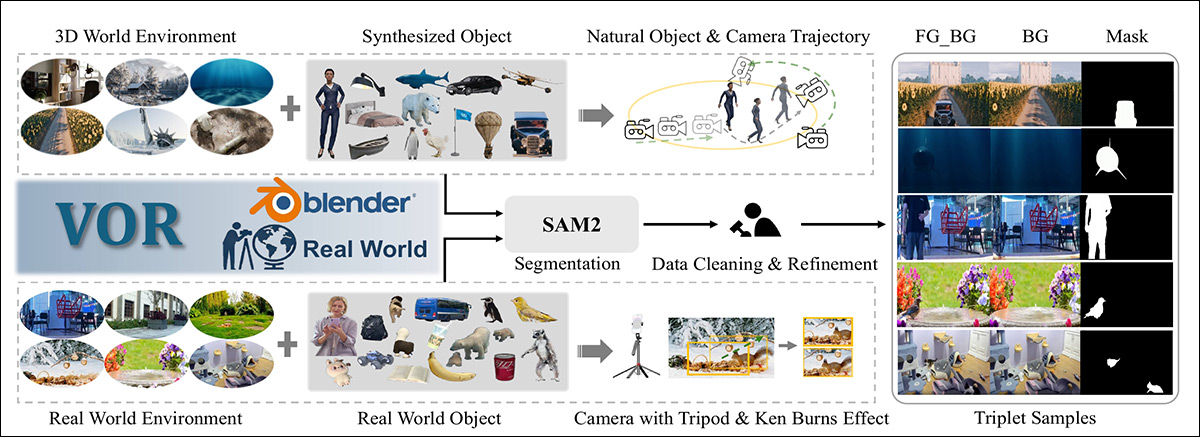

Новая работа включала создание/подбор полуноваторского набора данных, состоящего почти из 350 оригинальных реальных и синтезированных сцен (с использованием общедоступных репозиториев*), либо полученных с помощью специализированного оборудования, либо отобранных и переработанных для рабочего процесса, построенного на основе открытого 3D-фреймворка Blender.

Гибридный набор данных Video Object Removal (VOR) лежит в основе... EffectErase само приложение, которое построено на основе Wan2.1 Система генерации видео. Система также определяет два новых связанных эталонных показателя: Оценка VOR и VOR Wild – соответственно, для образцов с и без основа истины.

(Хотя в статье есть сопутствующий проектный сайтСайт перегружен множеством видеороликов высокого разрешения и загружается с трудом; поэтому, если вам сложно пользоваться сайтом проекта, пожалуйста, обратитесь к отрывкам, которые я собрал во встроенном видео выше.

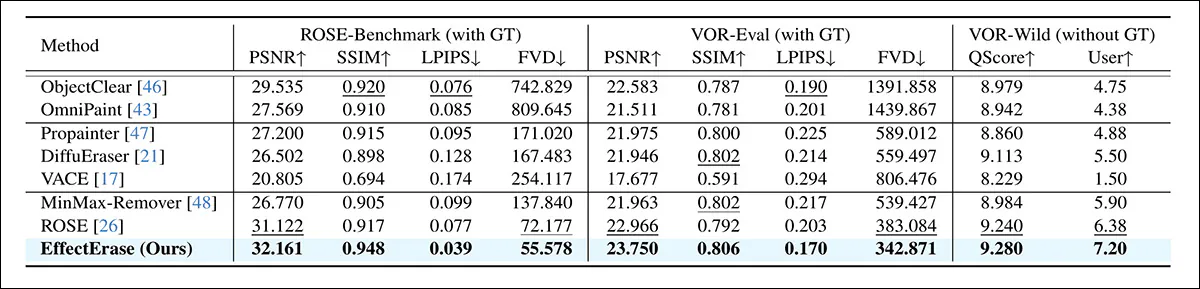

Сравнение количественных показателей по сопоставимым предыдущим наборам данных с учетом нового предложения. Источник

Исследователи утверждают, что их подход обеспечивает самые современные результаты как по количественным показателям, так и по качественным результатам, подтвержденным в ходе исследования с участием людей.

Они отмечают, что в предыдущих работах не всегда удавалось устранить дополнительные эффекты объекта, такие как тени и отражения, и что их набор данных был тщательно разработан для исправления этого недостатка:

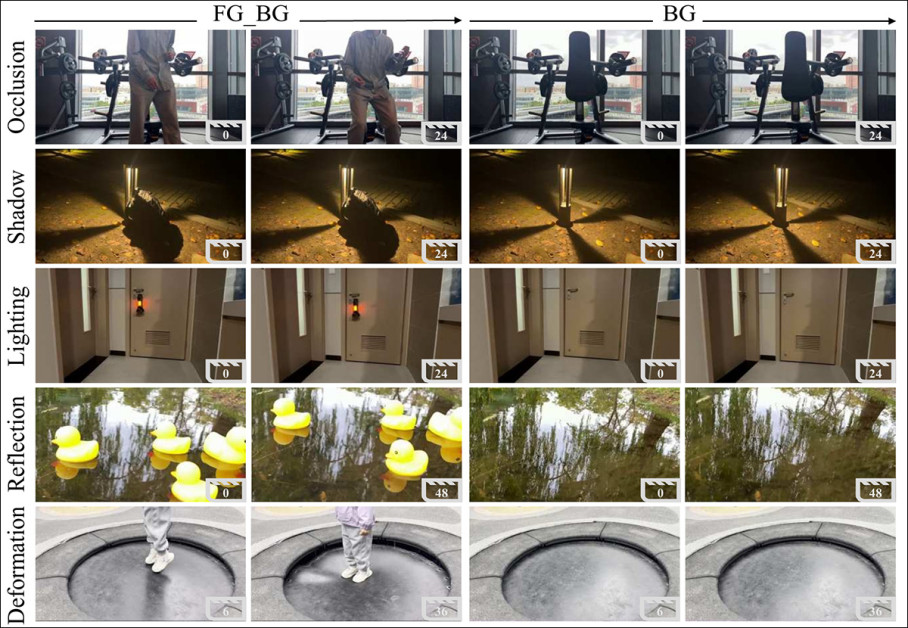

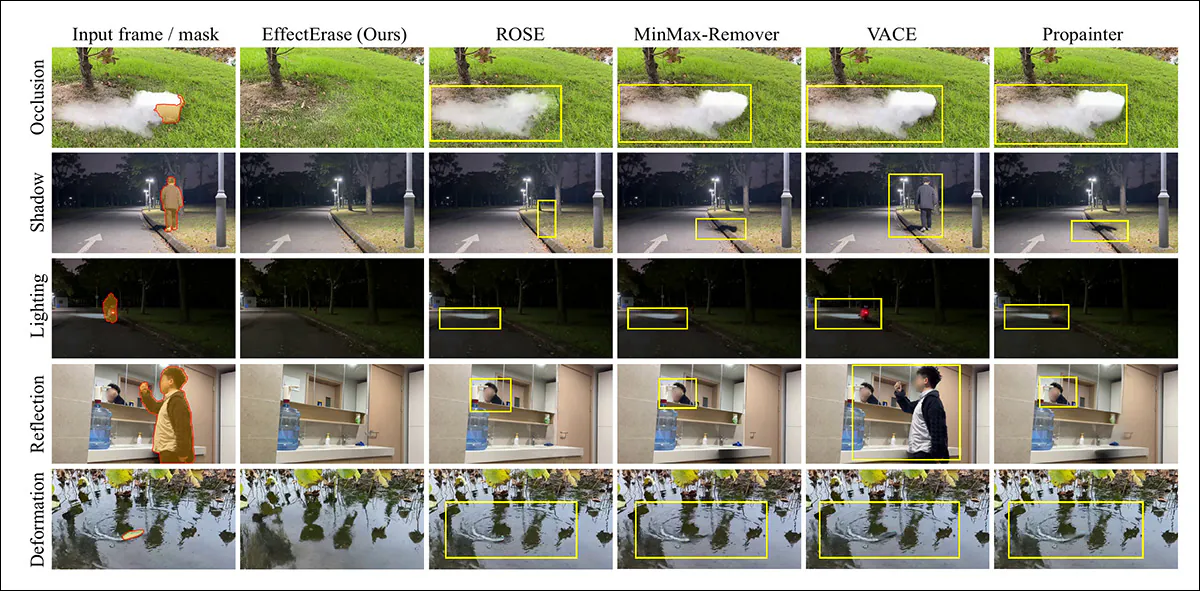

Примеры того, как предыдущие подходы не учитывали не только объект, который необходимо удалить, но и второстепенные признаки, такие как отражения и тени.

Новый документ называется EffectErase: Совместное удаление и вставка видеообъектов для высококачественного удаления эффектов.Эта работа подготовлена четырьмя исследователями из Колледжа компьютерных наук и искусственного интеллекта Фуданского университета.

Способ доставки

Гибридный набор данных VOR был разработан таким образом, чтобы охватить достаточно широкий спектр сценариев и рассмотреть все последствия попытки удалить человека или объект из видео:

Парные кадры из набора данных VOR иллюстрируют, как удаление объекта должно выходить за рамки видимого объекта и затрагивать его эффекты. Примеры показывают окклюзию, тени, изменения освещения, отражения и физическую деформацию, каждая из которых представлена как входные данные (наличие объекта) наряду с соответствующим чистым фоном после удаления. Дополнительные примеры см. в видеоролике на YouTube, встроенном в конце этой статьи.

Авторы определяют пять основных типов «помех», которые необходимо устранить, следующим образом: окклюзия, включая различные виды окклюзии стеклом и дымом; тени; освещение (например, когда удаляемый объект создает или изменяет путь света); отражениеи деформация (например, отпечаток пользователя на подушке, который не должен сохраниться после того, как человек его убрал).

Конвейер построения набора данных для VOR, объединяющий синтетические сцены, созданные в Blender, с реальными видеозаписями, где синтетические данные формируются из тщательно подобранных 3D-сред, объектов и траекторий камеры, а также реальных видеоматериалов, записанных в различных сценах и дополненных анимацией Кена Бернса. Затем сегментация SAM2 и ручная доработка позволяют получить выровненные видеотриплеты переднего и заднего плана с соответствующими масками.

Для получения исходных данных из реальных условий исследователи использовали стационарные камеры для записи сцен «с» и «без» объектов, охватывающих широкий спектр условий окружающей среды, времени суток и погодных условий.

Для синтезированных данных были созданы сценарии с несколькими ракурсами и несколькими объектами, включающие намеренно сложные и непредсказуемые типы движения камеры, подобные тем, которые могут встречаться в реальных видеоматериалах; исследователи отмечают, что этот подход более сложен и трудоемок, чем тот, который использовался для аналогичных задач. Удаление объектов с побочными эффектами из видео (ROSE) набор данных.

Для увеличения разнообразия движений, Эффект Кена Бернса Этот метод был применен к парам кадров, снятых камерой, с добавлением контролируемых панорамирований, масштабирования и небольших движений с рук в соответствии с четырнадцатью предопределенными правилами, при этом для каждой пары было выбрано пять вариантов движения, а кадрирование оставалось в пределах исходного кадра.

Масштаб и разнообразие были дополнительно расширены за счет объединения синтетических объектов с несколькими конфигурациями камер. Маски были сгенерированы путем размещения вручную заданных точек на ключевых кадрах, а сегментация распространялась с помощью Сегмент всего 2 (SAM2), очистка и уточнение результатов, а также сборка проверенных триплетов переднего плана, фона и маски для обучения.

Итоговая коллекция насчитывает 145 часов видеоматериала, состоящего из 60 000 парных видеороликов, как реальных, так и синтетических, охватывающих 366 классов объектов в 443 сценах.

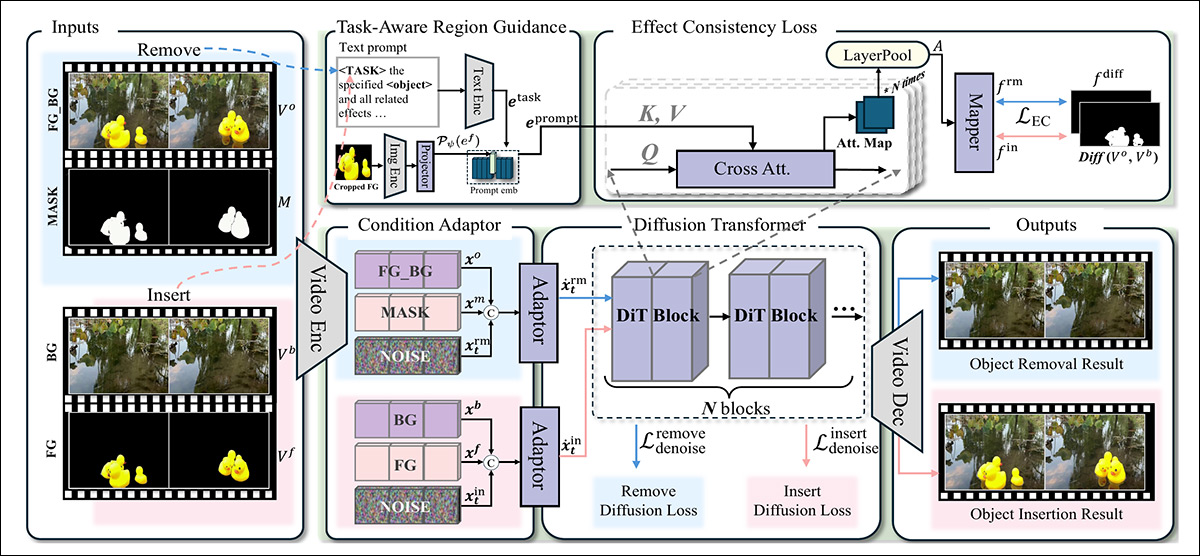

Сеть EffectErase сама обрабатывает материал с помощью вариационного автокодировщика (VAE†), при этом скрытое шумоподавление обрабатывается Wan2.1. По этой магистрали работает EffectErase. Совместное обучение извлечению и введению, который позволяет одновременно обучать обе задачи на одних и тех же участках; Региональное наведение с учетом поставленных задач (TARG), который использует токены объектов и задач с перекрестное внимание моделировать пространственно-временные связи между объектами и их воздействием, а также обеспечивать возможность переключения между задачами; и Потеря согласованности эффекта, которая выравнивает области воздействия, соответствующие задачам удаления и вставки:

Схема для фреймворка EffectErase. Во время обучения парные видео кодируются в общее латентное пространство, объединяются с шумом и обрабатываются диффузионным трансформером, управляемым перекрестным вниманием с учетом задачи, в то время как функция потерь согласованности эффектов выравнивает области удаления и вставки таким образом, чтобы обе задачи были сосредоточены на одной и той же области.

Процессы удаления и вставки сами по себе обучаются совместно, используя общую диффузионную архитектуру, поэтому модель учится фокусироваться на одних и тех же затронутых областях и структурных признаках.

Видео с объектами, видео только с фоном и маски сначала кодируются в скрытое пространствоЗатем для обучения с использованием диффузии добавляется шум, и модель учится восстанавливать чистые представления под руководством, специфичным для данной задачи. После этого облегченный адаптер объединяет зашумленные признаки с условиями удаления или добавления, позволяя обеим задачам совместно использовать контрольную информацию, оставаясь при этом управляемыми.

Региональное наведение с учетом поставленных задач создает сигнал, специфичный для задачи, путем объединения языковых токенов с визуальными признаками, извлеченными из объекта переднего плана, используя CLIPЗаменив универсальный токен объекта на векторное представление, полученное из фактического содержимого изображения. Это объединенное представление внедряется в базовую архитектуру посредством механизма перекрестного внимания, что позволяет модели отслеживать, как объект и его визуальные эффекты изменяются в пространстве и времени, обеспечивая при этом гибкое переключение между удалением и добавлением.

Потеря согласованности эффекта Процессы удаления и вставки заставляют фокусироваться на одних и тех же измененных областях, поскольку обе задачи связаны с одним и тем же объектом и его визуальными эффектами. Затем карты внимания из каждой ветви объединяются в карты мягких областей и выравниваются с помощью карта различий Этот дополнительный параметр вычисляется на основе видео с объектами и фоном, что позволяет сохранить тонкие изменения, такие как освещение и тени. от помогает в установке и извлечении направляющей и обеспечивает согласованность обеих задач.

Данные и тесты

Исследователи протестировали свой подход, сравнив его с различными методами восстановления изображений, восстановления видеоизображений и удаления объектов: OmniPaint; ОбъектОчистить; ВАСЕ; ДиффуЭразер; Профессиональный художник; ROSEи Минимакс-Удаление.

WAN2.1 был доработан с помощью ЛоРА†† с использованием набора данных VOR с разрешением 832x480 пикселей. 81 последовательный кадр ( эффективный предел Для обучения, которое проводилось в течение 129 000 итераций при различных значениях WAN (за пределами которых, как правило, возникают ошибки), случайным образом выбирались значения. размер партии из 8, на восьми графических процессорах H100, каждый с 80 ГБ видеопамяти. скорость обучения было установлено значение 1×102, и ранг LoRA в 256.

ROSE-Benchmark Единственным протестированным внешним набором данных была синтетическая коллекция; два других были VOR-Eval, ДО тест набора данных раскол; и VOR-Wild, тестовый набор, состоящий из 195 реальных видеороликов, собранных из интернета, с участием «динамических объектов».

Использованные метрики были Пиковое отношение сигнал/шум (ПСНР); Индекс структурного сходства (ССИМ); Полученное сходство участков перцептивного изображения (LPIPS); и Расстояние видео Фреше (FVD). Также было рассмотрено исследование пользователей, включающее 195 видеороликов, созданных с помощью VOR-Wild, с учетом усредненных оценок 20 добровольцев.

Кроме того, авторы разработали QScore, показатель, использующий Квен-ВЛ Мультимодальная модель, предназначенная для оценки качества видеоизображения после удаления объектов с точки зрения остаточных артефактов или пропущенных элементов окружения, таких как тени и световые эффекты:

Количественное сравнение результатов тестов ROSE и VOR, при этом лучшие и вторые лучшие результаты выделены жирным шрифтом и подчеркнуты соответственно.

В связи с этими результатами авторы отмечают:

«[Современные] методы восстановления изображений работают с отдельными кадрами, используя 2D-модели без учета временной последовательности, и поэтому не обеспечивают временную согласованность в видео».

Современные методы восстановления видеоизображений не учитывают явные побочные эффекты объектов, что приводит к неестественным результатам удаления. Существующие методы удаления видеообъектов не учитывают пространственно-временную корреляцию между объектом и его побочными эффектами, и, следовательно, часто приводят к появлению артефактов и остаточных следов удаленных объектов.

В целом, EffectErase демонстрирует лучшие результаты на всех наборах данных и по всем метрикам оценки. Он получает наилучшие оценки по метрике качества видео FVD, демонстрируя превосходную плавность и согласованность во времени создаваемых видеороликов.

«Наш метод также демонстрирует самые высокие показатели QScore и положительные отзывы пользователей, что еще раз подтверждает его эффективность в получении визуально убедительных результатов удаления».

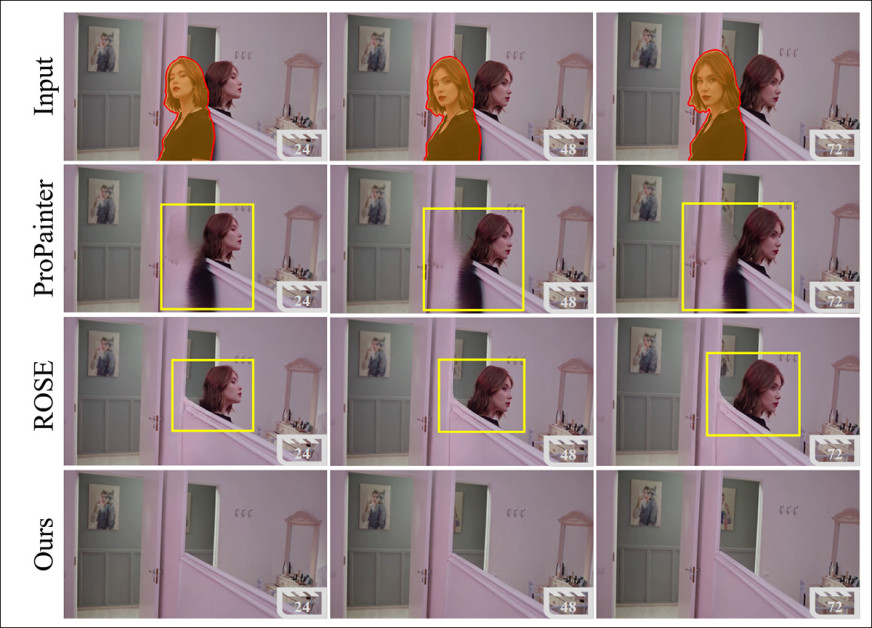

Для качественной оценки статические результаты представлены в статье (показана) непосредственно ниже, а динамические результаты доступны на сайте проекта и в сопутствующих материалах. видеопрезентация на YouTube:

Качественное сравнение результатов VOR-Eval по случаям окклюзии, теней, освещения, отражений и деформаций. Методы заполнения пробелов с трудом удаляют эффекты за пределами маски, в то время как модели удаления часто оставляют видимые артефакты. EffectErase удаляет как целевые объекты, так и связанные с ними эффекты более чисто. Для получения более подробной информации обратитесь к исходной статье, а для просмотра видеопримеров — к сайту проекта.

Мы также отсылаем читателя к различным примерам, связанным с проектом, которые представлены ниже, а также к официальному видео на YouTube, размещенному в конце этой статьи:

Нажмите, чтобы играть. Пример сравнения с сайта проекта EffectErase. Для получения более качественного изображения (с учетом вышеупомянутых оговорок) и дополнительных примеров, пожалуйста, обратитесь к сайту.

Авторы комментируют:

«Методы восстановления видеоизображений часто создают артефакты в замаскированных областях и не позволяют полностью устранить побочные эффекты, вызванные удаленными объектами. Предыдущие подходы к удалению объектов, такие как [ROSE] и [MinMax-Remover], хорошо справляются с удалением целевых объектов, но все еще испытывают трудности с побочными эффектами, особенно в сценариях с окклюзией, тенями, освещением, отражением и деформацией».

«В отличие от них, EffectErase эффективно удаляет как целевые объекты, так и связанные с ними эффекты, обеспечивая чистые, согласованные и высококачественные результаты».

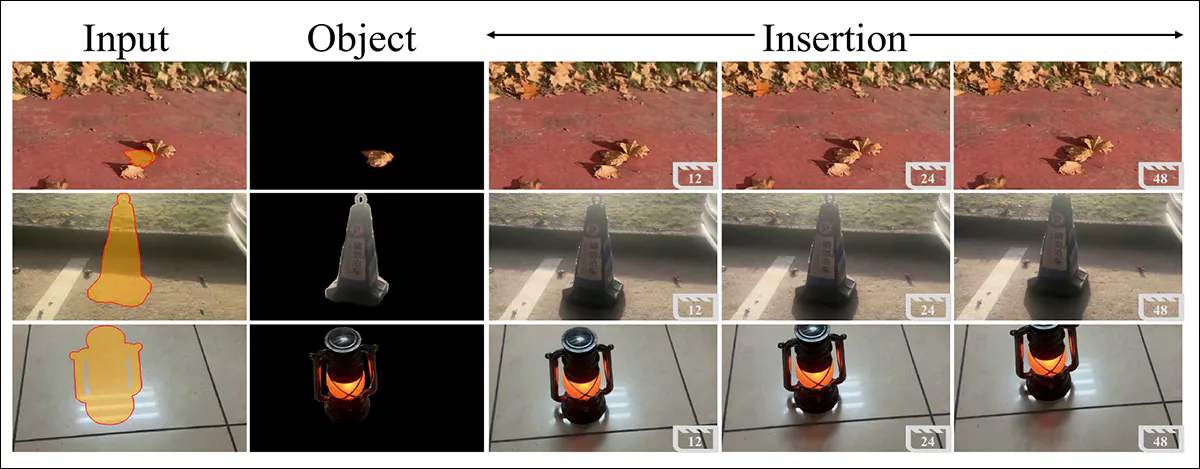

В заключение исследователи отмечают, что их метод также может быть адаптирован для задач введения, а не извлечения, без необходимости дополнительного обучения:

Результаты вставки видеообъектов. EffectErase вставляет объекты, сохраняя при этом фоновое содержимое и создавая согласованные эффекты, вызванные объектами, такие как тени и отражения, во всех кадрах.

Видеорезультаты выполнения задачи по вставке можно посмотреть в (Время показа) видео на YouTube примеры (также встроенные без временных меток в конце статьи).

Заключение

Анализ аналогичных проектов в литературе показывает, что многие по-прежнему надеются, что универсальные модели визуальных эффектов в конечном итоге смогут интегрировать подобную функциональность в общий «инструментарий», предназначенный для целого ряда эффектов, а не только для этой конкретной задачи.

Однако, исходя из принципа «мастер на все руки», представляется разумным предположить, что специализированные системы, такие как EffectErase, будут и впредь сохранять преимущество перед более универсальными подходами; с оговоркой, что разрыв в конечном итоге может сократиться настолько, что разница станет нецелесообразной для дополнительных усилий по обучению дискретной модели.

* Хотелось бы надеяться, что в свете растущей обеспокоенности по поводу происхождения интеллектуальной собственности будут указаны все подобные источники; однако, если в доступных материалах новой работы указан источник 3D-моделей, мне не удалось найти эту ссылку.

† Предоставленная ссылка, по-видимому, является общий пояснительный текст с 2013 года, при этом конкретные данные о VAE не приводятся.

†† В статье это описание семантически неясно, поскольку тонкая настройка и LoRA — это разные процессы с совершенно разными требованиями.

Впервые опубликовано в субботу, 21 марта 2026 года.