etikk

AI Incident Database har som mål å gjøre AI-algoritmer sikrere

Ethvert tilstrekkelig stort system vil ha feil, og en del av å korrigere for disse feilene er å ha en database over dem som kan analyseres for påvirkninger og potensielle årsaker. På samme måte som FDA opprettholder en database for uønskede medisinereaksjoner, eller National Transportation Safety Board opprettholder en database for luftfartsulykker, AI Incident Database er en database ment å katalogisere feil i AI-systemer og for å hjelpe AI-forskere med å utvikle nye metoder for å unngå disse feilene. Skaperne av AI Incident Database (AIID) håper at den vil hjelpe AI-selskaper med å utvikle sikrere, mer etisk AI.

Hva er AIID?

AIID er et produkt av organisasjonen Partnership on AI (PAI). PAI ble opprinnelig grunnlagt i 2016 av medlemmer av AI-forskningsteam hos store teknologiselskaper som Facebook, Apple, Amazon, Google, IBM og Microsoft. Siden den gang har organisasjonen rekruttert medlemmer fra mange flere organisasjoner, inkludert ulike ideelle organisasjoner. I 2018 satte PAI seg for å lage en konsistent klassifiseringsstandard for AI-feil. Det var imidlertid ingen samling av AI-hendelser å basere denne klassifiseringen på. Av denne grunn opprettet PAI AIID.

Ifølge TechTalks, formatet til AIID ble informert av strukturen til databasen for luftfartsulykker vedlikeholdt av National Transportation Safety Board. Siden det begynte å samles inn rapporter i 1996, har det kommersielle flyreisesystemet klart å øke sikkerheten til luftfartsindustrien ved å arkivere og analysere hendelser. Håpet er at et lignende lager av AI-hendelser kan gjøre AI-systemer tryggere, mer etiske og mer pålitelige. AIID hentet også inspirasjon fra Common Vulnerabilities and Exposures-databasen, som er et oppbevaringssted for bemerkelsesverdige programvarefeil som spenner over en rekke forskjellige bransjer og disipliner.

Sean McGregor er den ledende tekniske konsulenten hos IBM for Watson AI XPRIZE. McGregor er også ansvarlig for å overvåke utviklingen av AIIDs faktiske database. McGregor forklarte at målet med AIID til syvende og sist er å forhindre AI-systemer fra å forårsake skade, eller i det minste redusere alvorlighetsgraden av uønskede hendelser. Som McGregor bemerket, er maskinlæringssystemer vesentlig mer komplekse og uforutsigbare enn tradisjonelle programvaresystemer, og som et resultat kan de ikke testes på samme måte som annen programvare kan. Maskinlæringssystemer kan endre oppførselen deres på uventede måter. McGregor bemerker at kapasiteten til dyplæringssystemer til å lære kan bety at "feil er mer sannsynlige, mer kompliserte og farligere" når de går inn i en ustrukturert verden.

Mer enn 1,000 AI-relaterte hendelser logget

Siden AIID opprinnelig ble opprettet, har det vært mer enn 1,000 AI-relaterte hendelser logget inn i databasen. Av alle hendelsene i databasen var problemer som involverte AI-rettferdighet den vanligste typen uønskede hendelser. Mange av disse rettferdighetshendelsene involverer bruk av ansiktsgjenkjenningsalgoritmer av offentlige etater. McGregor bemerker også at det er et økende antall hendelser som involverer robotikk som legges til databasen.

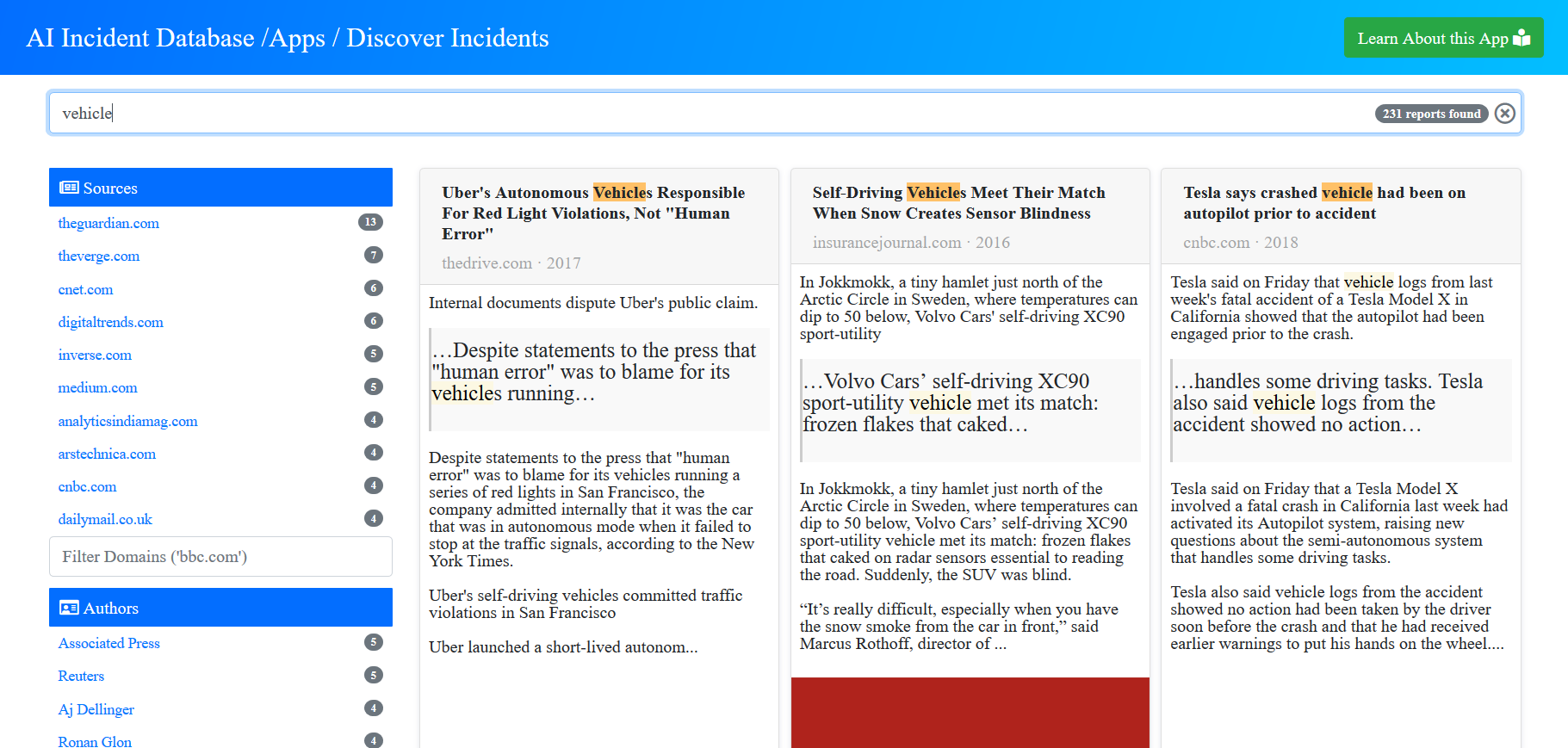

Besøkende til databasen kan utføre spørringer, søke i databasen etter hendelser basert på kriterier som nøkkelord, hendelses-ID, kilde eller forfatter. For eksempel, å kjøre et søk etter «Deepfake» returnerer 7 rapporter, mens søk etter «roboter» returnerer 158 rapporter.

En sentralisert database for hendelser med feil på AI og fungerer på uventede måter kan hjelpe forskere, ingeniører og etikere med å overvåke utviklingen og distribusjonen av AI-systemer. Produktledere hos teknologiselskaper kan bruke AIID for å se om det er noen potensielle problemer før de tar i bruk AI-anbefalingssystemer, eller en AI-ingeniør kan få en ide om potensielle skjevheter som må korrigeres når man oppretter AI-applikasjonen. På samme måte kan risikoansvarlige bruke databasen til å bestemme potensielle negative bivirkninger forbundet med en AI-modell, slik at de kan planlegge fremover og utvikle tiltak for å redusere potensielle skader.

Arkitekturen som ligger til grunn for AIID er ment å være fleksibel, da dette gjør det mulig å lage nye verktøy for å spørre databasen og trekke ut meningsfull innsikt. Partnership on AI og McGregor vil samarbeide for å konstruere en fleksibel taksonomi som kan brukes til å klassifisere alle forskjellige former for AI-hendelser. Teamet håper at når den fleksible taksonomien først er opprettet, kan den kombineres med et automatisert system som automatisk logger AI-hendelser.

"AI-fellesskapet har begynt å dele hendelsesregistreringer med hverandre for å motivere endringer i deres produkter, kontrollprosedyrer og forskningsprogrammer," McGregor forklarte via TechTalks. "Nettstedet ble offentlig utgitt i november, så vi begynner akkurat å innse fordelene med systemet."