Andersons hoek

Het reduceren van AI-beeldhallucinaties door ze te overdrijven

ChatGPT-achtige visiemodellen ‘hallucineren’ vaak elementen die niet in een afbeelding thuishoren. Een nieuwe methode vermindert deze fouten door het model overdreven versies van zijn eigen hallucinaties te laten zien, op basis van onderschriften – en vraagt het model vervolgens om het opnieuw te proberen. Deze aanpak vereist geen opnieuw trainen of extra gegevens en kan worden toegepast op een breed scala aan modellen en modeltypen.

Een nieuwe publicatie uit China biedt een interessante kijk op het hardnekkige probleem van hallucinaties in AI-gegenereerde afbeeldingen en video’s – elementen die duidelijk niet in de afbeelding thuishoren, op basis van de aanvraag en invoer van de gebruiker.

In essentie laat het systeem een afbeelding zien en laat het model deze beschrijven, zoals gebruikelijk; het maakt vervolgens een nieuwe afbeelding van die onderschrift met een tekst-naar-afbeelding-model – en eventuele extra objecten of details in deze tweede afbeelding zijn directe voorstellingen van de hallucinaties van het model. Vervolgens stuurt het systeem het model zachtjes weg van die fouten de volgende keer dat het probeert:

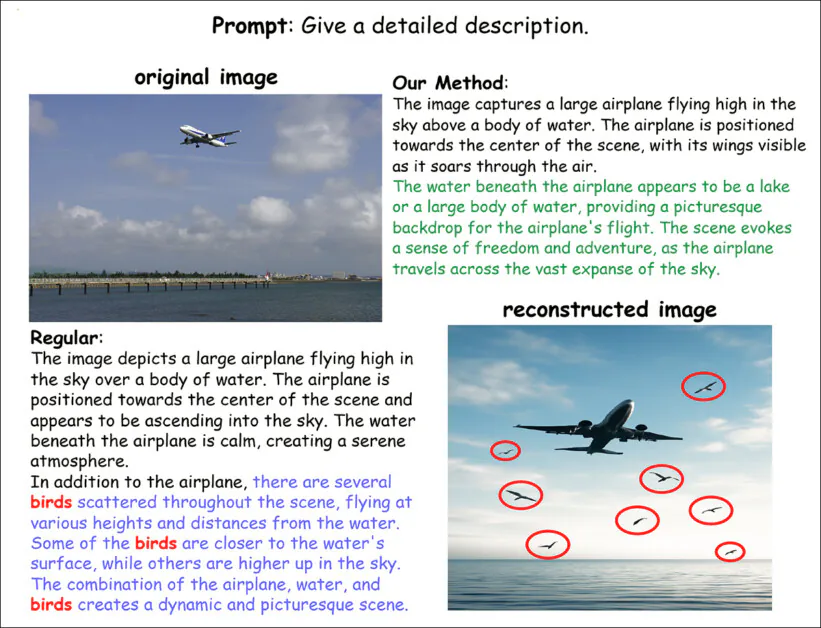

Een illustratie van hoe de nieuwe methode hallucinaties in afbeeldingsonderschriften identificeert en vermindert. Het reguliere model beschrijft vogels die niet in de oorspronkelijke afbeelding voorkomen, waardoor een gereconstrueerde afbeelding ontstaat die ze toevoegt. Deze fouten worden gemarkeerd in rood. In tegenstelling tot de voorgestelde methode, die deze verzonnen details vermijdt terwijl het onderschrift specifiek en vloeiend blijft. Bron: https://arxiv.org/pdf/2509.21997

De methode begint met het laten zien van echte afbeeldingen aan het model en het laten beschrijven ervan, inclusief enkele beschrijvingen met objecten of details die niet daadwerkelijk aanwezig zijn. Deze gehallucineerde onderschriften worden vervolgens gebruikt om synthetische afbeeldingen te genereren die de fouten gemakkelijker te zien maken. Door de echte en gegenereerde afbeeldingen te vergelijken, leert het systeem welke interne patronen in het model gemaakte inhoud produceren.

Zodra deze foutpatronen zijn geïdentificeerd, kunnen ze worden opgeslagen en later worden gebruikt. Wanneer het model een nieuwe afbeelding krijgt, past het systeem zijn interne signalen aan tijdens het onderschrift, het model wegduwend van de bekende patronen die hallucinaties veroorzaken. Dit werkt in één pas en vereist geen extra gegevens, opnieuw trainen of nieuwe afbeeldingengeneratie op testtijd.

De verwarde web

In het bovenstaande voorbeeld, uit het papier, kunnen we zien dat verstrengeling waarschijnlijk verantwoordelijk is voor het toevoegen van ‘vogels’ aan de invoerafbeelding, zelfs als de eerste afbeelding geen vogels lijkt te bevatten.

Verstrengeling treedt op wanneer een model erop staat om bepaalde concepten te associëren met bepaalde andere concepten, alleen omdat de twee (of meer) concepten de neiging hebben om vaak samen te verschijnen in de oorspronkelijke gegevensverdeling waarop het model is getraind. In dit geval kan het model veel afbeeldingen van vliegtuigen+vogels hebben gezien, waardoor een associatie ontstaat die niet van toepassing is op de specifieke afbeelding in kwestie, maar die desondanks de afgeleide onderschrift binnendringt.

Hoewel verstrengeling kan worden geminimaliseerd door eerder te stoppen met trainen (wat over het algemeen het model maximaal flexibel en aanpasbaar maakt), vermindert dit ook de details en resolutie van alle getrainde concepten, waardoor de modeltrainer met het eeuwige dilemma zit: een model maken dat zeer flexibel en ontward is; of een model maken dat krachtiger generatief is, maar ook meer hallucinaties produceert?

Als de kwaliteit van het onderschrift en de aandacht voor detail in de curatie van de oorspronkelijke gegevens voor een generatief model beter was dan logistiek toelaat, zouden onderschriften voor alle bronafbeeldingen elk object in elke afbeelding hebben gedetailleerd, zodat het getrainde model discrete en ontwarde ingangen in zijn latentie-ruimte had kunnen toewijzen.

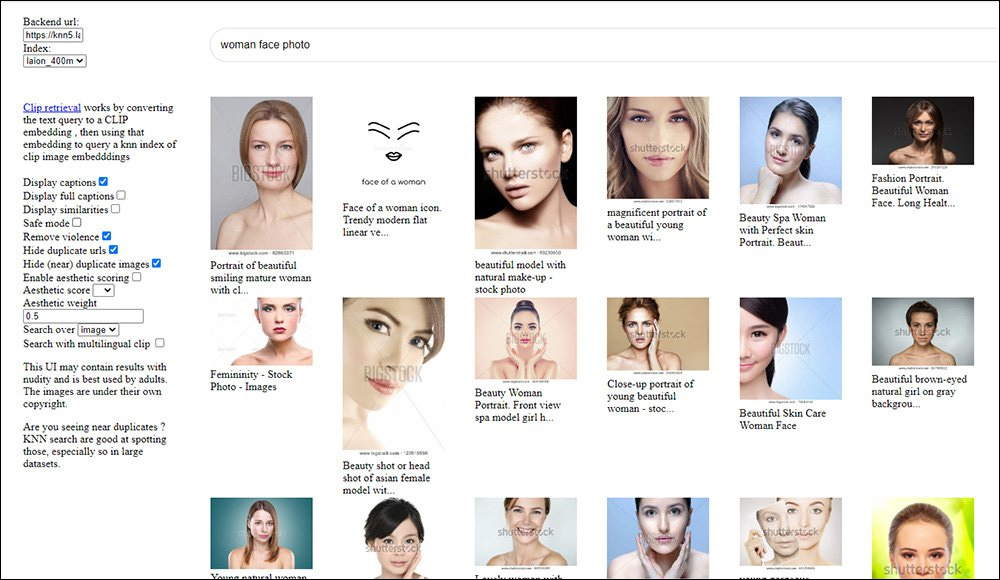

Zoals het er nu voor staat, betekent de zelfbedienende praktijk van SEO-onderschriften, in combinatie met het feit dat ad hoc hyperschaal-webscraping nog steeds de beste bron is voor het trainen van krachtige generatieve modellen, dat afbeeldingsonderschriften vaak aanzienlijk tekortschieten in deze standaard:

Een illustratie van hoe zwakke onderschriften de bruikbaarheid van LAION-afbeeldingen voor het trainen van modellen zoals Stable Diffusion beperken. Veel van de tekstlabels zijn oppervlakkig, vaag of geoptimaliseerd voor SEO in plaats van een accurate beschrijving, waardoor het voor het model moeilijker wordt om fijne visuele concepten zoals gezichtskenmerken te leren. (Oorspronkelijke bron was https://rom1504.github.io/, nu inactief).

Daarom, aangezien een fundamentele oplossing onwaarschijnlijk ooit praktisch zal zijn, is de reductie van LLM/VLM-hallucinaties door middel van omwegen en compromissen nu een sterke sub-stroom in de literatuur geworden.

De nieuwe Chinese techniek die deze week werd onthuld, stellen de auteurs, werd getest op een verscheidenheid aan architectuur in diverse omstandigheden en kan een nuttige manier zijn om ‘hallucinatievervuiling’ te verminderen.

Zij zeggen:

‘Uitgebreide experimenten op meerdere benchmarks laten zien dat onze methode hallucinaties aanzienlijk vermindert op object-, attribuut- en relatie-niveau, terwijl het merendeel van de recall en onderschrift[rijkdom] behoudt.’

De nieuwe paper heeft als titel Hallucinaties blootleggen om ze te onderdrukken: VLM’s Representation Editing With Generative Anchors, en komt van drie onderzoekers van de Universiteit van Wetenschap en Technologie van China en de Nanjing Universiteit.

Methode

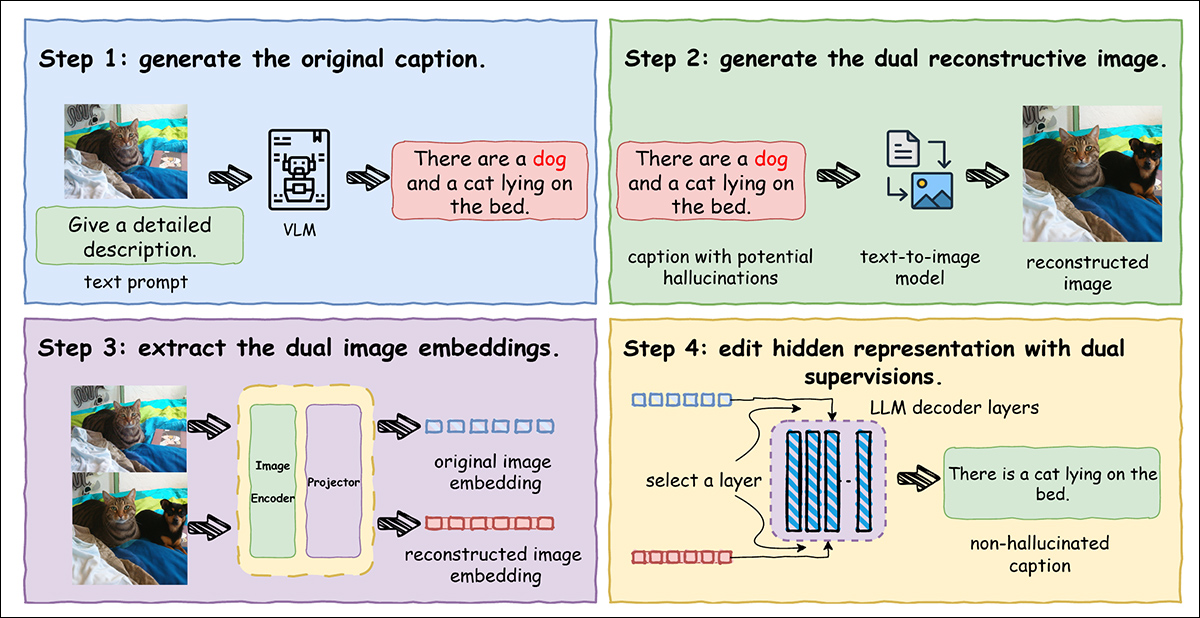

De auteurs hebben een eind-tot-eind-pijplijn ontwikkeld, die hieronder wordt getoond, om hallucinaties in afbeeldingsonderschriften te blootleggen en te onderdrukken:

Een illustratie van de volledige pijplijn. Een visie-taalmodel genereert eerst een onderschrift van de invoerafbeelding, dat mogelijk hallucineerde inhoud bevat. Dit onderschrift wordt vervolgens gebruikt om een gereconstrueerde afbeelding te produceren via een tekst-naar-afbeelding-model, waardoor eventuele hallucinaties gemakkelijker te zien zijn. Embeddings van zowel de oorspronkelijke als de gereconstrueerde afbeeldingen worden geëxtraheerd en gebruikt om aanpassingen in de decoder te leiden, waardoor het model hallucineerde details onderdrukt terwijl het onderschriftkwaliteit behoudt.

Vanuit een echte invoerafbeelding genereert een visie-taalmodel een beschrijvend onderschrift dat mogelijk uitgevonden objecten of relaties bevat. Dit onderschrift wordt vervolgens gevoerd in een tekst-naar-afbeelding-generator om een gereconstrueerde afbeelding te creëren die exact beschrijft wat het onderschrift beschrijft. Door deze gereconstrueerde afbeelding te vergelijken met de oorspronkelijke, worden de vervalste inhoud duidelijk en meetbaar, waardoor subtiele fouten in tekst zichtbare verschillen worden die het systeem kan richten en verminderen.

Om het model weg te leiden van ‘uitvinden’ van details, vergelijkt het systeem twee versies van dezelfde afbeelding: de oorspronkelijke en een gereconstrueerde op basis van het onderschrift. Elke afbeelding wordt omgezet in een compacte embedding die de inhoud vastlegt.

De oorspronkelijke afbeelding fungeert als een betrouwbare referentie, terwijl de gereconstrueerde afbeelding aangeeft waar hallucinaties mogelijk zijn binnengeslopen. Door zijn interne voorstellingen aan te passen om dichter bij de oorspronkelijke en verder van de gereconstrueerde afbeelding te komen, leert het model zichzelf automatisch te corrigeren. Aangezien dit proces niet afhankelijk is van handmatig aangepaste regels of externe gegevens, blijft het volledig zelf-supervised.

Het papier stelt:

‘Hallucinaties in MLLM’s zijn intrinsiek moeilijk te detecteren omdat ze linguïstisch goed gevormd zijn en vaak niet te onderscheiden zijn van trouwe beschrijvingen op tekstniveau. Het verschil ligt niet in taalplausibiliteit maar in de misalignering met visuele bewijs, waar het model zelf meestal ongevoelig voor is.

‘Om dit aan te pakken, introduceren we een hallucinatie-expositiemechanisme dat generatieve reconstructie gebruikt om impliciete inconsistenties om te zetten in expliciete en waarneembare signalen.’

Gegeven een invoerafbeelding en zijn onderschrift, gebruikt het systeem de FLUX.1-dev tekst-naar-afbeelding-model om een afbeelding opnieuw te creëren vanuit het onderschrift alleen. Deze opnieuw gecreëerde afbeelding heeft de neiging de betekenis van het onderschrift te overdrijven, waardoor eventuele valse details meer zichtbaar worden. Deze versterkte fouten dienen vervolgens als nuttige signalen die het model helpen om zijn eigen fouten te herkennen en te corrigeren.

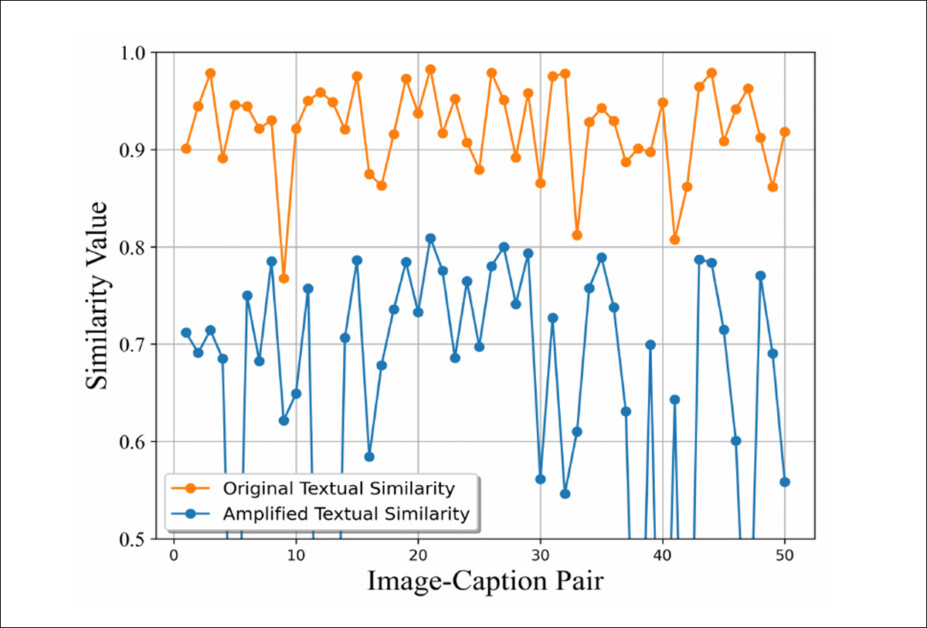

Om hun aanpak te testen, voegden de auteurs hallucinaties toe aan onderschriften en gebruikten het tekst-naar-afbeelding-model om gereconstrueerde afbeeldingen te genereren. Deze afbeeldingen werden vervolgens opnieuw onderschreven door LLaVA, en de semantische overeenkomst tussen de oorspronkelijke en gehallucineerde onderschriften werd geëvalueerd:

Een illustratie van hoe de hallucinatie-versterkingsmechanisme subtiele fouten zichtbaar maakt. Elk punt toont de overeenkomst tussen onderschriften van de oorspronkelijke en gereconstrueerde afbeeldingen voor één afbeelding-onderschrift-paar. De oranje lijn vertegenwoordigt de overeenkomst gemeten rechtstreeks tussen oorspronkelijke en gehallucineerde onderschriften, die hoog blijft en kleine fouten maskeert; de blauwe lijn vertegenwoordigt de overeenkomst na reconstructie, die scherp daalt, waardoor het proces verborgen hallucinaties in duidelijke semantische markers omzet die kunnen worden gedetecteerd en gecorrigeerd.

De overeenkomst daalt scherp na reconstructie, waardoor het proces subtiele fouten beter zichtbaar maakt.

Gegevens en tests

Het valideren van de effectiviteit van de nieuwe methode omvatte het gebruik van drie geschikte benchmarks: Oniderschrift Hallucinatie Beoordeling met Afbeeldingsrelevantie (CHAIR); MLLM Evaluatie benchmark (MME); en Pooling-gebaseerde Object Probing Evaluatie (POPE).

Uit het CHAIR-publicatiepapier: voorbeelden van gehallucineerde objecten gegenereerd door twee toonaangevende onderschriftingsystemen, TopDown en NBT, waarbij elk model visuele elementen uitvindt die niet daadwerkelijk in de afbeelding aanwezig zijn, zoals laptops, gootstenen of surfplanken. Bron: https://arxiv.org/pdf/1809.02156

Standaardmetrieken zoals hallucinatiesnelheid of recall kunnen misleidend zijn, omdat een model hallucinaties kan vermijden door alleen maar korte of vage onderschriften te produceren. Om het compromis tussen recall en hallucinatie te verantwoorden, werd een gecombineerde metriek genaamd Hallucinatie en Recall (HAR@β) gebruikt, die onderschriften beoordeelt op basis van zowel nauwkeurigheid als volledigheid, en die de balans toelaat aan te passen afhankelijk van of het vermijden van fouten of het opnemen van meer details belangrijker is.

POPE werd gebruikt om contextgevoelige objecthallucinaties te evalueren, en MME om attribuutniveau-hallucinaties te evalueren, met beide als ja-of-nee-oordelen taken.

Experimenten werden uitgevoerd op diverse representatieve datasets, met het gebruik van het Flux-model en de LLaVA-v1.5-7B variant. De gebruikte datasets waren Microsoft COCO; A-OKVQA; en GQA.

Latente bewerking werd uitgevoerd voor de tweede laag van de modellen, in overeenstemming met eerder gerelateerd werk, terwijl hyperparameters en temperatuur consistent waren over alle modellen.

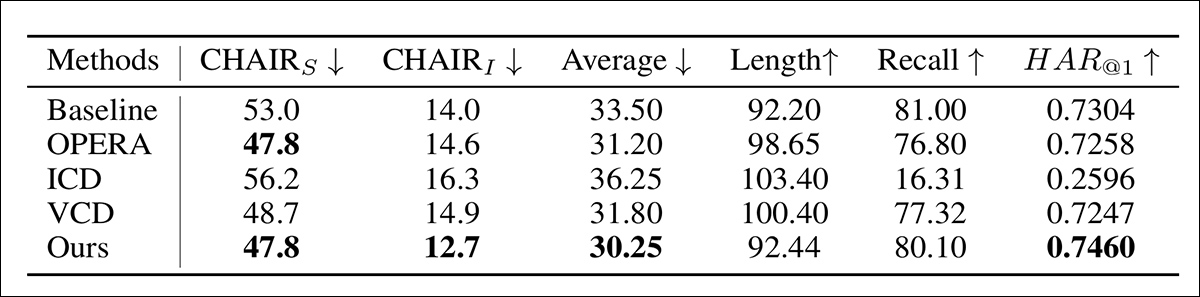

De initiële resultaten op CHAIR worden hieronder weergegeven*:

Prestatie op CHAIR-benchmark voor hallucinatie-mitigatie, geëvalueerd met meerdere metrieken.

Van deze resultaten merken de auteurs op:

‘[Onze methode presteert consistent beter dan andere baselines op zowel CHAIRS als CHAIRI[*] , waardoor de superioriteit in het onderdrukken van hallucinaties wordt aangetoond. Ondertussen, hoewel bijna alle methoden onvermijdelijk recall verminderen bij het onderdrukken van hallucinaties, weerspiegelt een compromis tussen trouw en informativiteit, onze aanpak bereikt de kleinste daling.

‘Dit toont aan dat onze methode een breed scala aan grondwaarheden objecten vastlegt. Met de HAR@β-metriek behaalt onze methode de hoogste score, waardoor de mogelijkheid om hallucinaties te verminderen terwijl dekking behouden wordt, wordt benadrukt.’

De onderzoekers wijten deze sterke resultaten aan de dubbele supervisie-opstelling, waarbij schone semantiek van de oorspronkelijke afbeelding werden versterkt, terwijl tegelijkertijd misleidende signalen van de gereconstrueerde afbeelding werden onderdrukt. Omdat de aanpassing alleen de richting gericht was op hallucinaties, bleef de rest van de voorstelling intact, waardoor het systeem fouten kon corrigeren zonder details of informativiteit op te offeren.

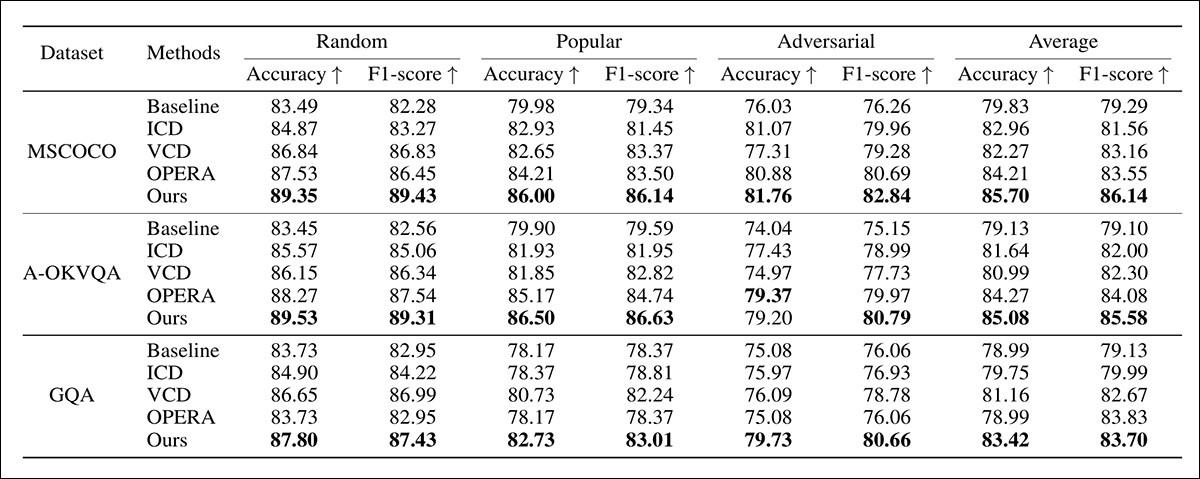

Vergelijking van prestaties op de POPE-benchmark onder verschillende configuraties en datasets.

Met betrekking tot de resultaten op POPE, weergegeven in de resultaatentabel hierboven, stelt het papier:

‘Het kan worden waargenomen dat onze methode consistent de beste prestatie behaalt in alle instellingen. Opvallend is dat onze methode tot +5,95% nauwkeurigheid en +6,85% F1-score kan behalen, waardoor andere trainingsvrije benaderingen met een grote marge worden overtroffen.

‘Derhalve tonen deze resultaten aan dat onze methode een betrouwbare en generaliseerbare oplossing biedt over verschillende moeilijkheidsniveaus.’

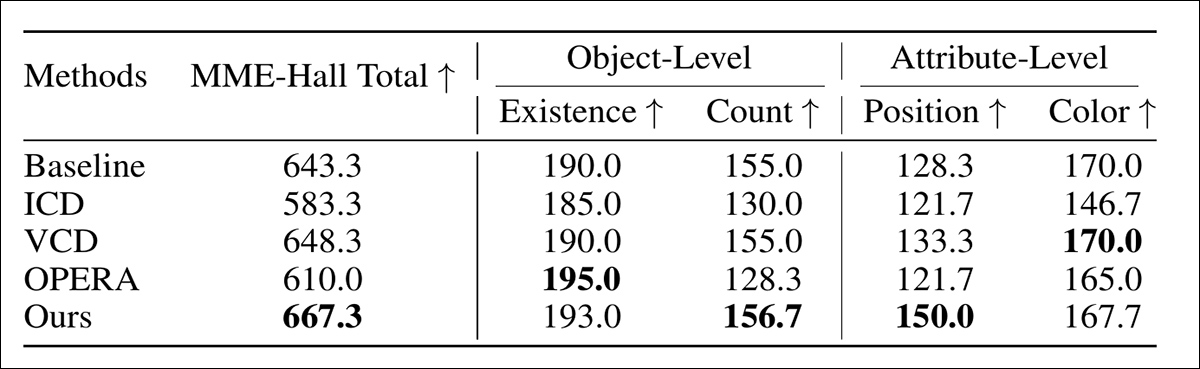

Uit de derde testronde, prestatievergelijkingen over MME.

De laatste hoofdtest was op MME, met de resultaten hierboven. Echter, onder andere weglatingen, wordt de methode ‘OPERA’ genoemd, die nergens in het hoofdpapier of de bijlage wordt gedefinieerd. Hoewel de auteurs beweren een sterke prestatie op MME te hebben, zonder adequate definities van de methoden, zouden we het resultaatgedeelte op dit punt misschien moeten laten.

Een illustratie uit de MME-benchmark met LLaVA-v1.5-7B, waarin wordt getoond hoe het basismodel een gehallucineerd antwoord produceerde, terwijl de voorgestelde methode het correcte antwoord gaf, met de gereconstrueerde afbeelding die de hallucinatie meer zichtbaar maakt.

Conclusie

Hoewel dit papier duidelijk haastig is en lijdt aan het gebrek aan structuur, focus en duidelijkheid dat de afgelopen 12 maanden in de literatuur is toegenomen (misschien niet ongerelateerd aan het snel groeiende gebruik van AI in academisch onderzoek), blijft de centrale mechanisme die wordt gepresenteerd ingenieus.

Hoewel deze eind-tot-eind-aanpak geen opnieuw trainen vereist en toepasbaar lijkt op een breed scala aan architectuur, zou het interessant zijn om meer testkandidaten te zien; en het moet ook in overweging worden genomen dat een tussenliggend systeem van deze soort ten minste enige latentie zal introduceren, en enige mate van extra energievraag – geen klein probleem in grote hoeveelheden.

* Ongebruikelijk, presenteert het hoofdlichaam van dit papier resultaten met koppen die alleen in de bijlage worden uitgelegd, en niet in het hoofdpapier – een steeds vaker voorkomende slechte gewoonte in de literatuur, aangezien onderzoekers proberen de centrale these te beperken tot 8-9 pagina’s, zelfs wanneer het materiaal dat niet toelaat. In elk geval werd de CHAIR-benchmark, die werd gebruikt om objecthallucinatie in onderschriften te evalueren, gebaseerd op een subset van 500 MSCOCO-afbeeldingen uit eerder werk. Twee vormen werden gebruikt: CHAIRs, die meet hoe vaak hallucinaties in een onderschrift voorkomen; en CHAIRI, die meet hoeveel van de genoemde objecten zijn gehallucineerd. HAR@β , geïntroduceerd in het hoofdpapier, werd gedefinieerd als een Fβ-achtige combinatie van hallucinatie-onderdrukking en objectherinnering.

Eerst gepubliceerd op dinsdag 30 september 2025