Kunstmatige intelligentie

Waarom Wedstrijden het Nieuwe Standaard worden voor het Testen van AI

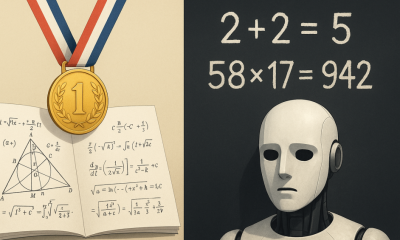

Gedurende vele jaren zijn benchmarks zoals ImageNet voor computer vision en GLUE voor natural language processing de belangrijkste instrumenten geweest voor het evalueren van AI. Ze boden een eenvoudige manier om vooruitgang te volgen en verschillende modellen te vergelijken. Maar omdat AI-systemen geavanceerder zijn geworden, zijn veel van deze benchmarks verzadigd, met modellen die het menselijke niveau evenaren of zelfs overtreffen. Deze uitdaging heeft de behoefte aan nieuwe methoden doen ontstaan die de mogelijkheden van AI beter kunnen testen. Als antwoord op deze uitdaging zijn onderzoekers nu bezig met wedstrijden als een alternatieve manier om AI te evalueren. In plaats van te vertrouwen op vaste datasets, worden AI-modellen nu geëvalueerd door middel van bordspellen, programmeerwedstrijden, wiskunde-olympiades, e-sports en robotuitdagingen. In deze omgevingen moeten modellen zich aanpassen, redeneren en strategieën ontwikkelen om nieuwe problemen en tegenstanders te tackelen. Dit artikel onderzoekt de beperkingen van traditionele benchmarks en laat zien hoe wedstrijden een nieuwe standaard worden voor het evalueren van AI.

Waarom Traditionele Benchmarks Tekortschieten

Traditionele benchmarks hebben de ontwikkeling van AI gedurende decennia geleid. Ze bieden een gestandaardiseerde manier om de prestaties van AI-modellen te vergelijken. Deze datasets bevatten vaste invoer met duidelijke doelen, waardoor onderzoekers verschillende benaderingen op een eenvoudige manier kunnen vergelijken. Een model dat beter presteerde, werd als meer capabel beschouwd.

Hoe dan ook, omdat AI-systemen krachtiger zijn geworden, hebben deze benchmarks fundamentele beperkingen aan het licht gebracht. Het meest voor de hand liggende probleem is benchmark-verzadiging. Wanneer modellen perfecte of bijna-perfecte scores behalen, verliest de test zijn vermogen om het onderscheid tussen sterkere en zwakkere modellen te maken. Studies laten zien dat veel benchmarks snel verzadigen, en deze trend is de afgelopen jaren nog meer toegenomen.

Data-verontreiniging vormt een andere uitdaging. Veel benchmark-exemplaren zijn online beschikbaar en kunnen in trainingsdatasets zijn opgenomen. Wanneer een model een probleem oplost, kan het een antwoord herinneren dat het al tijdens de training heeft gezien. Dit creëert een illusie van intelligentie zonder daadwerkelijke redeneervaardigheid te demonstreren.

Sommige onderzoekers hebben geprobeerd dit op te lossen door menselijke evaluatie te gebruiken. Hoewel dit nuances toevoegt, brengt menselijke evaluatie ook subjectiviteit en vooroordelen met zich mee. Deze beoordelingen zijn ook tijdrovend, duur en moeilijk om te schalen over meerdere modellen. Deze beperkingen hebben een dringende behoefte aan evaluatiemethoden gecreëerd die kunnen blijven bijbenen met de snel vooruitgaande AI-mogelijkheden.

Waarom Wedstrijden een Beter Aanpak Bieden

Wedstrijden bieden een dynamische testomgeving die veel tekortkomingen van traditionele benchmarks aanpakt. Ze bieden duidelijke regels, gedefinieerde doelen en meetbare resultaten die niet afhankelijk zijn van subjectieve interpretatie. Succes wordt bepaald door transparante resultaten die iedereen kan verifiëren.

Het grootste voordeel van wedstrijden is hun natuurlijke vermogen om moeilijkheidsgraad te schalen. Naarmate AI verbetert, worden de uitdagingen automatisch moeilijker. In games moeten sterkere modellen tegen meer geavanceerde tegenstanders spelen. In wiskundewedstrijden nemen de problemen in complexiteit toe. In programmeerwedstrijden worden de algoritmische uitdagingen veeleisender. Deze zelfschalende eigenschap zorgt ervoor dat de evaluatie relevant blijft naarmate de technologie vordert.

Wedstrijden eisen ook diverse cognitieve vaardigheden. Strategische games vereisen langetermijnplanning en tegenstandermodellering. Wiskunde-olympiades testen creatief probleemoplossen en strikt redeneren. Programmeerwedstrijden evalueren algoritmisch denken en implementatievaardigheden. Real-world-uitdagingen zoals Kaggle-wedstrijden beoordelen praktische probleemoplossende vaardigheden in verschillende domeinen.

Het belangrijkste is dat wedstrijden directe vergelijking met menselijke prestaties mogelijk maken. Dit kenmerk biedt een betekenisvol referentiepunt dat statische benchmarks niet kunnen bieden. Wanneer een AI-systeem meedoet aan de Internationale Wiskunde-olympiade of schaakt tegen grootmeesters, krijgen we inzicht in hoe machine-intelligentie zich verhoudt tot menselijke capaciteiten.

De transparantie van competitieve evaluatie maakt ook diepere analyse mogelijk. Elke zet in een spel, elke stap in een wiskundig bewijs en elke regel code kan worden onderzocht om te begrijpen hoe AI-systemen problemen aanpakken. Deze openheid verandert evaluatie van eenvoudig scoren in een venster voor het begrijpen van besluitvormingsprocessen.

Voorbeelden van AI in Wedstrijden

Het evalueren van AI door middel van wedstrijden is geen nieuw idee. In 2016 DeepMind’s AlphaGo versloeg de wereldkampioen Go Lee Sedol, en zijn opvolger, AlphaZero, versloeg de regerende computerkampioen Stockfish door zichzelf het schaakspel aan te leren. In e-sports OpenAI’s Dota 2-systeem (OpenAI Five) versloeg het wereldkampioensteam in 2019, terwijl DeepMind’s AlphaStar de status van grootmeester bereikte in StarCraft II. Deze overwinningen toonden aan dat AI-systemen kunnen aanpassen en slagen in hoogst strategische, real-time-omgevingen.

Onlangs hebben onderzoekers AI-modellen ontwikkeld voor academische wedstrijden. In feite Google DeepMind en OpenAI-systemen behaalden een gouden medaille-score op de Internationale Wiskunde-olympiade. In programmeren AlphaCode nam nieuwe Codeforces-problemen aan en eindigde rond het mediane menselijke niveau. Deze resultaten toonden aan dat AI-systemen concurrerend kunnen presteren in olympiad-achtige redeneerwedstrijden.

Competitie in robotica volgt een soortgelijke aanpak. Evenementen zoals RoboCup, DARPA-uitdagingen en XPrize-taken vereisen dat teams agents bouwen die in real-world-omgevingen opereren, van voetballende robots tot autonome voertuigen. Deze competitieve formaten maken vooruitgang meetbaar en stellen directe vergelijking tussen systemen mogelijk.

Wat Competitie-Gebaseerde Testen Onthult

Wedstrijden onthullen aspecten van intelligentie die traditionele benchmarks vaak missen. Algemene vermogens worden meteen duidelijk wanneer AI nieuwe uitdagingen tegenkomt die het nog nooit heeft ontmoet. In tegenstelling tot benchmarks die memorisatie bevorderen, presenteren wedstrijden constant nieuwe scenario’s die echte probleemoplossende vaardigheden vereisen.

Creatief redeneren komt naar voren als een cruciaal factor, vooral in wiskundige en wetenschappelijke wedstrijden. AI moet originele inzichten genereren en nieuwe argumenten construeren om een probleem op te lossen dat het nog nooit heeft gezien. Deze creativiteit kan niet worden gemeten door middel van patroonherkenning in vaste datasets.

Aanpasbaarheid is een essentieel aspect van alle competitieve domeinen. Games-spelende AI moet strategieën aanpassen op basis van tegenstander-gedrag. Wedstrijd-oplossende AI moet benaderingen wijzigen wanneer eerste pogingen falen. Deze flexibiliteit weerspiegelt real-world-eisen waarin starre reacties vaak falen.

Robuustheid onder noviteit is een andere belangrijke factor van competitie-gebaseerde testing. De competitieve omgeving verandert constant, waardoor AI moet omgaan met nieuwe situaties en onverwachte zetten. Een model dat goed presteert onder deze omstandigheden is waarschijnlijker betrouwbaar en effectief in real-world-toepassingen.

Ten slotte bieden wedstrijden een directe manier om menselijke redeneervaardigheid te vergelijken met machine-intelligentie. Door te concurreren tegen menselijke experts in een spel of een probleemoplossingswedstrijd, worden AI-systemen gehouden aan de hoogste standaard. Dit kenmerk biedt een duidelijk, aspiratievol doel voor het veld in plaats van abstracte prestatie-metrieken.

Uitdagingen in Competitie-Gebaseerde Evaluatie

Hoewel competitie-gebaseerde evaluatie veel voordelen biedt, gaat het ook gepaard met verschillende uitdagingen. Een zorg is domeinspecifiteit. Een schaakkampioen kan mogelijk geen complex wiskundig probleem oplossen. Succes in een specifieke wedstrijd garandeert geen algemene intelligentie. Het veld moet manieren vinden om resultaten uit meerdere wedstrijden te combineren om een meer omvattende kijk te krijgen op de algehele capaciteiten van een AI.

Standaardisatie is een ander probleem. Terwijl win-verliesrecords duidelijk zijn binnen een enkel spel, is het vergelijken van resultaten over verschillende soorten wedstrijden moeilijk. Hoe vergelijk je bijvoorbeeld de prestatie van een model in een robotuitdaging met zijn prestatie in een programmeerwedstrijd? Onderzoekers werken aan het creëren van kaders die deze verschillende soorten resultaten in een eerlijke beoordeling kunnen omvatten.

Ten slotte is er het probleem van toegankelijkheid. Terwijl veel wedstrijden open zijn, vereisen sommige significante computationele middelen of expertise die mogelijk niet beschikbaar zijn voor alle onderzoekers, vooral die van kleinere instellingen. Het verzekeren dat deze nieuwe evaluatiemethoden inclusief zijn, is essentieel voor de gezondheid en diversiteit van het veld.

Breder Impact op AI-Onderzoek

De opkomst van competitie-gebaseerde evaluatie heeft al een significante impact op hoe AI wordt ontwikkeld. Het moedigt onderzoekers aan om af te stappen van het enkel trainen van modellen op benchmarks naar het bouwen van systemen die kunnen plannen, redeneren en aanpassen aan nieuwe situaties. Deze verschuiving is cruciaal om echte vooruitgang te boeken naar meer algemene vormen van intelligentie.

Competitieve platforms democratiseren ook evaluatie. Door games en wedstrijden open te stellen voor iedereen, kunnen kleine onderzoeksGroepen en individuele ontwikkelaars concurreren met grote technologiebedrijven. Deze democratisering moedigt innovatie aan van een bredere range van mensen en instellingen. Platforms zoals Kaggle, de Internationale Wiskunde-olympiade en programmeerwedstrijdsites bieden toegankelijke locaties voor het testen van AI-capaciteiten.

Ten slotte hebben lessen uit competitief testen een directe invloed op real-world-toepassingen. De capaciteit om te plannen, aan te passen en robuust te blijven onder druk is waardevol in domeinen zoals financiën, transport, gezondheidszorg en defensie. Deze domeinen vereisen AI die onzekerheid kan hanteren, kan aanpassen aan veranderende omstandigheden en betrouwbare prestaties kan leveren.

De Bottom Line

Competitie-gebaseerde evaluatie herdefinieert hoe we AI-voortgang meten. In tegenstelling tot statische benchmarks testen wedstrijden aanpasbaarheid, creativiteit en echte probleemoplossing onder dynamische omstandigheden. Hoewel uitdagingen zoals standaardisatie en toegankelijkheid blijven bestaan, duwt deze verschuiving AI naar meer robuuste, veelzijdige en mens-vergelijkbare intelligentie. Het verscherpt niet alleen onderzoek maar versnelt ook de ontwikkeling van AI-systemen die klaar zijn voor real-world-impact.