Kunstmatige intelligentie

Supercharging Graph Neural Networks met Large Language Models: De Ultieme Gids

Graphen zijn gegevensstructuren die complexe relaties vertegenwoordigen in een breed scala aan domeinen, waaronder sociale netwerken, kennisbases, biologische systemen en veel meer. In deze graphen worden entiteiten vertegenwoordigd als knooppunten en hun relaties worden weergegeven als randen.

De mogelijkheid om deze ingewikkelde relationele structuren effectief te vertegenwoordigen en te redeneren is cruciaal voor het mogelijk maken van vooruitgang in domeinen zoals netwerk wetenschap, chemische informatiekunde en recommender systemen.

Graph Neural Networks (GNN’s) zijn opgekomen als een krachtig diep leer raamwerk voor graph machine learning taken. Door de graph topologie op te nemen in de neurale netwerk architectuur via buurt aggregatie of graph convoluties, kunnen GNN’s lage dimensionale vector representaties leren die zowel de knooppunt kenmerken als hun structurele rollen coderen. Dit stelt GNN’s in staat om state-of-the-art prestaties te bereiken op taken zoals knooppunt classificatie, link voorspelling en graph classificatie in diverse toepassingsgebieden.

Terwijl GNN’s aanzienlijke vooruitgang hebben geboekt, blijven enkele belangrijke uitdagingen bestaan. Het verkrijgen van hoogwaardige gelabelde gegevens voor het trainen van begeleide GNN-modellen kan duur en tijdrovend zijn. Bovendien kunnen GNN’s moeite hebben met heterogene graph structuren en situaties waarin de graph distributie op test tijd aanzienlijk verschilt van de trainingsgegevens (uit de distributie generalisatie).

In parallel, hebben Large Language Models (LLM’s) zoals GPT-4 en LLaMA de wereld stormenderhand veroverd met hun ongelooflijke natuurlijke taal begrip en generatie capaciteiten. Getraind op enorme tekst corpora met miljarden parameters, vertonen LLM’s opmerkelijke few-shot learning capaciteiten, generalisatie over taken en alledaagse redeneringsvaardigheden die eerder extreem moeilijk werden geacht voor AI-systemen.

Het enorme succes van LLM’s heeft onderzoeken naar het benutten van hun kracht voor graph machine learning taken aangewakkerd. Enerzijds bieden de kennis en redeneringscapaciteiten van LLM’s kansen om traditionele GNN-modellen te verbeteren. Anderzijds zouden de gestructureerde representaties en feitelijke kennis die inherent zijn aan graphen, instrumenteel kunnen zijn bij het aanpakken van enkele belangrijke beperkingen van LLM’s, zoals hallucinaties en gebrek aan interpretatie.

Graph Neural Networks en Zelfbegeleid Leren

Om de noodzakelijke context te bieden, zullen we eerst de kernconcepten en methoden in graph neurale netwerken en zelfbegeleid graph representatie leren kort bespreken.

Graph Neurale Netwerk Architecturen

Graph Neurale Netwerk Architectuur – bron

Het belangrijkste onderscheid tussen traditionele diepe neurale netwerken en GNN’s ligt in hun vermogen om rechtstreeks op graph-gegevens te werken. GNN’s volgen een buurt aggregatie schema, waarbij elke knooppunt functie vectoren van zijn buren aggregeert om zijn eigen representatie te berekenen.

Talrijke GNN-architecturen zijn voorgesteld met verschillende instantiaties van de bericht en update functies, zoals Graph Convolutional Networks (GCN’s), GraphSAGE, Graph Attention Networks (GAT’s) en Graph Isomorphism Networks (GIN’s) onder andere.

Onlangs hebben graph transformers aan populariteit gewonnen door de zelf aandacht mechanisme van natuurlijke taal transformers aan te passen om op graph-gegevens te werken. Enkele voorbeelden zijn GraphormerTransformer en GraphFormers. Deze modellen zijn in staat om lange afstands afhankelijkheden over de graph beter te vangen dan zuiver buurt-gebaseerde GNN’s.

Zelfbegeleid Leren op Graphen

Terwijl GNN’s krachtige representatie modellen zijn, wordt hun prestatie vaak beperkt door het gebrek aan grote gelabelde datasets die nodig zijn voor begeleide training. Zelfbegeleid leren is opgekomen als een veelbelovend paradigma om GNN’s voor te trainen op ongelabelde graph gegevens door gebruik te maken van pretext taken die alleen de intrinsieke graph structuur en knooppunt kenmerken vereisen.

Enkele veel voorkomende pretext taken die worden gebruikt voor zelfbegeleid GNN voor training zijn:

- Knooppunt Eigenschap Voorspelling: Willekeurig maskeren of corrumperen van een deel van de knooppunt attributen/kenmerken en de GNN de taak geven om ze te reconstrueren.

- Rand/Link Voorspelling: Leren om te voorspellen of een rand bestaat tussen een paar knooppunten, vaak op basis van willekeurig rand maskeren.

- Contrastief Leren: Maximale overeenkomsten tussen graph weergaven van hetzelfde graph monster maximaliseren terwijl weergaven van verschillende graphen worden weggeduwd.

- Wederzijdse Informatie Maximisatie: Maximale wederzijdse informatie tussen lokale knooppunt representaties en een doel representatie zoals de globale graph embedding.

Pretext taken zoals deze stellen de GNN in staat om betekenisvolle structurele en semantische patronen te extraheren uit de ongelabelde graph gegevens tijdens voor training. De voor getrainde GNN kan vervolgens worden fijngesteld op relatief kleine gelabelde subsets om uit te blinken in diverse downstream taken zoals knooppunt classificatie, link voorspelling en graph classificatie.

Door zelfbegeleiding te benutten, vertonen GNN’s die zijn voor getraind op grote ongelabelde datasets betere generalisatie, robuustheid tegen distributie verschuivingen en efficiëntie in vergelijking met training van scratch. Echter, enkele belangrijke beperkingen van traditionele GNN-gebaseerde zelfbegeleide methoden blijven bestaan, die we vervolgens zullen onderzoeken door LLM’s te benutten.

Graph ML Versterken met Large Language Models

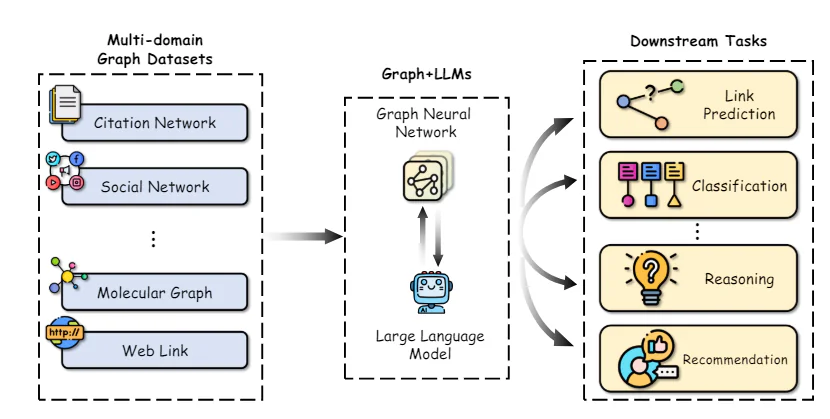

Integratie van Graphen en LLM – bron

De opmerkelijke capaciteiten van LLM’s in het begrijpen van natuurlijke taal, redeneren en few-shot leren bieden kansen om meerdere aspecten van graph machine learning pipelines te verbeteren. We onderzoeken enkele belangrijke onderzoeksrichtingen in deze ruimte:

Een belangrijke uitdaging bij het toepassen van GNN’s is het verkrijgen van hoogwaardige functie representaties voor knooppunten en randen, vooral wanneer ze rijke tekstuele attributen bevatten zoals beschrijvingen, titels of abstracts. Traditioneel zijn eenvoudige zak van woorden of voor getrainde woord embedding modellen gebruikt, die vaak falen om de nuances van semantiek te vangen.

Recente werken hebben de kracht van het benutten van Large Language Models als tekst encoders aangetoond om betere knooppunt/rand functie representaties te construeren voordat ze worden doorgegeven aan de GNN. Bijvoorbeeld, Chen et al. gebruiken LLM’s zoals GPT-3 om tekstuele knooppunt attributen te encoderen, waarbij aanzienlijke prestatie winst wordt getoond ten opzichte van traditionele woord embeddings op knooppunt classificatie taken.

Verder dan betere tekst encoders, kunnen LLM’s worden gebruikt om aangevulde informatie te genereren uit de oorspronkelijke tekst attributen op een semi-begeleide manier. TAPE genereert potentiële labels/verklaringen voor knooppunten met behulp van een LLM en gebruikt deze als extra aangevulde functies. KEA extracteert termen uit tekst attributen met behulp van een LLM en verkrijgt gedetailleerde beschrijvingen voor deze termen om functies aan te vullen.

Door de kwaliteit en expressiviteit van invoer functies te verbeteren, kunnen LLM’s hun superieure natuurlijke taal begrip capaciteiten overdragen aan GNN’s, waardoor de prestatie op downstream taken wordt verbeterd.