Kunstmatige intelligentie

Multimodale AI evolueert met ChatGPT die zicht krijgt met GPT-4V(ision)

In de voortdurende inspanning om AI meer zoals mensen te maken, hebben de GPT-modellen van OpenAI de grenzen voortdurend verlegd. GPT-4 kan nu prompts van zowel tekst als afbeeldingen accepteren.

Multimodaliteit in generatieve AI geeft de mogelijkheid van een model aan om diverse uitvoer te produceren, zoals tekst, afbeeldingen of audio, op basis van de invoer. Deze modellen, getraind op specifieke gegevens, leren onderliggende patronen om soortgelijke nieuwe gegevens te genereren, waardoor AI-toepassingen worden verrijkt.

Recente vooruitgang in multimodale AI

Een recente opvallende stap in dit veld is te zien met de integratie van DALL-E 3 in ChatGPT, een aanzienlijke upgrade in OpenAI’s tekst-naar-afbeeldingstechnologie. Deze combinatie maakt een soepelere interactie mogelijk waarbij ChatGPT helpt bij het maken van precieze prompts voor DALL-E 3, waardoor gebruikersideeën worden omgezet in levendige AI-gegenereerde kunst. Dus, terwijl gebruikers rechtstreeks kunnen communiceren met DALL-E 3, maakt het hebben van ChatGPT in de mix het proces van het maken van AI-kunst veel gebruikersvriendelijker.

Kijk voor meer informatie over DALL-E 3 en de integratie met ChatGPT hier. Deze samenwerking toont niet alleen de vooruitgang in multimodale AI, maar maakt ook het maken van AI-kunst een fluitje van een cent voor gebruikers.

Google’s health heeft ondertussen Med-PaLM M geïntroduceerd in juni van dit jaar. Het is een multimodale generatief model dat in staat is om diverse biomedische gegevens te coderen en te interpreteren. Dit is bereikt door het fijn afstemmen van PaLM-E, een taalmodel, om te voldoen aan medische domeinen met behulp van een open-source benchmark, MultiMedBench. Deze benchmark bestaat uit meer dan 1 miljoen samples over 7 biomedische gegevenstypen en 14 taken zoals medische vraagbeantwoording en generatie van radiologierapporten.

Verschillende industrieën nemen innovatieve multimodale AI-hulpmiddelen aan om bedrijfsgroei te stimuleren, operaties te stroomlijnen en klantbetrokkenheid te verhogen. Vooruitgang in spraak-, video- en tekst-AI-mogelijkheden zet de groei van multimodale AI in gang.

Bedrijven zoeken naar multimodale AI-toepassingen die in staat zijn om bedrijfsmodellen en -processen te veranderen, waardoor groeimogelijkheden ontstaan binnen het generatieve AI-ecosysteem, van gegevenstools tot opkomende AI-toepassingen.

Na de lancering van GPT-4 in maart, merkten sommige gebruikers een daling in de kwaliteit van de antwoorden over tijd, een zorg die werd geuit door opvallende ontwikkelaars en op de forums van OpenAI. Aanvankelijk werd dit door OpenAI verworpen, maar een latere studie bevestigde het probleem. Het onthulde een daling in de nauwkeurigheid van GPT-4 van 97,6% naar 2,4% tussen maart en juni, wat wijst op een daling in de kwaliteit van de antwoorden met opeenvolgende modelupdates.

De hype rond Open AI’s ChatGPT is nu terug. Het heeft nu een visiefunctie GPT-4V, waardoor gebruikers GPT-4 kunnen laten analyseren van afbeeldingen die door hen worden verstrekt. Dit is de nieuwste functie die voor gebruikers is geopend.

Het toevoegen van afbeeldingsanalyse aan grote taalmodellen (LLM’s) zoals GPT-4 wordt door sommigen gezien als een grote stap vooruit in AI-onderzoek en -ontwikkeling. Dit soort multimodale LLM opent nieuwe mogelijkheden, waardoor taalmodellen verder gaan dan tekst om nieuwe interfaces te bieden en nieuwe soorten taken op te lossen, waardoor nieuwe ervaringen voor gebruikers ontstaan.

De training van GPT-4V was voltooid in 2022, met vroegtijdige toegang in maart 2023. De visuele functie in GPT-4V wordt aangedreven door GPT-4-tech. Het trainingsproces bleef hetzelfde. Aanvankelijk werd het model getraind om het volgende woord in een tekst te voorspellen met een enorme dataset van zowel tekst als afbeeldingen van diverse bronnen, waaronder het internet.

Later werd het fijn afgestemd met meer gegevens, met behulp van een methode genaamd versterking van het leren van menselijke feedback (RLHF), om uitvoer te genereren die door mensen werd bevoroordeeld.

GPT-4 Visiemechanica

GPT-4’s opmerkelijke visuele taalvaardigheden, hoewel indrukwekkend, hebben onderliggende methoden die aan de oppervlakte blijven.

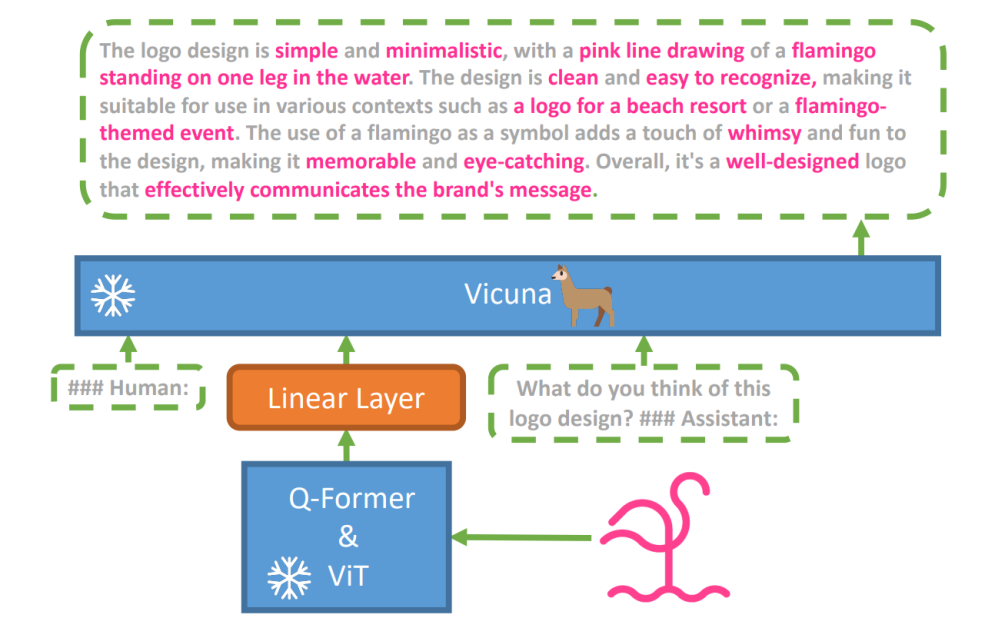

Om deze hypothese te onderzoeken, werd een nieuw visueel-taalmodel geïntroduceerd, MiniGPT-4, met behulp van een geavanceerd LLM genaamd Vicuna. Dit model gebruikt een visuele encoder met vooraf getrainde componenten voor visuele perceptie, waardoor de visuele functies worden uitgelijnd met het Vicuna-taalmodel via een enkele projectielaag. De architectuur van MiniGPT-4 is eenvoudig maar effectief, met de focus op het uitlijnen van visuele en taalfunctionaliteiten om visuele conversatievaardigheden te verbeteren.

MiniGPT-4’s architectuur omvat een visuele encoder met vooraf getrainde ViT en Q-Former, een enkele lineaire projectielaag en een geavanceerd Vicuna-groot taalmodel.

De trend van autoregressieve taalmodellen in visueel-taaltaken is ook toegenomen, waarbij gebruik wordt gemaakt van cross-modale overdracht om kennis te delen tussen taal- en multimodale domeinen.

MiniGPT-4 verbindt de visuele en taaldomeinen door visuele informatie van een vooraf getrainde visuele encoder uit te lijnen met een geavanceerd LLM. Het model gebruikt Vicuna als taaldecoder en volgt een tweestaps trainingsaanpak. Aanvankelijk wordt het getraind op een grote dataset van afbeelding-tekstparen om visueel-taalvaardigheden te begrijpen, gevolgd door fijn afstemmen op een kleinere, hoogwaardige dataset om generatiebetrouwbaarheid en bruikbaarheid te verbeteren.

Om de natuurlijkheid en bruikbaarheid van gegenereerde taal in MiniGPT-4 te verbeteren, ontwikkelden onderzoekers een tweestapsuitlijningsproces, om het gebrek aan adequate visueel-taaluitlijningsdatasets aan te pakken. Zij curateerden een gespecialiseerde dataset voor dit doel.

Aanvankelijk genereerde het model gedetailleerde beschrijvingen van invoerafbeeldingen, waarbij het detail werd verbeterd door het gebruik van een conversatieprompt die was uitgelijnd met het formaat van het Vicuna-taalmodel.

Initiële afbeeldingsbeschrijvingsprompt:

###Human: <Img><ImageFeature></Img>Beschrijf deze afbeelding in detail. Geef zo veel details als mogelijk. Zeg alles wat je ziet. ###Assistant:

Voor gegevensnabewerking werden eventuele inconsistenties of fouten in de gegenereerde beschrijvingen gecorrigeerd met behulp van ChatGPT, gevolgd door handmatige verificatie om een hoge kwaliteit te garanderen.

Tweede-stap fijnafstemmingsprompt:

###Human: <Img><ImageFeature></Img><Instruction>###Assistant:

Deze verkenning opent een venster naar het begrijpen van de mechanismen van multimodale generatieve AI zoals GPT-4, waarbij licht wordt geworpen op hoe visuele en taalmodi effectief kunnen worden geïntegreerd om coherente en contextueel rijke uitvoer te genereren.

Verkennen van GPT-4 Visie

Bepalen van afbeeldingsbronnen met ChatGPT

GPT-4 Visie verhoogt ChatGPT’s vermogen om afbeeldingen te analyseren en hun geografische oorsprong te bepalen. Deze functie verplaatst gebruikersinteracties van alleen tekst naar een combinatie van tekst en visuele elementen, waardoor het een handig hulpmiddel wordt voor degenen die geïnteresseerd zijn in verschillende plaatsen via afbeeldingsgegevens.

Complexere wiskundige concepten

GPT-4 Visie blinkt uit in het onderzoeken van complexe wiskundige ideeën door grafische of met de hand geschreven uitdrukkingen te analyseren. Deze functie fungeert als een nuttig hulpmiddel voor personen die moeilijke wiskundige problemen willen oplossen, waardoor GPT-4 Visie een opvallende hulp is in onderwijs- en academische velden.

Omzetten van handschriftondersteuning naar LaTeX-codes

Een van de opvallende mogelijkheden van GPT-4V is de mogelijkheid om handschriftondersteuning om te zetten in LaTeX-codes. Deze functie is een zegen voor onderzoekers, academici en studenten die vaak handschriftondersteunde wiskundige uitdrukkingen of andere technische informatie moeten omzetten in een digitale indeling. De transformatie van handschrift naar LaTeX breidt de horizon van documentdigitisatie uit en vereenvoudigt het technische schrijfproces.

Extractie van tabelgegevens

GPT-4V toont vaardigheid in het extraheren van gegevens uit tabellen en het beantwoorden van gerelateerde vragen, een essentieel actief voor gegevensanalyse. Gebruikers kunnen GPT-4V gebruiken om door tabellen te bladeren, belangrijke inzichten te verzamelen en vragen op te lossen, waardoor het een robuust hulpmiddel is voor data-analisten en andere professionals.

Visueel aanwijzen begrijpen

De unieke mogelijkheid van GPT-4V om visueel aanwijzen te begrijpen, voegt een nieuwe dimensie toe aan gebruikersinteractie. Door visuele hints te begrijpen, kan GPT-4V vragen beantwoorden met een hogere contextuele begrip.

Maak eenvoudige mock-up-websites met een tekening

Gestimuleerd door deze tweet, probeerde ik een mock-up te maken voor de Unite.AI-website.

Hoewel het resultaat niet helemaal overeenkwam met mijn oorspronkelijke visie, hier is het resultaat dat ik bereikte.

Beperkingen en fouten van GPT-4V(ision)

Om GPT-4V te analyseren, voerde het Open AI-team kwalitatieve en kwantitatieve beoordelingen uit. Kwalitatieve beoordelingen omvatten interne tests en externe expertbeoordelingen, terwijl kwantitatieve beoordelingen modelweigeringen en nauwkeurigheid in verschillende scenario’s maten, zoals het identificeren van schadelijke inhoud, demografische herkenning, privacyproblemen, geolocatie, cybersecurity en multimodale jailbreaks.

Toch is het model niet perfect.

Het paper benadrukt de beperkingen van GPT-4V, zoals onjuiste inferenties en ontbrekende tekst of tekens in afbeeldingen. Het kan hallucineren of feiten verzinnen. In het bijzonder is het niet geschikt voor het identificeren van gevaarlijke stoffen in afbeeldingen, die het vaak verkeerd identificeert.

In medische beeldvorming kan GPT-4V inconsistentie antwoorden geven en ontbreekt het aan kennis van standaardpraktijken, wat kan leiden tot potentieel verkeerde diagnoses.

Onbetrouwbaar voor medische doeleinden (Bron)

Het faalt ook om de nuances van bepaalde haatsymbolen te begrijpen en kan ongepaste inhoud genereren op basis van visuele invoer. OpenAI raadt af om GPT-4V te gebruiken voor kritische interpretaties, vooral in medische of gevoelige contexten.

Samenvatting

Gemaakt met Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

De komst van GPT-4 Visie (GPT-4V) brengt een reeks van interessante mogelijkheden en nieuwe uitdagingen met zich mee. Voordat het werd uitgebracht, is veel moeite gedaan om ervoor te zorgen dat risico’s, vooral met betrekking tot afbeeldingen van personen, grondig zijn onderzocht en geminimaliseerd. Het is indrukwekkend om te zien hoe GPT-4V is geëvolueerd, met veelbelovende resultaten in moeilijke gebieden zoals geneeskunde en wetenschap.

Nu zijn er enkele grote vragen op tafel. Moeten deze modellen bijvoorbeeld in staat zijn om beroemde personen te identificeren op basis van foto’s? Moeten ze een persoons geslacht, ras of gevoelens kunnen raden op basis van een afbeelding? En moeten er speciale aanpassingen worden gemaakt om visueel gehandicapten te helpen? Deze vragen openen een doos met wormen over privacy, eerlijkheid en hoe AI in ons leven past, waar iedereen een mening over zou moeten hebben.