Andersons hoek

Op zoek naar een AI die een hele film kan volgen

AI-modellen verliezen nog steeds het spoor van wie wie is en wat er in een film gebeurt. Een nieuw systeem coördineert gezichtsherkenning en geplande samenvatting, waardoor personages recht worden gehouden en plots coherent zijn over hele films.

Het krijgen van kunstmatige intelligentie om naar Hollywood-stijl films te kijken en ze te begrijpen, lijkt misschien een niche- of marginale onderneming; maar een systeem dat een volledige film van begin tot einde kan bekijken, de voortgang van alle personages kan volgen en bovenop het plot kan blijven, heeft niet alleen een aantal directe toepassingen mogelijk gemaakt die van dergelijke mogelijkheden kunnen profiteren, maar ook een aantal perifere of ongerelateerde uitdagingen, in verschillende domeinen.

De laaghangende vruchten voor filmkijkende AI-modellen zijn recommendersystemen, in streamingplatforms zoals Netflix, Amazon Prime en HBO Max. Een gedetailleerd begrip van plotontwikkelingen en karakteracties maakt een nauwere match mogelijk met de (vaak specieuze) voorkeuren en enthousiasme van kijkers.

Verder maakt een dieper begrip van een film het mogelijk om trefwoorden te genereren en een nauwkeurigere categorisatie, in plaats van het in stand houden van vaak gekopieerde film beschrijvingen die mogelijk decennia geleden zijn geschreven. Dergelijke inzichten kunnen ook het aanwezig zijn van ‘volwassen’ thema’s in een film aan het licht brengen, die niet duidelijk zijn vanuit het dialoog of vanuit de visuals.

Bovendien kunnen oude films in een catalogus verouderde beoordelingen en overzichten hebben; bijvoorbeeld, taal en idiomen die genormaliseerd waren in een film uit de jaren 50 zouden nu veel meer aandacht verdienen. Maar zonder een algemeen begrip van context, verkregen uit het echt volgen van een lange filmnarratief, kunnen dergelijke incidenten worden over- of onderbenadrukt.

Meer in het algemeen kunnen verbeterde filmanalysebenaderingen een grote bijdrage leveren aan het veel bredere probleem van gebeurtenisherkenning, dat dringend nodig is voor innovaties in beveiligingsmonitoring, geautomatiseerde sportcommentaren en samenvattingen van alle soorten, in een enorme range van media.

Daarom is ‘AI-gebaseerde filmkijken’ een verrassend goedingeschreven genre in Computer Vision-literatuur.

Het grote plaatje zien

De nieuwste deelnemer heet MovieTeller – een academische/industriële samenwerking uit China die nieuwe vooruitgang boekt door de verschillende subtaken in de uitdaging over verschillende AI-toepassingen te verdelen die deze uitdagingen passen, in plaats van – zoals vaak het geval is – te proberen om discrete en geëncapsuleerde modellen te trainen die alle nodige taken vanuit een enkele latent ruimte kunnen uitvoeren.

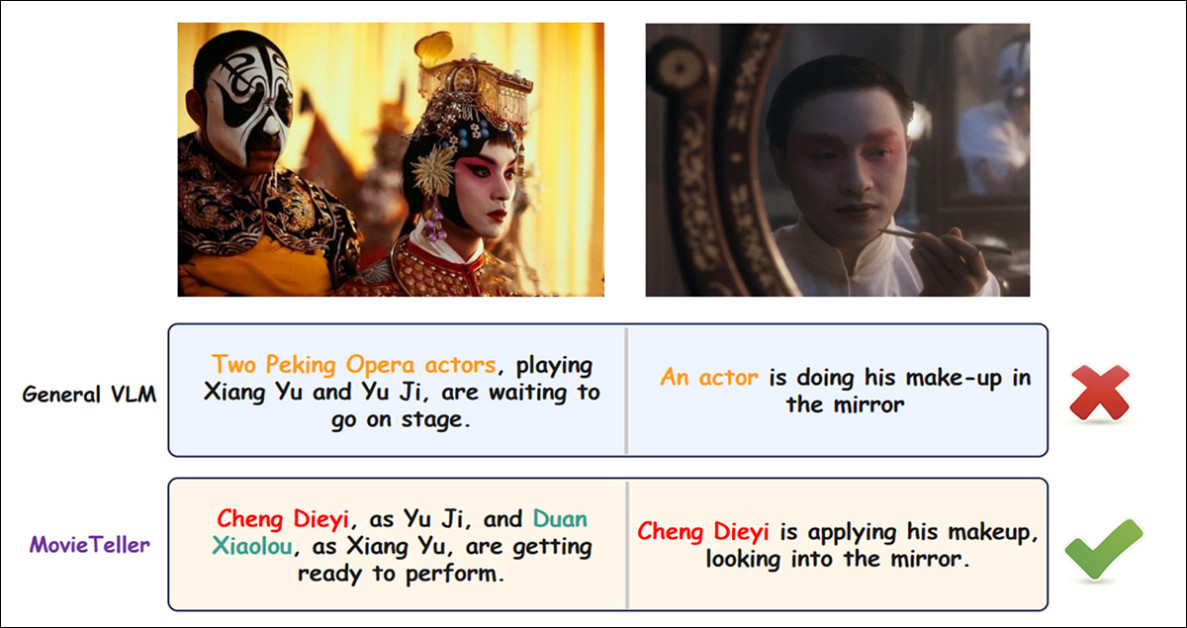

De auteurs observeren dat eerdere Vision-Language Models (VLMs) die met dezelfde taak werden geconfronteerd, niet veel verder zijn gekomen dan enkele frame-analyse; en dat hun gebrek aan context het moeilijk maakt voor dergelijke modellen om personages consistent te identificeren – misschien het meest essentiële kenmerk van een dergelijk systeem:

Het nieuwe systeem, MovieTeller, kan personages in scènes persistent identificeren, dankzij het gebruik van een speciaal gezichtsherkenningssysteem; maar het is de meer omvattende toewijding aan context die het kader in staat stelt om bovenop plotontwikkelingen te blijven. Bron

De auteurs verklaren:

‘Algemene VLMs hebben vaak moeite om specifieke personages te herkennen en consistent te volgen throughout een lange narratief. Ze kunnen een belangrijke protagonist beschrijven als “een man” in één scène en “een persoon” in een andere, zonder de visuele representatie te binden aan een consistente identiteit.’

De auteurs merken op dat omdat Transformers‘ self-attention mechanism gebruik maakt van quadratische complexiteit, het verwerken van elke frame van een volledige film tegelijk te computationeel duur wordt. Als gevolg daarvan tendeerden benaderingen die afhankelijk zijn van uniform frame-sampling of eenvoudige concatenatie naar het breken van de flow van het verhaal, waardoor gefragmenteerde samenvattingen in plaats van een coherente narratief ontstaan.

In plaats daarvan bestaat het nieuwe systeem uit een georkestreerde trainingsvrije pipeline, met speciale tools om gezichtsherkenning en persistentie van geheugen (als personages de narratief van een film verlaten en weer binnenkomen) aan te pakken.

MovieTeller werd getest tegen eerdere benaderingen met 60 volledige films, equivalent aan 10.000 minuten aan beeldmateriaal. In kwantitatieve ablatie-tests en menselijke studies, rapporteren de auteurs, was hun benadering in staat om opvallend te verbeteren ten opzichte van de standaardomgevingen en aannamen die door eerdere systemen werden gebruikt.

Het nieuwe papier heet MovieTeller: Tool-augmenteerde filmSynopsis met ID-consistente progressieve abstractie, en komt van vijf auteurs uit Zhejiang University in Hangzhou, de staat geleide China Media Group, en Watch AI Group* (de laatste twee zijn gevestigd in Beijing).

Methode

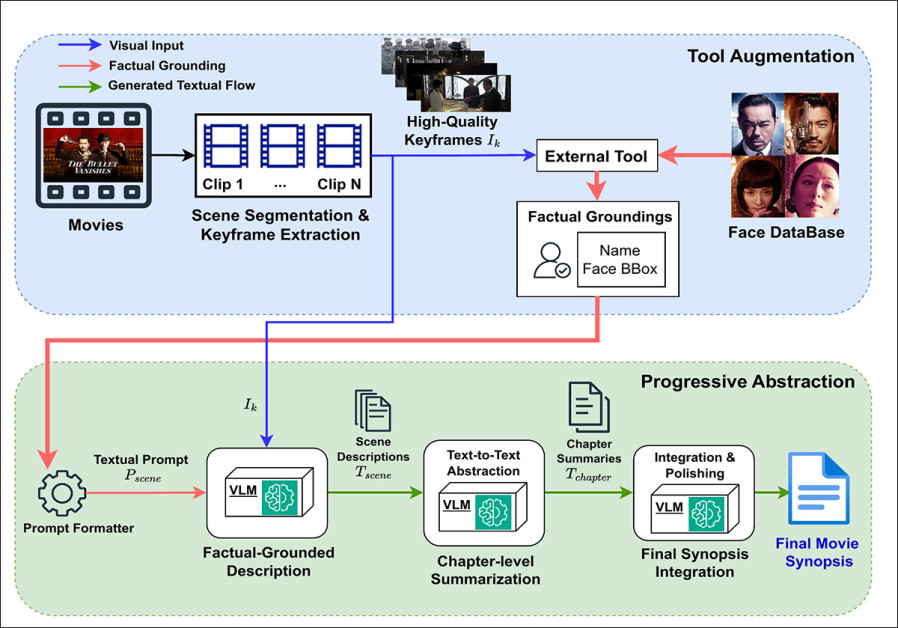

Het MovieTeller-schema bestaat uit drie fasen: scène-segmentatie en keyframe-extractie, die worden afgehandeld via het PySceneDetect-project; Factual-Grounded Scene Description Generation via de aanpassing van de Qwen2.5-VL-7B-Instruct VLM; en progressieve abstractie, die gedetailleerde scène-beschrijvingen condenseert tot hoofdstuk-samenvattingen, en vervolgens tot een finale coherente synopsis – en dit wordt ook uitgevoerd door de Qwen2.5-model:

Overzicht van het MovieTeller-kader: een volledige film wordt eerst gesegmenteerd in scènes en gedistilleerd tot high-quality keyframes; vervolgens injecteert een externe gezichtsherkenningstool feitelijke grondslagen, waardoor karakternamen worden gekoppeld aan begrenzingsboxen, die een Vision-Language Model leiden in het produceren van ID-consistente scène-beschrijvingen. Deze beschrijvingen worden vervolgens progressief geabstraheerd tot hoofdstuk-samenvattingen en geïntegreerd in een coherente finale filmsynopsis.

De initiële fase gebruikt PySceneDetect om de film te breken in discrete scènes, op basis van duidelijke visuele veranderingen, met elke scène vertegenwoordigd door een enkele keyframe.

Echter, niet elke frame maakt een goede samenvattingsafbeelding, aangezien overgangsmomenten, fade-outs en donkere frames later analyse kunnen verwarren. Daarom voert een eenvoudige kwaliteitscontrole een filterrun uit op kandidaatframes, door helderheid en visuele variatie te meten, waardoor alleen informatie-rijke afbeeldingen worden geselecteerd voor beschrijving.

Het gezicht plaatsen

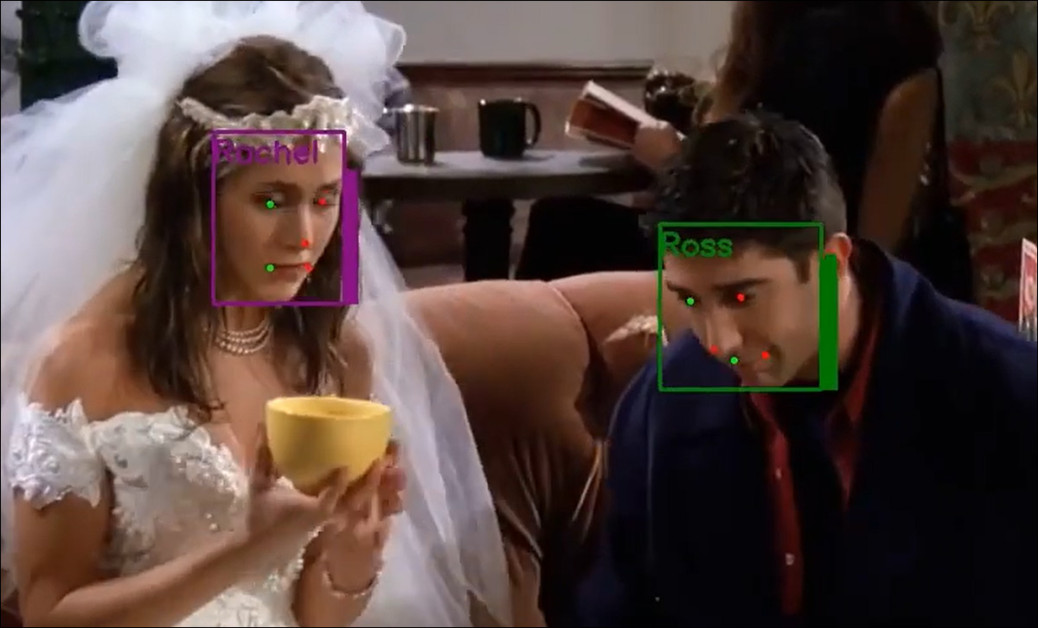

Een gezichtsdatabase werd opgebouwd uit openbaar beschikbare castinformatie†, waarin elke hoofdrolspeler zijn naam naast een numeriek gezicht embedding opslaat. Wanneer een gezicht verschijnt in een keyframe, wordt zijn embedding gematcht tegen de database, en het dichtstbijzijnde resultaat wordt geaccepteerd als het een vertrouwensdrempel overschrijdt. Dit creëert ‘feitelijke grondslagen’, waardoor namen worden gekoppeld aan specifieke begrenzingsboxen.

Voor deze doeleinden wordt InsightFace gebruikt, waardoor een ArcFace loss-gebaseerde herkenningstool wordt gebruikt:

Twee bekende gezichten die goed worden herinnerd door de Additive Angular Margin Loss (ArcFace) initiatief, die op een zeer vergelijkbare manier wordt gebruikt voor het MovieTeller-project. Bron

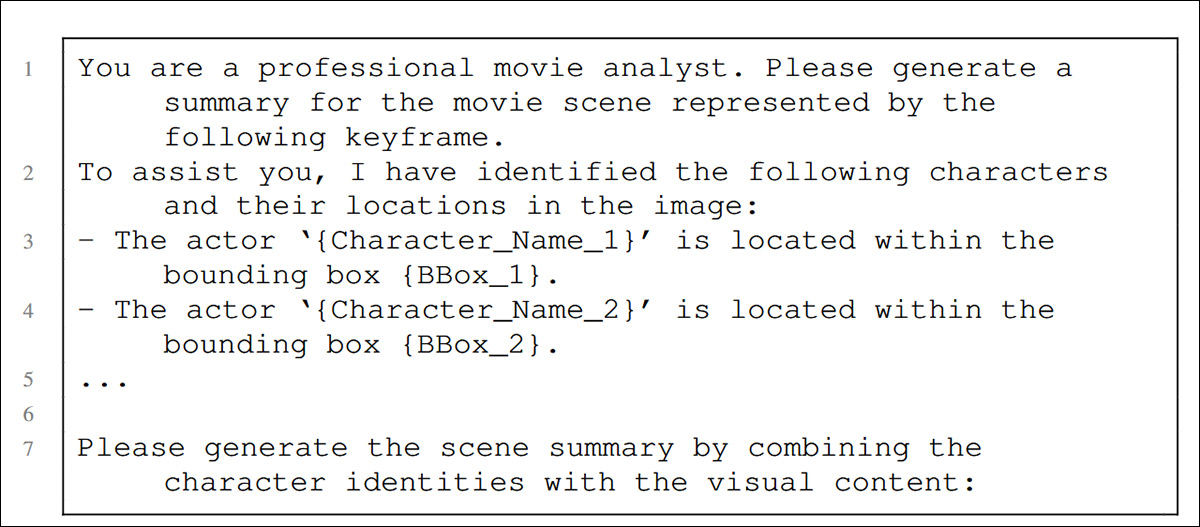

De geannoteerde keyframes worden vervolgens doorgegeven aan het Qwen-model met een prompt die de gedetecteerde personages en hun posities vermeldt:

Aangezien Vision-Language Models een hele speelfilm niet in één keer kunnen absorberen, breekt MovieTeller het materiaal eerst af in scène-beschrijvingen. Deze worden gegroepeerd in opeenvolgende, hoofdstuk-achtige blokken, die vervolgens worden doorgegeven aan Qwen2.5, die elk hoofdstuk samenvat, waardoor plotontwikkelingen, karaktermotivaties en wendingen worden gecomprimeerd, terwijl eerder geverifieerde karakternamen worden behouden.

Deze gecomprimeerde hoofdstuk-samenvattingen worden vervolgens geconcateneerd en teruggegeven aan het model met een nieuwe prompt die een complete synopsis vraagt:

Soortgelijk aan de prompt die om een complete synopsis vraagt, wordt dit voorbeeld gebruikt om scène-beschrijvingen te genereren, waarin expliciet geverifieerde karakternamen en begrenzingsboxen worden geïnjecteerd om het Vision-Language Model te beperken en ID-consistente narratie af te dwingen.

Er wordt aangenomen dat het proces is geslaagd, de finale output moet coherently de narratieve boog van de film weerspiegelen. Dit is een bijzonder moeilijke taak in machine learning, aangezien de variëteit aan mogelijke plot-samenvattingen en de stijl waarin ze kunnen worden gepresenteerd, samen met de benodigde lengte van deze datapunten, het vrijwel onmogelijk maakt om de gebruikelijke ground truth-gebaseerde benaderingen te volgen.

Gegevens en tests

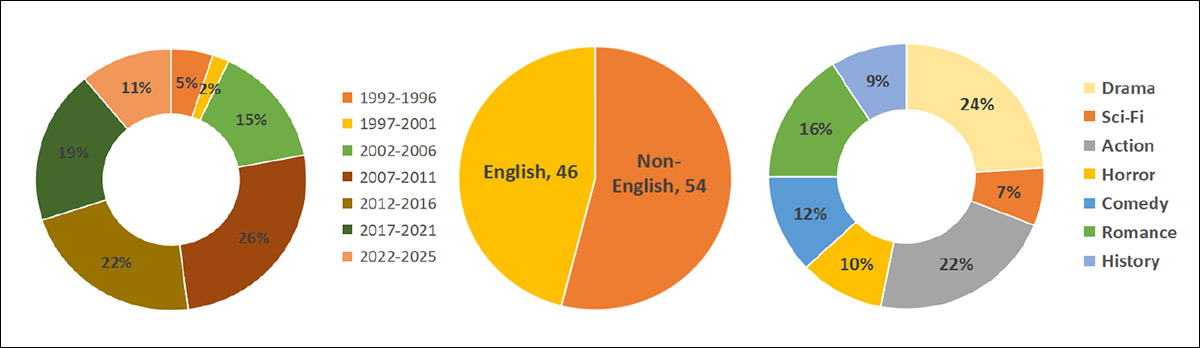

Om het systeem te testen, hebben de auteurs een maatwerk (en bron-onvermeld) dataset van 100 volledige films gecureerd, equivalent aan ongeveer 166 uur aan runtime. De films omvatten Iron Man 3, Farewell My Concubine, Eat Drink Man Woman, en The Chronicles of Narnia. De onderzoekers eisten dat alle opgenomen films een rating van boven de 5,0 op de IMDB hadden:

Dataset-samenstelling over 100 films, met een gebalanceerde tijdelijke dekking van 1992 tot 2025, een lichte meerderheid van niet-Engelstalige titels en een brede genre-spreiding geleid door Drama en Actie, met vertegenwoordiging over Sci-Fi, Horror, Comedy, Romance en Geschiedenis.

De brede range van genres die worden aangepakt (zie grafiek hierboven) was ontworpen om te voorkomen dat er een voorkeur ontstaat voor een bepaald genre.

De gezichtsdatabase voor elke film bestond uit twee foto’s van de hoofdrolspelers – één van een filmstill en één van een gerelateerde publiciteitsfoto.

Geïmplementeerd in Python, werden de tests uitgevoerd op vier NVIDIA A40 GPU’s, elk met 48GB VRAM, en met de eerder genoemde Qwen2.5-variant als het centrale VLM. Ablatie-studies†† werden ook uitgevoerd met alternatieve state-of-the-art-modellen InternVL3-8B en WeThink-Qwen2.5VL-7B.

Het nieuwe kader werd getest tegen twee ablatie††-varianten: een No-Hint baseline, waarin het Vision-Language Model scène-beschrijvingen genereerde van de keyframe alleen, zonder enige tekstuele hints over karakteridentiteiten; en een Name-Only Hint instelling, waarin het model de gedetecteerde karakternamen kreeg, maar niet hun begrenzingsboxen, waardoor de auteurs de specifieke bijdrage van ruimtelijke grondslagen aan identiteitsconsistentie en narratieve coherentie konden isoleren

In termen van metrics, gezien de eerder genoemde moeilijkheid om ground truth-gebaseerde methoden toe te passen op lange plot-samenvattingen, werden standaard n-gram overlap metrics zoals ROUGE en BLEU verlaten ten gunste van BERTScore met F1 score, om semantische gelijkenis te meten tegen een referentie-samenvatting getrokken uit ‘een openbare encyclopedie’.

Ook werd Gemini 2.5 Flash gebruikt om elke samenvatting te scoren voor feitelijke trouw; ID-consistentie en volledigheid; narratieve coherentie en flow; en bondigheid, met scores gemiddeld over dimensies.

Tenslotte werd een menselijke evaluatie van 50 willekeurig geselecteerde samenvattingen uitgevoerd met behulp van een drievoudige gedwongen keuze, waardoor een praktische controle werd uitgevoerd op de geautomatiseerde beoordelingen.

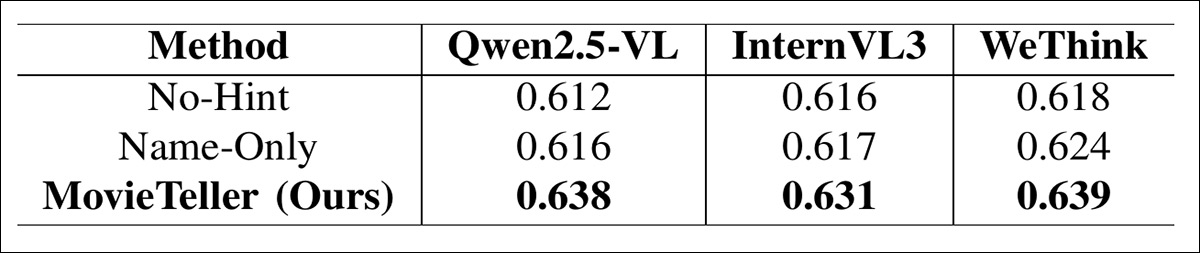

Hieronder zien we BERTScore (F1) resultaten voor de drie backbone-modellen: Qwen2.5-VL, InternVL3 en WeThink. Elk wordt getest in drie configuraties: No-Hint, Name-Only en het volledige MovieTeller-systeem:

BERTScore (F1) vergelijking over drie basis Vision-Language Modellen en drie experimentele instellingen, waarin consistent winst wordt behaald door het toevoegen van karakternamen en verdere verbeteringen wanneer ruimtelijke grondslagen worden toegevoegd, met MovieTeller die de hoogste scores behaalt in alle gevallen.

De auteurs merken op dat het patroon consistent is over alle drie de backbone-modellen: het gebruik van alleen de ruwe keyframe levert de zwakste prestaties op; het toevoegen van karakternamen produceert een bescheiden verbetering; en het combineren van namen met begrenzingsboxen levert de sterkste resultaten op. Hoewel de winst incrementeel is in plaats van dramatisch, behaalt de volledig gefundeerde configuratie de hoogste semantische overeenstemming met de referentie-samenvatting, in elke instelling.

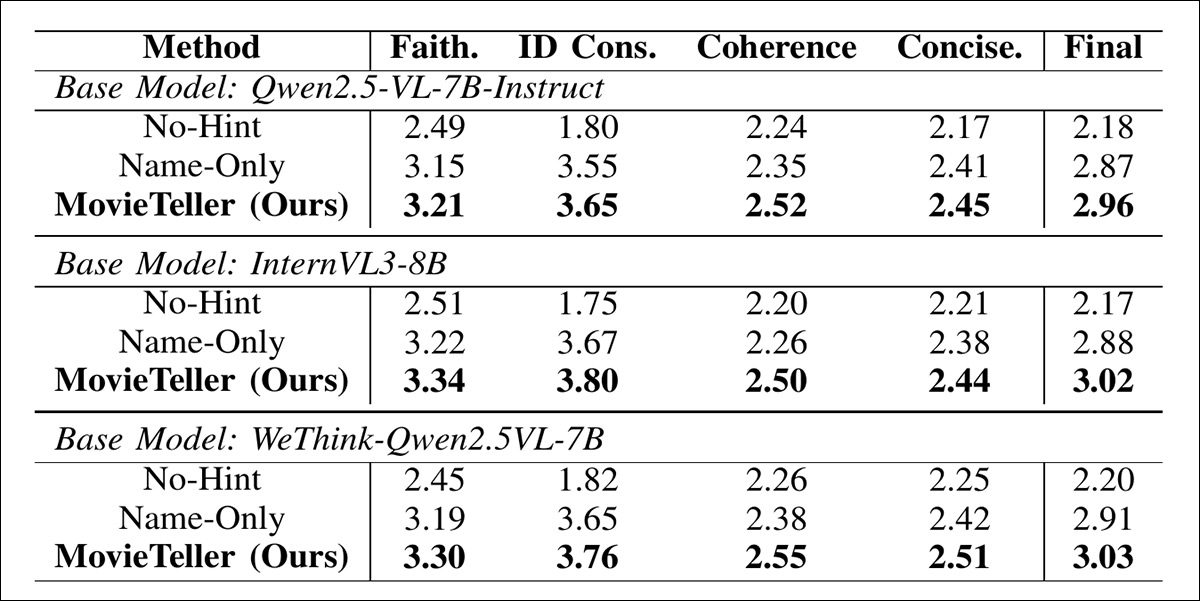

In termen van LLM-gebaseerde evaluatie van narratieve kwaliteit: zoals we zien in de resultaten hieronder, heeft de No-Hint baseline het meeste moeite met identiteitsconsistentie, wat de algehele score naar beneden haalt; maar het toevoegen van namen alleen produceert een opvallende lift, met name op identiteitsgerelateerde dimensies. Echter, het volledige MovieTeller-kader behaalt de hoogste scores over alle drie de backbone-modellen:

LLM-as-a-Judge evaluatie (1–5 schaal) over drie basismodellen, waarin wordt aangetoond dat het toevoegen van karakternamen identiteitsconsistentie en algehele kwaliteit verbetert, terwijl het volledige MovieTeller-kader de hoogste scores behaalt over feitelijke trouw, coherentie, bondigheid en eindbeoordeling.

De sterkste winst wordt behaald in ID-consistentie, en in de eindbeoordeling, wat suggereert dat ruimtelijke grondslagen helpen het model duidelijk te houden wie wat doet als het verhaal zich ontvouwt.

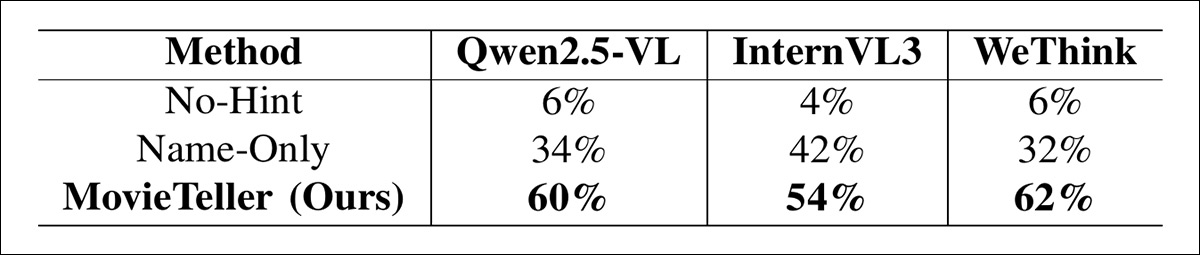

In de menselijke evaluatie van 50 willekeurig geselecteerde samenvattingen, werden deelnemers getoond drie samenvattingen tegelijk, en gevraagd om de beste te selecteren:

Menselijke voorkeurspercentages in een drievoudige gedwongen keuze-evaluatie, waarin wordt aangetoond dat de volledig gefundeerde MovieTeller-samenvattingen het vaakst worden geselecteerd over alle drie de backbone-modellen, waardoor ze beide de No-Hint en Name-Only-varianten aanzienlijk overtreffen.

Tenslotte werd een kwalitatieve test uitgevoerd op de film The Bullet Vanishes (2012):

We kunnen de gehele figuur uit het oorspronkelijke papier niet reproduceren, omdat het erg lang en tekst-dicht is. Verwijzen naar het bronpapier in plaats daarvan.

Hier produceert de No-Hint baseline een vage samenvatting die personages in algemene termen noemt en hun rollen vertroebelt, waardoor de keten van gebeurtenissen moeilijker te volgen is. Het toevoegen van namen alleen verbetert de oppervlakteherinnering, maar de narratief dwaalt nog steeds, met karakterrelaties en motivaties die op een vrij ‘geflattende’ manier worden beschreven.

Omgekeerd houdt de volledig gefundeerde MovieTeller-versie identiteiten stabiel gedurende de hele samenvatting en koppelt acties aan de juiste personages, waardoor het onderzoekplot zich kan ontvouwen met een duidelijker causale structuur. Specifieke spanningen en rol-dynamiek worden behouden in plaats van geabstraheerd, waardoor een samenvatting ontstaat die minder lijkt op een losse schets en meer op een coherente navertelling van de centrale boog van de film:

Deel van de finale vergelijking, die we hier niet volledig kunnen reproduceren, waarin een geabstraheerde en volledige MovieTeller-samenvatting wordt getoond. Verwijzen naar het bronpapier in plaats daarvan.

Conclusie

Hoewel de meeste nieuwe projecten van dit type eindigen in de Computer Vision-literatuur, omvat AI-gegenereerde filmsamenvatting veel andere disciplines en domeinen in machine learning-onderzoek – en het is moeilijk te zeggen welke van deze onbewust de ontbrekende puzzelstuk zal bijdragen; hoewel MovieTeller een stap in de goede richting zet door de taken over passende modules te verdelen in plaats van te hopen om alles discreet in de latent ruimte op te lossen, behoudt het de ‘opgeklopte’ feel die vaak voorafgaat aan een latere, meer elegante oplossing.

* Ik kan deze instelling niet identificeren, zelfs niet na enig zoeken.

† Een zou aannemen dat het iets zoals de IMDB of OMDB is, maar de bron is niet gespecificeerd.

†† Verwijzen naar het bronpapier voor een uitgebreide ablatie, aangezien we alleen ablatie in uitzonderlijke gevallen behandelen. Ik zal opmerken dat de onbehandelde ablatie-studies die hier worden verwezen, de algemene bevindingen van het papier niet ondermijnen.

Eerst gepubliceerd op vrijdag 27 februari 2026