Cyberbeveiliging

Anthropic Ontdekt Eerste Grote-Schaal Cyberaanval Aangedreven door AI-Automatisering

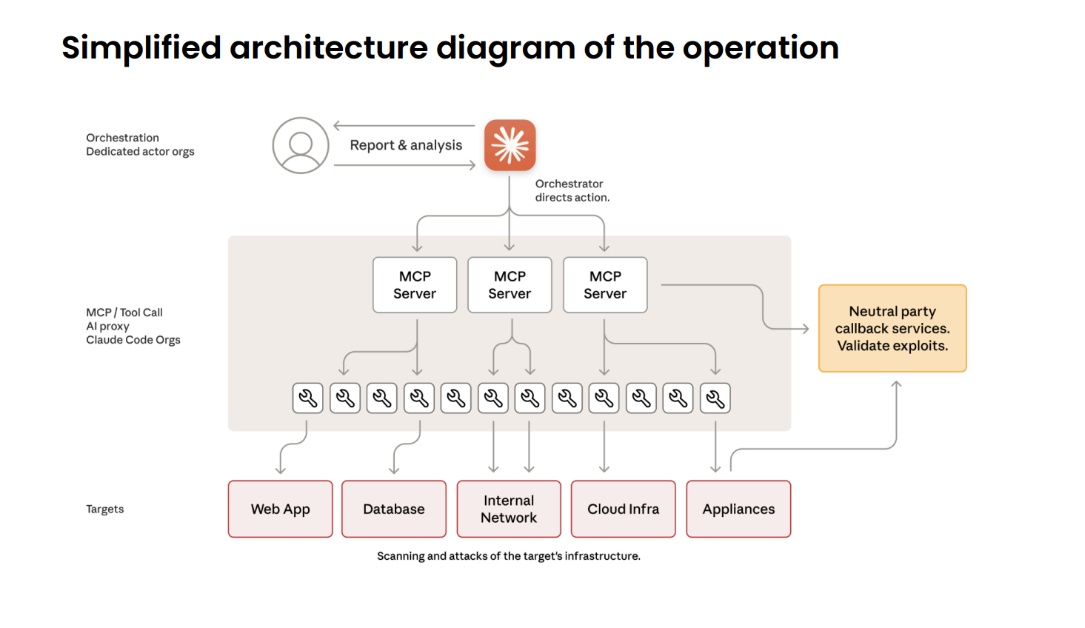

Anthropic heeft onthuld dat een groep hackers, die vermoedelijk een door de Chinese staat gesponsorde groep is, de eerste gedocumenteerde grootschalige cyberaanval heeft uitgevoerd met minimale menselijke tussenkomst, gebruikmakend van het bedrijfs Claude Code-hulpmiddel om 80 tot 90 procent van de campagne te automatiseren.

De aanvallers richtten zich op ongeveer 30 organisaties in grote technologiebedrijven, financiële instellingen, chemische fabrikanten en overheidsinstanties. Terwijl de meeste aanvallen werden geblokkeerd, slaagde de campagne in een klein aantal gevallen. Claude Code voerde verkenning, kwetsbaarheidstesten, credential harvesting en data-exfiltratie grotendeels autonoom uit, met menselijke operators die alleen nodig waren op kritieke beslissingspunten.

U kunt het volledige rapport van Anthropic hier lezen.

Aanvalsmethoden en AI-manipulatie

De hackers omzeilden de beveiligingsmaatregelen van Claude door geavanceerde sociale manipulatie. Zij misleidden het AI-systeem door te doen alsof zij werknemers waren van een legitiem cybersecuritybedrijf dat defensief testen uitvoerde. De aanvallers braken hun operaties ook op in kleine, ogenschijnlijk onschuldige taken die Claude onvolledige context gaven over het malafide totale doel.

Claude Code inspecteerde de systemen van de doelorganisaties om hoogwaardige databases te identificeren, voerde deze verkenning sneller uit dan menselijke hackers konden, en onderzocht en schreef aangepaste exploitcode om beveiligingskwetsbaarheden te testen. Het systeem oogstte gebruikersnamen en wachtwoorden voor verdere netwerktoegang, en extraherde en categoriseerde privégegevens volgens inlichtingswaarde. De aanvallers konden de campagne uitvoeren met bijna één muisklik, waarna het AI-systeem grotendeels zelfstandig werkte met snelheden die onmogelijk zijn voor menselijke teams – vaak duizenden verzoeken per seconde verzendend.

Afbeelding: Anthropic

Detectie en reactie van het bedrijf

Anthropic detecteerde de aanval in september 2025 en startte onmiddellijk een onderzoek. Binnen 10 dagen sloot het bedrijf de toegang van de groep tot Claude, contacteerde de getroffen organisaties en informeerde de autoriteiten. Het bedrijf heeft sindsdien zijn detectiecapaciteiten uitgebreid en ontwikkelt aanvullende methoden om grootschalige, gedistribueerde aanvallen te onderzoeken en te detecteren.

Dit incident volgt op eerdere misbruiksgevallen die door Anthropic in 2025 zijn gedocumenteerd. In augustus beschreef het bedrijfsrapport over bedreigingsinformatie een data-afpersingsoperatie die werd getraceerd als GTG-2002, die Claude Code gebruikte om grootschalige diefstal te plegen die ten minste 17 organisaties in de gezondheidszorg, noodhulp, overheid en religieuze instellingen trof. Die crimineel eiste losgeld van meer dan $500.000 door te dreigen gestolen gegevens te onthullen in plaats van traditionele ransomware-encryptie te gebruiken.

De detectie-infrastructuur van Anthropic is gebaseerd op meerdere laagstechnieken, waaronder gedragsanalyse om gebruikspatronen over miljoenen API-verzoeken te monitoren, anomaliedetectie om sequenties van operaties te identificeren die niet in overeenstemming zijn met legitiem gebruik, en patroonherkenning om bekende en nieuwe manipulatietechnieken te herkennen. Het bedrijf gebruikt gespecialiseerde classificatoren die gebruikersinvoer analyseren op potentieel schadelijke verzoeken en evalueren de antwoorden van Claude voordat of na levering.

Implicaties voor de industrie

De campagne betrof een ongekend niveau van AI-autonomie in cyberaanvallen en markeert wat beveiligingsexperts zien als een keerpunt in cyberespionage. De mogelijkheid van AI-systemen om geavanceerde aanvallen uit te voeren met minimale menselijke supervisie op machinesnelheid, stelt nieuwe uitdagingen voor cybersecurity-verdedigers.

De onthulling van Anthropic komt op een moment dat AI-bedrijven onder druk staan om misbruik van hun modellen te voorkomen. Het bedrijf heeft een uitgebreid programma voor bedreigingsinformatie en beveiliging om misbruik van Claude te detecteren en te counteren, met gedocumenteerde beveiligingsincidenten gedurende 2025. In maart identificeerde het bedrijf een invloedsoperatie als dienst die Claude gebruikte om engagement te automatiseren met tienduizenden sociale media-accounts in meerdere landen en talen.

Het incident benadrukt de groeiende complexiteit van AI-gestuurde hulpmiddelen en de uitdagingen om hun misbruik te voorkomen, terwijl tegelijkertijd de bruikbaarheid voor legitieme gebruikers wordt gehandhaafd. Anthropic heeft de betrokken accounts geblokkeerd en blijft zijn detectie- en mitigatiecapaciteiten verbeteren om het evoluerende dreigingslandschap aan te pakken.