Kunstmatige intelligentie

AI-afbeelding matting die scènes begrijpt

In de extra documentaire die de DVD-uitgave van Alien3 (1992) uit 2003 begeleidt, herinnerde de legendarische visuele effectenman Richard Edlund zich met afgrijzen de ‘sumoworstelen’ van photochemische matte-extractie die het visuele effectenwerk tussen de late jaren dertig en de late jaren tachtig domineerde. Edlund beschreef de hit-and-miss-aard van het proces als ‘sumoworstelen’, in vergelijking met de digitale blauw/groene schermtechnieken die begin jaren negentig de overhand kregen (en hij is daar naar teruggekeerd).

Het extraheren van een voorgrondelement (zoals een persoon of een ruimteschipmodel) uit een achtergrond, zodat het uitgeknipte beeld in een achtergrondplaat kan worden samengesteld, werd oorspronkelijk bereikt door het voorgrondelement tegen een uniform blauwe of groene achtergrond te filmen.

Arbeidsintensieve photochemische extractieprocessen voor een VFX-shot van ILM voor ‘Return of the Jedi’ (1983). Source: https://www.youtube.com/watch?v=qwMLOjqPmbQ

In de resulterende beelden zou de achtergrondkleur vervolgens chemisch worden geïsoleerd en gebruikt als sjabloon om het voorgrondelement (of persoon) in een optische printer opnieuw af te drukken als een ‘zwevend’ object in een overigens transparante filmcel.

Het proces stond bekend als kleurscheidingsoverlaging (CSO) – hoewel deze term uiteindelijk meer geassocieerd zou raken met de grove ‘Chromakey’ video-effecten in lager begrote televisie-uitzendingen van de jaren zeventig en tachtig, die met analoge in plaats van chemische of digitale middelen werden bereikt.

Een demonstratie van Color Separation Overlay in 1970 voor de Britse kindershow ‘Blue Peter’. Source: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

In elk geval, of het nu voor film- of video-elementen was, kon daarna de geëxtraheerde beelden in andere beelden worden ingevoegd.

Hoewel Disney’s opvallend duurdere en propriëtaire natriumdampproces (dat specifiek op geel was afgestemd en ook werd gebruikt voor Alfred Hitchcocks horrorfilm The Birds uit 1963) betere definities en scherpe mattes opleverde, bleef photochemische extractie een arbeidsintensief en onbetrouwbaar proces.

Disney’s propriëtaire natriumdampextractieproces vereiste achtergronden bij de gele kant van het spectrum. Hier wordt Angela Lansbury aan draden opgehangen tijdens de productie van een VFX-beeld voor ‘Bedknobs and Broomsticks’ (1971). Source

Verder dan digitale matting

In de jaren negentig zorgde de digitale revolutie voor het wegvallen van de chemicaliën, maar niet voor de behoefte aan groene schermen. Het was nu mogelijk om de groene (of welke) achtergrondkleur te verwijderen door simpelweg naar pixels binnen een tolerantiebereik van die kleur te zoeken in pixel-editingsoftware zoals Photoshop, en een nieuwe generatie video-compositie suites die automatisch de gekleurde achtergronden konden uitschakelen. Bijna overeenkomstig werden zestig jaar van de optische printindustrie naar de geschiedenis verwezen.

De laatste tien jaar van GPU-geaccelereerd computer vision onderzoek brengt matte-extractie naar een derde tijdperk, waarin onderzoekers worden opgedragen systemen te ontwikkelen die hoge kwaliteit mattes kunnen extraheren zonder de behoefte aan groene schermen. Alleen al op Arxiv zijn papers gerelateerd aan innovaties in machine learning-gebaseerde voorgrondextractie een wekelijks fenomeen.

Ons in beeld brengen

Dit brandpunt van academische en industriële interesse in AI-extractie heeft al impact op de consumentenruimte: grove maar werkende implementaties zijn ons allen vertrouwd in de vorm van Zoom en Skype filters die onze woonkamers kunnen vervangen door tropische eilanden, enz., in videoconferenties.

Hoewel de beste mattes nog steeds een groen scherm vereisen, zoals Zoom aangaf op woensdag.

Links, een man voor een groen scherm, met goed geëxtraheerd haar via Zoom’s Virtual Background-functie. Rechts, een vrouw voor een normale huiskamersituatie, met haar geëxtraheerd via algoritmes, minder nauwkeurig, en met hogere rekenvereisten. Source: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

Een verder artikel van het Zoom Support-platform waarschuwt dat non-groen schermextractie ook meer rekenkracht in het opnameapparaat vereist.

De noodzaak om het uit te knippen

Verbeteringen in kwaliteit, draagbaarheid en bronbesparing voor ‘in het wild’ matte-extractiesystemen (d.w.z. het isoleren van mensen zonder de behoefte aan groene schermen) zijn relevant voor veel meer sectoren en activiteiten dan alleen videoconferentiefilters.

Voor datasetontwikkeling biedt verbeterde gezichts-, hoofd- en lichaamsherkenning de mogelijkheid om te garanderen dat extrinsieke achtergrondelementen niet worden getraind in computer vision modellen van menselijke onderwerpen; nauwkeurigere isolatie zou semantische segmentatie technieken aanzienlijk verbeteren die zijn ontworpen om domeinen te onderscheiden en te assimileren (d.w.z. ‘kat’, ‘persoon’, ‘boot’), en VAE en transformer-gebaseerde beeldsynthesesystemen zoals OpenAI’s nieuwe DALL-E 2; en betere extractiealgoritmes zouden de behoefte aan dure handmatige rotoscoping in dure VFX-pijpleidingen verminderen.

Feitelijk maakt de opkomst van multimodale (meestal tekst/afbeelding) methodologieën, waarin een domein zoals ‘kat’ zowel als afbeelding als met geassocieerde tekstverwijzingen wordt gecodeerd, al inroads in beeldverwerking. Een recent voorbeeld is de Text2Live architectuur, die multimodale (tekst/afbeelding) training gebruikt om video’s te maken van, onder andere, kristallen zwanen en glazen giraffen.

Scene-Aware AI Matting

Een aanzienlijk deel van het onderzoek naar AI-gebaseerde automatische matting heeft zich gericht op grensherkenning en evaluatie van pixel-gebaseerde groeperingen binnen een afbeelding of video-frame. Nieuw onderzoek uit China biedt echter een extractiepijplijn die de afbakening en mattekwaliteit verbetert door tekstgebaseerde beschrijvingen van een scène te benutten (een multimodale benadering die de afgelopen 3-4 jaar aan populariteit heeft gewonnen in de computer vision onderzoekssector), en claimt op verschillende manieren verbeteringen ten opzichte van eerdere methoden te hebben behaald.

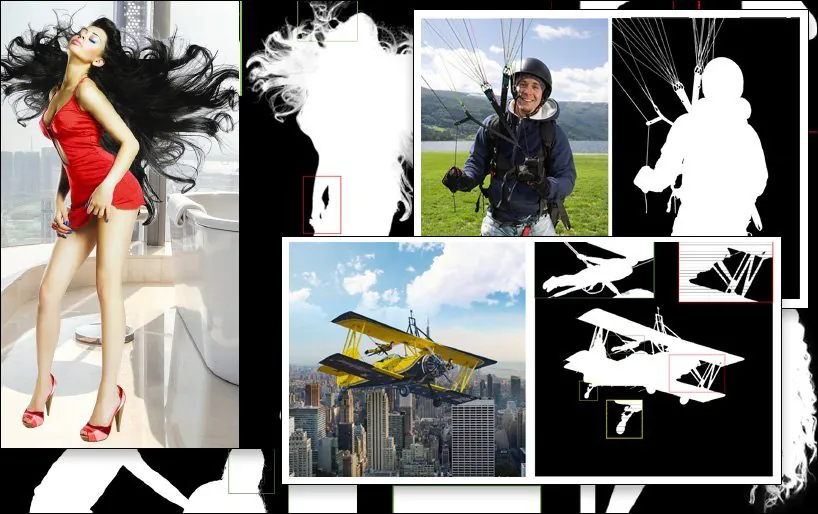

Een voorbeeld van SPG-IM-extractie (laatste afbeelding, rechtsonder), in vergelijking met concurrerende eerdere methoden. Source: https://arxiv.org/pdf/2204.09276.pdf

De uitdaging voor het extractieonderzoekssector is om workflows te produceren die een minimum aan handmatige annotatie en menselijke interventie vereisen – ideaal, geen. Behalve de kostenimplicaties, merken de onderzoekers van het nieuwe artikel op dat annotaties en handmatige segmentaties die door uitbesteedde crowdworkers over verschillende culturen heen worden uitgevoerd, ertoe kunnen leiden dat afbeeldingen op verschillende manieren worden gelabeld of gesegmenteerd, waardoor inconsistent en onbevredigende algoritmes ontstaan.

Een voorbeeld hiervan is de subjectieve interpretatie van wat een ‘voorgrondelement’ definieert:

Uit het nieuwe artikel: eerdere methoden LFM en MODNet (‘GT’ staat voor Ground Truth, een ‘ideale’ resultaat dat vaak handmatig of met niet-algoritme methoden wordt behaald), hebben verschillende en verschillend effectieve definities van voorgrondinhoud, terwijl de nieuwe SPG-IM-methode ‘near content’ beter afbakent via scènecontext.

Om dit aan te pakken, hebben de onderzoekers een tweestaps pijplijn ontwikkeld met de naam Situational Perception Guided Image Matting (SPG-IM). De tweestaps encoder/decoder architectuur bestaat uit Situational Perception Distillation (SPD) en Situational Perception Guided Matting (SPGM).

Eerst wordt SPD voorgetraind met visueel-tekstuele featuretransformaties, waardoor captions worden gegenereerd die zijn aangepast aan de bijbehorende afbeeldingen. Vervolgens wordt de voorspelling van de voorgrondmasker mogelijk gemaakt door de pijplijn te verbinden met een novate saliency predictie techniek.

Vervolgens produceert SPGM een geschatte alfa-matte op basis van de ruwe RGB-afbeeldingsinvoer en het gegenereerde masker dat in de eerste module is verkregen.

Het doel is situational perception guidance, waarbij het systeem een contextueel begrip heeft van wat de afbeelding bestaat uit, waardoor het bijvoorbeeld de uitdaging van het extraheren van complex haar van een achtergrond tegen bekende kenmerken van een dergelijke specifieke taak kan kaderen.

In het onderstaande voorbeeld begrijpt SPG-IM dat de kabels inherent zijn aan een ‘parachute’, waar MODNet deze details niet behoudt of definieert. Evenzo wordt bovenaan de complete structuur van de speeltoestellen willekeurig verloren in MODNet.

Het nieuwe artikel heet Situational Perception Guided Image Matting en komt van onderzoekers bij het OPPO Research Institute, PicUp.ai en Xmotors.

Intelligent Automated Mattes

SPG-IM biedt ook een Adaptive Focal Transformation (AFT) Refinement Network dat lokale details en globale context afzonderlijk kan verwerken, waardoor ‘intelligente mattes’ mogelijk worden.

Het begrijpen van scènecontext, in dit geval ‘meisje met paard’, kan mogelijk het extraheren van de voorgrond gemakkelijker maken dan eerdere methoden.

Het artikel zegt:

‘We geloven dat visuele representaties van de visueel-tekstuele taak, bijv. afbeeldingsonderschriften, zich richten op meer semantisch omvattende signalen tussen a) object naar object en b) object naar de omgevingsomgeving om beschrijvingen te genereren die zowel globale informatie als lokale details kunnen omvatten. Bovendien is, in vergelijking met de dure pixelannotatie van beeldmatting, tekstlabels kunnen worden verzameld tegen een zeer lage kosten.’

De SPD-tak van de architectuur wordt gezamenlijk voorgetraind met de University of Michigan’s VirTex transformer-gebaseerde tekstdecoder, die visuele representaties leert van semantisch dichte onderschriften.

VirTex traint gezamenlijk een ConvNet en Transformers via afbeelding-onderschrift paren, en transfereert de verkregen inzichten naar downstream visietaken zoals objectdetectie. Source: https://arxiv.org/pdf/2006.06666.pdf

Onder andere tests en ablatie studies testten de onderzoekers SPG-IM tegen state-of-the-art trimap-gebaseerde methoden Deep Image Matting (DIM), IndexNet, Context-Aware Image Matting (CAM), Guided Contextual Attention (GCA) , FBA, en Semantic Image Mapping (SIM).

Andere eerdere kaders die werden getest, waren trimap-vrije benaderingen LFM, HAttMatting, en MODNet. Voor een eerlijke vergelijking werden de testmethoden aangepast op basis van de verschillende methodologieën; waar code niet beschikbaar was, werden de technieken van het artikel gereproduceerd op basis van de beschreven architectuur.

Het nieuwe artikel zegt:

‘Onze SPG-IM overtreft alle concurrerende trimap-vrije methoden ([LFM], [HAttMatting], en [MODNet]) met een grote marge. Bovendien toont ons model ook opmerkelijke superioriteit ten opzichte van de state-of-the-art (SOTA) trimap-gebaseerde en masker-geleide methoden in termen van alle vier de metrics over de openbare datasets (d.w.z. Composition-1K, Distinction-646, en Human-2K), en onze Multi-Object-1K benchmark.’

En gaat verder:

‘Het kan duidelijk worden waargenomen dat onze methode fijne details (bijv. haarpunten, transparante textures, en grenzen) behoudt zonder de leiding van een trimap. Bovendien, in vergelijking met andere concurrerende trimap-vrije modellen, kan onze SPG-IM beter globale semantische volledigheid behouden.’

Publicatie op 24 april 2022.