人工知能

安定したビデオ拡散: 大規模データセットへの潜在的なビデオ拡散モデル

ジェネレーティブAIは、長い間AIコミュニティを牽引してきており、特に拡散モデルを使用したジェネレーティブ画像モデリングの分野における進歩は、ジェネレーティブビデオモデルの進歩に大きく貢献しており、研究だけでなく、実際のアプリケーションにも大きな影響を与えています。従来、ジェネレーティブビデオモデルは、スクラッチからトレーニングされるか、事前トレーニングされた画像モデルから部分的にまたは完全にファインチューンされることが多く、画像とビデオのデータセットの混合に基づいてトレーニングされます。

ジェネレーティブビデオモデルの進歩をさらに推進するために、この記事では、安定したビデオ拡散モデルについて説明します。これは、高解像度の画像からビデオやテキストからビデオのコンテンツを生成できる潜在的なビデオ拡散モデルです。2D画像の合成にトレーニングされた潜在的な拡散モデルが、時間層を追加し、小規模な高品質ビデオのデータセットでモデルをファインチューンすることで、ジェネレーティブビデオモデルの能力と効率をどのように向上させたかについて説明します。また、安定したビデオ拡散モデルのアーキテクチャと動作について深く掘り下げ、さまざまなメトリックでそのパフォーマンスを評価し、ビデオ生成のための現在の最先端フレームワークと比較します。では、始めましょう。

安定したビデオ拡散モデルとジェネレーティブビデオモデル:導入

ほぼ無限の可能性を持つジェネレーティブAIは、AIおよびMLの実践者にとって研究の主な対象となっています。近年、ジェネレーティブ画像モデルの効率とパフォーマンスが急速に進歩し、ジェネレーティブビデオモデルの進歩にもつながり、実用性と実際のアプリケーションが向上しました。ただし、ジェネレーティブビデオモデルの能力を向上させることを目指す多くの研究は、主に時間的および空間的な層の配置に焦点を当てており、ジェネレーティブモデルの結果にデータの選択が与える影響を調査することに対する関心は低いです。

ジェネレーティブ画像モデルの進歩により、研究者は、トレーニングデータの分布がジェネレーティブモデルのパフォーマンスに大きな影響を与えることを発見しました。さらに、研究者は、大規模で多様なデータセットでジェネレーティブ画像モデルを事前トレーニングし、それを小規模で高品質のデータセットでファインチューンすることで、パフォーマンスが大幅に向上することを発見しました。従来、ジェネレーティブビデオモデルは、成功したジェネレーティブ画像モデルの知見を実装していますが、データとトレーニング戦略の影響を調査する研究はまだ行われていません。安定したビデオ拡散モデルは、データの選択に特に焦点を当てて、ジェネレーティブビデオモデルの能力を向上させることを目指しています。

最近のジェネレーティブビデオモデルは、拡散モデルやテキスト条件付け/画像条件付けアプローチを使用して、複数の一貫したビデオまたは画像フレームを合成します。拡散モデルは、反復的な精緻化プロセスを実装することで、ノイズのあるサンプルから正常な分布を学習する能力で知られており、高解像度ビデオやテキストから画像の合成で望ましい結果をもたらしてきました。同様の原理を核に、安定したビデオ拡散モデルは、ビデオデータセットとジェネレーティブアドバーサリアルネットワーク(GAN)やオートレグレッシブモデルを使用して、潜在的なビデオ拡散モデルをトレーニングします。

安定したビデオ拡散モデルは、固定されたアーキテクチャと固定されたトレーニング戦略を使用し、データのキュレーションの影響を評価するという、従来のジェネレーティブビデオモデルとは異なる戦略を採用しています。安定したビデオ拡散モデルは、ジェネレーティブビデオモデリングの分野に以下の貢献を行うことを目指しています。

- ジェネレーティブビデオモデルで使用する高品質のデータセットを作成するための体系的なデータキュレーション手法を提示します。

- 画像からビデオやテキストからビデオのコンテンツを生成するための最先端モデルをトレーニングします。

- モデルの3D理解と運動の強い先入観を調査するためのドメイン固有の実験を実施します。

安定したビデオ拡散モデルは、潜在的なビデオ拡散モデルの知見とデータキュレーション手法をその基礎に実装しています。

潜在的なビデオ拡散モデル

潜在的なビデオ拡散モデル(Video-LDM)は、主なジェネレーティブモデルを計算コストの低い潜在的な空間でトレーニングするアプローチを採用しています。多くのVideo-LDMは、事前トレーニングされたテキストから画像のモデルに時間混合層を追加したアーキテクチャを実装しています。結果として、多くのビデオ潜在的な拡散モデルは、時間層のみをトレーニングするか、トレーニングプロセスをスキップします。安定したビデオ拡散モデルは、フレームワーク全体をファインチューンする点で異なります。さらに、テキストからビデオのデータを合成するために、安定したビデオ拡散モデルは直接テキストプロンプトに条件付けられ、結果は、生成されたフレームワークが多視点シンセシスまたは画像からビデオのモデルに容易にファインチューンできることを示しています。

データキュレーション

データキュレーションは、安定したビデオ拡散モデルの重要なコンポーネントであり、ジェネレーティブモデル全般に不可欠です。パフォーマンスを向上させるために、大規模なモデルを大規模なデータセットで事前トレーニングする必要があります。データキュレーションは、効率的な言語-画像表現を活用することで、ジェネレーティブ画像モデルで成功裏に実装されてきましたが、ジェネレーティブビデオモデルの開発におけるデータキュレーションについての議論はまだ行われていません。ジェネレーティブビデオモデルのデータキュレーションには、開発者が直面するいくつかの課題があります。これらの課題に対処するために、安定したビデオ拡散モデルは3段階のトレーニング戦略を実装し、結果の向上とパフォーマンスの向上を実現しています。

高品質ビデオシンセシスのためのデータキュレーション

前述のように、安定したビデオ拡散モデルは3段階のトレーニング戦略を実装し、結果の向上とパフォーマンスの向上を実現しています。ステージIは、2Dテキストから画像の拡散モデルを使用する画像事前トレーニングステージです。ステージIIは、ビデオ事前トレーニングステージであり、大量のビデオデータでフレームワークをトレーニングします。最後に、ステージIIIは、ビデオファインチューニングステージであり、モデルを小規模な高品質のビデオのサブセットで改良します。

しかし、安定したビデオ拡散モデルがこれらの3つのステージを実装する前に、データを処理して注釈付けることが重要です。なぜなら、これはステージIIまたはビデオ事前トレーニングステージの基礎となり、ジェネレーティブビデオモデルの最適な出力を確保する上で重要な役割を果たします。最大の効率を確保するために、フレームワークは最初に、3つの異なるFPS(フレーム秒)レベルでカスケードカット検出パイプラインを実装します。このパイプラインの必要性は、以下の画像で示されています。

次に、安定したビデオ拡散モデルは、3つの異なる合成キャプション付け方法を使用して各ビデオクリップを注釈付けします。以下の表は、安定した拡散フレームワークで使用されるデータセットを、フィルタリングプロセスの前後で比較しています。

ステージI:画像事前トレーニング

安定したビデオ拡散モデルの3段階パイプラインの最初のステージは画像事前トレーニングであり、これを実現するために、初期の安定したビデオ拡散モデルのフレームワークは、事前トレーニングされた画像拡散モデルであるStable Diffusion 2.1モデルに対して基礎付けられ、より強力な視覚表現を提供します。

ステージII:ビデオ事前トレーニング

2段目のステージはビデオ事前トレーニングステージであり、多モーダルジェネレーティブ画像モデルのデータキュレーションは、より良い結果と効率の向上につながるという知見に基づいています。しかし、ジェネレーティブビデオモデルの場合は、不要なサンプルをフィルタリングするための強力なオフザシェルフ表現が不足しているため、安定したビデオ拡散モデルは、適切なデータセットを作成するための入力信号として人間の好みを使用しています。以下の図は、フレームワークのパフォーマンスを向上させるために、キュレーションデータセットで事前トレーニングすることの正の影響を示しています。

具体的には、フレームワークは、LVDモデルのランキングを考慮して、さまざまな方法で潜在的なビデオ拡散モデルのサブセットをキュレーションします。さらに、安定したビデオ拡散フレームワークは、キュレーションデータセットでフレームワークをトレーニングすることで、パフォーマンスが向上すること、および拡散モデル全般のパフォーマンスが向上することを発見しています。さらに、データキュレーション戦略は、より大規模で関連性が高く、実用的であるデータセットでも機能します。以下の図は、フレームワークのパフォーマンスを向上させるために、キュレーションデータセットで事前トレーニングすることの正の影響を示しています。

ステージIII:高品質ファインチューニング

ステージIIまで、安定したビデオ拡散フレームワークは、ビデオ事前トレーニング前のパフォーマンスの向上に焦点を当てていましたが、3段目のステージでは、ビデオの高品質ファインチューニング後のフレームワークのパフォーマンスの最適化に焦点を当てています。ステージIIIでは、フレームワークは潜在的な画像拡散モデルのトレーニング技術を利用し、トレーニング例の解像度を増やします。このアプローチの有効性を分析するために、フレームワークは、初期化のみが異なる3つの同一モデルと比較します。最初の同一モデルは、重みを初期化し、ビデオトレーニングプロセスをスキップしますが、残りの2つの同一モデルは、他の潜在的なビデオモデルの重みから初期化されます。

結果と発見

安定したビデオ拡散フレームワークが実際のタスクでどのように実行されるか、および現在の最先端フレームワークと比較してどのように実行されるかを見てみましょう。安定したビデオ拡散フレームワークは、最適なデータアプローチを使用してベースモデルをトレーニングし、次にファインチューニングを実行して、各タスクを実行するための最先端モデルを生成します。

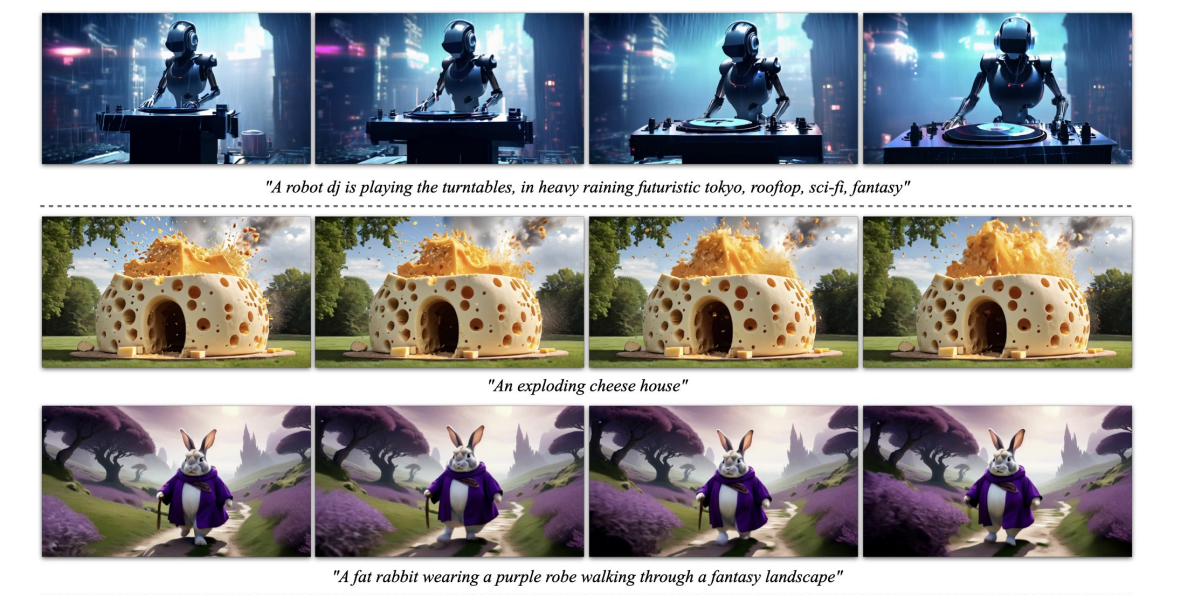

上の画像は、フレームワークによって生成された高解像度の画像からビデオのサンプルを表しています。以下の図は、フレームワークが高品質のテキストからビデオのサンプルを生成する能力を示しています。

事前トレーニング済みベースモデル

前述のように、安定したビデオ拡散モデルはStable Diffusion 2.1フレームワークに基づいています。最近の発見によると、画像拡散モデルをトレーニングする際には、画像の解像度を向上させるために、ノイズスケジュールを採用し、ノイズを増やすことが重要であることがわかりました。このアプローチにより、安定したビデオ拡散ベースモデルは強力な運動表現を学習し、ゼロショット設定でのテキストからビデオの生成において、ベースラインモデルを上回ります。結果は以下の表に示されています。

フレーム補間とマルチビュー生成

安定したビデオ拡散フレームワークは、マルチビューデータセットで画像からビデオのモデルをファインチューンして、オブジェクトの新しいビューを生成します。このモデルは、SVD-MVまたは安定したビデオ拡散マルチビューモデルと呼ばれます。元のSVDモデルは、2つのデータセットを使用してファインチューンされ、入力として単一の画像を受け取り、出力として画像のシーケンスを生成します。

以下の画像からわかるように、安定したビデオ拡散マルチビューフレームワークは、スクラッチマルチビューフレームワークと同等のパフォーマンスを発揮し、SVD-MVが元のSVDフレームワークからの知見を活用してマルチビュー画像生成で優れた結果を得る能力を示しています。さらに、結果は、SVDフレームワークからファインチューンされたモデルと同様に、モデルを比較的少ないイテレーションで実行することで、最適な結果が得られることを示しています。

上の図では、左側にメトリックが示されています。安定したビデオ拡散マルチビューフレームワークは、Scratch-MVとSD2.1マルチビューフレームワークを上回っていることがわかります。2番目の画像は、トレーニングイテレーションの数がSVD-MVフレームワークの全体的なパフォーマンスに与える影響を示しています。SVD-MVフレームワークは、Clipスコアで安定した結果を示しています。

最終的な考え

この記事では、安定したビデオ拡散について説明しました。これは、高解像度の画像からビデオやテキストからビデオのコンテンツを生成できる潜在的なビデオ拡散モデルです。安定したビデオ拡散モデルは、固定されたアーキテクチャと固定されたトレーニング戦略を使用し、データのキュレーションの影響を評価するという、従来のジェネレーティブビデオモデルとは異なる戦略を採用しています。2D画像の合成にトレーニングされた潜在的な拡散モデルが、時間層を追加し、小規模な高品質ビデオのデータセットでモデルをファインチューンすることで、ジェネレーティブビデオモデルの能力と効率をどのように向上させたかについて説明しました。また、安定したビデオ拡散モデルのアーキテクチャと動作について深く掘り下げ、さまざまなメトリックでそのパフォーマンスを評価し、ビデオ生成のための現在の最先端フレームワークと比較しました。

さらに、安定したビデオ拡散フレームワークは、3つの異なるビデオモデルトレーニングステージを実装し、それぞれを独立して分析して、フレームワークのパフォーマンスへの影響を評価します。フレームワークは最終的に、最適なビデオシンセシスに適したビデオ表現を出力し、結果は現在使用されている最先端のビデオ生成モデルと同等です。