Kecerdasan buatan

Pengawas Bias Berbasis AI untuk Artikel Berita, Tersedia dalam Python

Peneliti di Kanada, India, Cina, dan Australia telah berkolaborasi untuk menghasilkan paket Python yang tersedia secara gratis yang dapat digunakan untuk mendeteksi dan menggantikan ‘bahasa tidak adil’ dalam salinan berita.

Sistem, yang diberi judul Dbias, menggunakan berbagai teknologi pembelajaran mesin dan database untuk mengembangkan alur kerja tiga tahap yang dapat memperbaiki teks yang bias hingga menghasilkan versi yang tidak bias atau lebih netral.

Loaded language in a news snippet identified as ‘biased’ is transformed into a less incendiary version by Dbias. Source: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Sistem ini mewakili pipa yang dapat digunakan kembali dan mandiri yang dapat diinstal melalui Pip dari Hugging Face, dan diintegrasikan ke dalam proyek yang ada sebagai tahap tambahan, add-on, atau plugin.

Pada April, fungsionalitas serupa yang diimplementasikan di Google Docs menghadapi kritik, tidak hanya karena kurangnya kemampuan edit. Dbias, di sisi lain, dapat dilatih secara lebih selektif pada corpus berita apa pun yang diinginkan pengguna akhir, sehingga mempertahankan kemampuan untuk mengembangkan pedoman keadilan yang disesuaikan.

Perbedaan kritis adalah bahwa pipa Dbias dimaksudkan untuk secara otomatis mengubah ‘bahasa yang dimuat’ (kata-kata yang menambahkan lapisan kritis pada komunikasi faktual) menjadi bahasa netral atau prosais, bukan untuk melatih pengguna secara terus-menerus. Pada dasarnya, pengguna akhir akan mendefinisikan filter etika dan melatih sistem sesuai; dalam pendekatan Google Docs, sistem sedang – secara bisa dibilang – melatih pengguna, dengan cara searah.

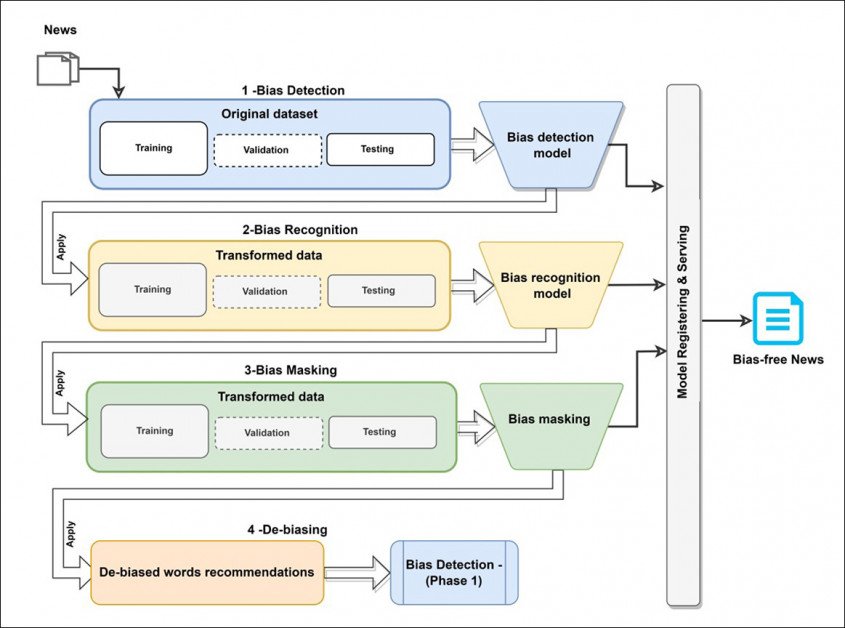

Conceptual architecture for the Dbias workflow.

Menurut peneliti, Dbias adalah paket deteksi bias yang dapat dikonfigurasi pertama, berbeda dengan proyek perakitan yang ada sebelumnya yang telah mengcharacterisasi sub-sektor ini dari Pemrosesan Bahasa Alami (NLP) hingga saat ini.

Makalah baru ini berjudul Pendekatan untuk Memastikan Keadilan dalam Artikel Berita, dan berasal dari kontributor di University of Toronto, Toronto Metropolitan University, Environmental Resources Management di Bangalore, DeepBlue Academy of Sciences di Cina, dan The University of Sydney.

Metode

Modul pertama di Dbias adalah Deteksi Bias, yang menggunakan paket DistilBERT – versi yang sangat dioptimalkan dari BERT yang cukup intensif mesin dari Google. Untuk proyek ini, DistilBERT telah disesuaikan pada dataset Media Bias Annotation (MBIC).

MBIC terdiri dari artikel berita dari berbagai sumber media, termasuk Huffington Post, USA Today, dan MSNBC. Peneliti menggunakan versi yang diperluas dari dataset.

Meskipun data asli dianotasi oleh pekerja crowdsourced (metode yang dipertanyakan pada akhir 2021), peneliti makalah baru ini dapat mengidentifikasi contoh tambahan yang tidak diberi label dari bias dalam dataset, dan menambahkannya secara manual. Insiden bias yang diidentifikasi terkait dengan ras, pendidikan, etnis, bahasa, agama, dan jenis kelamin.

Modul berikutnya, Pengenalan Bias, menggunakan Named Entity Recognition (NER) untuk membedakan kata-kata yang bias dari teks input. Makalah tersebut menyatakan:

‘Misalnya, berita “Jangan membeli hype pseudo-ilmiah tentang tornado dan perubahan iklim” telah diklasifikasikan sebagai bias oleh modul deteksi bias sebelumnya, dan modul pengenalan bias sekarang dapat mengidentifikasi istilah “pseudo-ilmiah hype” sebagai kata yang bias.’

NER tidak secara khusus dirancang untuk tugas ini, tetapi telah digunakan sebelumnya untuk identifikasi bias, terutama untuk proyek 2021 dari Durham University di Inggris.

Untuk tahap ini, peneliti menggunakan RoBERTa yang dikombinasikan dengan pipa NER Transformer SpaCy bahasa Inggris.

Tahap berikutnya, Pemaskaran Bias, melibatkan topeng ganda dari kata-kata bias yang diidentifikasi, yang beroperasi secara berurutan dalam kasus kata-kata bias yang diidentifikasi beberapa.

Loaded language digantikan dengan bahasa pragmatis pada tahap ketiga Dbias. Perhatikan bahwa ‘mouthing’ dan ‘using’ setara dengan tindakan yang sama, meskipun yang pertama dianggap merendahkan.

Jika perlu, umpan balik dari tahap ini akan dikirim kembali ke awal pipa untuk evaluasi lebih lanjut hingga sejumlah frasa atau kata alternatif yang sesuai telah dihasilkan. Tahap ini menggunakan Masked Language Modeling (MLM) sepanjang garis yang ditetapkan oleh kolaborasi 2021 yang dipimpin oleh Facebook Research.

Biasanya, tugas MLM akan menutupi 15% kata secara acak, tetapi alur kerja Dbias menginstruksikan proses untuk mengambil kata-kata bias yang diidentifikasi sebagai input.

Arsitektur ini diimplementasikan dan dilatih pada Google Colab Pro pada NVIDIA P100 dengan 24GB VRAM pada ukuran batch 16, menggunakan hanya dua label (bias dan tidak bias).