Anderson का एंगल

प्रमुख भाषा मॉडलों में चेन-ऑफ-थॉट रीजनिंग ‘सजावटी’ साबित

नए शोध से पता चलता है कि वर्तमान के सभी प्रमुख एआई भाषा मॉडलों – जिनमें ChatGPT और Claude शामिल हैं – की पॉलिश किए गए चरणबद्ध स्पष्टीकरण केवल ‘सजावटी’ हैं, और आमतौर पर एआई द्वारा उत्तर तय करने के बाद गढ़े जाते हैं।

पिछले साल, एआई-केंद्रित कंपनियों, जिनमें Anthropic और Apple शामिल हैं, से आए उच्च प्रोफ़ाइल अध्ययनों की एक श्रृंखला ने संकेत दिया कि तथाकथित ‘रीजनिंग एआई’ अक्सर चरणबद्ध स्पष्टीकरण पैदा करते हैं जो वास्तव में उनके उत्तरों को सूचित करने वाले कारकों को प्रतिबिंबित नहीं करते।

कई कारणों से, बहस जल्द ही अव्यवस्थित खंडनों और विविध व्याख्याओं (इसमें शामिल इस साइट पर भी) में बदल गई, जिससे यह प्रश्न अनसुलझा रह गया कि क्या चेन-ऑफ-थॉट (CoT) रीजनिंग केवल अंतिम उपयोगकर्ताओं को आश्वस्त करने के लिए डिज़ाइन किया गया एक कॉस्मेटिक फ्रिपरी है, या फिर एक वास्तविक तर्क प्रक्रिया का सबूत है।

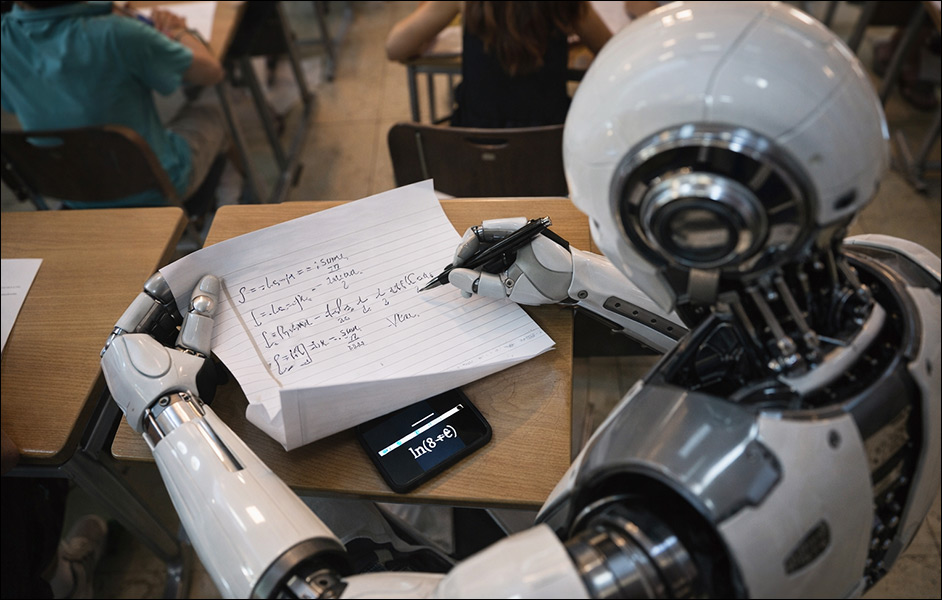

ChatGPT ‘अपना काम दिखाता है’ – लेकिन क्या इसने पहले ही तय कर लिया है कि क्या उत्तर देना है?

दिखाओ और बताओ

अब, भारत से एक दिलचस्प नया पेपर एक सस्ता और आसानी से दोहराया जा सकने वाला तरीका पेश कर रहा है ताकि यह आकलन किया जा सके कि क्या ChatGPT और अन्य प्रमुख लार्ज लैंग्वेज मॉडल्स (LLMs) के इंटरफेस में उन प्रभावशाली ‘डिडक्शन एनिमेशन’ वास्तव में एआई द्वारा किसी निष्कर्ष तक पहुँचने के चरणों से गुजरने का संकेत देते हैं।

यह नया शोध इलाहाबाद स्थित भारतीय सूचना प्रौद्योगिकी संस्थान (IIITA) और दिल्ली स्थित राष्ट्रीय इलेक्ट्रॉनिकी एवं सूचना प्रौद्योगिकी संस्थान (NIELIT) के दो शोधकर्ताओं से आया है।

लेखकों ने पाया कि लगभग सभी मामलों में, स्वामित्व वाले और ओपन-सोर्स LLMs के एक महत्वपूर्ण हिस्से में, उपयोगकर्ताओं को प्रस्तुत की गई चेन-ऑफ-थॉट रीजनिंग ‘सजावटी’ है, जिसका आविष्कार एआई द्वारा उस उत्तर के निष्कर्ष पर पहुँचने के बाद किया जाता है जिसे वह प्रस्तुत करेगा।

ChatGPT5.4, Claude Opus 4.6-R, और DeepSeek-V3.2 जैसे मॉडलों का परीक्षण करते हुए, लेखकों ने पाया कि प्रस्तुत 10-15 CoT संकेतों में से किसी एक चरण को हटाने से वास्तव में उत्तर 17% से भी कम समय में बदलता है, और कोई भी एकल चरण, अकेले, सही उत्तर प्राप्त करने के लिए पर्याप्त था।

लेखक बताते हैं*:

‘स्वास्थ्य सेवा, वित्त और कानून में एआई के लिए नियामक ढांचे तेजी से “स्पष्टीकरण योग्य” [सिस्टम] की मांग कर रहे हैं। हमारे परिणाम बताते हैं कि मानक दृष्टिकोण – मॉडल से अपना काम दिखाने के लिए कहना – पारदर्शिता का भ्रम प्रदान करता है।

‘स्पष्टीकरण धाराप्रवाह, डोमेन-उपयुक्त हैं, और एक सूक्ष्म तरीके से गलत हैं: वे उस तर्क का वर्णन करते हैं जो मॉडल ने नहीं किया।

‘एक चिकित्सा एआई जो लिखता है “ईोसिनोफिलिया एक एम्बोलिक प्रक्रिया का सुझाव देता है” ने जरूरी नहीं कि ईोसिनोफिलिया पर विचार किया हो। इसने प्रश्न के तने से उत्तर तक पैटर्न मिलान किया हो सकता है और बाद में तर्क गढ़ लिया हो।

‘ईयू एआई अधिनियम (अनुच्छेद 13) के तहत, एक उच्च-जोखिम वाले एआई सिस्टम को “शामिल तर्क के बारे में सार्थक जानकारी” प्रदान करनी चाहिए। हमारे निष्कर्ष बताते हैं कि अधिकांश फ्रंटियर मॉडलों से चेन-ऑफ-थॉट स्पष्टीकरण इस मानक को पूरा नहीं करते–उत्तर तक पहुँचने में “शामिल तर्क” वह तर्क नहीं है जिसका वर्णन स्पष्टीकरण में किया गया है।’

लेखकों ने देखा कि परीक्षण किए गए दो छोटे मॉडलों ने दोहराव के सामान्य पैटर्न को तोड़ा, लेकिन केवल बहुत विशेष परिस्थितियों में: MiniMax-M25 ने सेंटीमेंट विश्लेषण से निपटते समय वास्तविक चरण-निर्भरता प्रदर्शित की, जबकि Kimi-K25 ने CoT प्रसंस्करण की वास्तविक 39% आवश्यकता दिखाई – लेकिन केवल विषय वर्गीकरण से निपटते समय।

अन्य सभी मामलों में, बड़े और बेहतर ज्ञात मॉडलों की तरह, प्रदर्शित तर्क के चरण पूरी तरह से प्रदर्शनात्मक प्रतीत हुए, जिसमें मॉडलों ने इसके बजाय शॉर्टकट का उपयोग किया।

छोटे मॉडल अधिक मेहनत करते हैं

परीक्षण किए गए दस एपीआई मॉडलों के अलावा, लेखकों ने कई छोटे ओपन-वेट मॉडलों† का भी परीक्षण किया, जिनकी पैरामीटर संख्या 0.8 से 8 बिलियन (जो आजकल काफी मामूली है) के बीच थी, और पाया कि ये अधिक छोटे एआई वास्तव में तर्क करते हैं, और वह CoT जो वे दिखाते हैं आमतौर पर – हालांकि हमेशा नहीं – उपयोगी और सटीक निष्कर्षों तक पहुँचने के लिए आवश्यक होता है।

छोटे मॉडलों ने चरण-तर्क की 55% आवश्यकता प्रदर्शित की, जबकि बड़े मॉडलों में औसतन 11% आवश्यकता थी, जिसके बारे में लेखकों का दावा है, ‘उन्होंने बहु-चरण तर्क को पूरी तरह से दरकिनार करना सीख लिया है, आंतरिक शॉर्टकट के माध्यम से सही उत्तरों पर पहुँचते हैं जिनका उनके लिखित तर्क में प्रतिबिंब नहीं होता’।

लेखकों का मानना है कि कोई मॉडल किसी कार्य में जितना बेहतर होता जाता है, उसे तर्क के चरणों की उतनी ही कम आवश्यकता होती है (हालांकि यह प्रशिक्षण डेटा वितरण में जो भी उत्तर सबसे मजबूत था, उसके पक्ष में तर्कसंगत विश्लेषण से परहेज करने की अवधारणा पर एक अधिक राजनयिक दृष्टिकोण है)††:

‘छोटे मॉडल गणित पर विश्वसनीय रूप से तर्क करते हैं क्योंकि उन्हें अवश्य करना होता है—शॉर्टकट लगाने के लिए उनके पास पैरामीट्रिक ज्ञान की कमी होती है।

‘फ्रंटियर मॉडलों ने पर्याप्त गणितीय पैटर्न आत्मसात कर लिए हैं कि स्पष्ट चेन रीजनिंग अनावश्यक हो जाती है। CoT फिर भी सटीकता में सुधार करता है (जनरेशन को संरचित करके), लेकिन अलग-अलग चरण अब अद्वितीय जानकारी नहीं रखते।’

विधि

मॉडलों का परीक्षण करने के लिए इस्तेमाल की गई विधि तीन मानदंडों पर आधारित है:

आवश्यकता प्रत्येक CoT चरण को बारी-बारी से हटाती है, और फिर जांचती है कि क्या उत्तर बदलता है। किसी भी चरण को हटाने से परिणाम बदल जाता है उसे ‘आवश्यक’ गिना जाता है; पर्याप्तता प्रत्येक चरण को अलग करती है, और परीक्षण करती है कि क्या वह अकेले उत्तर प्राप्त कर सकता है, ऐसे किसी भी चरण को पर्याप्त गिना जाता है; और क्रम संवेदनशीलता चरणों को फेरबदल करती है, और देखती है कि क्या उत्तर बदलता है (चूंकि वास्तविक तर्क कीवर्ड के बजाय अनुक्रम पर निर्भर करना चाहिए)।

एक साथ लेने पर, उच्च आवश्यकता और कम पर्याप्तता वास्तविक चरण-दर-चरण तर्क का संकेत देते हैं, जबकि कम आवश्यकता और उच्च पर्याप्तता ऐसे स्पष्टीकरणों का संकेत देते हैं जिन्हें परिणाम को प्रभावित किए बिना हटाया, पुनर्व्यवस्थित या कम किया जा सकता है।

लेखक ध्यान देते हैं कि यह विधि व्हाइट-बॉक्स मॉडल एक्सेस की किसी भी आवश्यकता को दूर करती है, क्योंकि इसे बंद-स्रोत, केवल-एपीआई मॉडल जैसे ChatGPT और Claude पर केवल कुछ डॉलर में किया जा सकता है, और स्वाभाविक रूप से, ओपन-वेट मॉडल पर भी उतनी ही सफलतापूर्वक जिन्हें स्थानीय रूप से इंस्टॉल किया जा सकता है।

वे यह भी ध्यान देते हैं कि पूर्व के अध्ययनों ने या तो ऐ