Angle d’Anderson

Utilisation de l’IA pour simuler le grain de film

Faites l’Amérique granuleuse à nouveau : un nouvel outil d’IA peut supprimer le grain de film des anciennes séquences, compresser la vidéo à une fraction de sa taille, puis remettre le grain afin que les spectateurs ne remarquent rien. Il fonctionne avec les normes vidéo existantes et réduit la bande passante de jusqu’à 90 pour cent, tout en conservant l’apparence vintage.

Pour beaucoup d’entre nous qui regardent des films ou des émissions de télévision anciennes, le « grésillement » du grain de film est rassurant ; même lorsque nous ne le remarquons pas consciemment, le grain nous indique que ce que nous regardons a été réalisé avec des produits chimiques, et non avec du code, et relie l’expérience au monde physique : au choix du stock, à l’exposition, aux processus de laboratoire et aux époques révolues :

L’approche d’Hollywood en matière de grain a évolué au fil des changements culturels et des méthodes de production. Au cours des années 1960, l’évolution des stocks de caméras et des pratiques photographiques a contribué à l’identité visuelle distincte de la décennie. Plus tard, les réalisateurs travaillant en numérique ont recommencé à introduire intentionnellement le grain. Au milieu des années 1980, le réalisateur James Cameron a sélectionné un stock Kodak particulièrement grossier pour Aliens (1986, en bas à droite de l’image ci-dessus), probablement pour renforcer l’atmosphère tout en aidant à cacher les fils des effets visuels miniatures pratiques. Source : https://archive.is/3ZSjN (mon article le plus récent sur ce sujet)

La texture analogique vient d’une époque où la production de médias coûtait de l’argent, l’accès était limité, et il y avait au moins une idée vague que seuls les plus capables ou les plus déterminés pouvaient y parvenir, agissant comme un raccourci pour le réalisme et la crédibilité – et, lorsque les technologies de capture haute résolution ont éliminé cela, la nostalgie.

Christopher Nolan n’a jamais abandonné. Alors que la plupart de l’industrie a adopté le numérique pour sa rapidité et sa flexibilité, le réalisateur acclamé s’est obstiné, insistant sur le celluloid comme discipline et esthétique.

Denis Villeneuve, travaillant carrément dans les pipelines numériques, trie toujours ses rushes à travers des processus photochimiques. Pour les films Dune, tournés numériquement, les rushes ont été imprimés sur du stock de film, puis numérisés à nouveau, uniquement pour l’atmosphère et l’effet.

Grain factice

Les amateurs de qualité de film et de télévision associent le grain visible à la haute résolution, où le débit binaire (la quantité de données poussées dans chaque trame) est si élevé que même les plus petits détails, tels que les cristaux d’halogénure, sont préservés.

Cependant, si les réseaux de streaming rendaient vraiment ce type de débit binaire disponible, cela mettrait une pression considérable sur la capacité du réseau, et provoquerait probablement des tampons et des tremblements. Par conséquent, des plateformes telles que Netflix créent des versions AV1 optimisées de leur contenu et utilisent les capacités du codec AV1 pour ajouter du grain au film ou à l’épisode de manière intelligente et appropriée, économisant 30 % de bande passante dans le processus.

L’AV1 est conçu pour incorporer un grain de film artificiel, comme dans ces exemples. Source : https://waveletbeam.com/index.php/av1-film-grain-synthesis

Le « fétichisme du grain » est un équivalent numérique relativement rare aux tendances ataviques telles que la renaissance du vinyle, et il est difficile de dire s’il est utilisé par les streamers pour faire ressembler des vidéos hautement optimisées à des « vidéos brutes » très coûteuses (pour les spectateurs qui ont inconsciemment associé ces caractéristiques), en faisant semblant que le débit binaire est plus élevé qu’il ne l’est ; ou pour détourner la baisse de qualité perçue que les anciens spectacles 4:3 subiraient autrement lorsque les fournisseurs de streaming les coupent pour les mettre au format écran large ; ou simplement pour flatter l’esthétique « rétro » de Nolan en général.

Grain siloé

Le problème est que le grain est également du bruit. Les systèmes numériques détestent le bruit, et les codecs de streaming tels que l’AV1 les éliminent pour économiser de la bande passante, à moins que les paramètres de grain ne soient explicitement configurés. De même, les améliorateurs d’images basés sur l’IA tels que la série Topaz Gigapixel traitent le grain comme une erreur à corriger.

Dans le domaine de la synthèse d’images basée sur la diffusion, le grain est extrêmement difficile à générer, car il représente des détails extrêmes, et apparaîtrait donc généralement seulement dans des modèles surapprenants, car l’architecture entière du modèle de diffusion latente (LDM) est conçue pour déconstruire le bruit (comme le grain) en images claires, plutôt que de traiter les flocons de grain comme des propriétés implicites dans les médias.

Par conséquent, il peut être difficile de créer un grain convaincant à l’aide de l’apprentissage automatique. Et même si l’on pouvait le faire, le rendre directement dans une vidéo optimisée gonflerait simplement la taille du fichier vidéo à nouveau.

En raison de cette considération logistique, les codecs vidéo de pointe tels que Versatile Video Coding (VVC) offrent du grain comme un service de « sidecar ».

Le VVC compressé la vidéo propre et dénoisée et élimine le grain. Au lieu de gaspiller des données pour essayer de préserver des modèles de grain aléatoires à haute fréquence, il analyse le grain séparément et encode un petit ensemble de paramètres (par exemple, l’amplitude, la fréquence et le mode de mélange) qui décrivent comment régénérer un grain similaire pendant la lecture.

Ces paramètres sont stockés dans un FGC-SEI (Film Grain Characteristics Supplemental Enhancement Information) flux, qui accompagne le flux principal. Après décodage, un module de synthèse utilise ces instructions pour réappliquer un grain synthétique qui imite le grain d’origine.

Cela préserve l’« apparence » d’un grain riche en haute résolution, tout en gardant le débit binaire réel bas, puisque l’encodeur n’est pas forcé de dépenser des ressources pour préserver un bruit imprévisible.

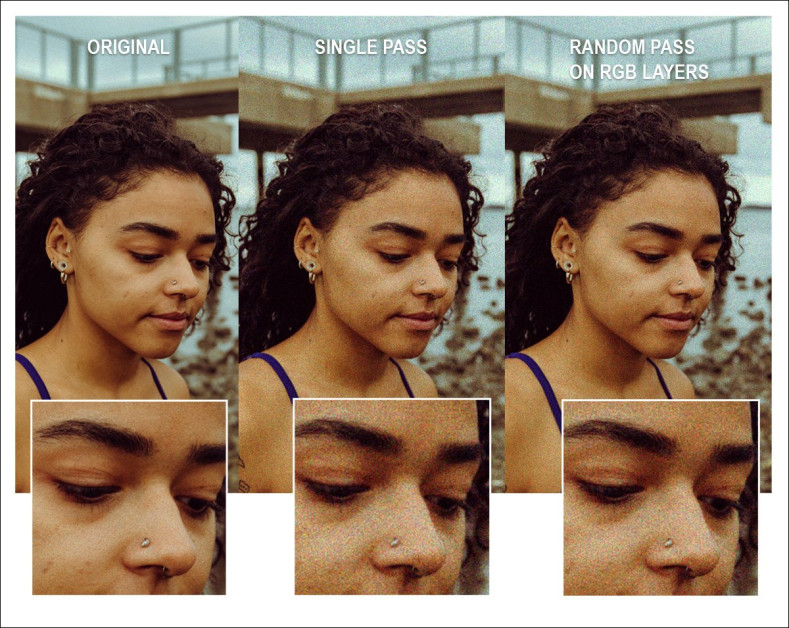

De plus, comme pour les fichiers de sous-titres discrets, ce « grain » factice est spécifique à la vidéo en question ; l’application aléatoire de filtres de grain génériques dans des plateformes telles que Photoshop ou After Effects, ou dans des pipelines de traitement automatisé, ne résulterait pas en un grain « adapté », mais plutôt en un bruit de superposition sans rapport :

Gauche : image d’origine. Centre : grain de la caméra Raw appliqué uniformément sur tous les canaux. Droite : le même filtre de grain appliqué individuellement à chaque canal dans la séquence. Source image (CC0) : https://stocksnap.io/photo/woman-beach-FJCOO6JWDP (via mon article précédent)

Le filtre de grain de Photoshop ajoute un bruit aléatoire uniforme ; mais le grain de film réel provient de cristaux d’halogénure de tailles variables. L’application du filtre à chaque canal séparément (voir l’image ci-dessus) ne crée que plus de chaos, et non de réalisme. Le grain de film réel reflète la façon dont la lumière frappe des couches d’émulsions au moment de l’exposition. Simuler cela nécessiterait d’estimer comment différentes zones d’une image auraient activé chaque couche d’halogénure, et non simplement de diviser l’effet sur les couches RVB.

FGA-NN

Dans cette quête spécieuse, une nouvelle étude de recherche de France – une brève mais intéressante sortie qui propose une méthode quantitative et qualitative supérieure pour analyser et recréer le grain :

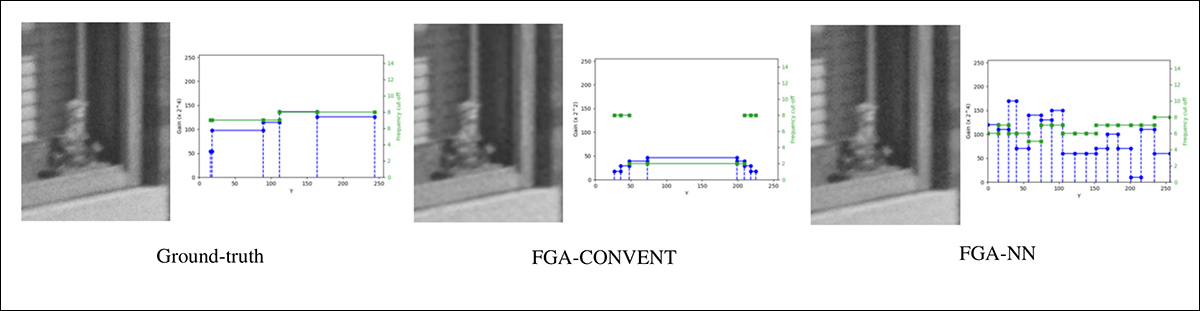

Comparaison entre le grain de référence et les résultats de diverses méthodes d’analyse et de synthèse. Source : https://arxiv.org/pdf/2506.14350

Le nouveau système, intitulé FGA-NN, ne s’écarte pas de l’utilisation conventionnelle de la synthèse de grain basée sur Gauss à travers la méthode VVC-compatible standard, Versatile Film Grain Synthesis (VFGS). Ce que le système change, c’est l’analyse, en utilisant un réseau neuronal pour estimer les paramètres de synthèse de manière plus précise

Par conséquent, le grain final est toujours synthétisé en utilisant le même modèle gaussien conventionnel – mais le réseau alimente de meilleures métadonnées dans un générateur basé sur des règles standard, obtenant un modèle de pointe.

Le nouvel article est intitulé FGA-NN : Film Grain Analysis Neural Network, et provient de trois chercheurs d’InterDigital R&D, Cesson-Sévigné. Bien que l’article ne soit pas long, examinons certains des aspects clés des progrès que la nouvelle méthode offre.

Méthode

Pour récapituler : le système FGA-NN prend une vidéo granuleuse comme entrée et extrait une description compacte du grain, en sortie des paramètres dans le format FGC-SEI standardisé utilisé par des codecs modernes divers. Ces paramètres sont transmis aux côtés de la vidéo, permettant au décodeur de reconstruire le grain en utilisant VFGS, plutôt que de coder le grain directement.

Le schéma pour l’analyse et la réapplication du grain de film dans la distribution de vidéos, en utilisant FGA-NN pour l’extraction de paramètres et VFGS pour la synthèse.

Pour former le réseau, les auteurs avaient besoin de paires de vidéos granuleuses et de métadonnées FGC-SEI correspondantes. Puisque la plupart des vidéos granuleuses ne disposent pas de ce type de métadonnées, les chercheurs ont créé leur propre ensemble de données en générant des paramètres FGC-SEI, en appliquant un grain synthétique à des vidéos propres, et en les utilisant comme exemples de formation.

Les données de formation pour FGA-NN ont été créées en appliquant un grain synthétique à des rushes propres à partir des ensembles de données BVI-DVC et DIV2K. Des paramètres FGC-SEI aléatoires ont été générés et utilisés avec l’outil de synthèse VFGS, permettant à chaque vidéo granuleuse d’être associée à des métadonnées connues.

Les paramètres FGC-SEI aléatoires ont été générés et utilisés avec l’outil de synthèse Versatile Film Grain Synthesis (VFGS), permettant à chaque vidéo granuleuse d’être associée à des métadonnées connues.

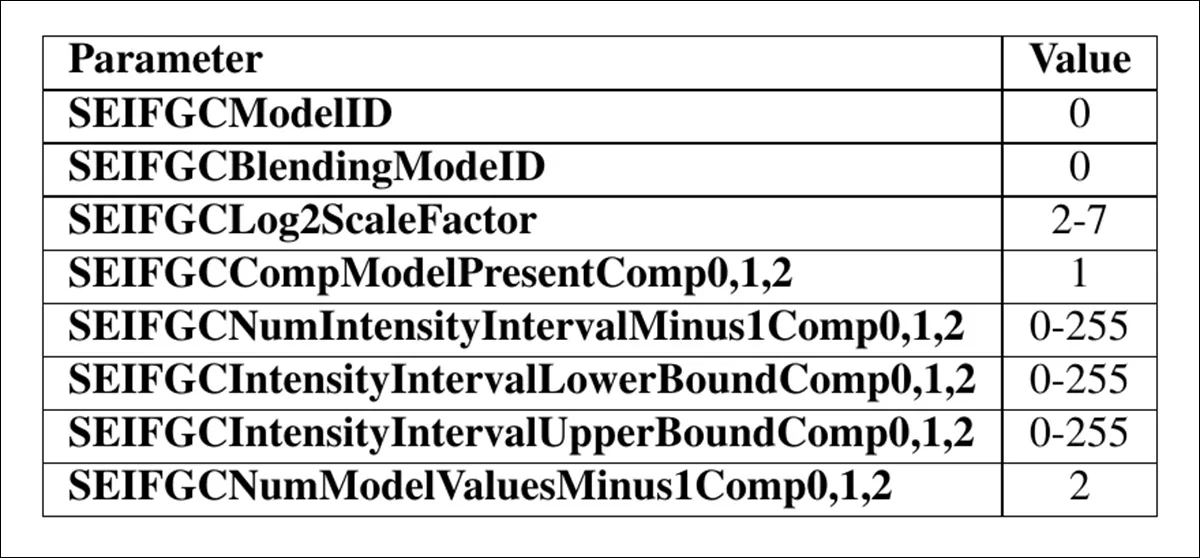

Aperçu des plages de paramètres FGC-SEI aléatoires utilisés pour la formation, appliqués à des rushes propres à partir des ensembles de données BVI-DVC et DIV2K. Les paramètres ont été limités pour assurer des résultats visuels plausibles sur les canaux luma et chroma.

Le modèle de filtrage de fréquence, la seule méthode de synthèse actuellement prise en charge dans les implémentations de codec telles que le VVC Test Model (VTM), a été utilisé dans tout le processus. Les plages de paramètres ont été limitées pour préserver la plausibilité visuelle sur les canaux luma et chroma.

Effet du réseau

FGA-NN présente deux modèles coordonnés, pour luma et chroma, respectivement, chacun conçu pour prédire les paramètres spécifiques nécessaires pour recréer un grain de film réaliste.

Pour chaque image d’entrée, le système estime un ensemble d’intervalles d’intensité, les facteurs d’échelle liés à chaque intervalle, les fréquences de coupure horizontale et verticale, et un ajustement d’échelle global appelé facteur Log2Scale. Pour cela, le modèle utilise un extracteur de caractéristiques partagé qui traite l’entrée granuleuse et se branche sur quatre branches de sortie distinctes, chacune responsable d’une tâche de prédiction spécifique :

Architecture de la version luma de FGA-NN. Un backbone partagé extrait des caractéristiques de l’entrée granuleuse, suivi de quatre branches de sortie adaptées à des tâches de prédiction de paramètres spécifiques : limites d’intervalles, facteurs d’échelle, fréquences de coupure et ajustement global Log2Scale. Le réseau chroma utilise la même structure avec des dimensions d’entrée et de sortie ajustées.

Les limites d’intervalles sont prédites en utilisant la régression, tandis que les facteurs d’échelle, les fréquences de coupure et le réglage d’échelle global sont traités comme des problèmes de classification.

L’architecture est ajustée pour refléter la complexité de chaque tâche, avec des couches internes plus grandes utilisées pour des prédictions plus fines ; en particulier, le modèle chroma reflète la structure luma, mais s’adapte aux caractéristiques différentes des données de couleur.

Formation et tests

FGA-NN a été formé en utilisant quatre fonctions objectives, chacune alignée sur l’une de ses tâches de prédiction. Pour les sorties de classification, une perte d’entropie croisée catégorique a été utilisée pour réduire l’écart entre les étiquettes prédites et les étiquettes de référence.

Les limites d’intervalles ont été normalisées dans une plage de 0 à 1 et optimisées en utilisant une perte combinée : une perte L1 exponentielle (expL1) qui pénalisait les erreurs plus importantes, et une pénalité de monotonie qui décourageait les tendances à la baisse. Toutes les quatre pertes ont été combinées, avec des poids élevés attribués aux facteurs de coupure et d’échelle, tandis que les limites d’intervalles et le facteur Log2Scale ont été pondérés à 1 et 0,1.

La formation a été effectuée sous l’optimiseur Adam, à un taux d’apprentissage de 5e-4, sur 10 000 itérations, avec une taille de lot de 64.

Le seul outil comparable adapté aux tests comparatifs était FGA-CONVENT, qui produit également des valeurs au format FGC-SEI, et est utilisé pour le traitement du grain. Les deux systèmes ont été testés sur des séquences UHD à partir de l’ensemble d’évaluation subjective JVET, en utilisant des rushes contenant du grain de film réel.

Lignes verticales en pointillés indiquent les limites d’intervalles d’intensité, tandis que le gain Log2Scale est noté dans l’étiquette d’axe.

Dans l’image ci-dessus, on voit des cadres découpés identiques générés par VFGS en utilisant des paramètres de chaque méthode, comparés à l’original. Leurs estimations luma respectives sont également tracées par rapport aux valeurs de référence définies manuellement en utilisant VFGS, qui trace ici l’intensité des pixels sur l’axe des X (0-255), les facteurs d’échelle sur l’axe des Y bleu (0-255), et les fréquences de coupure sur l’axe des Y vert (2-14).

Les auteurs déclarent :

‘On peut observer que FGA-NN capture avec précision la tendance générale du modèle de grain de film et de son amplitude, aboutissant à des images synthétisées avec un grain de film perceptuellement similaire à celui des images de référence.

‘D’un autre côté, FGA-CONVENT prédit un facteur d’échelle plus faible, compensé par un facteur Log2Scale plus faible en conséquence de sa conception, et tend à générer un modèle de grain de film plus grossier que la référence, aboutissant à une apparence distincte mais visuellement cohérente.’

Ils notent que la comparaison directe avec les paramètres de grain de référence est peu fiable, puisque l’échelle et le facteur Log2Scale peuvent se compenser mutuellement, et que de petites erreurs ont souvent peu d’impact visuel.

Test de foi

La fidélité du grain de film a été mesurée à travers quatre flux de travail : FGA-NN avec VFGS ; FGA-CONVENT plus VFGS ; Style-FG ; et 3R-INN. Les tests ont utilisé les ensembles de données FGC-SEI et FilmGrainStyle740k, en comparant la sortie à la référence en utilisant des métriques de similarité perçue apprises (LPIPS) ; JSD-NSS ; et divergence de Kullback-Leibler (KL).

Résultats des tests sur l’ensemble de données FilmGrainStyle740k. Style-FG et 3R-INN surpassent les autres, ayant été formés sur cet ensemble, tandis que FGA-NN suit de près. FGA-CONVENT sous-performe, reflétant sa dépendance à l’analyse multi-image et aux régions homogènes – conditions non remplies par les petites entrées riches en texture utilisées dans ce cas.

Sur ces résultats, les auteurs déclarent :

‘Sur l’ensemble de test FilmGrainStyle740k, Style-FG et 3R-INN réalisent les meilleurs résultats, ces méthodes ayant été spécifiquement formées sur cet ensemble, tandis que FGA-NN suit de près. La performance de FGA-CONVENT combinée avec VFGS est sous-optimale sur les deux ensembles de test.

‘Ceci est uniquement dû au fait que l’analyse repose sur des régions homogènes et exploite les informations provenant de plusieurs images dans un cas d’analyse de grain de film réel, alors que dans l’évaluation actuelle, l’analyse est fournie avec une seule image à basse résolution (256×256 à un maximum de 768×512), qui contient souvent beaucoup de texture.

‘Ceci complique encore le défi pour la méthode d’analyse conventionnelle, la rendant impossible à appliquer à de petites images.’

Enfin, les auteurs notent que tandis que les méthodes basées sur l’apprentissage telles que 3R-INN et Style-FG produisent des résultats visuels solides sur des ensembles de données ciblés, leur coût computationnel élevé les rend inadaptés au déploiement sur des appareils utilisateurs.

Comparaison de trames à faible débit binaire améliorées en utilisant différents flux de travail d’analyse et de synthèse (troisième à dernière colonne).

Par comparaison, l’approche proposée dans le nouvel article associe le module d’analyse léger FGA-NN à la méthode de synthèse VFGS efficace en termes de matériel, que les auteurs décrivent comme une solution plus viable et déployable pour réintroduire le grain de film dans les vidéos compressées.

Ils déclarent en outre que les avantages de FGA-NN sont potentiellement considérables, à grande échelle :

‘[L’encodage] de vidéos UHD avec du grain de film à des débits binaire moyens à bas en utilisant notre flux de travail d’analyse et de synthèse de grain de film permet des économies de débit binaire de jusqu’à 90 % par rapport à l’encodage à débit binaire élevé.’

Conclusion

L’obsession pour le grain de film est l’une des plus étranges et des plus curieuses idées de l’ère post-analogique, et il est intéressant de noter que ce qui était autrefois considéré comme une limitation du médium est devenu un symbole de véracité et d’authenticité en soi, même (peut-être inconsciemment) pour une nouvelle génération de spectateurs nés après le déclin effectif de l’émulsion.

Il convient de noter que aucune des méthodes de pointe de recréation de grain, y compris cette dernière innovation, ne peut exactement capturer l’effet réel de la façon dont la lumière affecte les couches d’halogénure dans un véritable processus photochimique, à travers une gamme de conditions.

Publié pour la première fois le mercredi 18 juin 2025