Angle d'Anderson

Pourquoi l'intrication des concepts signifie que vous ne pouvez pas avoir de vidéo IA « à votre façon »

Les outils vidéo d'IA promettent un contrôle total, mais un « enchevêtrement conceptuel » caché lie les identités, les expressions et les comportements, obligeant à recourir à des bidouillages et à des astuces de modèles qui brisent le mythe d'une magie GenAI sans effort.

Opinion Depuis la dernière fois que j'ai abordé le sujet en détail il y a cinq ans, le problème de intrication conceptuelle L'utilisation des systèmes d'IA entraînés s'est étendue à un éventail d'utilisateurs beaucoup plus large, sans pour autant être mieux comprise en soi.

À l'époque, encodeur automatique Les systèmes de deepfake (c'est-à-dire les systèmes désormais obsolètes) Laboratoire DeepFace et les moins axés sur le porno Échange de visage, tous deux dérivés du Reddit de 2017, discrédité et presque immédiatement banni publication du code) étaient les seuls à proposer des deepfakes relativement photoréalistes de personnes.

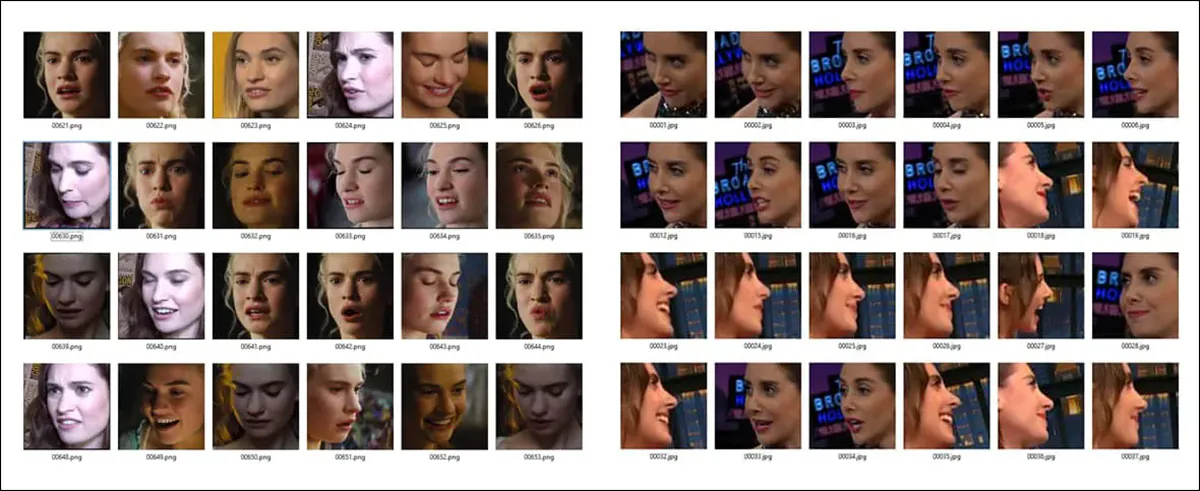

Ces systèmes s'appuyaient sur de vastes ensembles de données d'entraînement facial destinés à fournir au modèle d'IA des informations sur A) l'apparence de la personne au repos (un canonique (intégration de référence) et B) à quoi ils ressemblaient dans les diverses situations qu'un visage peut refléter, à partir de sleep grâce à rire, horreur, ennui, cynisme, tristesse, etc.

L'identité ne se manifeste pas isolément, mais indissociablement des expressions faciales. De plus, certaines émotions ne sont perceptibles que sous des angles extrêmes, ce qui tend à associer l'angle à l'émotion et inversement.

Le problème était que l'identité canonique devait généralement être déduite de captures faciales qui n'étaient pas en elles-mêmes « neutres », de sorte que la prépondérance des sourires et des rictus obtenus lors de l'extraction de données de banques d'images modifiait le résultat. pour la distribution vers une « image par défaut souriante ». Cela s'explique par le grand nombre de photos de paparazzi prises sur le tapis rouge dans les données d'entraînement extraites du web qui alimentent généralement ces modèles, ainsi que par toute autre raison tout aussi fallacieuse pouvant expliquer qu'un ensemble de données soit biaisé en faveur d'un type d'image particulier.

En d'autres termes, le système d'auto-encodeur devrait tenter d'extraire un concept d'identité « neutre » à partir de milliers d'images où les traits du visage étaient déformés par expressions faciales normales.

Il fallait également tenter de démêler les concepts sémantiques faciaux des différentes émotions. à partir des angles sous lesquels les visages ont été pris àCela signifiait que si les seules expressions faciales « terrifiées » disponibles étaient issues d'une vue de profil, le système entraîné ne pourrait reproduire cette émotion de manière optimale que depuis cette vue.

Faire face à l'avenir

As basé sur la diffusion À partir de 2022, les approches de l'IA générative ont pris le dessus sur la scène de l'image (et plus tard, de la vidéo), les systèmes génératifs étant devenus bien meilleurs pour extrapoler des expressions faciales précises à partir de données faciales limitées.

Même les plus épineux challenge La création de profils convaincants est quasiment impossible avec les technologies actuelles, tandis que les données d'expression sont efficacement dissociées de l'identité – au point que la manipulation en direct de type deepfake, initiée par les auto-encodeurs, est devenue possible. DeepFaceLive Les systèmes de diffusion en continu ont de nombreuses applications de diffusion hors ligne efficaces, la mise en œuvre en temps réel étant un développement futur probable :

Cliquez pour jouer. Le projet « FlashPortrait » présente divers exemples d'avatars animés à partir de vidéos sources. Dans ce cas précis, la question de savoir si le réalisme relève ou non du domaine « réaliste » n'a aucune importance. Source

Pourtant, à mesure que le champ d'application de l'IA générale s'est élargi et que ses résultats sont devenus plus sophistiqués, le problème de l'intrication s'est tout simplement propagé à de nombreux autres domaines – et est actuellement « corrigé » par des astuces plutôt rudimentaires et assez anciennes. Si vous ignorez la nature de ces astuces, vous aurez peut-être une vision plus positive de la rapidité avec laquelle l'IA vidéo et image évolue et surmonte ses anciens obstacles.

Chats bavards

Il est désormais clair pourquoi les anciens systèmes d'auto-encodeurs de 2017 avaient du mal à distinguer l'identité et l'émotion. Cela s'explique par deux raisons : a) une trop grande quantité de données d'un même type, OU une version trop spécifique d'un type de données importantes, ce qui entraîne un biais de distribution ; et/ou b) l'architecture du modèle n'était pas adaptée à la tâche de séparer ces qualités et avait tendance à les fusionner lors de l'inférence, à moins que l'utilisateur ne prenne un soin tout particulier à équilibrer son jeu de données.

Pour la même raison, des problèmes similaires sont apparus dans plusieurs modèles vidéo, libres et propriétaires, au cours des dernières années, même s'ils ont été éclipsés par des critiques plus importantes concernant hallucination, absence de censureet divers autres sujets.

Par exemple, dans le Système Wan2.+De nombreux utilisateurs ont constaté que c'était très difficile pour empêcher leurs caractères générés de parler sans cesseet souvent difficiles à arrêter regardant la caméra.

Ce dernier problème (le fait de regarder la caméra, ou de briser le quatrième mur) est antérieur à l'avènement des systèmes de synthèse vidéo, puisqu'il est apparu dans divers systèmes de diffusion d'images uniquement, en raison de la prévalence des photos « regardant la caméra » dans les ensembles de données extraites du Web tels que LAION.

Le problème des personnages « bavards » vient de la profusion de vidéos d'« influenceurs » sur YouTube, qui offrent naturellement des milliers d'heures de discours face caméra, souvent organisés en ensembles de données où les chercheurs peuvent blanchir le web scraping en fournissant un contexte académique.

Mais à moins que les conservateurs initiaux ou ultérieurs ne veillent à limiter le nombre de vidéos de ce type et à les équilibrer avec des séquences de types plus variés, un biais important se développe dans le modèle vidéo, ce qui nécessitera des mesures correctives rapides et divers systèmes complémentaires tiers.

Face au problème de « bavardage » de Wan, l'utilisateur Reddit u/Several-Estimate-681 a proposé une solution : solution de contournement qui exploite un paramètre du Wan 2.1 Infinite Talk V2V système – un cadre conçu pour encourager une loquacité à la manière des influenceurs – qui permet à l'utilisateur de faire taire le personnage rendu :

Cliquez pour jouer : Juste écouter – une solution de contournement pour obtenir une attention particulière aux personnages dans Wan2.+. Source

De toute évidence, les raccourcis de ce genre ne constituent pas des solutions architecturales de bas niveau, et, en l'absence de véritables solutions trouvées et mises en œuvre par les créateurs des modèles de base (car les amateurs occasionnels n'ont généralement pas des millions de dollars à recréer ou affiner ce type de travail), cela signifie que le jeu d'enchevêtrement « tape-taupe » est susceptible d'être La remise à zéro sera effective lors de la prochaine mise à jour..

Bon marché et fragile

Rien dans l'architecture de diffusion elle-même ne rend ces problèmes inévitables ; en effet, s'il existait un moyen d'appliquer une curation, un tri et une qualité réellement efficaces, la qualité de l'information serait grandement facilitée. légende et annotation Pour traiter des ensembles de données à très grande échelle comportant des millions de points de données, la quasi-totalité de ces problèmes disparaîtrait probablement.

Cependant, un tel niveau d'attention aux détails serait comparable au projet Manhattan en termes de logistique, d'envergure, de ressources nécessaires et d'effort à long terme. Dans un contexte où une nouvelle architecture, ou même une nouvelle architecture version Si l'ampleur d'un tel effort pouvait être réduite à néant, il n'existe actuellement aucune volonté de prendre ce type d'engagement.

Par conséquent, dans la mesure où cela est compatible avec l'obtention de modèles utilisables, les approches les moins coûteuses restent privilégiées. Un exemple de cette « pingrerie » est… augmentation des données, qui, lorsqu'elle est appliquée sans discernement et à des types inappropriés de clips vidéo, peut avoir résultats hilarants:

Étant donné que l'augmentation des données inverse souvent le sens des vidéos sources dans l'ensemble de données, le modèle d'IA peut parfois apprendre des mouvements « impossibles ». - Source

Cependant, globalement, les erreurs répétées et les comportements inappropriés de certaines personnes qui se mettent en « mode influenceur » sont généralement considérés comme des dommages collatéraux dans les systèmes génératifs qui peuvent, malgré ces faux pas et ces faiblesses persistantes, être amenés à produire des résultats impressionnants et des titres sensationnels.

Solutions standardisées

Durant la période actuelle, des centaines de domaines de vidéos génératives, dont la quasi-totalité enfreint d'une manière ou d'une autre, une nouvelle vague de lois et de réactions négatives Ils profitent pleinement de la situation, contrairement à GenAI, avant que les forces de l'ordre, les listes noires ou d'autres formes de déplateformage ne suppriment ces services commerciaux.

Les sites les plus importants et les plus connus de ce type, tels que Kling et Grok, ont tendance soit à adhérer à une forme d'autocensure (à terme), soit à répondre aux critiques en modifiant les types de contenu que leurs plateformes mettent à la disposition des utilisateurs.

Mais derrière ces grands noms se cachent des centaines d'autres entreprises éphémères, qui répondent constamment à la demande de contenus nouveaux (et souvent plus extrêmes).

Ce type de provisionnement simplifié évite les coûts et les efforts considérables liés à la formation de modèles de base à partir de zéro. Très souvent, même le réglage fin, pourtant bien moins coûteux, est impossible.

Ces sites proposent donc des « modèles » qui, en pratique, se comportent de manière 100 % identique à LoRAs formés sur mesure, qui sont utilisés par les amateurs d'IA depuis plus de quatre ans maintenant, pour entraîner n'importe quelle identité, style, objet et (dans le cas des LoRA vidéo) mouvement ou action souhaités dans un module LoRA dédié.

Avec LoRA interposé entre l'utilisateur et le modèle de base, les résultats obtenus seront très spécifiques au sujet d'entraînement de LoRA. Généralement, les performances globales du modèle sont compromises par l'influence de LoRA, qui reproduit très bien son propre sujet, mais injecte également ce contenu dans toute requête (si les sites éphémères de vidéos GenAI permettaient ce niveau de contrôle – ce qui n'est pas le cas ; ils proposent simplement un [ACTION DE VOTRE CHOIX] modèle, et interpréter votre texte/images/vidéos d'entrée de la manière la plus susceptible de donner lieu à une application réussie du modèle).

Pour des raisons évidentes, je ne peux pas intégrer d'exemples de sites web dans cet article ; mais la littérature scientifique récente a fourni des exemples analogues. Ici, par exemple, Projet EffectMaker illustre le principe en action, par lequel une action spécifique est appliquée à une image fournie par l'utilisateur :

Cliquez pour jouer. Dans EffectMaker, des effets spécifiques finement réglés peuvent être appliqués à des entrées personnalisées. Source

Même dans ces circonstances hautement ciblées et soigneusement sélectionnées, les utilisateurs se plaignent souvent de devoir effectuer plusieurs tentatives de destruction de jetons pour obtenir un bon résultat, et nous ne devrions peut-être pas attribuer à l'avarice ou aux pratiques douteuses des fournisseurs ce qui est plus probablement dû à une nature intrinsèquement aléatoire. DiT Cadres GenAI.

On pourrait affirmer que le grand public se forge une opinion des capacités de GenAI à partir d'exemples triés sur le volet, non représentatifs des résultats qu'un utilisateur novice et occasionnel obtiendrait. Si un utilisateur effectue six essais avec un modèle (par exemple, un LoRA fourni par le site web d'IA), il aura tendance à publier et à vanter les meilleurs résultats, laissant croire qu'on pourrait obtenir de tels résultats en interrogeant le modèle de base – et laissant croire que les modèles génératifs de base sont bien plus simples qu'ils ne le sont en réalité.

Conclusion

La littérature continue d'examiner le problème de l'intrication, qui a émergé sérieusement vers 2020, dans le cadre du projet Max Planck/Google. collaboration Un regard lucide sur l'apprentissage non supervisé des représentations désenchevêtrées et leur évaluation.

De plus, divers successeurs de Démêler par contraste (Disco) émergent périodiquement, et la scène reste animée par une prise de conscience du problème qui dépasse largement la sensibilisation du public à ce que représente l'IA ne peut pas faire, à cet égard.

UN Étude chinoise de 2024 Cela suggère qu'une résolution de l'intrication n'est peut-être pas nécessaire pour résoudre les problèmes qu'elle engendre. Historiquement, cela se vérifie, car de nombreux problèmes complexes en vision par ordinateur ont été surmontés non pas par une résolution, mais par le recours à des techniques et des approches entièrement nouvelles.

En attendant l'émergence d'un concurrent aussi distinct, il semble que nous devrons continuer à appliquer des correctifs d'urgence et des solutions de fortune aux lacunes et aux limites de GenAI, et à supporter la surestimation publique de la flexibilité et de la ductilité des modèles de base.

Première publication le lundi 23 mars 2026