Angle d’Anderson

Résoudre les limites des modèles de diffusion en matière de miroirs et de réflexions

Depuis que l’intelligence artificielle générative a commencé à susciter l’intérêt du public, le domaine de la recherche en vision par ordinateur s’est intéressé de plus en plus au développement de modèles d’IA capables de comprendre et de reproduire les lois physiques ; cependant, le défi de l’enseignement aux systèmes d’apprentissage automatique pour simuler des phénomènes tels que la gravité et la dynamique des fluides a été un objectif important de recherche pendant au moins les cinq dernières années.

Depuis que les modèles de diffusion latente (LDM) ont dominé la scène de l’IA générative en 2022, les chercheurs se sont de plus en plus concentrés sur la capacité limitée de l’architecture LDM à comprendre et reproduire les phénomènes physiques. Maintenant, ce problème a gagné une importance supplémentaire avec le développement emblématique du modèle de vidéo générative d’OpenAI Sora, et la (sans doute) plus conséquente sortie récente des modèles de vidéo Hunyuan Video et Wan 2.1 ouverts.

Réfléchir mal

La plupart des recherches visant à améliorer la compréhension de la physique des LDM se sont concentrées sur des domaines tels que la simulation de la marche, la physique des particules et d’autres aspects du mouvement newtonien. Ces domaines ont attiré l’attention parce que les inexactitudes dans les comportements physiques de base entraîneraient immédiatement une perte d’authenticité des vidéos générées par l’IA.

Cependant, un petit mais croissant courant de recherche se concentre sur l’une des plus grandes faiblesses des LDM – leur incapacité relative à produire des réflexions précises.

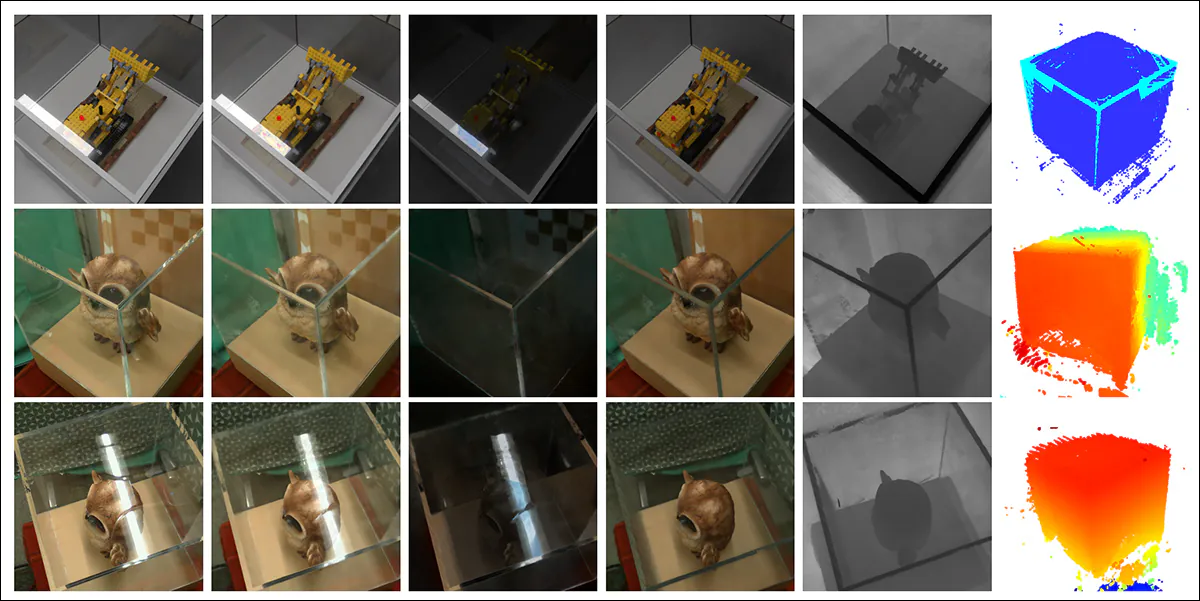

À partir du document de janvier 2025 ‘Reflecting Reality : permettre aux modèles de diffusion de produire des réflexions de miroir fidèles’, des exemples de ‘défaillance de réflexion’ par rapport à l’approche des chercheurs. Source : https://arxiv.org/pdf/2409.14677

Ce problème était également un défi pendant l’ère du CGI et persiste dans le domaine du jeu vidéo, où les algorithmes de l’illumination par suivi de rayons simulent le chemin de la lumière lorsqu’elle interagit avec les surfaces. Le suivi de rayons calcule la façon dont les rayons de lumière virtuels rebondissent ou traversent les objets pour créer des réflexions, des réfractions et des ombres réalistes.

Cependant, chaque rebond supplémentaire augmente considérablement le coût computationnel, les applications en temps réel doivent donc faire un compromis entre la latence et la précision en limitant le nombre de rebonds de rayons de lumière autorisés.

![Une représentation d'un faisceau de lumière virtuel calculé dans un scénario 3D basé sur le CGI, en utilisant des technologies et des principes développés pour la première fois dans les années 1960 et qui ont atteint leur apogée entre 1982 et 1993 (la période entre Tron [1982] et Jurassic Park [1993]).](https://www.unite.ai/wp-content/uploads/2025/04/ray-tracing.jpg)

Une représentation d’un faisceau de lumière virtuel calculé dans un scénario 3D basé sur le CGI, en utilisant des technologies et des principes développés pour la première fois dans les années 1960 et qui ont atteint leur apogée entre 1982 et 1993 (la période entre ‘Tron’ [1982] et ‘Jurassic Park’ [1993]). Source : https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing

Par exemple, représenter une théière en chrome devant un miroir pourrait impliquer un processus de suivi de rayons où les rayons de lumière rebondissent à plusieurs reprises entre les surfaces réfléchissantes, créant une boucle presque infinie avec peu de bénéfices pratiques pour l’image finale. Dans la plupart des cas, une profondeur de réflexion de deux à trois rebonds dépasse déjà ce que le spectateur peut percevoir. Un seul rebond entraînerait un miroir noir, car la lumière doit effectuer au moins deux voyages pour former une réflexion visible.

Chaque rebond supplémentaire augmente considérablement le coût computationnel, souvent en doublant les temps de rendu, ce qui rend la gestion plus rapide des réflexions l’une des plus grandes opportunités d’amélioration de la qualité de rendu par suivi de rayons.

Naturellement, les réflexions se produisent et sont essentielles à la photoréalisme, dans des scénarios beaucoup moins évidents – tels que la surface réfléchissante d’une rue de la ville ou d’un champ de bataille après la pluie ; la réflexion de la rue opposée dans une vitrine ou une porte en verre ; ou sur les lunettes des personnages représentés, où les objets et les environnements peuvent être nécessaires pour apparaître.

Une réflexion jumelle simulée via un compositeur traditionnel pour une scène emblématique de ‘The Matrix’ (1999).

Problèmes d’image

Pour cette raison, les cadres qui étaient populaires avant l’avènement des modèles de diffusion, tels que Neural Radiance Fields (NeRF), et certains défis plus récents tels que Gaussian Splatting ont maintenu leurs propres difficultés pour mettre en œuvre des réflexions de manière naturelle.

Le projet REF2-NeRF (représenté ci-dessous) a proposé une méthode de modélisation basée sur NeRF pour les scènes contenant un meuble en verre. Dans cette méthode, la réfraction et la réflexion ont été modélisées à l’aide d’éléments qui dépendaient et indépendaient de la perspective de l’observateur. Cette approche a permis aux chercheurs d’estimer les surfaces où la réfraction se produisait, en particulier les surfaces en verre, et a permis la séparation et la modélisation des composants de lumière directe et réfléchie.

Exemples à partir du document Ref2Nerf. Source : https://arxiv.org/pdf/2311.17116

D’autres solutions de réflexion NeRF des 4-5 dernières années ont inclus NeRFReN, Reflecting Reality, et le projet Planar Reflection-Aware Neural Radiance Fields de Meta en 2024.

Pour GSplat, des documents tels que Mirror-3DGS, Reflective Gaussian Splatting, et RefGaussian ont offert des solutions concernant le problème de réflexion, tandis que le projet Nero de 2023 a proposé une méthode personnalisée pour incorporer des qualités réfléchissantes dans les représentations neuronales.

MirrorVerse

Obtenir qu’un modèle de diffusion respecte la logique de réflexion est sans doute plus difficile qu’avec des approches explicites et non sémantiques telles que Gaussian Splatting et NeRF. Dans les modèles de diffusion, une règle de ce type n’est susceptible de devenir fiablement intégrée que si les données de formation contiennent de nombreux exemples variés sur une large gamme de scénarios, ce qui la rend fortement dépendante de la distribution et de la qualité du jeu de données d’origine.

Traditionnellement, l’ajout de comportements particuliers de ce type est du ressort d’un LoRA ou de l’ajustement fin du modèle de base ; mais ceux-ci ne sont pas des solutions idéales, car un LoRA a tendance à dévier la sortie vers ses propres données de formation, même sans invitation, tandis que les ajustements fins – outre le fait qu’ils sont coûteux – peuvent faire dévier de manière irréversible un modèle important de la voie principale et engendrer une multitude d’outils personnalisés qui ne fonctionneront jamais avec aucune autre variante du modèle, y compris le modèle d’origine.

En général, améliorer les modèles de diffusion nécessite que les données de formation accordent une attention plus grande à la physique de la réflexion. Cependant, de nombreux autres domaines ont également besoin d’une attention similaire. Dans le contexte des jeux de données à grande échelle, où la curation personnalisée est coûteuse et difficile, résoudre chaque faiblesse de cette manière est impraticable.

Néanmoins, des solutions au problème de réflexion des LDM apparaissent de temps en temps. Un tel effort récent, en provenance de l’Inde, est le projet MirrorVerse, qui propose un jeu de données amélioré et une méthode de formation capable d’améliorer l’état de l’art dans ce défi particulier de la recherche sur la diffusion.

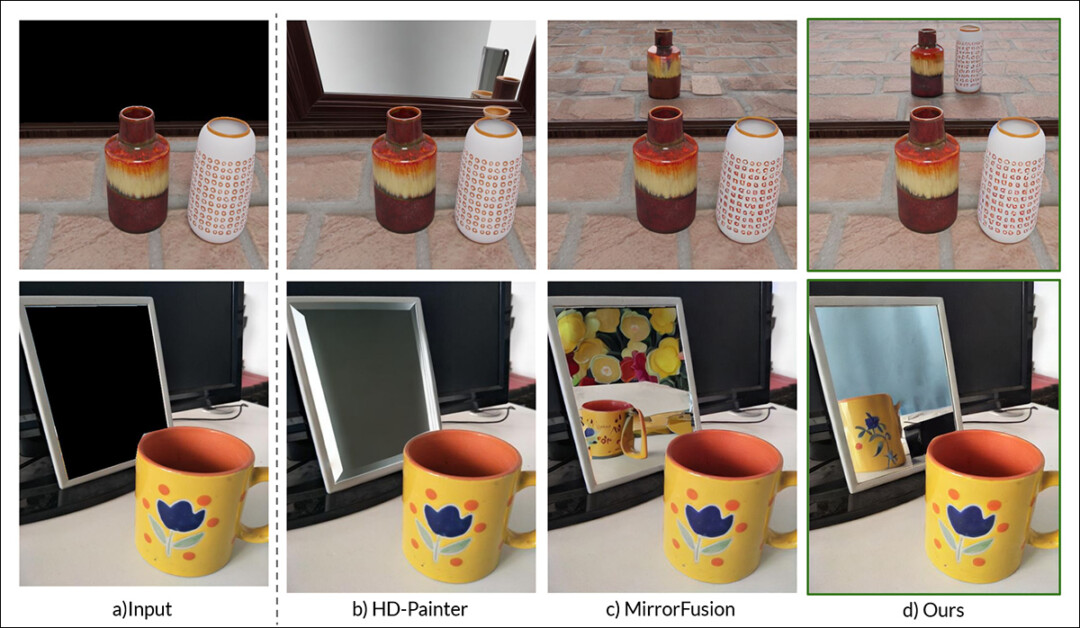

À droite, les résultats de MirrorVerse comparés à deux approches antérieures (deux colonnes centrales). Source : https://arxiv.org/pdf/2504.15397

Comme on peut le voir dans l’exemple ci-dessus (l’image de fonction dans le PDF de la nouvelle étude), MirrorVerse améliore les offres récentes qui abordent le même problème, mais est loin d’être parfait.

Dans l’image du haut à droite, on voit que les jarres en céramique sont légèrement à droite de l’endroit où elles devraient être, et dans l’image ci-dessous, qui ne devrait techniquement pas présenter de réflexion de la tasse, une réflexion incorrecte a été introduite dans la zone de droite, contre la logique des angles de réflexion naturels.

Par conséquent, nous allons examiner la nouvelle méthode non pas parce qu’elle peut représenter l’état actuel de la technique dans la réflexion basée sur la diffusion, mais également pour illustrer la mesure dans laquelle cela peut s’avérer être un problème insoluble pour les modèles de diffusion latente, statiques et vidéo, dans la mesure où les exemples de données de réflexivité sont susceptibles d’être entrelacés avec des actions et des scénarios particuliers.

Par conséquent, cette fonction particulière des LDM peut continuer à être en deçà des approches spécifiques à la structure telles que NeRF, GSplat et le CGI traditionnel.

Le nouveau document s’intitule MirrorVerse : pousser les modèles de diffusion à refléter réaliste le monde, et provient de trois chercheurs issus du Vision and AI Lab, IISc Bangalore, et du Samsung R&D Institute à Bangalore. Le document a une page de projet associée, ainsi qu’un jeu de données sur Hugging Face, avec le code source publié sur GitHub.

Méthode

Les chercheurs notent dès le départ la difficulté que des modèles tels que Stable Diffusion et Flux ont pour respecter les invites basées sur la réflexion, en illustrant le problème de manière adéquate :

À partir du document : les modèles d’image-à-texte actuels, SD3.5 et Flux, présentant des défis importants pour produire des réflexions cohérentes et géométriquement précises lorsqu’ils ont été invités à les générer dans une scène.

Les chercheurs ont développé MirrorFusion 2.0, un modèle générateur basé sur la diffusion visant à améliorer la photoréalisme et la précision géométrique des réflexions de miroir dans les images synthétiques. La formation du modèle était basée sur le nouveau jeu de données mis au point par les chercheurs, intitulé MirrorGen2, conçu pour résoudre les faiblesses de généralisation observées dans les approches précédentes.

MirrorGen2 élargit les méthodologies antérieures en introduisant la position aléatoire des objets, les rotations aléatoires, et l’ancrage explicite des objets, dans le but de garantir que les réflexions restent plausibles sur une gamme plus large de poses et de placements d’objets par rapport à la surface du miroir.

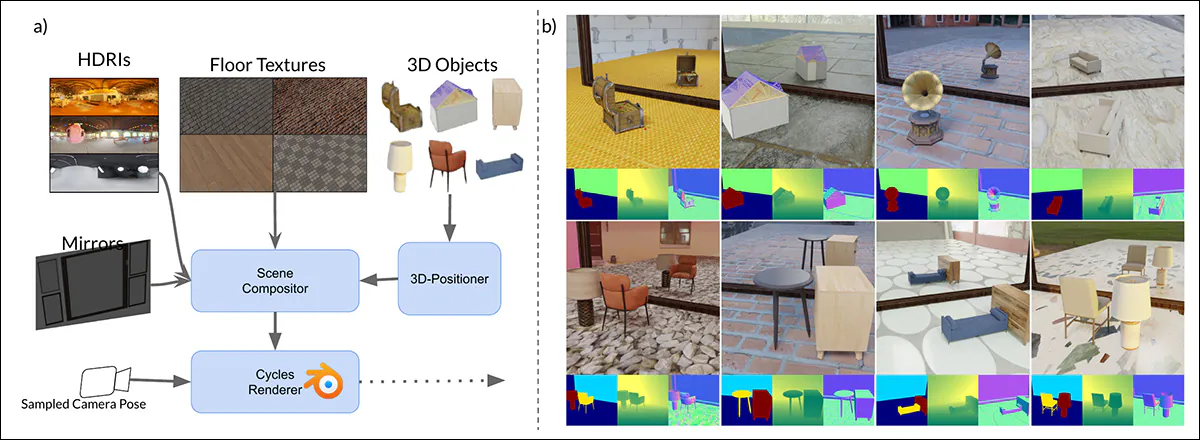

Schéma pour la génération de données synthétiques dans MirrorVerse : le pipeline de génération de données a appliqué des augmentations clés en positionnant aléatoirement, en faisant tourner et en ancrant les objets dans la scène à l’aide du 3D-Positioner. Les objets sont également appariés en combinaisons sémantiquement cohérentes pour simuler des relations spatiales complexes et des occlusions, permettant au jeu de données de capturer des interactions plus réalistes dans des scènes à objets multiples.

Pour renforcer davantage la capacité du modèle à gérer des dispositions spatiales complexes, le pipeline MirrorGen2 intègre des scènes d’objets appariés, permettant au système de mieux représenter les occlusions et les interactions entre plusieurs éléments dans des contextes réfléchissants.

Le document indique :

‘Les catégories sont appariées manuellement pour garantir la cohérence sémantique – par exemple, en appariant une chaise avec une table. Lors du rendu, après la position et la rotation de l’objet principal, un objet supplémentaire de la catégorie appariée est échantillonné et organisé pour éviter le chevauchement, créant ainsi des régions spatiales distinctes dans la scène.’

En ce qui concerne l’ancrage explicite des objets, les auteurs ont ici garanti que les objets générés étaient ‘ancrés’ au sol dans les données synthétiques de sortie, plutôt que de ‘flotter’ de manière inappropriée, ce qui peut se produire lorsque les données synthétiques sont générées à grande échelle ou avec des méthodes hautement automatisées.

Puisque l’innovation des données est centrale dans la nouveauté du document, nous allons procéder plus tôt que d’habitude à cette section de la couverture.

Données et tests

SynMirrorV2

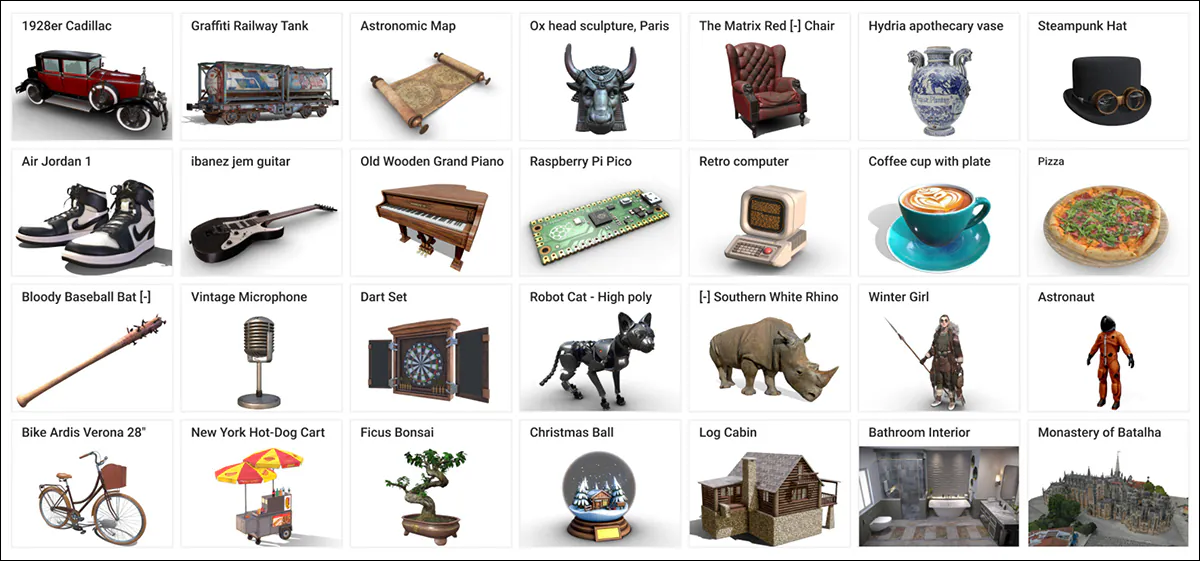

Le jeu de données SynMirrorV2 des chercheurs a été conçu pour améliorer la diversité et le réalisme des données de formation de réflexion de miroir, mettant en vedette des objets 3D issus de Objaverse et Amazon Berkeley Objects (ABO), avec ces sélections ultérieurement affinées via OBJECT 3DIT, ainsi que le processus de filtrage à partir du projet MirrorFusion V1, pour éliminer les actifs de mauvaise qualité. Cela a abouti à un bassin raffiné de 66 062 objets.

Exemples à partir du jeu de données Objaverse, utilisés dans la création du jeu de données ciblé pour le nouveau système. Source : https://arxiv.org/pdf/2212.08051

La construction de scènes a consisté à placer ces objets sur des sols texturisés de CC-Textures et des arrière-plans HDRI de PolyHaven CGI, en utilisant soit des miroirs pleins ou des miroirs rectangulaires hauts. L’éclairage a été standardisé avec une lumière d’aire positionnée au-dessus et derrière les objets, à un angle de 45 degrés. Les objets ont été mis à l’échelle pour tenir dans un cube unitaire et positionnés en utilisant une intersection précalculée du miroir et du frustum de la caméra, garantissant la visibilité.

Des rotations aléatoires ont été appliquées autour de l’axe y, et une technique d’ancrage a été utilisée pour prévenir les ‘artefacts flottants’.

Pour simuler des scènes plus complexes, le jeu de données a également incorporé plusieurs objets disposés selon des appariements sémantiquement cohérents basés sur les catégories ABO. Les objets secondaires ont été placés pour éviter le chevauchement, créant 3 140 scènes à objets multiples conçues pour capturer des occlusions et des relations de profondeur variées.

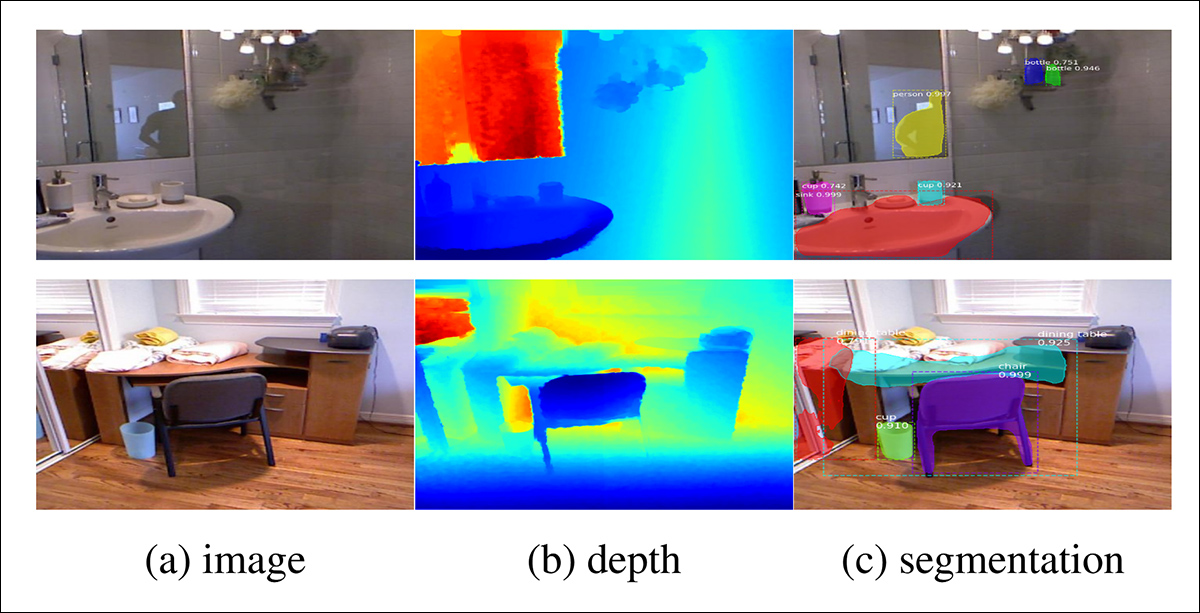

Exemples de vues rendues à partir du jeu de données des auteurs contenant plusieurs objets (plus de deux), avec des illustrations de segmentation d’objets et de visualisations de cartes de profondeur ci-dessous.

Processus de formation

En reconnaissant que le réalisme synthétique seul était insuffisant pour une généralisation robuste aux données du monde réel, les chercheurs ont développé un processus d’apprentissage par curriculum en trois étapes pour la formation de MirrorFusion 2.0.

À l’étape 1, les auteurs ont initialisé les poids des deux branches de condition et de génération avec le point de repère Stable Diffusion v1.5, et ont affiné le modèle sur la partie de formation à objet unique du jeu de données SynMirrorV2. Contrairement au projet Reflecting Reality mentionné ci-dessus, les chercheurs n’ont pas gelé la branche de génération. Ils ont ensuite formé le modèle pendant 40 000 itérations.

À l’étape 2, le modèle a été affiné pendant 10 000 itérations supplémentaires sur la partie de formation à objets multiples du jeu de données SynMirrorV2, afin d’enseigner au système à gérer les occlusions et les dispositions spatiales plus complexes trouvées dans des scènes réalistes.

Enfin, à l’étape 3, 10 000 itérations supplémentaires d’affinement ont été effectuées en utilisant des données du monde réel du jeu de données MSD, en utilisant des cartes de profondeur générées par l’estimateur de profondeur monocular Matterport3D.

Exemples à partir du jeu de données MSD, avec des scènes du monde réel analysées en cartes de profondeur et de segmentation. Source : https://arxiv.org/pdf/1908.09101

Pendant la formation, les invites de texte ont été omises pour 20 % du temps de formation afin d’encourager le modèle à faire un usage optimal des informations de profondeur disponibles (c’est-à-dire une approche ‘masquée’).

La formation a eu lieu sur quatre GPU NVIDIA A100 pour toutes les étapes (la spécification de VRAM n’est pas fournie, bien qu’elle aurait pu être de 40 Go ou 80 Go par carte). Un taux d’apprentissage de 1e-5 a été utilisé sur une taille de lot de 4 par GPU, sous l’optimiseur AdamW.

Ce schéma de formation a progressivement augmenté la difficulté des tâches présentées au modèle, en commençant par des scènes synthétiques plus simples et en avançant vers des compositions plus complexes, dans l’intention de développer une robuste transférabilité dans le monde réel.

Tests

Les auteurs ont évalué MirrorFusion 2.0 par rapport à l’état de l’art antérieur, MirrorFusion, qui a servi de référence, et ont mené des expériences sur le jeu de données MirrorBenchV2, couvrant à la fois les scènes à objet unique et à objets multiples.

Des tests qualitatifs supplémentaires ont été effectués sur des échantillons du jeu de données MSD et du jeu de données Google Scanned Objects (GSO).

L’évaluation a utilisé 2 991 images à objet unique à partir de catégories vues et non vues, et 300 scènes à deux objets à partir de ABO. Les performances ont été mesurées en utilisant le rapport de signal à bruit de pic (PSNR) ; l’indice de similarité structurelle (SSIM) ; et les scores de similarité de patch d’image perçue apprise (LPIPS) pour évaluer la qualité de réflexion sur la région de miroir masquée. La similarité CLIP a été utilisée pour évaluer l’alignement textuel avec les invites de saisie.

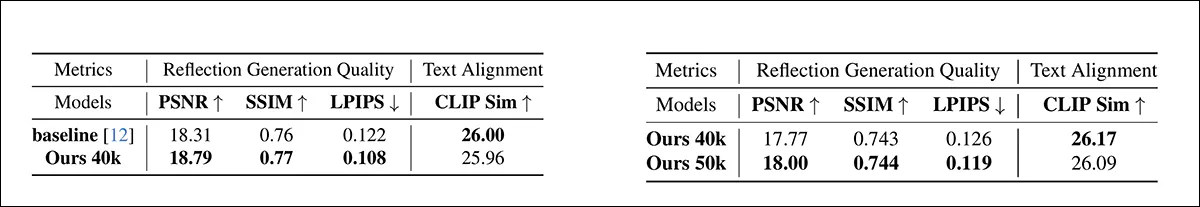

Dans les tests quantitatifs, les auteurs ont généré des images en utilisant quatre graines pour une invite spécifique, et ont sélectionné l’image résultante avec le meilleur score SSIM. Les deux tableaux de résultats pour les tests quantitatifs sont présentés ci-dessous.

À gauche, résultats quantitatifs pour la génération de réflexion d’objet unique sur la partie objet unique de MirrorBenchV2. MirrorFusion 2.0 a surpassé la référence, avec les meilleurs résultats indiqués en gras. À droite, résultats quantitatifs pour la génération de réflexion d’objet multiple sur la partie objet multiple de MirrorBenchV2. MirrorFusion 2.0 formé avec des objets multiples a surpassé la version formée sans eux, avec les meilleurs résultats indiqués en gras.

Les auteurs commentent :

‘[Les résultats] montrent que notre méthode surpasse la méthode de référence et que l’affinement sur plusieurs objets améliore les résultats sur des scènes complexes.’

La majeure partie des résultats, et ceux mis en avant par les auteurs, concernent les tests qualitatifs. En raison des dimensions de ces illustrations, nous ne pouvons les reproduire que partiellement.

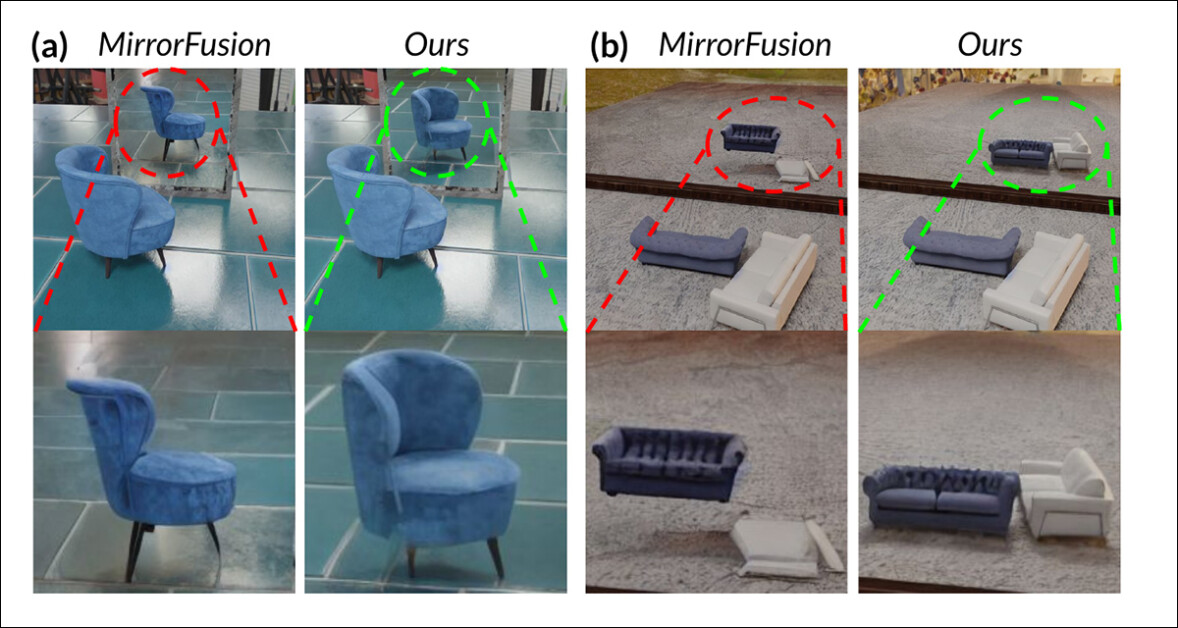

Comparaison sur MirrorBenchV2 : la référence a échoué à maintenir des réflexions précises et une cohérence spatiale, montrant une orientation de chaise incorrecte et des réflexions de plusieurs objets déformées, tandis que (les auteurs soutiennent) MirrorFusion 2.0 rend correctement la chaise et les canapés, avec une position, une orientation et une structure précises.

Sur ces résultats subjectifs, les chercheurs estiment que le modèle de référence a échoué à rendre avec précision l’orientation et les relations spatiales des objets dans les réflexions, produisant souvent des artefacts tels que des rotations incorrectes et des objets flottants. MirrorFusion 2.0, formé sur SynMirrorV2, selon les auteurs, préserve l’orientation et la position correctes des objets dans les scènes à objet unique et à objets multiples, aboutissant à des réflexions plus réalistes et cohérentes.

Ci-dessous, nous voyons les résultats qualitatifs sur le jeu de données GSO mentionné :

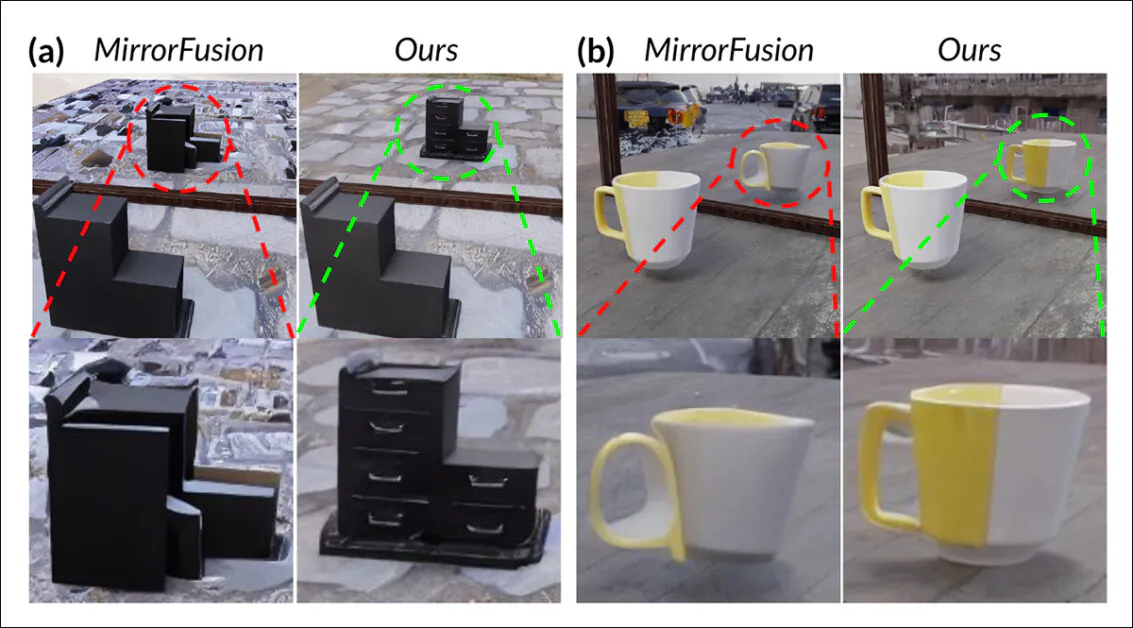

Comparaison sur le jeu de données GSO. La référence a mal représenté la structure de l’objet et a produit des réflexions incomplètes et déformées, tandis que MirrorFusion 2.0, selon les auteurs, préserve l’intégrité spatiale et génère une géométrie, une couleur et des détails précis, même pour des objets hors distribution.

Ici, les auteurs commentent :

‘MirrorFusion 2.0 génère des réflexions nettement plus précises et réalistes. Par exemple, dans la figure 5 (a – ci-dessus), MirrorFusion 2.0 reflète correctement les poignées du tiroir (surlignées en vert), tandis que le modèle de référence produit une réflexion invraisemblable (surlignée en rouge). ‘

‘De même, pour la “tasse blanche-jaune” de la figure 5 (b), MirrorFusion 2.0 livre une géométrie convaincante avec un minimum d’artefacts, contrairement à la référence, qui échoue à capturer avec précision la géométrie et l’apparence de l’objet.’

Le dernier test qualitatif a été effectué contre le jeu de données MSD du monde réel (résultats partiels présentés ci-dessous) :

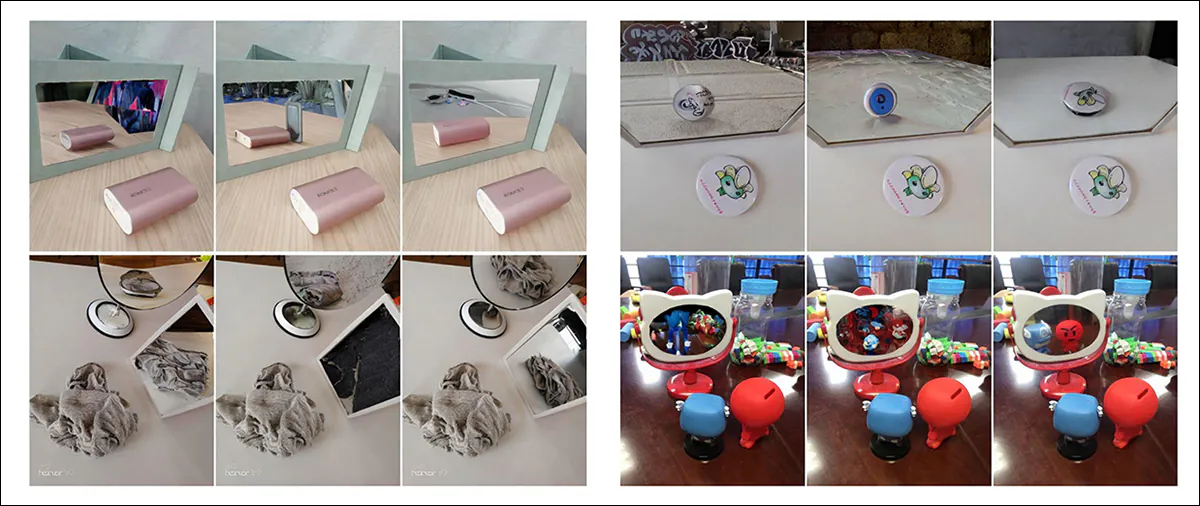

Résultats de scènes du monde réel en comparant MirrorFusion, MirrorFusion 2.0 et MirrorFusion 2.0, affiné sur le jeu de données MSD. MirrorFusion 2.0, selon les auteurs, capture des détails de scène complexes avec plus de précision, y compris des objets encombrés sur une table et la présence de plusieurs miroirs dans un environnement tridimensionnel. Seuls des résultats partiels sont présentés ici, en raison des dimensions des résultats dans le document original, auquel nous renvoyons le lecteur pour les résultats complets et une meilleure résolution.

Ici, les auteurs observent que même si MirrorFusion 2.0 a bien performé sur les jeux de données MirrorBenchV2 et GSO, il a initialement eu du mal avec des scènes du monde réel complexes dans le jeu de données MSD. L’affinement du modèle sur un sous-ensemble de MSD a amélioré sa capacité à gérer des environnements encombrés et plusieurs miroirs, aboutissant à des réflexions plus cohérentes et détaillées sur la partie de test conservée.

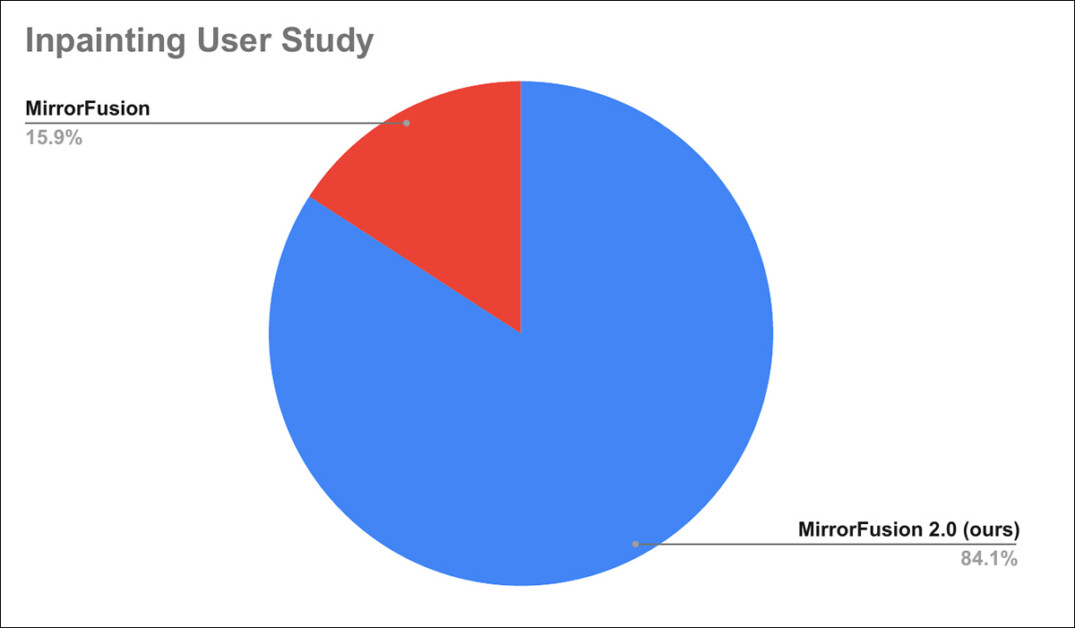

De plus, une étude utilisateur a été menée, dans laquelle 84 % des utilisateurs ont préféré les générations de MirrorFusion 2.0 par rapport à la méthode de référence.

Résultats de l’étude utilisateur.

Puisque les détails de l’étude utilisateur ont été relégués à l’annexe du document, nous renvoyons le lecteur à celle-ci pour les spécificités de l’étude.

Conclusion

Bien que plusieurs des résultats présentés dans le document soient des améliorations impressionnantes par rapport à l’état de l’art, l’état de l’art pour cette poursuite particulière est si médiocre que même une solution globale peu convaincante peut l’emporter avec un minimum d’efforts. L’architecture fondamentale d’un modèle de diffusion est inhospitalière à l’apprentissage fiable et à la démonstration de physique cohérente, de sorte que le problème est mal posé et apparemment non disposé à une solution élégante.

De plus, ajouter des données aux modèles existants est déjà la méthode standard pour remédier aux insuffisances des performances des LDM, avec tous les inconvénients énumérés ci-dessus. Il est raisonnable de supposer que si les futurs jeux de données à grande échelle devaient accorder plus d’attention à la distribution (et à l’annotation) des points de données liés à la réflexion, on pourrait s’attendre à ce que les modèles résultants gèrent mieux ce scénario.

Cependant, le même constat s’applique à de nombreux autres problèmes dans la sortie des LDM – qui peut dire lequel d’entre eux mérite le plus l’effort et l’argent impliqués dans la solution que les auteurs du nouveau document proposent ici ?

Publié pour la première fois le lundi 28 avril 2025. Mardi 29 avril : correction de grammaire dans les derniers paragraphes.