Angle d’Anderson

Vers le contrôle total dans la génération de vidéos par IA

Les modèles de fondation vidéo tels que Hunyuan et Wan 2.1, bien que puissants, ne offrent pas aux utilisateurs le type de contrôle granulaire que la production de films et de télévision (en particulier la production d’effets visuels) exige.

Dans les studios d’effets visuels professionnels, des modèles open-source comme ceux-ci, ainsi que des modèles basés sur des images (plutôt que des vidéos) tels que Stable Diffusion, Kandinsky et Flux, sont généralement utilisés avec une gamme d’outils de support qui adaptent leur sortie brute pour répondre à des besoins créatifs spécifiques. Lorsqu’un réalisateur dit : “Cela a l’air bien, mais pouvons-nous le rendre un peu plus [n] ?” vous ne pouvez pas répondre en disant que le modèle n’est pas suffisamment précis pour gérer de telles demandes.

Au lieu de cela, une équipe d’IA VFX utilisera une gamme de techniques traditionnelles de CGI et de composition, alliées à des procédures et des flux de travail personnalisés développés au fil du temps, afin d’essayer de repousser les limites de la synthèse vidéo un peu plus loin.

Donc, par analogie, un modèle de fondation vidéo est semblable à une installation par défaut d’un navigateur Web comme Chrome ; il fait beaucoup de choses directement, mais si vous voulez qu’il s’adapte à vos besoins, plutôt que l’inverse, vous aurez besoin de quelques plugins.

Les maniaques du contrôle

Dans le monde de la synthèse d’images basée sur la diffusion, le système de troisième partie le plus important est ControlNet.

ControlNet est une technique pour ajouter un contrôle structuré aux modèles de génération basés sur la diffusion, permettant aux utilisateurs de guider la génération d’images ou de vidéos avec des entrées supplémentaires telles que des cartes de contours, des cartes de profondeur ou des informations de pose.

Les différentes méthodes de ControlNet permettent la génération d’images à partir de la profondeur (première rangée), la segmentation sémantique (en bas à gauche) et la génération d’images guidée par la pose d’humains et d’animaux (en bas à gauche).

Au lieu de s’appuyer uniquement sur des invites de texte, ControlNet introduit des branches de réseau de neurones distinctes, ou adaptateurs, qui traitent ces signaux de conditionnement tout en préservant les capacités de génération du modèle de base.

Cela permet des sorties affinées qui s’apparentent plus étroitement aux spécifications de l’utilisateur, ce qui est particulièrement utile dans les applications où un contrôle précis de la composition, de la structure ou du mouvement est requis :

Avec une pose guidante, différents types de sorties précises peuvent être obtenus via ControlNet. Source : https://arxiv.org/pdf/2302.05543

Cependant, les cadres d’adaptateur de ce type fonctionnent à l’extérieur d’un ensemble de processus neuronaux qui sont très axés sur l’intérieur. Ces approches ont plusieurs inconvénients.

Premièrement, les adaptateurs sont formés de manière indépendante, ce qui conduit à des conflits de branche lorsqu’ils sont combinés, ce qui peut entraîner une qualité de génération dégradée.

Deuxièmement, ils introduisent une redondance de paramètres, nécessitant une computation et une mémoire supplémentaires pour chaque adaptateur, ce qui rend l’évolutivité inefficace.

Troisièmement, malgré leur flexibilité, les adaptateurs produisent souvent des résultats sous-optimaux par rapport aux modèles qui sont entièrement affinés pour la génération multi-condition. Ces problèmes rendent les méthodes basées sur les adaptateurs moins efficaces pour les tâches nécessitant une intégration transparente de plusieurs signaux de contrôle.

Idéalement, les capacités de ControlNet devraient être formées de manière native dans le modèle, de manière modulaire qui pourrait accueillir plus tard des innovations évidentes telles que la génération simultanée de vidéos et d’audio, ou des capacités de synchronisation labiale natives (pour l’audio externe).

Comme cela se présente, chaque pièce de fonctionnalité supplémentaire représente soit une tâche de post-production, soit une procédure non native qui doit naviguer dans les poids étroitement liés et sensibles de n’importe quel modèle de fondation sur lequel elle fonctionne.

FullDiT

Dans cette impasse arrive une nouvelle offre de Chine, qui propose un système où des mesures de type ControlNet sont intégrées directement dans un modèle de génération de vidéos à l’époque de la formation, plutôt que d’être reléguées à une après-pensée.

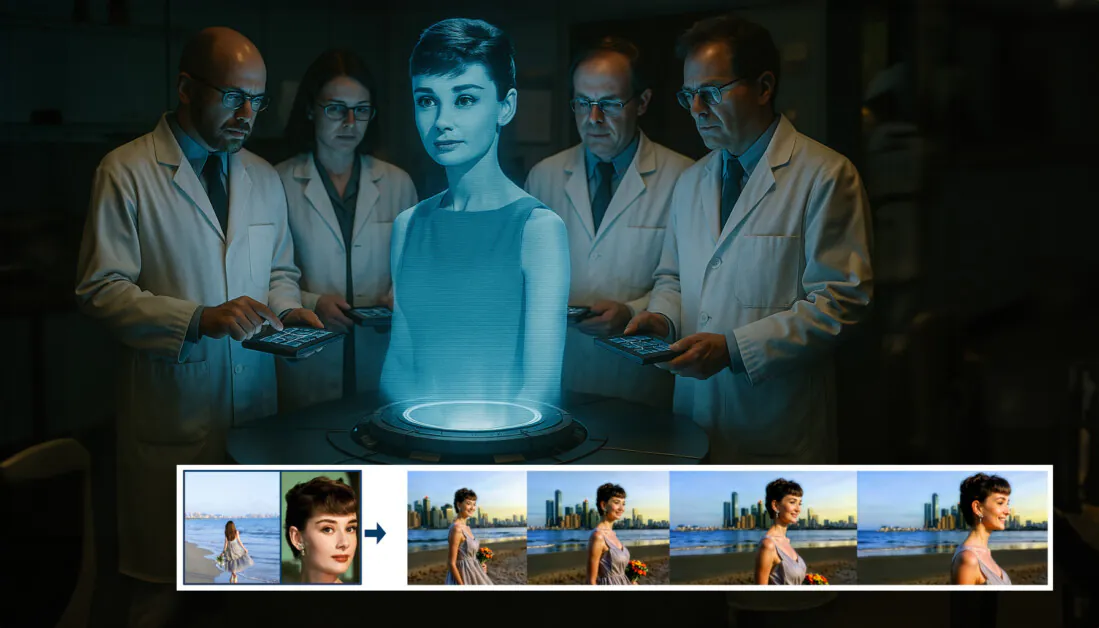

À partir du nouveau document : l’approche FullDiT peut intégrer l’imposition d’identité, la profondeur et le mouvement de caméra dans une génération native, et peut invoquer n’importe quelle combinaison de ceux-ci à la fois. Source : https://arxiv.org/pdf/2503.19907

Intitulé FullDiT, la nouvelle approche fusionne des conditions multi-tâches telles que le transfert d’identité, la cartographie de profondeur et le mouvement de caméra dans une partie intégrée d’un modèle de génération de vidéos, pour lequel les auteurs ont produit un modèle prototype formé et des extraits de vidéos sur un site de projet.

Dans l’exemple ci-dessous, nous voyons des générations qui intègrent le mouvement de caméra, les informations d’identité et les informations de texte (c’est-à-dire les invites de texte guidant l’utilisateur) :

Cliquez pour jouer. Exemples d’imposition de contrôle de type ControlNet avec uniquement un modèle de fondation formé de manière native. Source : https://fulldit.github.io/

Il convient de noter que les auteurs ne proposent pas leur modèle expérimental formé comme un modèle de fondation fonctionnel, mais plutôt comme une preuve de concept pour des modèles de vidéos natives texte-vidéo (T2V) et image-vidéo (I2V) qui offrent aux utilisateurs plus de contrôle que juste une invite d’image ou un texte.

Puisqu’il n’y a pas de modèles similaires de ce type, les chercheurs ont créé un nouveau référence intitulé FullBench, pour l’évaluation des vidéos multi-tâches, et affirment une performance de pointe dans les tests semblables qu’ils ont conçus contre les approches antérieures. Cependant, puisque FullBench a été conçu par les auteurs eux-mêmes, son objectivité est non testée, et son ensemble de données de 1 400 cas peut être trop limité pour des conclusions plus larges.

Peut-être l’aspect le plus intéressant de l’architecture que le document présente est son potentiel pour intégrer de nouveaux types de contrôle. Les auteurs déclarent :

‘Dans ce travail, nous n’explorons que les conditions de contrôle de la caméra, des identités et des informations de profondeur. Nous n’avons pas examiné davantage d’autres conditions et modalités telles que l’audio, la parole, le nuage de points, les boîtes de délimitation d’objets, le flux optique, etc. Bien que la conception de FullDiT puisse intégrer sans effort d’autres modalités avec une modification minimale de l’architecture, la question de savoir comment adapter rapidement et de manière rentable les modèles existants à de nouvelles conditions et modalités est toujours une question importante qui nécessite une exploration plus approfondie.’

Bien que les chercheurs présentent FullDiT comme un pas en avant dans la génération de vidéos multi-tâches, il convient de considérer que ce nouveau travail s’appuie sur des architectures existantes plutôt que d’introduire un paradigme fondamentalement nouveau.

Cependant, FullDiT se dresse actuellement seul (à ma connaissance) en tant que modèle de fondation de vidéo avec des installations de type ControlNet ‘codées en dur’ – et il est bon de voir que l’architecture proposée peut également accueillir des innovations ultérieures.

Cliquez pour jouer. Exemples de mouvements de caméra contrôlés par l’utilisateur, à partir du site du projet.

Le nouveau document est intitulé FullDiT : Modèle de génération de vidéos multi-tâches avec attention complète, et provient de neuf chercheurs à travers Kuaishou Technology et l’Université chinoise de Hong Kong. La page du projet est ici et les nouvelles données de référence sont sur Hugging Face.

Méthode

Les auteurs soutiennent que le mécanisme d’attention unifié de FullDiT permet un apprentissage de représentation transmodale plus solide en capturant à la fois les relations spatiales et temporelles entre les conditions :

Selon le nouveau document, FullDiT intègre plusieurs conditions d’entrée à travers une attention complète, les convertissant en une séquence unifiée. En revanche, les modèles basés sur les adaptateurs (à gauche) utilisent des modules distincts pour chaque entrée, ce qui entraîne une redondance, des conflits et des performances plus faibles.

Contrairement aux configurations basées sur les adaptateurs qui traitent chaque flux d’entrée séparément, cette structure d’attention partagée évite les conflits de branche et réduit la surcharge de paramètres. Ils affirment également que l’architecture peut être étendue à de nouveaux types d’entrée sans réaménagement majeur – et que le schéma de modèle montre des signes de généralisation à des combinaisons de conditions non vues pendant la formation, telles que le lien entre le mouvement de caméra et l’identité du personnage.

Cliquez pour jouer. Exemples de génération d’identité à partir du site du projet.

Dans l’architecture de FullDiT, toutes les entrées de conditionnement – telles que le texte, le mouvement de caméra, l’identité et la profondeur – sont d’abord converties en un format de jeton unifié. Ces jetons sont ensuite concaténés en une seule séquence longue, qui est traitée à travers une pile de couches de transformateur en utilisant une attention complète. Cette approche suit les travaux antérieurs tels que Open-Sora Plan et Movie Gen.

Cette conception permet au modèle d’apprendre les relations temporelles et spatiales conjointement sur toutes les conditions. Chaque bloc de transformateur fonctionne sur l’ensemble de la séquence, permettant des interactions dynamiques entre les modalités sans s’appuyer sur des modules distincts pour chaque entrée – et, comme nous l’avons noté, l’architecture est conçue pour être extensible, ce qui rend beaucoup plus facile l’intégration de signaux de contrôle supplémentaires à l’avenir, sans changements structurels majeurs.

Le pouvoir des trois

FullDiT convertit chaque signal de contrôle en un format de jeton standardisé afin que toutes les conditions puissent être traitées ensemble dans un cadre d’attention unifié. Pour le mouvement de caméra, le modèle encode une séquence de paramètres extrinsèques – tels que la position et l’orientation – pour chaque trame. Ces paramètres sont horodatés et projetés en vecteurs d’incrustation qui reflètent la nature temporelle du signal.

Les informations d’identité sont traitées différemment, car elles sont inhérentement spatiales plutôt que temporelles. Le modèle utilise des cartes d’identité qui indiquent quels personnages sont présents dans quelle partie de chaque trame. Ces cartes sont divisées en morceaux, avec chaque morceau projeté en un incrustation qui capture les indices d’identité spatiale, permettant au modèle d’associer des régions spécifiques de la trame à des entités spécifiques.

La profondeur est un signal spatio-temporel, et le modèle la gère en divisant les vidéos de profondeur en morceaux 3D qui s’étendent à la fois dans l’espace et le temps. Ces morceaux sont ensuite incrustés d’une manière qui préserve leur structure entre les trames.

Une fois incrustés, tous ces jetons de condition (caméra, identité et profondeur) sont concaténés en une seule séquence longue, permettant à FullDiT de les traiter ensemble en utilisant une attention complète. Cette représentation partagée permet au modèle d’apprendre les interactions entre les modalités et dans le temps sans s’appuyer sur des flux de traitement isolés.

Données et tests

L’approche de formation de FullDiT reposait sur des ensembles de données annotés de manière sélective adaptés à chaque type de conditionnement, plutôt que d’exiger que toutes les conditions soient présentes simultanément.

Pour les conditions textuelles, l’initiative suit l’approche de captionnage structuré décrite dans le projet MiraData.

Pipeline de collecte et d’annotation de vidéos du projet MiraData. Source : https://arxiv.org/pdf/2407.06358

Pour le mouvement de caméra, l’ensemble de données RealEstate10K était la principale source de données, en raison de ses annotations de haute qualité des paramètres de caméra.

Cependant, les auteurs ont observé que la formation exclusive sur des ensembles de données de scènes statiques de caméra telles que RealEstate10K tendait à réduire les mouvements d’objets et d’humains dynamiques dans les vidéos générées. Pour contrer cela, ils ont effectué un affinage supplémentaire en utilisant des ensembles de données internes qui comprenaient des mouvements de caméra plus dynamiques.

Les annotations d’identité ont été générées en utilisant le pipeline développé pour le projet ConceptMaster, qui a permis un filtrage et une extraction efficaces d’informations d’identité à grain fin.

Le cadre ConceptMaster est conçu pour résoudre les problèmes de découplage d’identité tout en préservant la fidélité des concepts dans les vidéos personnalisées. Source : https://arxiv.org/pdf/2501.04698

Les annotations de profondeur ont été obtenues à partir de l’ensemble de données Panda-70M en utilisant Depth Anything.

Optimisation via l’ordre des données

Les auteurs ont également mis en œuvre un calendrier de formation progressif, en introduisant des conditions plus difficiles plus tôt dans la formation pour s’assurer que le modèle acquérait des représentations robustes avant que les tâches plus simples soient ajoutées. L’ordre de formation a progressé de texte à caméra conditions, puis identités, et enfin profondeur, avec des tâches plus faciles généralement introduites plus tard et avec moins d’exemples.

Les auteurs soulignent la valeur de l’ordre du travail de cette manière :

‘Pendant la phase de préformation, nous avons noté que les tâches plus difficiles nécessitent un temps de formation plus long et devraient être introduites plus tôt dans le processus d’apprentissage. Ces tâches difficiles impliquent des distributions de données complexes qui diffèrent considérablement de la sortie vidéo, nécessitant que le modèle possède une capacité suffisante pour les capturer et les représenter avec précision.

‘Inversement, introduire des tâches plus faciles trop tôt peut amener le modèle à donner la priorité à leur apprentissage en premier lieu, car elles fournissent des rétroactions d’optimisation plus immédiates, ce qui entrave la convergence des tâches plus difficiles.’

Une illustration de l’ordre de formation des données adopté par les chercheurs, avec le rouge indiquant un plus grand volume de données.

Après la préformation initiale, une phase de finition finale a encore affiné le modèle pour améliorer la qualité visuelle et la dynamique du mouvement. Ensuite, la formation a suivi celle d’un cadre de diffusion standard : du bruit a été ajouté aux latents de la vidéo, et le modèle a appris à prédire et à supprimer, en utilisant les jetons de condition incrustés comme guide.

Pour évaluer efficacement FullDiT et fournir une comparaison équitable avec les méthodes existantes, et en l’absence de la disponibilité de tout autre référence approprié, les auteurs ont introduit FullBench, un ensemble de référence de 1 400 cas de test distincts.

Un exemple d’explorateur de données pour le nouveau référence FullBench. Source : https://huggingface.co/datasets/KwaiVGI/FullBench

Chaque point de données fournit des annotations de vérité de terrain pour divers signaux de conditionnement, notamment mouvement de caméra, identité et profondeur.

Métriques

Les auteurs ont évalué FullDiT en utilisant dix métriques couvrant cinq aspects principaux de la performance : alignement du texte, contrôle de la caméra, similarité d’identité, précision de la profondeur et qualité générale de la vidéo.

L’alignement du texte a été mesuré en utilisant CLIP similarity, tandis que le contrôle de la caméra a été évalué à travers erreur de rotation (RotErr), erreur de translation (TransErr) et cohérence du mouvement de caméra (CamMC), suivant l’approche de CamI2V (dans le projet CameraCtrl).

La similarité d’identité a été évaluée en utilisant DINO-I et CLIP-I, et la précision du contrôle de la profondeur a été quantifiée en utilisant Mean Absolute Error (MAE).

La qualité de la vidéo a été jugée avec trois métriques à partir de MiraData : similarité de trame de niveau CLIP pour la fluidité ; distance de mouvement basée sur le flux optique pour la dynamique ; et scores esthétiques LAION-Aesthetic pour l’attrait visuel.

Formation

Les auteurs ont formé FullDiT en utilisant un modèle de diffusion texte-vidéo interne (non divulgué) contenant environ un milliard de paramètres. Ils ont intentionnellement choisi une taille de paramètre modeste pour maintenir l’équité dans les comparaisons avec les méthodes antérieures et assurer la reproductibilité.

Puisque les vidéos de formation différaient en longueur et en résolution, les auteurs ont standardisé chaque lot en redimensionnant et en rembourrant les vidéos à une résolution commune, en échantillonnant 77 trames par séquence, et en utilisant une attention appliquée et des masques de perte pour optimiser l’efficacité de la formation.

L’optimiseur Adam a été utilisé à un taux d’apprentissage de 1×10−5 sur un cluster de 64 GPU NVIDIA H800, pour un total combiné de 5 120 Go de VRAM (considérez que dans les communautés de synthèse d’enthousiastes, 24 Go sur une RTX 3090 est encore considéré comme un standard de luxe).

Le modèle a été formé pendant environ 32 000 étapes, en incorporant jusqu’à trois identités par vidéo, ainsi que 20 trames de conditions de caméra et 21 trames de conditions de profondeur, les deux étant échantillonnées de manière uniforme sur les 77 trames.

Pour l’inférence, le modèle a généré des vidéos à une résolution de 384×672 pixels (environ cinq secondes à 15 images par seconde) avec 50 étapes d’inférence de diffusion et une échelle de guidage sans classeur de cinq.

Méthodes antérieures

Pour l’évaluation caméra-vidéo, les auteurs ont comparé FullDiT à MotionCtrl, CameraCtrl et CamI2V, avec tous les modèles formés en utilisant l’ensemble de données RealEstate10k pour assurer la cohérence et l’équité.

Dans la génération conditionnée par l’identité, puisqu’aucun modèle multi-identité comparable ouvert n’était disponible, le modèle a été comparé au modèle ConceptMaster à 1 milliard de paramètres, en utilisant les mêmes données de formation et la même architecture.

Pour les tâches de profondeur-vidéo, des comparaisons ont été effectuées avec Ctrl-Adapter et ControlVideo.

Résultats quantitatifs pour la génération de vidéos à tâche unique. FullDiT a été comparé à MotionCtrl, CameraCtrl et CamI2V pour la génération de vidéos à partir de caméra ; ConceptMaster (version à 1 milliard de paramètres) pour la génération de vidéos à partir d’identité ; et Ctrl-Adapter et ControlVideo pour la génération de vidéos à partir de profondeur. Tous les modèles ont été évalués en utilisant leurs paramètres par défaut. Pour la cohérence, 16 trames ont été échantillonnées de manière uniforme à partir de chaque méthode, correspondant à la longueur de sortie des modèles antérieurs.

Les résultats indiquent que FullDiT, malgré la gestion de plusieurs signaux de conditionnement simultanément, a atteint des performances de pointe dans les métriques liées au texte, au mouvement de caméra, à l’identité et au contrôle de la profondeur.

Dans les métriques de qualité globale, le système a généralement surpassé les autres méthodes, bien que sa fluidité ait été légèrement inférieure à celle de ConceptMaster. Ici, les auteurs commentent :

‘La fluidité de FullDiT est légèrement inférieure à celle de ConceptMaster, car le calcul de la fluidité est basé sur la similarité CLIP entre les trames adjacentes. Puisque FullDiT présente une dynamique nettement supérieure à celle de ConceptMaster, la métrique de fluidité est affectée par les grandes variations entre les trames adjacentes.

‘Pour le score esthétique, puisque le modèle de notation favorise les images dans le style de la peinture et que ControlVideo génère généralement des vidéos dans ce style, il obtient un score élevé en esthétique.’

En ce qui concerne la comparaison qualitative, il pourrait être préférable de se référer aux vidéos d’exemple sur le site du projet FullDiT, puisque les exemples PDF sont inévitablement statiques (et également trop grands pour être reproduits en entier ici).

La première section des résultats qualitatifs dans le PDF. Veuillez vous référer au document source pour les exemples supplémentaires, qui sont trop étendus pour être reproduits ici.