Intelligence Artificielle

La définition insaisissable de « Deepfake »

Une nouvelle étude convaincante menée en Allemagne critique la Loi de l'UE sur l'IA définition du terme « deepfake » jugée trop vague, notamment dans le contexte de la manipulation d'images numériques. Les auteurs soutiennent que l'accent mis par la loi sur les contenus ressemblant à des personnes ou des événements réels – tout en étant potentiellement apparaissant faux – manque de clarté.

Ils soulignent également que les exceptions prévues par la loi pour le « montage standard » (c’est-à-dire les modifications mineures des images assistées par l’IA) ne tiennent pas compte à la fois de l’influence omniprésente de l’IA dans les applications grand public et de la nature subjective des conventions artistiques antérieures à l’avènement de l’IA.

Une législation imprécise sur ces questions engendre deux risques majeurs : un « effet paralysant », lorsque la large portée interprétative de la loi étouffe l’innovation et l’adoption de nouveaux systèmes ; et un « effet de contournement de la loi », lorsque la loi est ignorée comme étant excessive ou non pertinente.

Dans les deux cas, les lois vagues transfèrent en réalité la responsabilité d’établir des définitions juridiques pratiques sur les décisions judiciaires futures – une approche prudente et peu risquée de la législation.

Les technologies de manipulation d'images basées sur l'IA semblent nettement en avance sur la capacité de la législation à les gérer. Par exemple, l'étude observe que la flexibilité croissante du concept de post-traitement « automatique » piloté par l'IA est illustrée par la « Optimiseur de scène » fonction dans les appareils photo Samsung récents, qui peut remplacer les images de la lune prises par l'utilisateur (un challengeant sujet), avec une image « raffinée » pilotée par l'IA :

En haut à gauche, un exemple du nouvel article d'une véritable image de la lune prise par un utilisateur, à gauche d'une version améliorée par Samsung créée automatiquement avec Scene Optimizer ; à droite, l'illustration officielle de Samsung du processus derrière cela ; en bas à gauche, des exemples de l'utilisateur de Reddit u/ibreakphotos, montrant (à gauche) une image délibérément floue de la lune et (à droite), la réinvention de cette image par Samsung - même si la photo source était une photo d'un moniteur, et non de la vraie lune. Sources (dans le sens des aiguilles d'une montre à partir du coin supérieur gauche) : https://arxiv.org/pdf/2412.09961 ; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/ ; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

Dans le coin inférieur gauche de l'image ci-dessus, nous voyons deux images de la lune. Celle de gauche est une photo utilisée par un utilisateur de Reddit. Ici, l'image a été volontairement floutée et réduite par l'utilisateur.

À droite, on voit une photo de la même image dégradée, prise avec un appareil photo Samsung avec post-traitement piloté par IA. L'appareil a automatiquement « augmenté » l'objet « lune » reconnu, même s'il ne s'agissait pas de la vraie lune.

Le document formule des critiques plus profondes à l'encontre de Meilleure prise fonctionnalité intégrée aux récents smartphones de Google – un controversé Fonctionnalité d'IA qui édite ensemble les « meilleures » parties d'une photo de groupe, en scannant plusieurs secondes d'une séquence photographique afin que les sourires soient déplacés vers l'avant ou vers l'arrière dans le temps si nécessaire - et que personne ne soit affiché en train de cligner des yeux.

L’article soutient que ce type de processus composite a le potentiel de déformer les événements :

« [Dans] une photo de groupe typique, un spectateur moyen considérerait probablement toujours la photo résultante comme authentique. Le sourire qui est inséré existait quelques secondes après la prise de la photo restante.

« D'un autre côté, la durée de dix secondes de la meilleure prise est suffisante pour un changement d'humeur. Une personne peut avoir arrêté de sourire tandis que le reste du groupe rit d'une blague à ses dépens.

« Par conséquent, nous supposons qu’une telle photo de groupe pourrait bien constituer un deep fake. »

L' nouveau papier est intitulé Qu'est-ce qu'un deep fake ? La frontière floue entre traitement légitime et manipulation en vertu de la loi européenne sur l'IA, et provient de deux chercheurs du laboratoire de droit informatique de l'université de Tübingen et de l'université de la Sarre.

Vieux trucs

La manipulation du temps en photographie est bien plus ancienne que l'IA grand public. Les auteurs de la nouvelle étude soulignent l'existence de techniques bien plus anciennes, que l'on peut qualifier d'« inauthentiques », comme la concaténation de plusieurs images séquentielles en une seule. Plage dynamique élevée (HDR) photo, ou une 'cousu' photo panoramique.

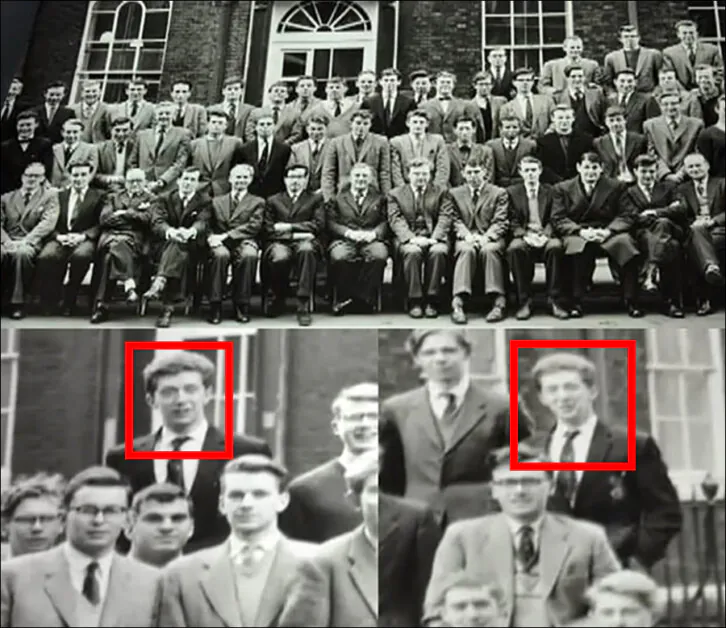

En effet, certaines des falsifications photographiques les plus anciennes et les plus amusantes ont été traditionnellement créées par des écoliers courant d'un bout à l'autre d'un groupe scolaire, en avance sur la trajectoire de la photo spéciale. caméras panoramiques qui étaient autrefois utilisés pour la photographie de groupes sportifs et scolaires – permettant à l’élève d’apparaître deux fois sur la même image :

La tentation de tromper les caméras panoramiques lors des photos de groupe était trop forte pour résister à de nombreux étudiants, qui étaient prêts à risquer une mauvaise séance au bureau du directeur afin de se « cloner » sur les photos de l'école. Source : https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

À moins de prendre une photo en mode RAW, qui convertit le capteur de l'objectif en un fichier très volumineux sans aucune interprétation, il est probable que vos photos numériques ne soient pas totalement authentiques. Les appareils photo appliquent systématiquement des algorithmes d'amélioration tels que la netteté de l'image et la balance des blancs, et ce, depuis les origines de la photographie numérique grand public.

Les auteurs du nouvel article soutiennent que même ces anciens types d'augmentation de photos numériques ne représentent pas la « réalité », puisque ces méthodes sont conçues pour rendre les photos plus agréables, et non plus « réelles ».

L’étude suggère que la loi européenne sur l’IA, même avec des amendements ultérieurs tels que Considérants 123–27, place toutes les productions photographiques dans un preuve cadre inadapté au contexte dans lequel les photos sont produites de nos jours, contrairement à la nature (nominativement objective) des images de caméras de sécurité ou de la photographie médico-légale. La plupart des images concernées par la loi sur l'IA sont plus susceptibles de provenir de contextes où les fabricants et les plateformes en ligne promouvoir activement interprétation photographique créative, incluant l'utilisation de l'IA.

Les chercheurs suggèrent que les photos « n'ont jamais été une représentation objective de la réalité ». Des facteurs tels que l'emplacement de l'appareil photo, la profondeur de champ choisie et les choix d'éclairage contribuent tous à rendre une photographie profondément subjective.

L'article observe que les tâches de « nettoyage » de routine – telles que l'élimination de la poussière des capteurs ou des lignes électriques indésirables d'une scène par ailleurs bien composée – n'étaient semi--automatisé avant l'essor de l'IA : les utilisateurs devaient sélectionner manuellement une région ou lancer un processus pour obtenir le résultat souhaité.

Aujourd'hui, ces opérations sont souvent déclenchées par des invites textuelles, notamment dans des outils comme Photoshop. Pour le grand public, ces fonctionnalités sont de plus en plus automatisées. sans la contribution de l'utilisateur – un résultat qui est apparemment considéré par les fabricants et les plateformes comme « évidemment souhaitable ».

Le sens dilué de « Deepfake »

L’un des principaux défis de la législation relative aux images modifiées et générées par l’IA est l’ambiguïté du terme « deepfake », dont la signification s’est considérablement élargie au cours des deux dernières années.

À l’origine, les termes s’appliquaient uniquement à la sortie vidéo de systèmes basés sur un autoencodeur comme DeepFaceLab et FaceSwap, tous deux dérivés de code anonyme publié sur Reddit fin 2017.

À partir de 2022, l'arrivée de Modèles de diffusion latente (LDM) tels que Diffusion stable Flux, ainsi que des systèmes de conversion de texte en vidéo tels que Sora, permettrait également l'échange d'identité et la personnalisation, avec une résolution, une polyvalence et une fidélité améliorées. Il était désormais possible de créer des modèles basés sur la diffusion qui pouvaient représenter célébrités et les politiciens. Le terme « deepfake » étant déjà un trésor médiatique pour les producteurs de médias, il a été étendu pour couvrir ces systèmes.

Plus tard, tant dans les médias que dans la littérature scientifique, le terme a également inclus usurpation d'identité basée sur du texteÀ ce stade, le sens originel de « deepfake » était pratiquement perdu, tandis que son sens étendu évoluait constamment et était de plus en plus dilué.

Mais le mot était si incendiaire et galvanisant, et il était devenu un puissant point de référence politique et médiatique. Il s’est avéré impossible de renoncer. Il a attiré les lecteurs vers les sites Web, les financements vers les chercheurs et l’attention vers les politiciens. Cette ambiguïté lexicale est le principal sujet de la nouvelle recherche.

Comme le font remarquer les auteurs, l’article 3(60) de la loi européenne sur l’IA décrit quatre conditions qui définissent un « deepfake ».

1 : La vraie lune

Tout d’abord, le contenu doit être généré ou manipulé, c'est-à-dire soit créées de toutes pièces grâce à l'IA (génération), soit modifiées à partir de données existantes (manipulation). L'article souligne la difficulté de distinguer les résultats « acceptables » de la retouche d'images des deepfakes manipulateurs, étant donné que les photos numériques ne sont, de toute façon, jamais de véritables représentations de la réalité.

L'article soutient qu'une lune générée par Samsung est sans doute authentique, car il est peu probable que la lune change d'apparence et que le contenu généré par l'IA, formé sur de véritables images lunaires, est donc susceptible d'être précis.

Cependant, les auteurs affirment également que, puisque le système Samsung s'est avéré capable de générer une image « améliorée » de la lune dans un cas où l'image source n'était pas la lune elle-même, cela serait considéré comme un « deepfake ».

Il serait peu pratique d’établir une liste exhaustive des différents cas d’utilisation autour de ce type de ad hoc fonctionnalité. La charge de la définition semble donc revenir, une fois de plus, aux tribunaux.

2 : Textes falsifiés

Deuxièmement, le contenu doit être sous forme d'image, d'audio ou de vidéo. Le contenu textuel, bien que soumis à d’autres obligations de transparence, n’est pas considéré comme un deepfake en vertu de la loi sur l’IA. Ce point n’est pas abordé en détail dans la nouvelle étude, bien qu’il puisse avoir une incidence notable sur l’efficacité de visuel deepfakes (voir ci-dessous).

3 : Problèmes du monde réel

Troisièmement, le contenu doit ressembler à des personnes, des objets, des lieux, des entités ou des événements existants. Cette condition établit un lien avec le monde réel, ce qui signifie que des images purement fabriquées, même si elles sont photoréalistes, ne seraient pas qualifiées de deepfake. Considérant 134 La loi européenne sur l'IA met l'accent sur l'aspect « ressemblance » en ajoutant le mot « sensiblement » (un report apparent aux jugements juridiques ultérieurs).

Les auteurs, citant travail antérieur, demandez-vous si un visage généré par l'IA doit appartenir à une personne réelle ou s'il doit seulement être correctement similaires à une personne réelle, afin de satisfaire à cette définition.

Par exemple, comment peut-on déterminer si une séquence d’images photoréalistes représentant l’homme politique Donald Trump a une intention d’usurpation d’identité, si les images (ou les textes qui l’accompagnent) ne le mentionnent pas spécifiquement ? La reconnaissance faciale? Des sondages auprès des utilisateurs ? La définition du « bon sens » selon un juge ?

Pour revenir à la question des « TextFakes » (voir ci-dessus), les mots constituent souvent une part importante de l'acte d'un visuel deepfake. Par exemple, il est possible de prendre une image ou une vidéo (non modifiée) de «personne a' et dire, dans une légende ou une publication sur les réseaux sociaux, que l'image est de 'personne b' (en supposant que les deux personnes se ressemblent).

Dans un tel cas, aucune IA n'est nécessaire, et le résultat peut être étonnamment efficace – mais une approche aussi low-tech constitue-t-elle également un « deepfake » ?

4 : Retoucher, remodeler

Enfin, le contenu doit paraître authentique ou véridique à une personne. Cette condition met l'accent sur la ou des spectateurs humains. Le contenu qui n'est reconnu comme représentant une personne ou un objet réel que par un algorithme mais être considéré comme un deepfake.

De toutes les conditions énoncées au paragraphe 3(60), celle-ci s’en remet le plus évidemment au jugement ultérieur d’un tribunal, puisqu’elle ne permet aucune interprétation par des moyens techniques ou mécanisés.

Il est évident qu’il existe des difficultés inhérentes à la recherche d’un consensus sur une stipulation aussi subjective. Les auteurs observent, par exemple, que différentes personnes et différents types de personnes (comme les enfants et les adultes) peuvent être disposés à croire différemment à un deepfake particulier.

Les auteurs soulignent également que les capacités d'IA avancées d'outils comme Photoshop remettent en question les définitions traditionnelles du « deepfake ». Si ces systèmes peuvent inclure des protections de base contre les contenus controversés ou interdits, ils élargissent considérablement le concept de « retouche ». Les utilisateurs peuvent désormais ajouter ou supprimer des objets de manière très convaincante et photoréaliste, atteignant ainsi un niveau d'authenticité professionnel qui redéfinit les limites de la manipulation d'images.

Les auteurs déclarent:

« Nous soutenons que la définition actuelle des deep fakes dans la loi sur l'IA et les obligations correspondantes ne sont pas suffisamment précises pour relever les défis posés par les deep fakes. En analysant le cycle de vie d'une photo numérique, du capteur de l'appareil photo aux fonctions d'édition numérique, nous constatons que :

« (1.) Les deep fakes sont mal définis dans la loi européenne sur l'IA. La définition laisse trop de marge pour définir ce qu'est un deep fake.

« (2.) Il n’est pas clair comment les fonctions d’édition telles que la fonction « meilleure prise » de Google peuvent être considérées comme une exception aux obligations de transparence.

« (3.) L’exception pour les images substantiellement modifiées soulève des questions sur ce qui constitue une modification substantielle du contenu et sur la question de savoir si cette modification doit ou non être perceptible par une personne physique. »

Prendre une exception

La loi européenne sur l’IA contient des exceptions qui, selon les auteurs, peuvent être très permissives. Article 50 (2), affirment-ils, offre une exception dans les cas où la majorité d'une image source originale n'est pas modifiée. Les auteurs notent :

« Que peut-on considérer comme un contenu au sens de l'article 50(2) dans le cas d'audio, d'images et de vidéos numériques ? Par exemple, dans le cas d'images, faut-il considérer l'espace pixel ou l'espace visible perceptible par l'homme ? Des manipulations substantielles dans l'espace pixel pourraient ne pas modifier la perception humaine, tandis que de légères perturbations dans cet espace peuvent la modifier radicalement. »

Les chercheurs donnent l'exemple de l'ajout d'une arme de poing sur la photo d'une personne pointant vers quelqu'un. En ajoutant l'arme, on ne modifie que 5 % de l'image ; cependant, la signification sémantique de la partie modifiée est notable. Il semble donc que cette exception ne tienne pas compte de la compréhension « de bon sens » de l'effet qu'un petit détail peut avoir sur la signification globale d'une image.

L'article 50(2) prévoit également des exceptions pour une « fonction d'assistance à l'édition standard ». Puisque la loi ne définit pas ce que signifie « édition standard », même des fonctionnalités de post-traitement aussi extrêmes que Best Take de Google semblent être protégées par cette exception, observent les auteurs.

Conclusion

L’intention déclarée du nouveau travail est d’encourager l’étude interdisciplinaire autour de la régulation des deepfakes et de servir de point de départ à de nouveaux dialogues entre informaticiens et juristes.

Cependant, le document lui-même succombe à la tautologie à plusieurs endroits : il utilise fréquemment le terme « deepfake » comme si sa signification était évidente, tout en s'en prenant à la loi européenne sur l'IA pour ne pas avoir défini ce qui constitue réellement un deepfake.

Première publication le lundi 16 décembre 2024