Intelligence artificielle

StyleTTS 2 : Synthèse vocale de niveau humain avec de grands modèles de langage de parole

Grâce à l’augmentation des approches de synthèse vocale naturelle et synthétique, l’une des principales réalisations que l’industrie de l’IA a accomplies au cours des dernières années est de synthétiser efficacement des cadres de texte-à-parole avec des applications potentielles dans différents secteurs, notamment les livres audio, les assistants virtuels, les narrations vocales et bien plus encore, certains modèles de pointe offrant des performances et une efficacité de niveau humain sur une large gamme de tâches liées à la parole. Cependant, malgré leurs solides performances, il y a encore place pour l’amélioration des tâches grâce à la parole expressive et diverse, à la nécessité d’une grande quantité de données d’entraînement pour optimiser les cadres de texte-à-parole à zéro tir, et à la robustesse pour les textes hors distribution (OOD) ou hors de la distribution, ce qui amène les développeurs à travailler sur un cadre de texte-à-parole plus robuste et plus accessible.

Dans cet article, nous allons parler de StyleTTS-2, un cadre de texte-à-parole robuste et innovant qui est construit sur les fondements du cadre StyleTTS, et vise à présenter l’étape suivante vers les systèmes de texte-à-parole de pointe. Le cadre StyleTTS2 modélise les styles de parole comme des variables aléatoires latentes, et utilise un modèle de diffusion probabiliste pour échantillonner ces styles de parole ou variables aléatoires, ce qui permet au cadre StyleTTS2 de synthétiser une parole réaliste de manière efficace sans utiliser de références audio. Grâce à cette approche, le cadre StyleTTS2 est en mesure de fournir de meilleurs résultats et montre une haute efficacité par rapport aux cadres de texte-à-parole de pointe actuels, mais est également capable de tirer parti de la synthèse vocale diverse offerte par les cadres de modèles de diffusion. Nous allons discuter du cadre StyleTTS2 en détail, et parler de son architecture et de sa méthodologie tout en jetant un coup d’œil aux résultats obtenus par le cadre. Alors, commençons.

StyleTTS2 pour la synthèse de texte à parole : Une introduction

StyleTTS2 est un modèle de synthèse de texte à parole innovant qui fait le prochain pas vers la construction de cadres de TTS de niveau humain, et il est construit sur StyleTTS, un modèle de génération de parole basé sur le style. Le cadre StyleTTS2 modélise les styles de parole comme des variables aléatoires latentes, et utilise un modèle de diffusion probabiliste pour échantillonner ces styles de parole ou variables aléatoires, ce qui permet au cadre StyleTTS2 de synthétiser une parole réaliste de manière efficace sans utiliser de références audio. La modélisation des styles comme des variables aléatoires latentes est ce qui sépare le cadre StyleTTS2 de son prédécesseur, le cadre StyleTTS, et vise à générer le style de parole le plus approprié pour le texte d’entrée sans avoir besoin d’une référence audio, et est capable d’atteindre des diffusions latentes efficaces tout en tirant parti des capacités de synthèse vocale diversifiée offertes par les modèles de diffusion. De plus, le cadre StyleTTS2 utilise également un modèle de langage de parole pré-entraîné (SLM) comme discriminateur, tel que le cadre WavLM, et le couple avec sa propre approche de modélisation de durée différentielle pour entraîner le cadre de bout en bout, et finalement générer une parole avec une naturalité améliorée. Grâce à l’approche qu’il suit, le cadre StyleTTS2 surpasse les cadres de pointe actuels pour les tâches de génération de parole, et est l’un des cadres les plus efficaces pour le pré-entraînement de grands modèles de parole dans un cadre à zéro tir pour les tâches d’adaptation de locuteur.

En poursuivant, pour fournir une synthèse de texte à parole de niveau humain, le cadre StyleTTs2 intègre les connaissances issues des travaux existants, notamment les modèles de diffusion pour la synthèse de parole, et les grands modèles de langage de parole. Les modèles de diffusion sont généralement utilisés pour les tâches de synthèse de parole en raison de leurs capacités de contrôle fin de la parole et de leurs capacités d’échantillonnage de parole diversifiée. Cependant, les modèles de diffusion ne sont pas aussi efficaces que les cadres non itératifs basés sur GAN, et une raison majeure est la nécessité d’échantillonner des représentations latentes, des formes d’onde et des mélo-spectrogrammes de manière itérative jusqu’à la durée cible de la parole.

D’un autre côté, les travaux récents sur les grands modèles de langage de parole ont indiqué leur capacité à améliorer la qualité des tâches de génération de texte à parole, et à s’adapter bien au locuteur. Les grands modèles de langage de parole convertissent généralement les entrées de texte en représentations quantifiées ou continues dérivées de cadres de langage de parole pré-entraînés pour les tâches de reconstruction de parole. Cependant, les fonctionnalités de ces modèles de langage de parole ne sont pas optimisées directement pour la synthèse de parole. En revanche, le cadre StyleTTS2 tire parti des connaissances acquises par les grands cadres SLM en utilisant un entraînement adversatif pour synthétiser les fonctionnalités des modèles de langage de parole sans utiliser des cartes d’espace latent, et apprend ainsi un espace latent optimisé pour la synthèse de parole.

StyleTTS2 : Architecture et méthodologie

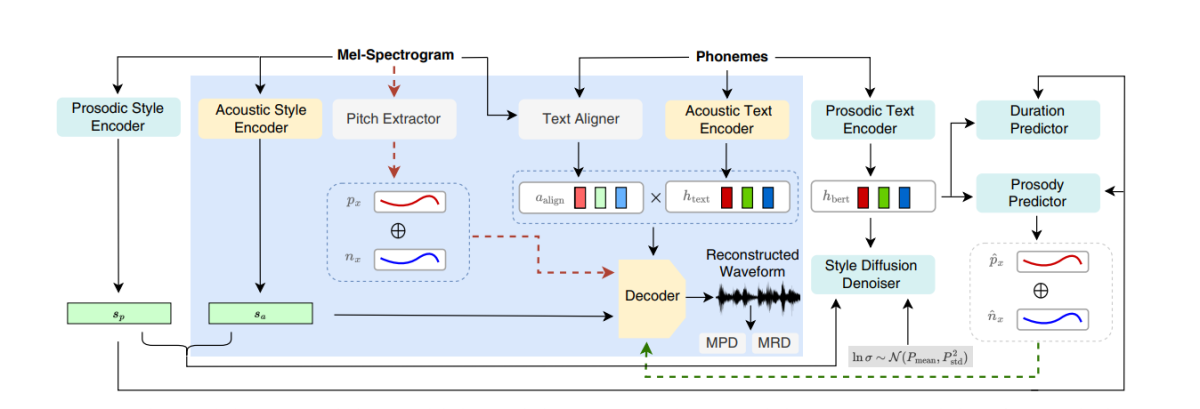

Au cœur du StyleTTS2 se trouve son prédécesseur, le cadre StyleTTS, qui est un cadre de texte à parole non autoregressif qui utilise un encodeur de style pour dériver un vecteur de style à partir de la référence audio, ce qui permet une génération de parole naturelle et expressive. Le vecteur de style utilisé dans le cadre StyleTTS est incorporé directement dans l’encodeur, la durée et les prédicteurs en utilisant l’AdaIN ou la normalisation d’instance adaptative, ce qui permet au modèle StyleTTS de générer des sorties de parole avec des prosodies, des durées et même des émotions variables. Le cadre StyleTTS se compose de 8 modèles au total, divisés en trois catégories

- Modèles acoustiques ou système de génération de parole avec un encodeur de style, un encodeur de texte et un décodeur de parole.

- Système de prédiction de texte à parole utilisant des prédicteurs de prosodie et de durée.

- Système utilitaire comprenant un aligneur de texte, un extracteur de hauteur et un discriminateur pour les besoins de l’entraînement.

Grâce à son approche, le cadre StyleTTS fournit des performances de pointe liées à la synthèse de parole contrôlable et diverse. Cependant, ces performances ont des inconvénients tels que la dégradation de la qualité des échantillons, les limitations expressives et la dépendance à l’égard des applications de parole dans les applications en temps réel.

En améliorant le cadre StyleTTS, le modèle StyleTTS2 donne lieu à des tâches de texte à parole expressives améliorées avec des performances hors distribution améliorées et une qualité de niveau humain élevée. Le cadre StyleTTS2 utilise un processus d’entraînement de bout en bout qui optimise les différents composants avec un entraînement adversatif et une synthèse directe de forme d’onde conjointe. Contrairement au cadre StyleTTS, le cadre StyleTTS2 modélise le style de parole comme une variable latente et l’échantillonne via des modèles de diffusion, générant ainsi des échantillons de parole diversifiés sans utiliser de référence audio. Examinons ces composants en détail.

Entraînement de bout en bout pour l’interférence

Dans le cadre StyleTTS2, une approche d’entraînement de bout en bout est utilisée pour optimiser les différents composants de texte à parole pour l’interférence sans avoir à compter sur des composants fixes. Le cadre StyleTTS2 atteint cela en modifiant le décodeur pour générer la forme d’onde directement à partir du vecteur de style, des courbes de hauteur et d’énergie, et des représentations alignées. Le cadre supprime alors la dernière couche de projection du décodeur et la remplace par un décodeur de forme d’onde. Le cadre StyleTTS2 utilise deux encodeurs : un décodeur basé sur HifiGAN pour générer la forme d’onde directement, et un décodeur basé sur iSTFT pour produire la phase et l’amplitude qui sont converties en formes d’onde pour une interférence et un entraînement plus rapides.

La figure ci-dessus représente les modèles acoustiques utilisés pour le pré-entraînement et l’entraînement conjoint. Pour réduire le temps d’entraînement, les modules sont d’abord optimisés dans la phase de pré-entraînement, suivie de l’optimisation de tous les composants, à l’exception de l’extracteur de hauteur, pendant l’entraînement conjoint. La raison pour laquelle l’entraînement conjoint n’optimise pas l’extracteur de hauteur est qu’il est utilisé pour fournir la vérité de terrain pour les courbes de hauteur.

La figure ci-dessus représente l’entraînement adversatif du modèle de langage de parole et l’interférence avec le cadre WavLM pré-entraîné mais non pré-ajusté. Le processus diffère de celui mentionné ci-dessus car il peut prendre des textes d’entrée variables mais accumule les gradients pour mettre à jour les paramètres à chaque lot.

Diffusion de style

Le cadre StyleTTS2 vise à modéliser la parole comme une distribution conditionnelle via une variable latente qui suit la distribution conditionnelle, et cette variable est appelée le style de parole généralisé, et représente toute caractéristique dans l’échantillon de parole au-delà de la portée de tout contenu phonétique, y compris le stress lexical, la prosodie, le taux de parole et même les transitions de formant.

Discriminateurs de modèle de langage de parole

Les modèles de langage de parole sont réputés pour leurs capacités générales à encoder des informations précieuses sur une large gamme de aspects sémantiques et acoustiques, et les représentations SLM ont traditionnellement pu imiter les perceptions humaines pour évaluer la qualité de la parole synthétisée générée. Le cadre StyleTTS2 utilise une approche d’entraînement adversatif pour utiliser la capacité des encodeurs SLM à effectuer des tâches génératives, et utilise un cadre WavLM de 12 couches comme discriminateur. Cette approche permet au cadre de permettre l’entraînement sur des textes hors distribution (OOD) ou hors de la distribution qui peuvent aider à améliorer les performances. De plus, pour éviter les problèmes de surajustement, le cadre échantillonne des textes OOD et en distribution avec une probabilité égale.

Modélisation de durée différentiable

Traditionnellement, un prédicteur de durée est utilisé dans les cadres de texte à parole qui produit des durées de phonèmes, mais les méthodes de suréchantillonnage que ces prédicteurs de durée utilisent bloquent souvent le flux de gradient pendant le processus d’entraînement de bout en bout, et le cadre NaturalSpeech utilise un suréchantillonneur basé sur l’attention pour la conversion de texte à parole de niveau humain. Cependant, le cadre StyleTTS2 trouve cette approche instable pendant l’entraînement adversatif car le StyleTTS2 s’entraîne en utilisant un suréchantillonnage différentiable avec un entraînement adversatif sans perte de termes supplémentaires en raison de la différence de longueur due aux déviations. Bien que l’utilisation d’une approche de warping temporel dynamique douce puisse aider à atténuer cette différence, son utilisation n’est pas seulement coûteuse en termes de calcul, mais sa stabilité est également une préoccupation lorsqu’elle est utilisée avec des objectifs adverses ou des tâches de reconstruction de mélodie.

Pour contourner cette limitation, le cadre StyleTTC2 propose d’utiliser une nouvelle approche de suréchantillonnage non paramétrique sans entraînement supplémentaire, et capable de prendre en compte des longueurs d’alignement variables. Pour chaque phonème, le cadre StyleTTC2 modélise l’alignement comme une variable aléatoire, et indique l’index de la trame de parole avec laquelle le phonème s’aligne.

Entraînement et évaluation du modèle

Le cadre StyleTTC2 est entraîné et expérimenté sur trois ensembles de données : VCTK, LibriTTS et LJSpeech. La composante à locuteur unique du cadre StyleTTS2 est entraînée en utilisant l’ensemble de données LJSpeech qui contient environ 13 000 échantillons audio, répartis en 12 500 échantillons d’entraînement, 100 échantillons de validation et environ 500 échantillons de test, avec un temps de lecture total d’environ 24 heures. La composante multi-locuteurs du cadre est entraînée sur l’ensemble de données VCTK qui consiste en plus de 44 000 clips audio avec plus de 100 locuteurs individuels avec des accents variables, et est réparti en 43 500 échantillons d’entraînement, 100 échantillons de validation et environ 500 échantillons de test. Enfin, pour équiper le cadre avec des capacités d’adaptation à zéro tir, le cadre est entraîné sur l’ensemble de données combiné LibriTTS qui consiste en des clips audio totalisant environ 250 heures de parole avec plus de 1 150 locuteurs individuels. Pour évaluer ses performances, le modèle utilise deux métriques : MOS-N ou note moyenne d’opinion de naturalité, et MOS-S ou note moyenne d’opinion de similarité.

Résultats

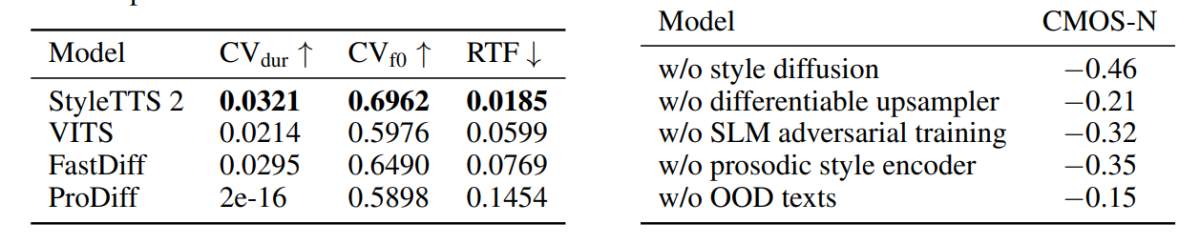

L’approche et la méthodologie utilisées dans le cadre StyleTTS2 sont mises en évidence dans ses performances, car le modèle surpasse plusieurs cadres de TTS de pointe, notamment sur l’ensemble de données NaturalSpeech, et établit ainsi une nouvelle norme pour l’ensemble de données. De plus, le cadre StyleTTS2 surpasse le cadre VITS de pointe sur l’ensemble de données VCTK, et les résultats sont présentés dans la figure suivante.

Le modèle StyleTTS2 surpasse également les modèles précédents sur l’ensemble de données LJSpeech, et ne montre aucun degré de dégradation de la qualité sur les textes hors distribution (OOD) comme le montrent les cadres précédents sur les mêmes métriques. De plus, dans un cadre à zéro tir, le modèle StyleTTC2 surpasse le cadre existant Vall-E en termes de naturalité, bien qu’il soit en retard en termes de similarité. Cependant, il est important de noter que le cadre StyleTTS2 est capable d’atteindre des performances compétitives malgré le fait qu’il n’est entraîné que sur 245 heures d’échantillons audio, par rapport à plus de 60 000 heures d’entraînement pour le cadre Vall-E, ce qui prouve que le StyleTTC2 est une alternative efficace en termes de données par rapport aux méthodes de pré-entraînement existantes utilisées dans le cadre Vall-E.

En poursuivant, en raison du manque de données audio étiquetées d’émotion, le cadre StyleTTC2 utilise le modèle GPT-4 pour générer plus de 500 instances à travers différentes émotions pour la visualisation des vecteurs de style que le cadre crée en utilisant son processus de diffusion.

Dans la première figure, les styles émotionnels en réponse aux sentiments du texte d’entrée sont illustrés par les vecteurs de style du modèle LJSpeech, et démontrent la capacité du cadre StyleTTC2 à synthétiser une parole expressive avec des émotions variées. La deuxième figure représente des clusters distincts formés pour chacun des cinq locuteurs individuels, démontrant ainsi une grande variété provenant d’un seul fichier audio. La dernière figure démontre le cluster lâche des émotions du locuteur 1, et révèle que, malgré certaines chevauchements, les clusters basés sur les émotions sont importants, indiquant ainsi la possibilité de manipuler la tonalité émotionnelle d’un locuteur indépendamment de l’échantillon audio de référence et de son ton d’entrée. Malgré l’utilisation d’une approche basée sur la diffusion, le cadre StyleTTS2 parvient à surperformer les cadres existants de pointe, notamment VITS, ProDiff et FastDiff.

Pensées finales

Dans cet article, nous avons parlé de StyleTTS2, un cadre de texte à parole innovant et robuste qui est construit sur les fondements du cadre StyleTTS, et vise à présenter l’étape suivante vers les systèmes de texte à parole de pointe. Le cadre StyleTTS2 modélise les styles de parole comme des variables aléatoires latentes, et utilise un modèle de diffusion probabiliste pour échantillonner ces styles de parole ou variables aléatoires, ce qui permet au cadre StyleTTS2 de synthétiser une parole réaliste de manière efficace sans utiliser de références audio. Le cadre StyleTTS2 utilise la diffusion de style et les discriminateurs SLM pour atteindre des performances de niveau humain sur les tâches de texte à parole, et parvient à surperformer les cadres existants de pointe sur une large gamme de tâches de parole.