Intelligence artificielle

Diffusion Vidéo Stable : Modèles de Diffusion Vidéo Latents pour les Grandes Données

L’IA générative a été un facteur moteur de la communauté de l’IA depuis un certain temps maintenant, et les progrès réalisés dans le domaine de la modélisation d’images génératives, en particulier avec l’utilisation de modèles de diffusion, ont aidé les modèles de vidéos génératives à progresser de manière significative, non seulement dans la recherche, mais également en termes d’applications dans le monde réel. Conventuellement, les modèles de vidéos génératives sont soit formés à partir de zéro, soit partiellement ou complètement affinés à partir de modèles d’images pré-entraînés avec des couches temporelles supplémentaires, sur un mélange de jeux de données d’images et de vidéos.

En poursuivant les progrès des modèles de vidéos génératives, dans cet article, nous allons parler du Modèle de Diffusion Vidéo Stable, un modèle de diffusion vidéo latent capable de générer des contenus d’image à vidéo et de texte à vidéo de haute résolution et de pointe. Nous allons discuter de la façon dont les modèles de diffusion latents formés pour la synthèse d’images 2D ont amélioré les capacités et l’efficacité des modèles de vidéos génératives en ajoutant des couches temporelles et en affinant les modèles sur de petits jeux de données composés de vidéos de haute qualité. Nous allons nous plonger plus en profondeur dans l’architecture et le fonctionnement du Modèle de Diffusion Vidéo Stable, et évaluer ses performances sur diverses métriques et les comparer avec les cadres actuels de pointe pour la génération de vidéos. Alors, commençons.

Modèle de Diffusion Vidéo Stable et Modèles de Vidéos Génératives : Une Introduction

Grâce à son potentiel presque illimité, l’IA générative a été le sujet principal de recherche pour les praticiens de l’IA et du ML depuis un certain temps maintenant, et les dernières années ont vu des progrès rapides à la fois en termes d’efficacité et de performance des modèles d’images génératives. Les connaissances acquises à partir des modèles d’images génératives ont permis aux chercheurs et aux développeurs de faire progresser les modèles de vidéos génératives, ce qui a abouti à une meilleure praticité et à des applications dans le monde réel. Cependant, la plupart des recherches visant à améliorer les capacités des modèles de vidéos génératives se concentrent principalement sur l’agencement exact des couches temporelles et spatiales, avec peu d’attention portée à l’étude de l’influence de la sélection des bonnes données sur le résultat de ces modèles génératifs.

Grâce aux progrès réalisés par les modèles d’images génératives, les chercheurs ont observé que l’impact de la distribution des données de formation sur les performances des modèles génératifs est en effet important et incontesté. De plus, les chercheurs ont également observé que le pré-entraînement d’un modèle d’image générative sur un grand et diversifié jeu de données, suivi d’un affinement sur un petit jeu de données de meilleure qualité, aboutit souvent à une amélioration significative des performances. Traditionnellement, les modèles de vidéos génératives mettent en œuvre les connaissances acquises à partir de modèles d’images génératives réussis, et les chercheurs n’ont pas encore étudié l’effet des données et des stratégies d’entraînement. Le Modèle de Diffusion Vidéo Stable est une tentative pour améliorer les capacités des modèles de vidéos génératives en explorant des territoires inconnus jusqu’alors, avec un accent particulier sur la sélection des données.

Les modèles de vidéos génératives récents reposent sur les modèles de diffusion, et les approches de conditionnement de texte ou d’image pour synthétiser plusieurs cadres de vidéo ou d’image cohérents. Les modèles de diffusion sont connus pour leur capacité à apprendre à débruir progressivement un échantillon à partir d’une distribution normale en mettant en œuvre un processus de raffinement itératif, et ils ont donné des résultats souhaitables sur la synthèse de vidéos et de textes à haute résolution. En utilisant le même principe à son cœur, le Modèle de Diffusion Vidéo Stable forme un modèle de diffusion vidéo latent sur son jeu de données vidéo, ainsi que l’utilisation de réseaux antagonistes génératifs ou de modèles autorégressifs dans une certaine mesure.

Le Modèle de Diffusion Vidéo Stable suit une stratégie unique jamais mise en œuvre par aucun modèle de vidéo générative, car il repose sur des lignes de base de diffusion vidéo latente avec une architecture fixe et une stratégie d’entraînement fixe, suivie de l’évaluation de l’effet de la curation des données. Le Modèle de Diffusion Vidéo Stable vise à apporter les contributions suivantes dans le domaine de la modélisation de vidéos génératives.

- Pour présenter un flux de travail de curation de données systématique et efficace dans le but de convertir une grande collection d’échantillons de vidéos non curées en un jeu de données de haute qualité qui est ensuite utilisé par les modèles de vidéos génératives.

- Pour former des modèles d’image à vidéo et de texte à vidéo de pointe qui surpassent les cadres existants.

- Pour mener des expériences spécifiques au domaine pour sonder la compréhension 3D et la forte priorité de mouvement du modèle.

Maintenant, le Modèle de Diffusion Vidéo Stable met en œuvre les connaissances acquises à partir des Modèles de Diffusion Vidéo Latents et des techniques de curation de données au cœur de sa fondation.

Modèles de Diffusion Vidéo Latents

Les Modèles de Diffusion Vidéo Latents ou VDL suivent l’approche de formation du modèle génératif principal dans un espace latent avec une complexité computationnelle réduite, et la plupart des VDL mettent en œuvre un modèle d’image à texte pré-entraîné couplé avec l’ajout de couches de mélange temporel dans l’architecture de pré-entraînement. Par conséquent, la plupart des Modèles de Diffusion Vidéo Latents ne forment que les couches temporelles, ou sautent le processus de formation tout à fait, contrairement au Modèle de Diffusion Vidéo Stable qui affine l’ensemble du cadre. De plus, pour la synthèse de données de texte à vidéo, le Modèle de Diffusion Vidéo Stable se conditionne directement sur une invite de texte, et les résultats indiquent que le cadre résultant peut être affiné en un modèle de synthèse multi-vue ou en un modèle d’image à vidéo facilement.

Curation de Données

La curation de données est un composant essentiel non seulement du Modèle de Diffusion Vidéo Stable, mais également des modèles génératifs dans leur ensemble, car il est essentiel de pré-entraîner de grands modèles sur des jeux de données à grande échelle pour améliorer les performances sur diverses tâches, y compris la modélisation de langage, ou la génération discriminative de texte à image, et bien plus encore. La curation de données a été mise en œuvre avec succès sur les modèles d’images génératives en exploitant les capacités de représentations d’images et de langage efficaces, bien que de telles discussions n’aient jamais été axées sur le développement de modèles de vidéos génératives. Il existe plusieurs obstacles que les développeurs rencontrent lors de la curation de données pour les modèles de vidéos génératives, et pour relever ces défis, le Modèle de Diffusion Vidéo Stable met en œuvre une stratégie de formation en trois étapes, ce qui aboutit à des résultats améliorés et à une augmentation significative des performances.

Curation de Données pour la Synthèse Vidéo de Haute Qualité

Comme discuté dans la section précédente, le Modèle de Diffusion Vidéo Stable met en œuvre une stratégie de formation en trois étapes, ce qui aboutit à des résultats améliorés et à une augmentation significative des performances. L’étape I est une étape de pré-entraînement d’image qui utilise un modèle de diffusion d’image à texte 2D. L’étape II est pour le pré-entraînement de vidéo dans lequel le cadre se forme sur une grande quantité de données de vidéo. Enfin, nous avons l’étape III pour le rafinition de vidéo dans lequel le modèle est raffiné sur un petit sous-ensemble de vidéos de haute qualité et de haute résolution.

Cependant, avant que le Modèle de Diffusion Vidéo Stable ne mette en œuvre ces trois étapes, il est vital de traiter et d’annoter les données, car cela sert de base à l’étape II ou à l’étape de pré-entraînement de vidéo, et joue un rôle critique pour assurer la sortie optimale. Pour assurer une efficacité maximale, le cadre met d’abord en œuvre une pipeline de détection de coupure en cascade à 3 niveaux de FPS ou de frames par seconde différents, et le besoin de cette pipeline est démontré dans l’image suivante.

Ensuite, le Modèle de Diffusion Vidéo Stable annoté chaque clip de vidéo à l’aide de trois méthodes de captionning synthétiques différentes. Le tableau suivant compare les jeux de données utilisés dans le cadre de la Stable Diffusion avant et après le processus de filtration.

Étape I : Pré-entraînement d’Image

La première étape de la stratégie de formation en trois étapes mise en œuvre dans le Modèle de Diffusion Vidéo Stable est le pré-entraînement d’image, et pour atteindre cela, le cadre initial du Modèle de Diffusion Vidéo Stable est ancré contre un modèle de diffusion d’image pré-entraîné, à savoir le modèle Stable Diffusion 2.1 qui l’équipe de représentations visuelles plus solides.

Étape II : Pré-entraînement de Vidéo

La deuxième étape est l’étape de pré-entraînement de vidéo, et elle se fonde sur les constatations que l’utilisation de la curation de données dans les modèles d’images génératives multimodales aboutit souvent à de meilleurs résultats et à une efficacité accrue, ainsi qu’à une génération d’images discriminative puissante. Cependant, en raison du manque de représentations puissantes et prêtes à l’emploi pour filtrer les échantillons indésirables pour les modèles de vidéos génératives, le Modèle de Diffusion Vidéo Stable repose sur les préférences humaines comme signaux d’entrée pour la création d’un jeu de données approprié utilisé pour le pré-entraînement du cadre. La figure suivante démontre l’effet positif du pré-entraînement du cadre sur un jeu de données curé qui aide à améliorer les performances globales pour le pré-entraînement de vidéo sur des petits jeux de données.

Pour être plus précis, le cadre utilise différentes méthodes pour curer des sous-ensembles de diffusion vidéo latente, et prend en compte le classement des modèles LVD formés sur ces jeux de données. De plus, le cadre de la Stable Diffusion trouve que l’utilisation de jeux de données curés pour la formation des cadres aide à améliorer les performances du cadre et des modèles de diffusion en général. De plus, la stratégie de curation de données fonctionne également sur des jeux de données plus grands, plus pertinents et plus pratiques. La figure suivante démontre l’effet positif du pré-entraînement du cadre sur un jeu de données curé qui aide à améliorer les performances globales pour le pré-entraînement de vidéo sur des petits jeux de données.

Étape III : Raffinement de Haute Qualité

Jusqu’à l’étape II, le cadre de la Stable Diffusion se concentre sur l’amélioration des performances avant le pré-entraînement de vidéo, et à l’étape III, le cadre se concentre sur l’optimisation ou l’amélioration supplémentaire des performances du cadre après le raffinement de vidéo de haute qualité, et sur la façon dont la transition de l’étape II à l’étape III est réalisée dans le cadre. À l’étape III, le cadre s’appuie sur des techniques de formation empruntées aux modèles de diffusion d’images latentes, et augmente la résolution des exemples de formation. Pour analyser l’efficacité de cette approche, le cadre la compare avec trois modèles identiques qui diffèrent uniquement en termes d’initialisation. Le premier modèle identique a ses poids initialisés, et le processus de formation de vidéo est ignoré, tandis que les deux autres modèles identiques sont initialisés avec les poids empruntés à d’autres modèles de vidéos latentes.

Résultats et Constatations

Il est temps de voir comment le cadre de la Stable Diffusion se comporte sur des tâches du monde réel et comment il se compare aux cadres actuels de pointe. Le cadre de la Stable Diffusion utilise d’abord l’approche de données optimale pour former un modèle de base, puis effectue un raffinement pour générer plusieurs modèles de pointe, chacun effectuant une tâche spécifique.

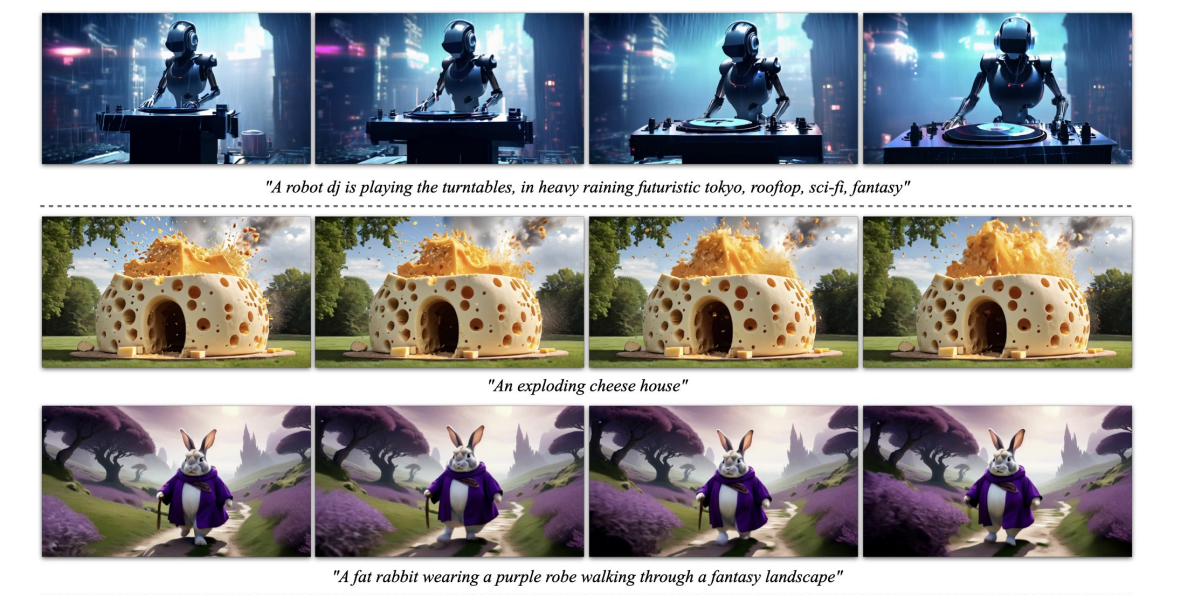

L’image ci-dessus représente les échantillons d’image à vidéo de haute résolution générés par le cadre, tandis que la figure suivante démontre la capacité du cadre à générer des échantillons de texte à vidéo de haute qualité.

Modèle de Base Pré-entraîné

Comme discuté précédemment, le modèle de la Stable Diffusion est construit sur le cadre de la Stable Diffusion 2.1, et sur la base de constatations récentes, il était crucial pour les développeurs d’adopter l’horaire de bruit et d’augmenter le bruit pour obtenir des images avec une meilleure résolution lors de la formation de modèles de diffusion d’images. Grâce à cette approche, le modèle de base de la Stable Diffusion apprend des représentations de mouvement puissantes et, dans le processus, surpasse les modèles de base pour la génération de vidéos de texte à vidéo dans un cadre de tir à zéro, et les résultats sont affichés dans le tableau suivant.

Interpolation de Trame et Génération Multi-Vue

Le cadre de la Stable Diffusion affine le modèle d’image à vidéo sur des jeux de données multi-vues pour obtenir plusieurs vues nouvelles d’un objet, et ce modèle est connu sous le nom de SVD-MV ou Modèle de Diffusion Vidéo Stable – Multi-Vue. Le modèle SVD d’origine est affiné à l’aide de deux jeux de données d’une manière telle que le cadre entre une image unique et retourne une séquence d’images multi-vues comme sortie.

Comme on le voit dans les images suivantes, le cadre de la Stable Diffusion Multi-Vue offre des performances élevées comparables à celles du cadre Scratch Multi-Vue de pointe, et les résultats sont une démonstration claire de la capacité du SVD-MV à tirer parti des connaissances acquises à partir du cadre SVD d’origine pour la génération d’images multi-vues. De plus, les résultats indiquent également que l’exécution du modèle pendant un nombre d’itérations relativement faible aide à fournir des résultats optimaux, comme c’est le cas pour la plupart des modèles affinés à partir du cadre SVD.

Dans la figure ci-dessus, les métriques sont indiquées sur le côté gauche et, comme on le voit, le cadre de la Stable Diffusion Multi-Vue surpasse le cadre Scratch-MV et le cadre SD2.1 Multi-Vue par une marge convenable. La deuxième image démontre l’effet du nombre d’itérations de formation sur les performances globales du cadre en termes de score Clip, et les cadres SVD-MV fournissent des résultats durables.

Pensées Finales

Dans cet article, nous avons discuté du Modèle de Diffusion Vidéo Stable, un modèle de diffusion vidéo latent capable de générer des contenus d’image à vidéo et de texte à vidéo de haute résolution et de pointe. Le Modèle de Diffusion Vidéo Stable suit une stratégie unique jamais mise en œuvre par aucun modèle de vidéo générative, car il repose sur des lignes de base de diffusion vidéo latente avec une architecture fixe et une stratégie d’entraînement fixe, suivie de l’évaluation de l’effet de la curation des données.

Nous avons discuté de la façon dont les modèles de diffusion latents formés pour la synthèse d’images 2D ont amélioré les capacités et l’efficacité des modèles de vidéos génératives en ajoutant des couches temporelles et en affinant les modèles sur de petits jeux de données composés de vidéos de haute qualité. Pour collecter les données de pré-entraînement, le cadre effectue une étude d’échelle et suit des pratiques de collecte de données systématiques, et propose finalement une méthode pour curer une grande quantité de données de vidéo et les convertir en données d’entrée adaptées aux modèles de vidéos génératives.

De plus, le cadre de la Stable Diffusion emploie trois étapes distinctes de formation de modèles de vidéos qui sont analysées indépendamment pour évaluer leur impact sur les performances du cadre. Le cadre produit finalement une représentation de vidéo puissante enough pour affiner les modèles pour une synthèse de vidéo optimale, et les résultats sont comparables à ceux des modèles de génération de vidéos de pointe déjà en usage.