Intelligence artificielle

ST-NeRF : Compositing et édition pour la synthèse de vidéos

Un consortium de recherche chinois a développé des techniques pour apporter des capacités d’édition et de compositing à l’un des secteurs de recherche les plus chauds sur la synthèse d’images de l’année dernière – les champs de rayonnement neural (NeRF). Le système est intitulé ST-NeRF (Champ de rayonnement neural cohérent spatio-temporel).

Ce qui ressemble à un panoramique de caméra physique dans l’image ci-dessous est en réalité simplement un utilisateur qui fait défiler les points de vue sur le contenu vidéo qui existe dans un espace 4D. Le point de vue n’est pas verrouillé sur la performance des personnes représentées dans la vidéo, dont les mouvements peuvent être vus de n’importe quel point d’un rayon de 180 degrés.

Chaque facette dans la vidéo est un élément capturé de manière discrète, composé dans une scène cohérente qui peut être explorée de manière dynamique.

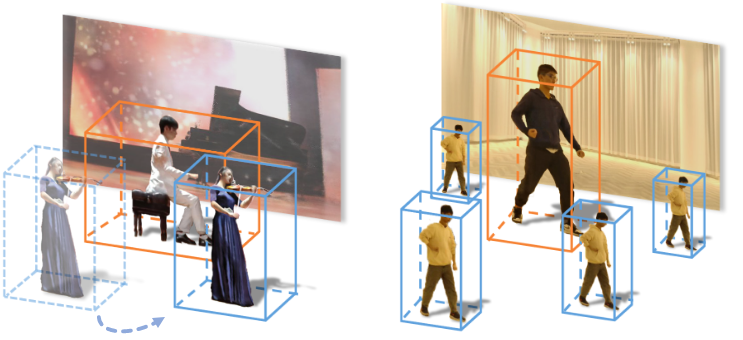

Les facettes peuvent être librement dupliquées dans la scène, ou redimensionnées :

En outre, le comportement temporel de chaque facette peut être facilement modifié, ralenti, inversé ou manipulé de diverses manières, ouvrant la voie à des architectures de filtres et à un niveau d’interprétabilité extrêmement élevé.

Deux facettes NeRF distinctes exécutées à des vitesses différentes dans la même scène. Source : https://www.youtube.com/watch?v=Wp4HfOwFGP4

Il n’y a pas besoin de rotoscopie des performers ou des environnements, ou de faire exécuter leurs mouvements de manière aveugle et hors du contexte de la scène prévue. Au lieu de cela, les images sont capturées de manière naturelle via un tableau de 16 caméras vidéo couvrant 180 degrés :

Les trois éléments représentés ci-dessus, les deux personnes et l’environnement, sont distincts et délimités uniquement à des fins d’illustration. Chacun peut être échangé, et chacun peut être inséré dans la scène à un moment antérieur ou postérieur de leur chronologie de capture individuelle.

ST-NeRF est une innovation dans la recherche sur les champs de rayonnement neural (NeRF), un cadre d’apprentissage automatique dans lequel des captures de points de vue multiples sont synthétisées dans un espace virtuel navigable par une formation extensive (bien que la capture d’un seul point de vue soit également un sous-secteur de la recherche NeRF).

Les champs de rayonnement neural fonctionnent en rassemblant plusieurs points de vue de capture dans un espace 3D cohérent et navigable unique, avec les lacunes entre la couverture estimées et rendues par un réseau neuronal. Lorsque la vidéo (plutôt que des images fixes) est utilisée, les ressources de rendu nécessaires sont souvent considérables. Source : https://www.matthewtancik.com/nerf

L’intérêt pour NeRF est devenu intense au cours des neuf derniers mois, et une liste Reddit maintenue de documents de recherche NeRF dérivés ou exploratoires compte actuellement soixante projets.

Quelques-unes des nombreuses ramifications du document de recherche NeRF original. Source : https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

Formation abordable

Le document est une collaboration entre des chercheurs de l’Université de technologie de Shanghai et DGene Digital Technology, et a été accepté avec enthousiasme sur Open Review.

ST-NeRF offre un certain nombre d’innovations par rapport aux initiatives précédentes dans les espaces de vidéos navigables dérivés du ML. Non moins, il atteint un niveau élevé de réalisme avec seulement 16 caméras. Même si Facebook’s DyNeRF utilise seulement deux caméras de plus que cela, il offre un arc de navigation beaucoup plus restreint.

Un exemple de l’environnement DyNeRF de Facebook, avec un champ de mouvement plus limité, et plus de caméras par mètre carré nécessaires pour reconstruire la scène. Source : https://neural-3d-video.github.io

En plus de ne pas avoir la capacité d’éditer et de composer des facettes individuelles, DyNeRF est particulièrement coûteux en termes de ressources computationnelles. En revanche, les chercheurs chinois déclarent que le coût de formation de leurs données se situe entre 900 $ et 3 000 $, par rapport à 30 000 $ pour le modèle de génération de vidéos à l’état de l’art DVDGAN, et des systèmes intensifs tels que DyNeRF.

Les réviseurs ont également noté que ST-NeRF fait une innovation majeure en découplant le processus d’apprentissage du mouvement du processus de synthèse d’images. Cette séparation est ce qui permet l’édition et la compositing, avec des approches précédentes restrictives et linéaires par comparaison.

Même si 16 caméras constituent un tableau très limité pour un tel demi-cercle de vue, les chercheurs espèrent réduire ce nombre encore plus dans les travaux ultérieurs grâce à l’utilisation de fonds statiques pré-scannés par procuration, et des approches de modélisation de scène plus axées sur les données.

Ils espèrent également incorporer des capacités de rééclairage, une innovation récente dans la recherche NeRF.

Adresse des limites de ST-NeRF

Dans le contexte des documents de recherche universitaires en CS qui ont tendance à jeter la vraie utilisabilité d’un nouveau système dans un paragraphe final jetable, même les limites que les chercheurs reconnaissent pour ST-NeRF sont inhabituelles.

Ils observent que le système ne peut actuellement pas individualiser et rendre séparément des objets particuliers dans une scène, car les personnes dans les images sont segmentées en entités individuelles via un système conçu pour reconnaître les humains et non les objets – un problème qui semble facile à résoudre avec YOLO et des cadres similaires, avec le travail plus difficile d’extraction de la vidéo humaine déjà accompli.

Même si les chercheurs notent qu’il n’est actuellement pas possible de générer des mouvements lents, il semble y avoir peu de choses pour empêcher la mise en œuvre de cela en utilisant des innovations existantes dans l’interpolation de trames telles que DAIN et RIFE.

Comme pour toutes les implémentations NeRF, et dans de nombreux autres secteurs de la recherche en vision par ordinateur, ST-NeRF peut échouer dans les cas d’occlusion sévère, où le sujet est temporairement obscurci par une autre personne ou un objet, et peut être difficile à suivre en continu ou à réacquérir avec précision par la suite. Comme ailleurs, cette difficulté peut devoir attendre des solutions en amont. Dans l’intervalle, les chercheurs reconnaissent que l’intervention manuelle est nécessaire dans ces cadres occlus.

Enfin, les chercheurs observent que les procédures de segmentation humaine reposent actuellement sur les différences de couleur, ce qui pourrait conduire à une collusion involontaire de deux personnes en un seul bloc de segmentation – un obstacle non limité à ST-NeRF, mais inhérent à la bibliothèque utilisée, et qui pourrait peut-être être résolu par l’analyse du flux optique et d’autres techniques émergentes.

Publié pour la première fois le 7 mai 2021.