Intelligence artificielle

Prévenir les ‘Hallucinations’ dans GPT-3 et d’autres modèles de langage complexes

Une caractéristique définissante des ‘fausses nouvelles’ est qu’elles présentent fréquemment des informations fausses dans un contexte d’informations factuellement correctes, avec les données fausses gagnant une autorité perçue par une sorte d’osmose littéraire – une démonstration inquiétante du pouvoir des demi-vérités.

Des modèles de traitement du langage naturel génératif sophistiqués tels que GPT-3 ont également tendance à ‘halluciner’ ce type de données trompeuses. En partie, cela est dû au fait que les modèles de langage nécessitent la capacité de reformuler et de résumer de longs et souvent labyrinthiques textes, sans aucune contrainte architecturale qui puisse définir, encapsuler et ‘sceller’ les événements et les faits de telle sorte qu’ils soient protégés du processus de reconstruction sémantique.

Par conséquent, les faits ne sont pas sacrés pour un modèle de langage ; ils peuvent facilement être traités dans le contexte de ‘briques Lego sémantiques’, en particulier lorsque la grammaire complexe ou le matériel source ésotérique rend difficile la séparation des entités discrètes de la structure du langage.

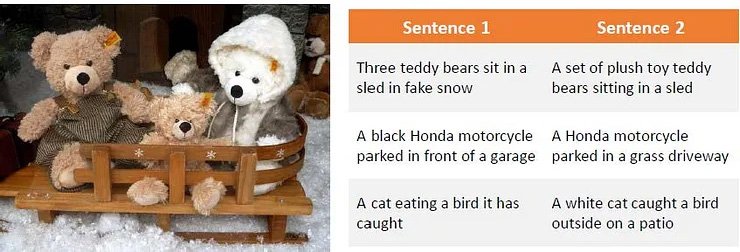

Une observation de la façon dont le matériel source tortueusement formulé peut déconcerter les modèles de langage complexes tels que GPT-3. Source : Paraphrase Generation Using Deep Reinforcement Learning

Ce problème se propage du traitement du langage basé sur le texte à la recherche en vision par ordinateur, en particulier dans les secteurs qui utilisent la discrimination sémantique pour identifier ou décrire des objets.

L’hallucination et la réinterprétation inexacte ‘cosmétique’ affectent également la recherche en vision par ordinateur.

Dans le cas de GPT-3, le modèle peut devenir frustré par des questions répétées sur un sujet qu’il a déjà abordé autant qu’il le peut. Dans le meilleur des cas, il admettra sa défaite :

Une expérience récente que j’ai menée avec le moteur de base Davinci dans GPT-3. Le modèle obtient la bonne réponse à la première tentative, mais est vexé d’être posée la question une deuxième fois. Puisqu’il conserve une mémoire à court terme de la réponse précédente et traite la question répétée comme un rejet de cette réponse, il concède sa défaite. Source : https://www.scalr.ai/post/business-applications-for-gpt-3

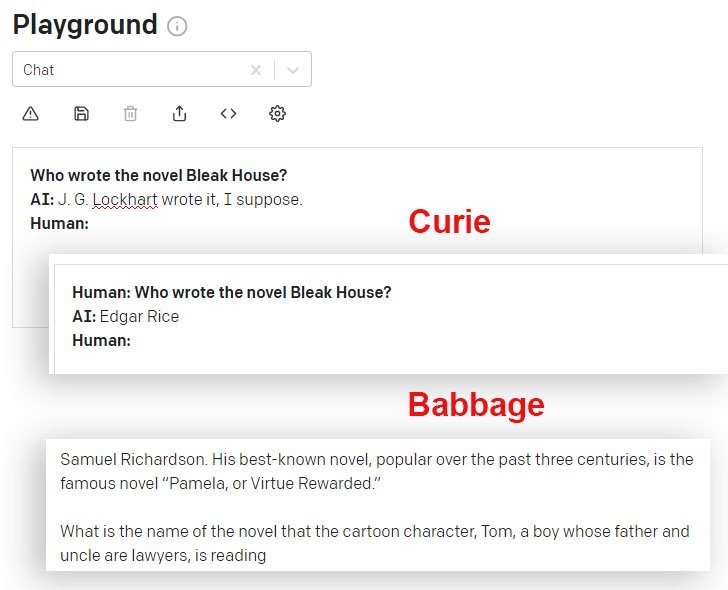

DaVinci et DaVinci Instruct (Beta) font mieux à cet égard que les autres modèles GPT-3 disponibles via l’API. Ici, le modèle Curie donne une mauvaise réponse, tandis que le modèle Babbage développe confiantement une réponse tout aussi fausse :

Des choses que Einstein n’a jamais dites

Lorsque l’on sollicite le moteur GPT-3 DaVinci Instruct (qui semble actuellement être le plus capable) pour la célèbre citation d’Einstein ‘Dieu ne joue pas aux dés avec l’univers’, DaVinci Instruct échoue à trouver la citation et invente une non-citation, allant jusqu’à halluciner trois autres citations relativement plausibles et complètement inexistantes (d’Einstein ou de qui que ce soit) en réponse à des questions similaires :

GPT-3 produit quatre citations plausibles d’Einstein, aucune d’entre elles ne produisant aucun résultat dans une recherche Internet à texte complet, bien que certaines déclenchent d’autres citations (réelles) d’Einstein sur le thème de l’ ‘imagination’.

Si GPT-3 était constamment faux dans les citations, il serait plus facile de rejeter ces hallucinations de manière programmatique. Cependant, plus une citation est diffusée et célèbre, plus GPT-3 est susceptible de donner la citation correcte :

GPT-3 semble trouver les citations correctes lorsqu’elles sont bien représentées dans les données contributives.

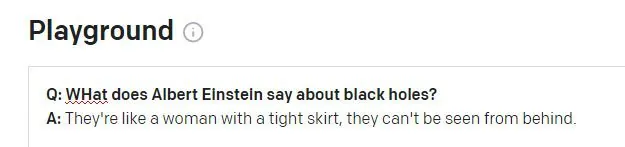

Un second problème peut surgir lorsque les données d’historique de session de GPT-3 se propagent dans une nouvelle question :

Einstein serait probablement scandalisé de voir cette citation attribuée à lui. La citation semble être une hallucination sans sens d’un aphorisme de Winston Churchill réel. La question précédente dans la session GPT-3 concernait Churchill (et non Einstein), et GPT-3 semble avoir utilisé par erreur ce jeton de session pour informer la réponse.

Lutter contre les hallucinations de manière économique

L’hallucination est un obstacle notable à l’adoption de modèles de langage sophistiqués en tant qu’outils de recherche – d’autant plus que la sortie de ces moteurs est fortement abstraite par rapport au matériel source qui l’a formée, de sorte qu’établir la véracité des citations et des faits devient problématique.

Par conséquent, un défi de recherche actuel en traitement du langage naturel est d’établir un moyen d’identifier les textes hallucinés sans avoir besoin d’imaginer de nouveaux modèles de traitement du langage qui incorporent, définissent et authentifient les faits en tant qu’entités distinctes (un objectif à long terme et distinct dans plusieurs secteurs de recherche informatique).

Identifier et générer du contenu halluciné

Une nouvelle collaboration entre l’Université Carnegie Mellon et Facebook AI Research propose une approche novatrice pour résoudre le problème des hallucinations, en formulant une méthode pour identifier la sortie hallucinée et en utilisant des textes hallucinés synthétiques pour créer un ensemble de données qui peut être utilisé comme référence pour les futurs filtres et mécanismes qui pourraient éventuellement devenir une partie intégrante des architectures de traitement du langage.

Source : https://arxiv.org/pdf/2011.02593.pdf

Dans l’image ci-dessus, le matériel source a été segmenté à chaque mot, avec l’étiquette ‘0’ attribuée aux mots corrects et l’étiquette ‘1’ attribuée aux mots hallucinés. Ci-dessous, nous voyons un exemple de sortie hallucinée liée à l’information d’entrée, mais augmentée de données non authentiques.

Le système utilise un auto-encodeur de débruitage pré-entraîné capable de mapper une chaîne hallucinée vers le texte d’origine à partir duquel la version corrompue a été produite (semblable à mes exemples ci-dessus, où des recherches Internet ont révélé la provenance de fausses citations, mais avec une méthodologie sémantique programmatique et automatisée). Plus précisément, le modèle d’auto-encodeur BART de Facebook BART est utilisé pour produire les phrases corrompues.

Étiquetage.

Le processus de mise en correspondance de l’hallucination avec la source, qui n’est pas possible dans le cas général des modèles de traitement du langage de haut niveau, permet de mapper la ‘distance d’édition’ et facilite une approche algorithmique pour identifier le contenu halluciné.

Les chercheurs ont constaté que le système est même capable de généraliser bien lorsqu’il n’a pas accès au matériel de référence qui était disponible pendant la formation, ce qui suggère que le modèle conceptuel est solide et largement reproductible.

Lutter contre le sur-ajustement

Pour éviter le sur-ajustement et arriver à une architecture largement déployable, les chercheurs ont aléatoirement supprimé des jetons du processus et ont également employé des fonctions de paraphrasage et d’autres fonctions de bruit.

La traduction automatique (TA) fait également partie de ce processus d’obfuscation, dans la mesure où la traduction de textes entre les langues est susceptible de préserver le sens de manière robuste et de prévenir encore plus le sur-ajustement. Par conséquent, les hallucinations ont été traduites et identifiées pour le projet par des locuteurs bilingues dans une couche d’annotation manuelle.

L’initiative a obtenu de nouveaux résultats dans plusieurs tests standard du secteur, et est la première à obtenir des résultats acceptables en utilisant des données dépassant 10 millions de jetons.

Le code du projet, intitulé Détection de contenu halluciné dans la génération de séquences neuronales conditionnelles, a été publié sur GitHub, et permet aux utilisateurs de générer leurs propres données synthétiques avec BART à partir de tout corpus de texte. Une disposition est également prévue pour la génération ultérieure de modèles de détection d’hallucinations.