Intelligence artificielle

Comment l’IA rend la reconnaissance de la langue des signes plus précise que jamais

Lorsque nous pensons à briser les barrières de la communication, nous nous concentrons souvent sur les applications de traduction de langage ou les assistants vocaux. Mais pour des millions de personnes qui utilisent la langue des signes, ces outils n’ont pas encore comblé le fossé. La langue des signes ne consiste pas seulement en mouvements de mains – c’est une forme riche et complexe de communication qui inclut les expressions faciales et le langage corporel, chaque élément portant un sens crucial.

Voici ce qui le rend particulièrement difficile : contrairement aux langues parlées, qui varient principalement en vocabulaire et en grammaire, les langues des signes du monde entier diffèrent fondamentalement dans la façon dont elles véhiculent le sens. La langue des signes américaine (ASL), par exemple, a sa propre grammaire et sa syntaxe uniques qui ne correspondent pas à l’anglais parlé.

Cette complexité signifie que la création de technologies pour reconnaître et traduire la langue des signes en temps réel nécessite une compréhension d’un système linguistique entier en mouvement.

Une nouvelle approche de la reconnaissance

C’est là que une équipe de l’Université de Floride Atlantique (FAU) à la Faculté d’ingénierie et de sciences informatiques a décidé de prendre une approche fraîche. Au lieu d’essayer de résoudre la complexité entière de la langue des signes d’un seul coup, ils se sont concentrés sur la maîtrise d’une étape cruciale : la reconnaissance des gestes de l’alphabet ASL avec une précision sans précédent grâce à l’IA.

Imaginez enseigner à un ordinateur à lire l’écriture manuscrite, mais en trois dimensions et en mouvement. L’équipe a créé quelque chose de remarquable : un ensemble de données de 29 820 images statiques montrant des gestes de mains ASL. Mais ils n’ont pas seulement collecté des photos. Ils ont marqué chaque image avec 21 points clés sur la main, créant une carte détaillée de la façon dont les mains bougent et forment différents signes.

Le Dr Bader Alsharif, qui a mené cette recherche en tant que candidat au doctorat, explique : « Cette méthode n’a pas été explorée dans les recherches précédentes, ce qui en fait une nouvelle et prometteuse direction pour les progrès futurs. »

Décortiquer la technologie

Plongeons dans la combinaison de technologies qui fait fonctionner ce système de reconnaissance de la langue des signes.

MediaPipe et YOLOv8

La magie se produit grâce à l’intégration sans faille de deux outils puissants : MediaPipe et YOLOv8. Pensez à MediaPipe comme un expert observateur de mains – un interprète de langue des signes compétent qui peut suivre chaque mouvement subtil des doigts et chaque position de la main. L’équipe de recherche a choisi MediaPipe spécifiquement pour son exceptionnelle capacité à fournir un suivi précis des repères de la main, en identifiant 21 points précis sur chaque main, comme mentionné ci-dessus.

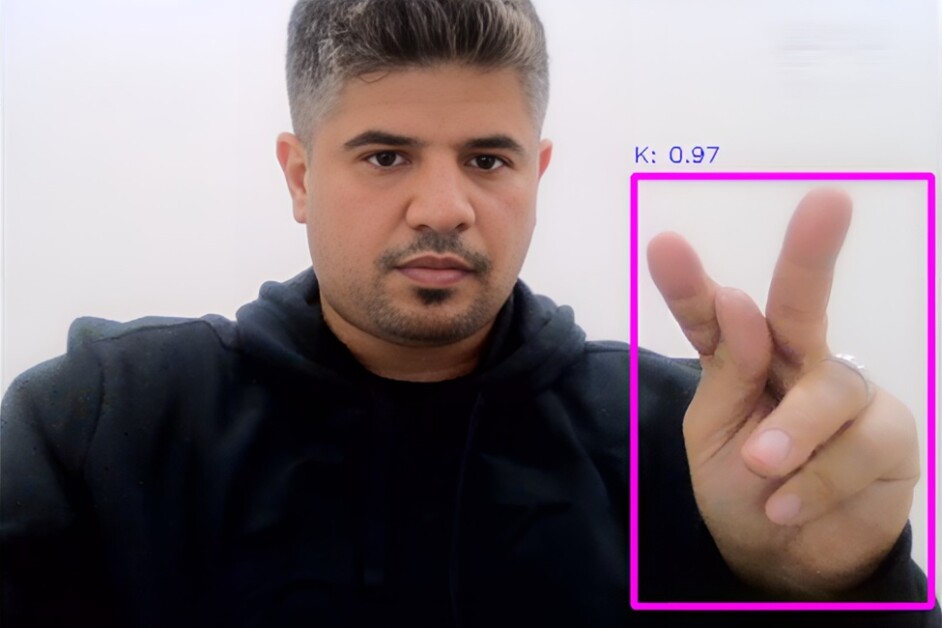

Mais le suivi ne suffit pas – nous devons comprendre ce que ces mouvements signifient. C’est là que YOLOv8 entre en jeu. YOLOv8 est un expert en reconnaissance de modèles, prenant tous ces points suivis et déterminant quellettre ou quel geste ils représentent. La recherche montre que lorsque YOLOv8 traite une image, il la divise en une grille S × S, avec chaque cellule de la grille responsable de la détection d’objets (dans ce cas, des gestes de mains) à l’intérieur de ses limites.

Alsharif et al., Franklin Open (2024)

Comment le système fonctionne réellement

Le processus est plus sophistiqué qu’il n’y paraît à première vue.

Voici ce qui se passe derrière la scène :

Étape de détection de la main

Lorsque vous faites un signe, MediaPipe identifie d’abord votre main dans le cadre et cartographie ces 21 points clés. Ce ne sont pas juste des points aléatoires – ils correspondent à des articulations et des repères spécifiques sur votre main, des extrémités des doigts à la base de la paume.

Analyse spatiale

YOLOv8 prend ensuite ces informations et les analyse en temps réel. Pour chaque cellule de la grille dans l’image, il prédit :

- La probabilité de la présence d’un geste de main

- Les coordonnées précises de l’emplacement du geste

- Le score de confiance de sa prédiction

Classification

Le système utilise quelque chose appelé « prédiction de boîte de délimitation » – imaginez dessiner un rectangle parfait autour de votre geste de main. YOLOv8 calcule cinq valeurs cruciales pour chaque boîte : les coordonnées x et y du centre, la largeur, la hauteur et un score de confiance.

Alsharif et al., Franklin Open (2024)

Pourquoi cette combinaison fonctionne si bien

L’équipe de recherche a découvert que, en combinant ces technologies, ils ont créé quelque chose de plus grand que la somme de ses parties. Le suivi précis de MediaPipe combiné à la détection d’objets avancée de YOLOv8 a produit des résultats remarquablement précis – nous parlons d’un taux de précision de 98 % et d’un score F1 de 99 %.

Ce qui rend cela particulièrement impressionnant, c’est la façon dont le système gère la complexité de la langue des signes. Certains signes peuvent sembler très similaires aux yeux non formés, mais le système peut repérer des différences subtiles.

Résultats record

Lorsque les chercheurs développent de nouvelles technologies, la grande question est toujours : « Comment fonctionne-t-elle réellement ? » Pour ce système de reconnaissance de la langue des signes, les résultats sont impressionnants.

L’équipe de FAU a soumis son système à des tests rigoureux, et voici ce qu’ils ont trouvé :

- Le système identifie correctement les signes 98 % du temps

- Il détecte 98 % de tous les signes effectués devant lui

- Le score de performance global atteint un impressionnant 99 %

« Les résultats de notre recherche démontrent la capacité de notre modèle à détecter et à classifier les gestes de la langue des signes américaine avec très peu d’erreurs », explique Alsharif.

Le système fonctionne bien dans des situations quotidiennes – différentes lumières, diverses positions de la main et même avec différentes personnes qui signent.

Cette percée pousse les limites de ce qui est possible dans la reconnaissance de la langue des signes. Les systèmes précédents ont lutté pour l’exactitude, mais en combinant le suivi des mains de MediaPipe avec les capacités de détection de YOLOv8, l’équipe de recherche a créé quelque chose de spécial.

« Le succès de ce modèle est en grande partie dû à l’intégration soigneuse de l’apprentissage par transfert, à la création méticuleuse de l’ensemble de données et au réglage précis », déclare Mohammad Ilyas, l’un des co-auteurs de l’étude. Cette attention aux détails a payé en termes de performance remarquable du système.

Ce que cela signifie pour la communication

Le succès de ce système ouvre des possibilités passionnantes pour rendre la communication plus accessible et inclusive.

L’équipe ne s’arrête pas à la reconnaissance des lettres. Le prochain grand défi est d’enseigner au système à comprendre un éventail encore plus large de formes et de gestes de la main. Pensez à ces moments où les signes semblent presque identiques – comme les lettres « M » et « N » en langue des signes. Les chercheurs travaillent à améliorer la capacité du système à repérer ces différences subtiles encore mieux. Comme le dit le Dr Alsharif : « Il est important de noter que les résultats de cette étude soulignent non seulement la robustesse du système, mais également son potentiel à être utilisé dans des applications pratiques et en temps réel. »

L’équipe se concentre maintenant sur :

- Faire fonctionner le système sur des appareils réguliers

- Le rendre suffisamment rapide pour les conversations du monde réel

- Assurer qu’il fonctionne de manière fiable dans n’importe quel environnement

Le doyen Stella Batalama de la Faculté d’ingénierie et de sciences informatiques de FAU partage la vision plus large : « En améliorant la reconnaissance de la langue des signes américaine, ce travail contribue à créer des outils qui peuvent améliorer la communication pour la communauté sourde et malentendante. »

Imaginez entrer dans un cabinet de médecin ou assister à un cours où cette technologie comble les lacunes de communication instantanément. C’est l’objectif réel ici – rendre les interactions quotidiennes plus fluides et plus naturelles pour tous les participants. C’est créer une technologie qui aide réellement les gens à se connecter. Que ce soit dans l’éducation, les soins de santé ou les conversations quotidiennes, ce système représente un pas vers un monde où les barrières de la communication continuent de diminuer.