Intelligence Artificielle

La nouvelle méthode Deepfake résout le problème de "Face Host"

Malgré plusieurs années d'hyperbole médiatique sur le potentiel des images deepfake à saper notre confiance de longue date dans l'authenticité des séquences vidéo, toutes les méthodes actuellement populaires reposent sur la recherche de « visages hôtes » dont la forme est globalement similaire à celle du visage cible.

Lorsque la séquence originale présente un visage large, mais que le sujet cible a un visage étroit, les résultats ont toujours été problématiques, car un tel transfert implique de couper une partie du visage d'origine et de reconstruire l'arrière-plan désormais exposé. Les packages actuels tels que DeepFaceLab et FaceSwap sont capables de produire des résultats limités lorsque la configuration est inversée (étroit> large), mais n'ont aucune possibilité de s'attaquer de manière convaincante à ce scénario.

Désormais, une collaboration entre Tencent et l'Université chinoise de Xiamen a permis de développer un nouvelle approche, intitulé HifiFace, destiné à combler ce manque à gagner.

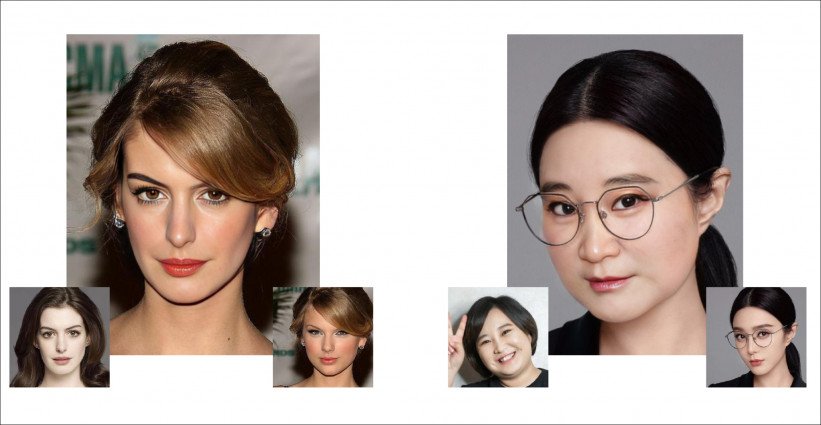

Deux deepfakes HifiFace, le premier d'Anne Hathaway, où une bonne ressemblance est obtenue malgré la forme du visage de l'hôte incompatible. HifiFace fonctionne également bien sur les cibles portant des lunettes, traditionnellement une pierre d'achoppement dans les deepfakes. Source : https://arxiv.org/pdf/2106.09965.pdf

Remodeler un visage deepfake

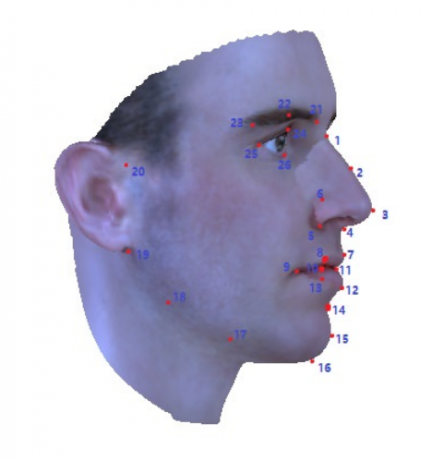

Les approches précédentes, comme celle de 2019 Échange et reconstitution de visages indépendants du sujet (FSGAN), ont dépendu de Raccord 3DMM (Modèles 3D Morphables) ou d'autres méthodologies basées sur la reconnaissance ou la transformation des repères faciaux, où les linéaments du visage à « écraser » dictent à peu près les limites de l'échange :

Détection de point de repère facial 3DMM. Source : https://github.com/Yinghao-Li/3DMM-fitting

Bien que les méthodes concurrentes s'appuient sur des caractéristiques dérivées des réseaux de reconnaissance faciale, celles-ci visent principalement à reconstituer la texture plutôt que la structure et produisent de la même manière un effet de « masque » dans les cas où le visage hôte n'est pas entièrement compatible (c'est-à-dire les limites et la forme de la racine des cheveux, de la mâchoire et des pommettes).

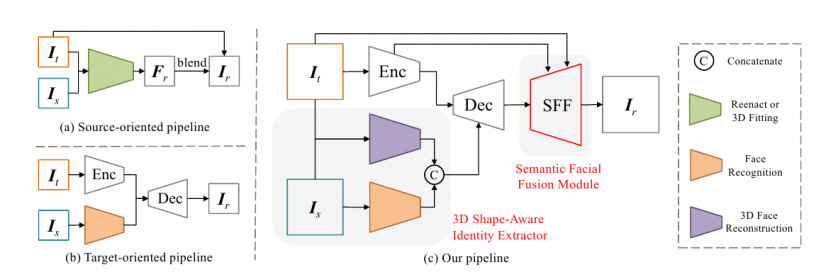

Pour répondre à ces problèmes, les chercheurs chinois, basés au Media Analytics and Computing Lab du Département d'intelligence artificielle de l'université, ont développé un réseau de bout en bout qui régresse les coefficients du visage cible et du visage source à l'aide d'un modèle de reconstruction 3D, qui est ensuite recombiné sous forme d'informations de forme et concaténé avec des informations vectorielles d'identité provenant d'un réseau de reconnaissance faciale.

Ces données géométriques sont ensuite introduites dans un modèle d'encodeur-décodeur sous forme d'informations structurelles, se mélangeant à l'expression et à la disposition du visage cible, qui sont exploitées comme sources auxiliaires pour un transfert précis.

Fusion faciale sémantique

De plus, HifiFace comprend un composant Semantic Facial Fusion (SFF), qui utilise une fonctionnalité de bas niveau dans l'encodeur pour préserver les informations spatiales et de texture, sans sacrifier l'identité de l'image cible. Les caractéristiques du codeur et du décodeur sont intégrées dans un masque adaptatif appris, et les informations d'arrière-plan sont mélangées dans la sortie au moyen du masque facial appris.

HifiFace en action. Source : https://johann.wang/HifiFace/

De cette manière, HifiFace s'écarte de l'utilisation des limites de visage du matériau d'origine comme limite stricte, en utilisant une segmentation sémantique de visage dilatée, dans laquelle le modèle peut effectuer une meilleure fusion adaptative sur les limites de bord du visage.

Deux approches précédentes (en haut et en bas à gauche) et la nouvelle architecture HifiFace, qui se compose d'un encodeur, d'un décodeur, d'un extracteur d'identité sensible à la forme 3D et d'un module SFF.

En comparaison avec les anciennes méthodes FSGAN, SimSwap que le béton ey FaceShifterHifiFace démontre une reconstruction supérieure de la forme du visage, car il ne se rapproche pas des éléments « fantômes » où les délimitations faciales confondent la cartographie identité>identité, mais les reconstruit définitivement.

Tests

Les chercheurs ont mis en œuvre le système en utilisant le VGGFace2 et les ensembles de données DeepGlint Asian-Celeb. Les visages ont été alignés via 5 repères extérieurs et recadrés à 256 × 256 pixels. Un réseau d'amélioration du portrait a également été utilisé pour générer une version 512 × 512 pixels, pour un modèle supplémentaire de plus haute résolution. Le modèle a été formé sous Adam.

Bien que FaceShifter préserve bien l'identité, il ne peut pas résoudre des problèmes tels que l'expression, la couleur et l'occlusion aussi efficacement que HifiFace, et possède une structure de réseau plus complexe. FSGAN a des problèmes pour transférer l'éclairage de la source à la cible.

Les chercheurs utilisent FaceForensics ++ pour des comparaisons quantitatives, échantillonner dix images chacune dans un lot de vidéos converties à travers les méthodes concurrentes, et constater que HifiFace a obtenu un score de récupération d'ID supérieur. En testant une série d'autres facteurs, tels que la qualité de l'image, les chercheurs ont également constaté que leur méthode surpassait les méthodologies concurrentes.

Ce travail représente une avancée supplémentaire vers l'abstraction du matériau source, qui n'est plus qu'un modèle approximatif dans lequel des identités précises peuvent être transférées. Certains logiciels libres actuels, dont DeepFaceLab, proposent une fonctionnalité naissante de remplacement de tête complète, mais, comme HifiFace, ils ne prennent pas en compte les cheveux et sont plus efficaces pour « construire » un visage que pour le sculpter afin de correspondre à une source cible.