Intelligence artificielle

Synthèse d’images humaines à partir d’ondes radio réfléchies

Les chercheurs de Chine ont développé une méthode pour synthétiser des images quasi photoréalistes de personnes sans caméras, en utilisant des ondes radio et des Réseaux Adversatifs Génératifs (GAN). Le système qu’ils ont conçu est formé sur des images réelles prises dans de bonnes conditions de lumière, mais est capable de capturer des « instantanés » relativement authentiques d’humains même dans des conditions sombres – et même à travers des obstacles importants qui cacheraient les personnes aux caméras conventionnelles.

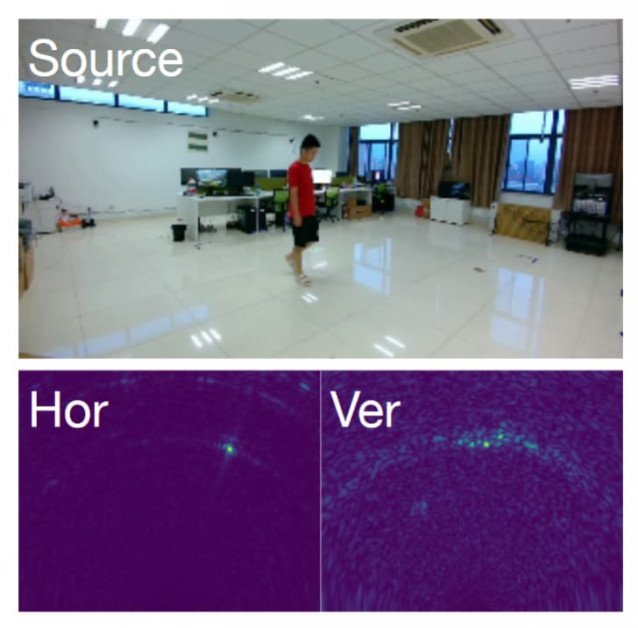

Les images s’appuient sur des « cartes de chaleur » à partir de deux antennes radio, l’une capturant des données du plafond vers le bas, et l’autre enregistrant les perturbations des ondes radio à partir d’une position « debout ».

Les photos résultantes des expériences de preuve de concept des chercheurs ont un aspect sans visage, « J-Horror » :

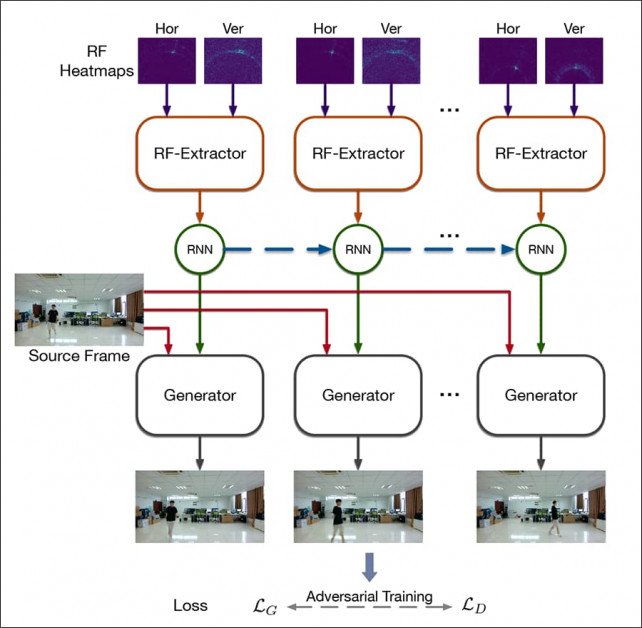

RFGAN est formé sur des images de personnes réelles dans des environnements contrôlés et sur des cartes de chaleur d’ondes radio qui enregistrent l’activité humaine. Ayant appris les fonctionnalités à partir des données, RFGAN peut alors générer des instantanés en fonction de nouvelles données RF. L’image résultante est une approximation, basée sur la résolution limitée des signaux RF à basse fréquence disponibles. Ce processus fonctionne même dans des environnements assombris, et à travers une variété d’obstacles potentiels. Source : https://arxiv.org/pdf/2112.03727.pdf

Pour former le GAN, baptisé RFGAN, les chercheurs ont utilisé des données appariées à partir d’une caméra RGB standard, et à partir des cartes de chaleur d’ondes radio concaténées produites au moment exact de la capture. Les images de personnes synthétisées dans le nouveau projet tendent à être floues de manière similaire à la photographie Daguerreotype précoce, car la résolution des ondes radio utilisées est très basse, avec une résolution de profondeur de 7,5 cm, et une résolution angulaire d’environ 1,3 degré.

Au-dessus, l’image alimentée au réseau GAN – en dessous, les deux cartes de chaleur, horizontale et verticale, qui caractérisent la personne dans la pièce, et qui sont synthétisées elles-mêmes à l’intérieur de l’architecture en une représentation 3D des données perturbées.

Le nouveau document, intitulé RFGAN : Synthèse humaine basée sur les ondes radio, provient de six chercheurs de l’Université des sciences et de la technologie électronique de Chine.

Données et architecture

En raison du manque de jeux de données ou de projets précédents partageant cette portée, et du fait que les signaux RF n’ont pas été utilisés auparavant dans un cadre de synthèse d’images GAN, les chercheurs ont dû développer des méthodologies nouvelles.

L’architecture principale de RFGAN.

Une normalisation adaptative a été utilisée pour interpréter les images de carte de chaleur jumelées pendant la formation, de sorte qu’elles correspondent spatialement avec les données d’image capturées.

Les dispositifs de capture RF étaient des radars à ondes millimétriques (mmWave) configurés en deux tableaux d’antennes, horizontaux et verticaux. La modulation de fréquence continue (FMCW) et les antennes linéaires ont été utilisées pour la transmission et la réception.

Le générateur reçoit un cadre source comme couche d’entrée, avec la représentation RF fusionnée (carte de chaleur) orchestrant le réseau à travers la normalisation au niveau des couches de convolution.

Données

Les données ont été collectées à partir de réflexions de signaux RF à partir de l’antenne mmWave à un simple 20 Hz, avec des vidéos humaines capturées simultanément à un très bas 10 ips. Neuf scènes intérieures ont été capturées, utilisant six volontaires, chacun portant des vêtements différents pour diverses sessions de collecte de données.

Le résultat était deux ensembles de données distincts, RF-Activity et RF-Walk, le premier contenant 68 860 images de personnes dans différentes positions (telles que accroupi et marche), ainsi que 137 760 cadres de carte de chaleur correspondants ; et le second contenant 67 860 cadres de marche aléatoire humaine, ainsi que 135 720 paires de cartes de chaleur associées.

Les données, selon la convention, ont été divisées de manière inégale entre la formation et les tests, avec 55 225 cadres d’image et 110 450 paires de cartes de chaleur utilisées pour la formation, et le reste mis de côté pour les tests. Les cadres de capture RGB ont été redimensionnés à 320×180, et les cartes de chaleur redimensionnées à 201×160.

Le modèle a ensuite été formé avec Adam à un taux d’apprentissage constant de 0,0002 pour le générateur et le discriminateur, à une époque de 80 et une taille de lot (très clairsemée) de 2. La formation a eu lieu via PyTorch sur un GPU GTX-1080 de niveau consommateur, dont les 8 Go de VRAM seraient généralement considérés comme quite modestes pour une telle tâche (expliquant la petite taille de lot).

Bien que les chercheurs aient adapté certaines métriques conventionnelles pour tester la réalisme de la sortie (détaillées dans le document), et aient effectué les tests d’ablation habituels, il n’y avait pas d’équivalent de travail antérieur pour mesurer les performances de RFGAN.

Intérêt ouvert pour les signaux secrets

RFGAN n’est pas le premier projet à tenter d’utiliser des fréquences radio pour construire une image volumétrique de ce qui se passe dans une pièce. En 2019, des chercheurs de MIT CSAIL ont développé une architecture appelée RF-Avatar, capable de reconstruire des humains 3D sur la base de signaux de fréquence radio dans la plage Wi-Fi, dans des conditions de occultation sévères.

Dans le projet MIT CSAIL de 2019, des ondes radio ont été utilisées pour supprimer les occultations, même y compris les murs et les vêtements, afin de recréer des sujets capturés dans un flux de travail CGI traditionnel. Source : https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

Les chercheurs du nouveau document reconnaissent également des travaux antérieurs liés à la cartographie de l’environnement avec des ondes radio (aucun d’entre eux n’ayant tenté de recréer des humains photoréalistes), qui ont cherché à estimer la vitesse humaine ; voir à travers les murs avec Wi-Fi ; évaluer les poses humaines ; et même reconnaître les gestes humains, parmi d’autres objectifs.

Transférabilité et applicabilité plus large

Les chercheurs ont ensuite cherché à savoir si leur découverte était suradaptée à l’environnement de capture initial et aux circonstances de formation, bien que le document n’offre que peu de détails sur cette phase de l’expérience. Ils affirment :

‘Pour déployer notre modèle dans une nouvelle scène, nous n’avons pas besoin de réentraîner tout le modèle à partir du début. Nous pouvons affiner le RFGAN préformé en utilisant très peu de données (environ 40 secondes de données) pour obtenir des résultats similaires.’

‘Les fonctions de perte et les hyperparamètres sont les mêmes que ceux de l’étape de formation. À partir des résultats quantitatifs, nous constatons que le modèle RFGAN préformé peut générer des cadres d’activité humaine souhaitables dans la nouvelle scène après affinement avec seulement un peu de données, ce qui signifie que notre modèle proposé a le potentiel d’être largement utilisé.’

Sur la base des détails du document sur cette application séminale d’une nouvelle technique, il n’est pas clair si le réseau que les chercheurs ont créé est « formé-entraîné » exclusivement pour les sujets d’origine, ou si les cartes de chaleur RF peuvent déduire des détails tels que la couleur des vêtements, car cela semble chevaucher les deux types de fréquences impliqués dans les méthodes de capture optique et radio.

Quoi qu’il en soit, RFGAN est une nouvelle façon d’utiliser les pouvoirs imitatifs et représentatifs des Réseaux Adversatifs Génératifs pour créer une nouvelle et intrigante forme de surveillance – une qui pourrait potentiellement fonctionner dans le noir et à travers les murs, d’une manière encore plus impressionnante que les efforts récents pour voir autour des coins avec la lumière réfléchie.

8 décembre 2021 (jour de la première publication), 20h04 GMT+2 – mot répété supprimé. – MA