Intelligence artificielle

L’offre de LipSync3D de Google améliore la synchronisation des mouvements de la bouche ‘Deepfaked’

Une collaboration entre les chercheurs de Google AI et l’Indian Institute of Technology Kharagpur propose un nouveau cadre pour synthétiser des têtes parlantes à partir de contenu audio. Le projet vise à produire des moyens optimisés et raisonnables pour créer du contenu vidéo de ‘tête parlante’ à partir d’audio, à des fins de synchronisation des mouvements des lèvres avec de l’audio doublé ou traduit par machine, et pour une utilisation dans des avatars, des applications interactives et d’autres environnements en temps réel.

Source: https://www.youtube.com/watch?v=L1StbX9OznY

Les modèles d’apprentissage automatique formés au cours de ce processus – appelés LipSync3D – nécessitent uniquement une seule vidéo de l’identité du visage cible comme données d’entrée. Le pipeline de préparation des données sépare l’extraction de la géométrie faciale de l’évaluation de l’éclairage et d’autres facettes d’une vidéo d’entrée, permettant ainsi une formation plus économique et plus ciblée.

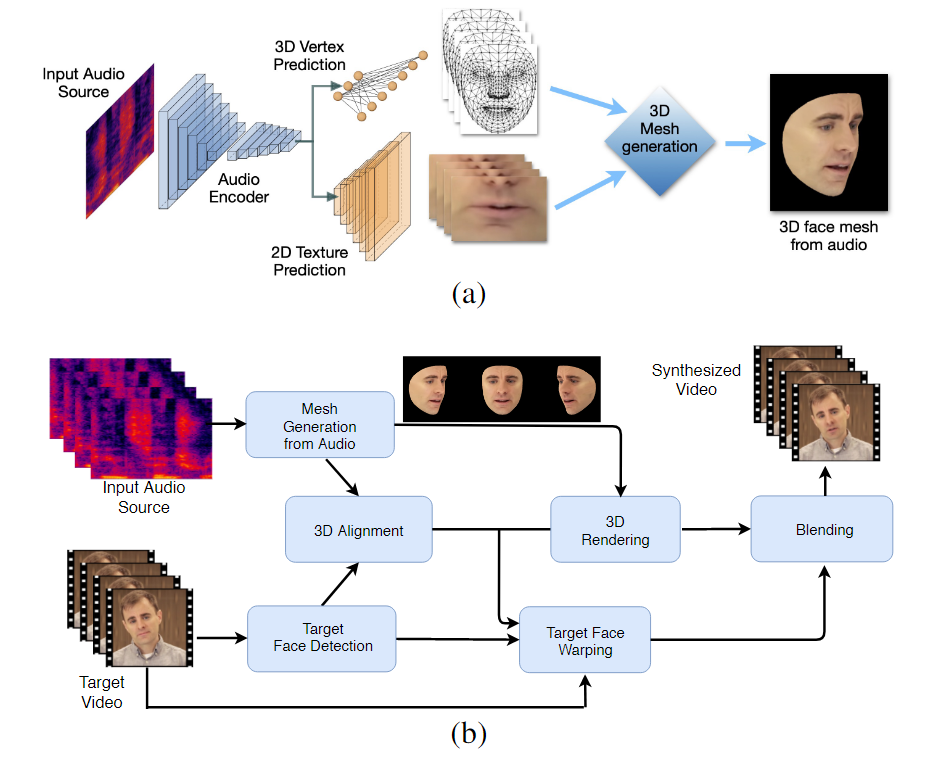

The two-stage work-flow of LipSync3D. Above, the generation of a dynamically textured 3D face from the ‘target’ audio; below, the insertion of the generated mesh into a target video.

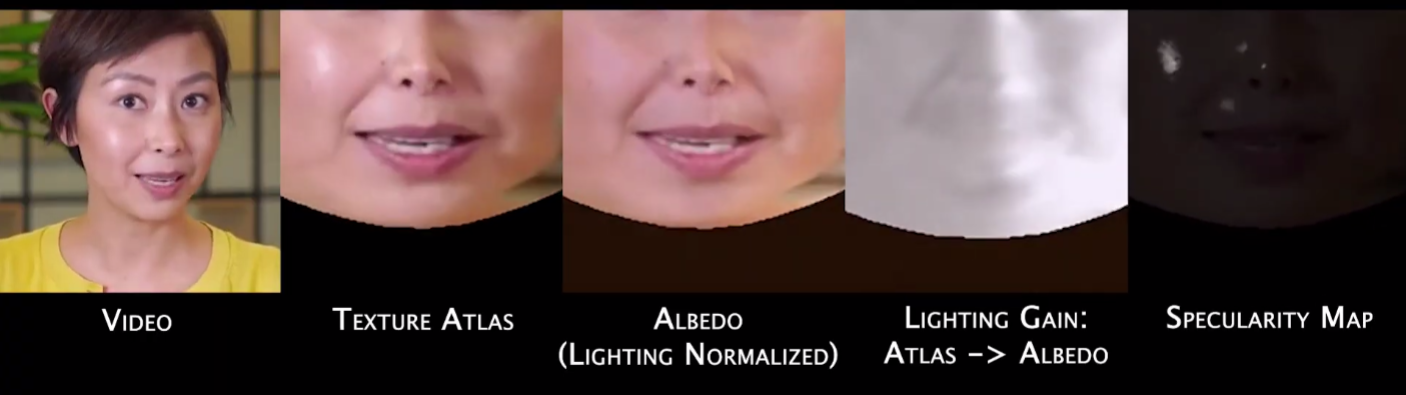

En fait, la contribution la plus notable de LipSync3D à l’effort de recherche dans ce domaine peut être son algorithme de normalisation de l’éclairage, qui découple la formation et l’inférence de l’éclairage.

Decoupling illumination data from general geometry helps LipSync3D to produce more realistic lip movement output under challenging conditions. Other approaches of recent years have limited themselves to ‘fixed’ lighting conditions that won’t reveal their more limited capacity in this respect.

Lors du prétraitement des trames d’entrée, le système doit identifier et supprimer les points spéculaires, car ceux-ci sont spécifiques aux conditions d’éclairage dans lesquelles la vidéo a été prise, et gêneraient autrement le processus de rééclairage.

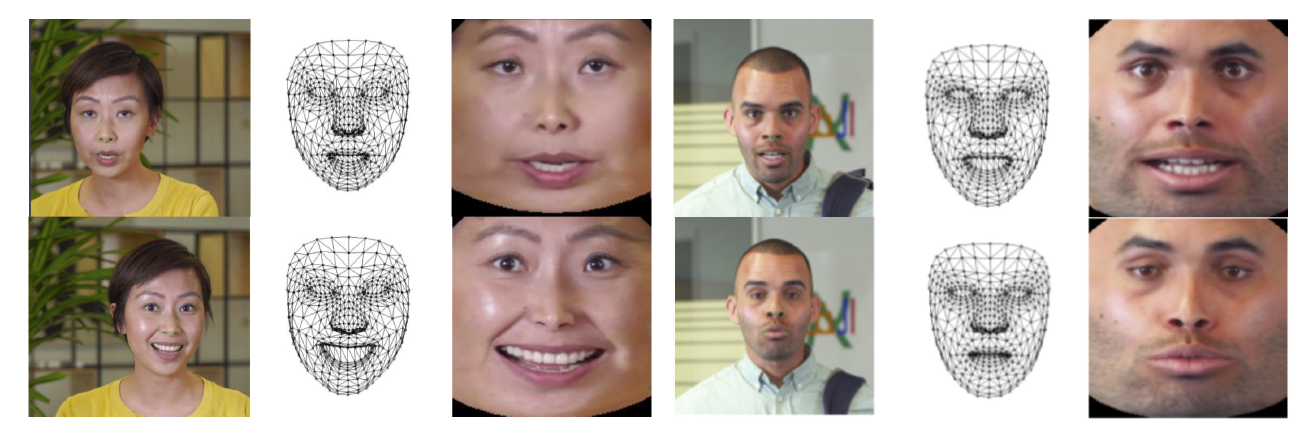

LipSync3D, comme son nom l’indique, ne réalise pas une simple analyse de pixels sur les visages qu’il évalue, mais utilise activement des repères faciaux identifiés pour générer des maillages CGI mobiles, ainsi que les textures ‘dépliées’ qui sont enveloppées autour d’eux dans un pipeline CGI traditionnel.

Pose normalization in LipSync3D. On the left are the input frames and detected features; in the middle, the normalized vertices of the generated mesh evaluation; and on the right, the corresponding texture atlas, which provides the ground truth for texture prediction. Source: https://arxiv.org/pdf/2106.04185.pdf

En plus de la méthode de rééclairage novatrice, les chercheurs affirment que LipSync3D offre trois innovations principales par rapport aux travaux précédents : la séparation de la géométrie, de l’éclairage, de la pose et de la texture en flux de données discrets dans un espace normalisé ; un modèle de prédiction de texture auto-régressif facile à former qui produit une synthèse de vidéo temporellement cohérente ; et une réalisme accru, évalué par des notations humaines et des métriques objectives.

Splitting out the various facets of the video facial imagery allows greater control in video synthesis.

LipSync3D peut dériver une géométrie de mouvement des lèvres appropriée directement à partir de l’audio en analysant les phonèmes et d’autres facettes du discours, et en les traduisant en poses de muscle connues autour de la zone de la bouche.

Ce processus utilise un pipeline de prédiction conjointe, où la géométrie et la texture inférées ont des encodeurs dédiés dans un ensemble d’auto-encodeurs, mais partagent un encodeur audio avec le discours qui est destiné à être imposé au modèle :

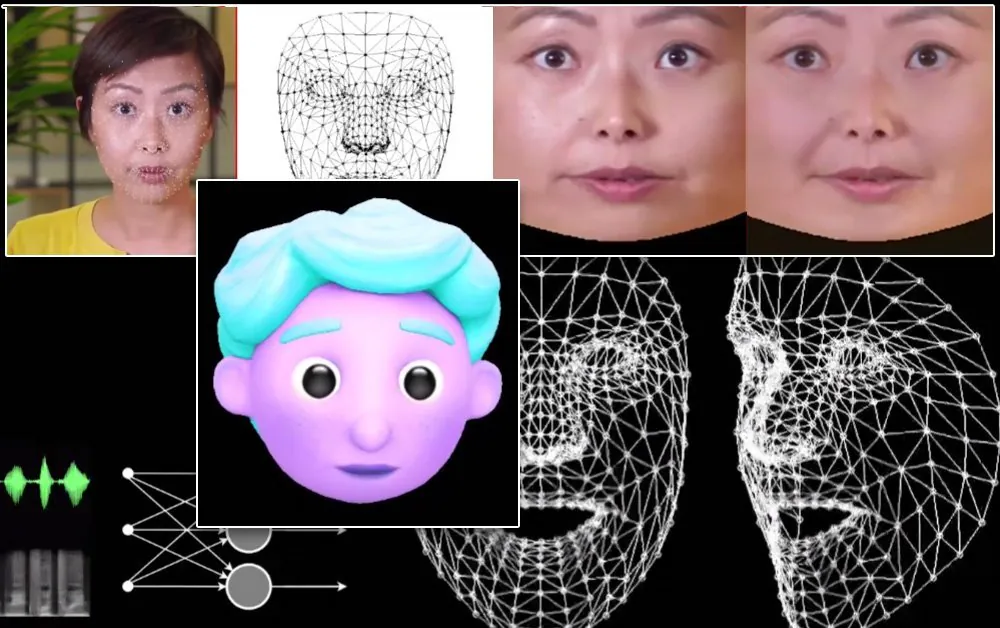

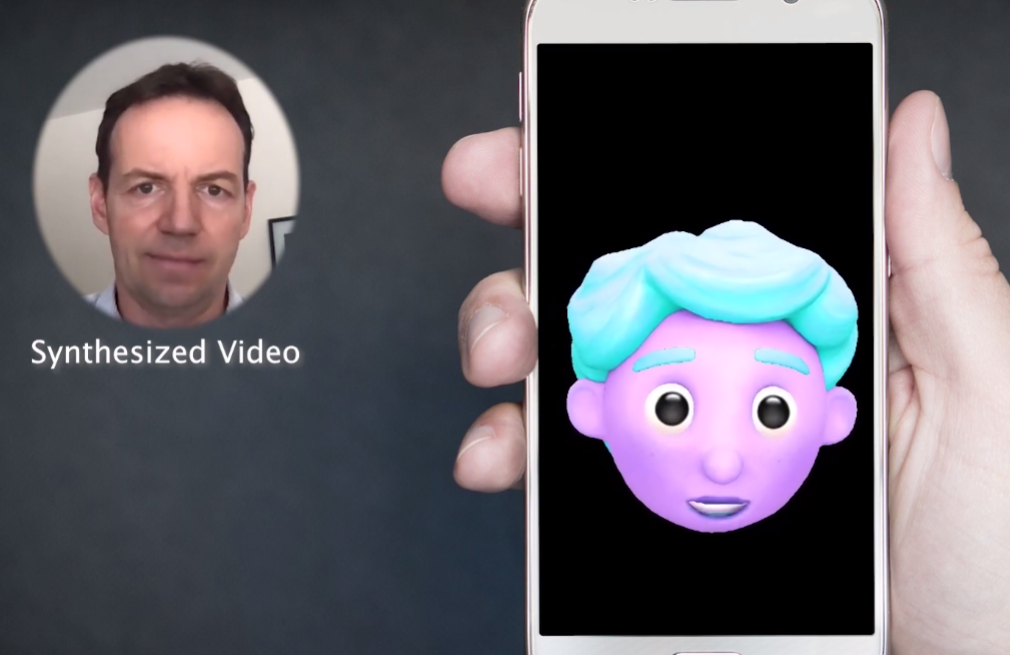

La synthèse de mouvement labile de LipSync3D est également destinée à alimenter des avatars CGI stylisés, qui ne sont en effet que le même type d’information de maillage et de texture que les images du monde réel :

A stylized 3D avatar has its lip movements powered in real time by a source speaker video. In such a scenario, the best results would be obtained by personalized pre-training.

Les chercheurs anticipent également l’utilisation d’avatars avec une sensation légèrement plus réaliste :

![]()

Les temps de formation d’échantillon pour les vidéos vont de 3 à 5 heures pour une vidéo de 2 à 5 minutes, dans un pipeline qui utilise TensorFlow, Python et C++ sur un GeForce GTX 1080. Les sessions de formation ont utilisé une taille de lot de 128 trames sur 500-1000 époques, avec chaque époque représentant une évaluation complète de la vidéo.

Vers une synchronisation dynamique du mouvement des lèvres

Le domaine de la synchronisation des lèvres pour accommoder une nouvelle piste audio a reçu une grande attention dans la recherche en vision par ordinateur au cours des dernières années (voir ci-dessous), notamment en tant que sous-produit de la technologie de deepfake controversée.

En 2017, l’Université de Washington a présenté des recherches capables d’apprendre la synchronisation des lèvres à partir de l’audio, en l’utilisant pour modifier les mouvements des lèvres de l’ancien président Obama. En 2018, l’Institut Max Planck pour l’informatique a dirigé une autre initiative de recherche pour permettre le transfert de vidéo d’identité à identité, avec la synchronisation des lèvres comme sous-produit du processus ; et en mai 2021, l’entreprise de technologie AI FlawlessAI a révélé sa technologie de synchronisation des lèvres propriétaire TrueSync, largement reçue dans la presse comme un moyen d’améliorer les technologies de doublage pour les sorties de films majeures dans plusieurs langues.

Et, bien sûr, le développement continu des référentiels de code source ouverts de deepfake fournit une autre branche de recherche active contributive dans ce domaine de synthèse d’images faciales.