Intelligence artificielle

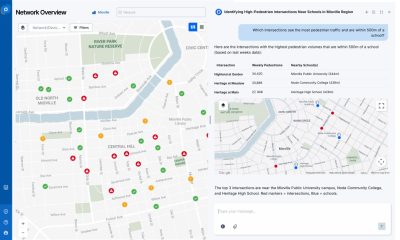

DeepSeek-V3 dévoilé : Comment la conception d’IA tenant compte du matériel réduit les coûts et améliore les performances

DeepSeek-V3 représente une avancée dans le développement d’IA rentable. Il démontre comment une conception intelligente de logiciel et de matériel peut offrir des performances de pointe sans coûts excessifs. En s’entraînant sur seulement 2 048 GPU NVIDIA H800, ce modèle obtient des résultats remarquables grâce à des approches innovantes comme l’Attention Latente Multi-tête pour l’efficacité de la mémoire, l’architecture Mixture of Experts pour le calcul optimisé et la formation de précision mixte FP8 qui débloque le potentiel du matériel. Le modèle montre que les petites équipes peuvent concurrencer les grandes entreprises technologiques grâce à des choix de conception intelligents plutôt que par une mise à l’échelle brutale.

Le défi de la mise à l’échelle de l’IA

L’industrie de l’IA est confrontée à un problème fondamental. Les grands modèles de langage deviennent plus importants et plus puissants, mais ils exigent également d’énormes ressources computationnelles que la plupart des organisations ne peuvent pas se permettre. Les grandes entreprises technologiques comme Google, Meta et OpenAI déployent des grappes d’entraînement avec des dizaines ou des centaines de milliers de GPU, ce qui rend difficile pour les petites équipes de recherche et les startups de concurrencer.

Cette lacune en termes de ressources menace de concentrer le développement de l’IA entre les mains de quelques grandes entreprises technologiques. Les lois de mise à l’échelle qui régissent les progrès de l’IA suggèrent que les modèles plus grands avec plus de données d’entraînement et de puissance de calcul conduisent à de meilleures performances. Cependant, la croissance exponentielle des besoins en matériel rend de plus en plus difficile pour les petits acteurs de concurrencer dans la course à l’IA.

Les exigences en termes de mémoire sont également devenues un défi important. Les grands modèles de langage nécessitent des ressources de mémoire importantes, avec une demande qui augmente de plus de 1000 % par an. Pendant ce temps, la capacité de mémoire à haute vitesse augmente à un rythme beaucoup plus lent, généralement inférieur à 50 % par an. Cette inadéquation crée ce que les chercheurs appellent le “mur de la mémoire de l’IA“, où la mémoire devient le facteur limitant plutôt que la puissance de calcul.

La situation devient encore plus complexe lors de l’inférence, lorsque les modèles servent de vrais utilisateurs. Les applications d’IA modernes impliquent souvent des conversations à plusieurs tours et des contextes longs, nécessitant des mécanismes de mise en cache puissants qui consomment des ressources de mémoire importantes. Les approches traditionnelles peuvent rapidement submerger les ressources disponibles et rendre l’inférence efficace un défi technique et économique important.

L’approche de DeepSeek-V3 tenant compte du matériel

DeepSeek-V3 est conçu avec l’optimisation du matériel en tête. Au lieu d’utiliser plus de matériel pour mettre à l’échelle les grands modèles, DeepSeek s’est concentré sur la création de conceptions de modèles tenant compte du matériel qui optimisent l’efficacité dans les contraintes existantes. Cette approche permet à DeepSeek d’atteindre des performances de pointe en utilisant seulement 2 048 GPU NVIDIA H800, une fraction de ce dont les concurrents ont généralement besoin.

L’insight clé derrière DeepSeek-V3 est que les modèles d’IA devraient considérer les capacités du matériel comme un paramètre clé dans le processus d’optimisation. Plutôt que de concevoir des modèles en isolation et de déterminer ensuite comment les exécuter de manière efficace, DeepSeek s’est concentré sur la construction d’un modèle d’IA qui intègre une compréhension approfondie du matériel sur lequel il fonctionne. Cette stratégie de co-conception signifie que le modèle et le matériel travaillent ensemble de manière efficace, plutôt que de traiter le matériel comme une contrainte fixe.

Le projet s’appuie sur les insights clés des modèles DeepSeek précédents, en particulier DeepSeek-V2, qui a introduit des innovations réussies comme DeepSeek-MoE et l’Attention Latente Multi-tête. Cependant, DeepSeek-V3 étend ces insights en intégrant la formation de précision mixte FP8 et en développant de nouvelles topologies de réseau qui réduisent les coûts d’infrastructure sans sacrifier les performances.

Cette approche tenant compte du matériel s’applique non seulement au modèle mais également à l’ensemble de l’infrastructure d’entraînement. L’équipe a développé un réseau à deux couches Fat-Tree Multi-Plane pour remplacer les topologies traditionnelles à trois couches, réduisant ainsi de manière significative les coûts de mise en réseau du cluster. Ces innovations en termes d’infrastructure démontrent comment une conception réfléchie peut réaliser des économies de coûts importantes dans l’ensemble du pipeline de développement de l’IA.

Les innovations clés qui stimulent l’efficacité

DeepSeek-V3 apporte plusieurs améliorations qui augmentent considérablement l’efficacité. L’une des innovations clés est le mécanisme d’Attention Latente Multi-tête (MLA), qui répond à l’utilisation élevée de la mémoire lors de l’inférence. Les mécanismes d’attention traditionnels nécessitent la mise en cache des vecteurs Clé et Valeur pour toutes les têtes d’attention. Cela consomme des quantités énormes de mémoire à mesure que les conversations deviennent plus longues.

MLA résout ce problème en compressant les représentations Clé-Valeur de toutes les têtes d’attention en un vecteur latent plus petit à l’aide d’une matrice de projection formée avec le modèle. Lors de l’inférence, seul ce vecteur latent compressé doit être mis en cache, réduisant ainsi de manière significative les exigences en termes de mémoire. DeepSeek-V3 nécessite seulement 70 Ko par jeton, comparé à 516 Ko pour LLaMA-3.1 405B et 327 Ko pour Qwen-2.5 72B1.

L’architecture Mixture of Experts offre un autre gain d’efficacité crucial. Au lieu d’activer l’ensemble du modèle pour chaque calcul, MoE active sélectivement uniquement les réseaux d’experts les plus pertinents pour chaque entrée. Cette approche maintient la capacité du modèle tout en réduisant de manière significative le calcul réel requis pour chaque passage avant.

La formation de précision mixte FP8 améliore encore l’efficacité en passant d’une précision à 16 bits à une précision à 8 bits. Cela réduit la consommation de mémoire de moitié tout en maintenant la qualité de la formation. Cette innovation répond directement au mur de la mémoire de l’IA en faisant un usage plus efficace des ressources matérielles disponibles.

Le Module de prédiction de jetons multiples ajoute une autre couche d’efficacité lors de l’inférence. Au lieu de générer un jeton à la fois, ce système peut prédire plusieurs jetons futurs simultanément, augmentant ainsi de manière significative la vitesse de génération grâce à la décoding spéculative. Cette approche réduit le temps total nécessaire pour générer des réponses, améliorant l’expérience utilisateur tout en réduisant les coûts de calcul.

Les leçons clés pour l’industrie

Le succès de DeepSeek-V3 fournit plusieurs leçons clés pour l’industrie de l’IA dans son ensemble. Il montre que l’innovation en termes d’efficacité est tout aussi importante que la mise à l’échelle de la taille du modèle. Le projet met également en évidence comment une conception soigneuse de logiciel et de matériel peut surmonter les limites de ressources qui pourraient autrement restreindre le développement de l’IA.

Cette approche de conception tenant compte du matériel pourrait changer la façon dont l’IA est développée. Au lieu de voir le matériel comme une limitation à contourner, les organisations pourraient le considérer comme un facteur de conception clé qui façonne l’architecture du modèle dès le départ. Ce changement de mentalité peut conduire à des systèmes d’IA plus efficaces et plus rentables dans l’ensemble de l’industrie.

L’efficacité des techniques comme MLA et la formation de précision mixte FP8 suggère qu’il existe encore une marge importante pour améliorer l’efficacité. À mesure que le matériel continue de progresser, de nouvelles opportunités d’optimisation émergeront. Les organisations qui tirent parti de ces innovations seront mieux préparées à concurrencer dans un monde avec des contraintes de ressources croissantes.

Les innovations en termes de mise en réseau dans DeepSeek-V3 mettent également l’accent sur l’importance de la conception d’infrastructure. Alors que beaucoup d’attention est portée sur les architectures de modèles et les méthodes d’entraînement, l’infrastructure joue un rôle critique dans l’efficacité globale et le coût. Les organisations qui construisent des systèmes d’IA devraient donner la priorité à l’optimisation de l’infrastructure ainsi qu’aux améliorations du modèle.

Le projet démontre également la valeur de la recherche ouverte et de la collaboration. En partageant leurs insights et techniques, l’équipe DeepSeek contribue à l’avancement plus large de l’IA tout en établissant leur position en tant que leaders dans le développement d’IA efficace. Cette approche profite à l’ensemble de l’industrie en accélérant les progrès et en réduisant la duplication d’efforts.

Le point clé

DeepSeek-V3 est un pas important en avant dans l’intelligence artificielle. Il montre que la conception soigneuse peut offrir des performances comparables à, ou meilleures que, la simple mise à l’échelle des modèles. En utilisant des idées comme l’Attention Latente Multi-tête, les couches Mixture-of-Experts et la formation de précision mixte FP8, le modèle atteint des résultats de premier plan tout en réduisant considérablement les besoins en matériel. Cette focalisation sur l’efficacité du matériel donne aux petits laboratoires et entreprises de nouvelles chances de construire des systèmes avancés sans budgets importants. À mesure que l’IA continue de progresser, des approches comme celles de DeepSeek-V3 deviendront de plus en plus importantes pour assurer que les progrès soient à la fois durables et accessibles. DeepSeek-3 enseigne également une leçon plus large. Avec des choix d’architecture intelligents et une optimisation serrée, nous pouvons construire une IA puissante sans avoir besoin de ressources et de coûts importants. De cette façon, DeepSeek-V3 offre à l’ensemble de l’industrie un chemin pratique vers une IA rentable et plus accessible qui aide de nombreuses organisations et utilisateurs dans le monde.