Angle d’Anderson

Apporter un sens de l’odorat au développement de l’IA

Un nouveau jeu de données d’IA enseigne aux machines à sentir en associant des données d’odeur à des images, permettant aux modèles de faire correspondre les odeurs aux objets, scènes et matériaux.

Peut-être parce que les machines à sortie d’odeur ont un historique plutôt mitigé, l’olfaction est un sens plutôt négligé dans la littérature de recherche sur l’IA. À moins que vous ne prévoyiez produire une autre entrée dans la longue saga du smell-o-vision, qui dure plus d’un siècle à ce jour, les cas d’utilisation ont toujours semblé plutôt « de niche » par rapport à l’exploitation potentielle des jeux de données d’images, d’audio et de vidéo, et des modèles d’IA formés à partir de ceux-ci.

En fait, la possibilité d’automatiser, d’industrialiser et de populariser les installations de détection offertes par les chiens de détection de bombes, les chiens de détection de cadavres, les chiens de détection de maladies et divers autres types d’unités de détection canine, serait un avantage notable dans les services municipaux et de sécurité. Malgré la forte demande, loin de dépasser l’offre, la formation et la maintenance des chiens de détection sont une entreprise coûteuse qui ne ne propose pas toujours une bonne valeur pour l’argent.

Jusqu’à présent, la plupart des recherches qui empiètent sur ce domaine d’étude ont été confinées à un laboratoire, avec des collections ciblées composées d’exemples avec des fonctionnalités conçues à la main – un profil plus enclin vers des solutions de type cottage-industrie que des applications industrialisées.

Devant par le nez

Dans ce climat plutôt terne, une collaboration académique/industrielle intéressante des États-Unis arrive, dans laquelle une équipe de chercheurs a passé plusieurs mois à cataloguer diverses odeurs dans des environnements intérieurs et extérieurs à New York – et, pour la première fois, à rassembler des images associées aux odeurs capturées :

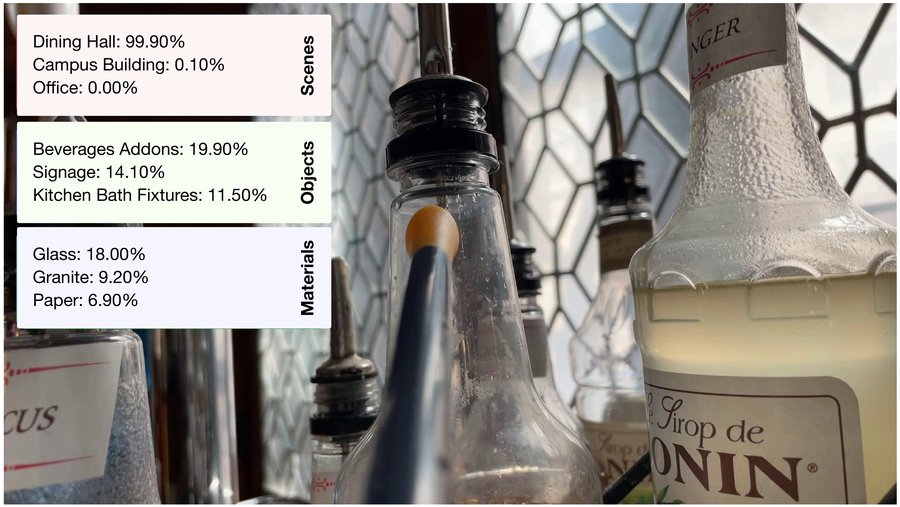

Notez le capteur central, le « nez » de l’appareil olfactif. Formé uniquement sur l’odeur, le modèle devine s’il renifle du granit, du plastique ou du cuir – et identifie même la pièce dans laquelle il se trouve, sans voir un seul pixel. Source

Cette recherche a conduit les auteurs du nouveau travail à concevoir une variante du cadre de préformation du langage-image contrastif (CLIP) très populaire, sous la forme de Préformation olfactive-image contrastive (COIP) – qui relie les odeurs et les images.

En haut : des données de capteur olfactif et vidéo synchronisées sont capturées dans des paramètres naturels à l’aide d’un appareil photo-e-nez. En bas à gauche (b) : un ensemble d’incrustations est appris par auto-supervision cross-modale. (c) : le système récupère des correspondances visuelles en fonction d’une odeur de requête. (d) : des échantillons d’odeur individuels sont utilisés pour classer les catégories d’environnement, d’objet et de matériau. (e) : des odeurs très similaires, comme deux types d’herbe, sont distinguées sans entrée visuelle. Source

Le nouveau jeu de données, intitulé Les odeurs de New York, contient 7 000 paires d’odeurs et d’images mettant en vedette 3 500 objets différents. Lorsqu’il a été formé dans des tests, les nouvelles données ont été trouvées pour surpasser les fonctionnalités populaires conçues à la main dans le nombre relativement faible de jeux de données similaires antérieurs.

Les auteurs espèrent que leur première sortie ouvrira la voie à des travaux ultérieurs et à des suivis vers des systèmes de détection olfactive conçus pour fonctionner dans la nature, de la même manière que les chiens de détection* :

‘Nous considérons ce jeu de données comme une étape vers la perception olfactive multimodale in situ, ainsi que comme une étape vers le lien entre la vue et l’odeur. Alors que l’olfaction a traditionnellement été abordée dans des paramètres contraints, tels que l’assurance qualité, il existe de nombreuses applications dans des paramètres naturels.

‘Par exemple, en tant qu’êtres humains, nous utilisons constamment notre sens de l’odeur pour évaluer la qualité de la nourriture, identifier les dangers et détecter des objets invisibles.

‘De plus, de nombreux animaux, tels que les chiens, les ours et les souris, montrent des capacités olfactives suprahumaines, suggérant que la perception olfactive humaine est loin de la limite des capacités des machines.’

Bien que le nouvel article, intitulé Les odeurs de New York : un grand jeu de données multimodal pour l’olfaction, promette que les données et le code seront publiés, un fichier de données de 27 Go est déjà disponible via le site du projet. L’article a été produit par neuf chercheurs de l’Université Columbia, de l’Université Cornell et d’Osmo Labs.

Méthode

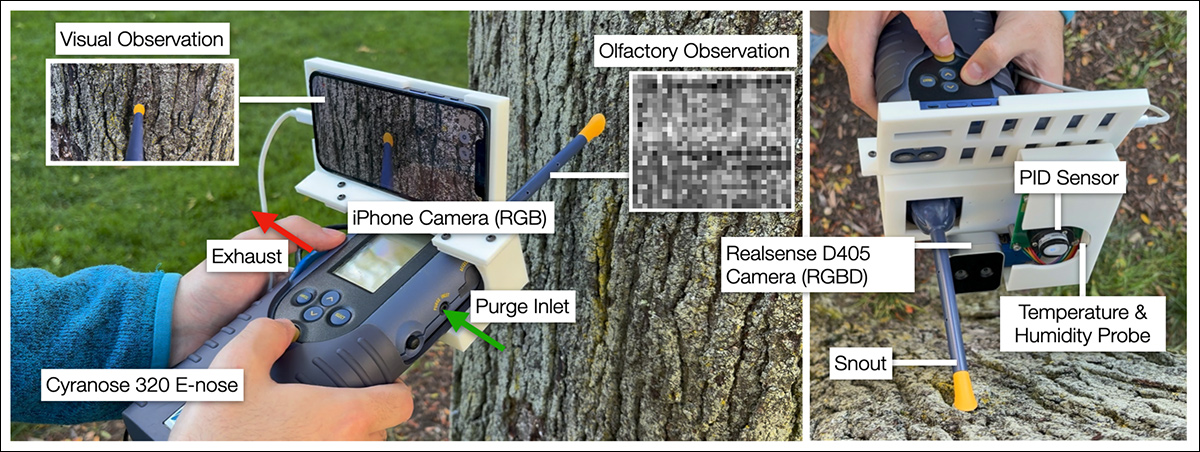

Pour collecter du matériel pour la nouvelle collection, les chercheurs ont utilisé le Cyranose 320 nez électronique, avec un iPhone monté au-dessus de la prise d’air avant pour capturer visuellement les odeurs enregistrées :

Un appareil de capteur portable collecte des données de vidéo et d’odeur appariées en montant un appareil photo iPhone sur un nez électronique Cyranose 320. Le museau est dirigé vers les objets tandis que l’échappement et l’entrée de purge gèrent le débit d’air pendant l’échantillonnage. Une caméra RGB-D capture la profondeur, tandis que la concentration de composés organiques volatils (COV), la température et l’humidité sont enregistrées par des capteurs intégrés, notamment un module PID et une sonde environnementale.

L’appareil Cyranose fonctionne à 2 Hz, enregistrant des étapes olfactives de 32 dimensions. Les concentrations de composés organiques volatils (COV) ont été enregistrées avec un capteur MiniPID2 PPM WR.

L’unité portable a fonctionné comme un capteur agile, relayant des données à une station mobile plus puissante pour le traitement.

Pour placer l’odeur cible dans son contexte, une « odeur de référence » a été enregistrée, avant que l’objet plus spécifique ne soit ciblé directement avec le « museau » du Cyranose. L’échantillon ambiant a ensuite été pris à partir d’un port latéral de l’unité, pour s’assurer qu’il était suffisamment éloigné de la source d’odeur principale pour ne pas être contaminé.

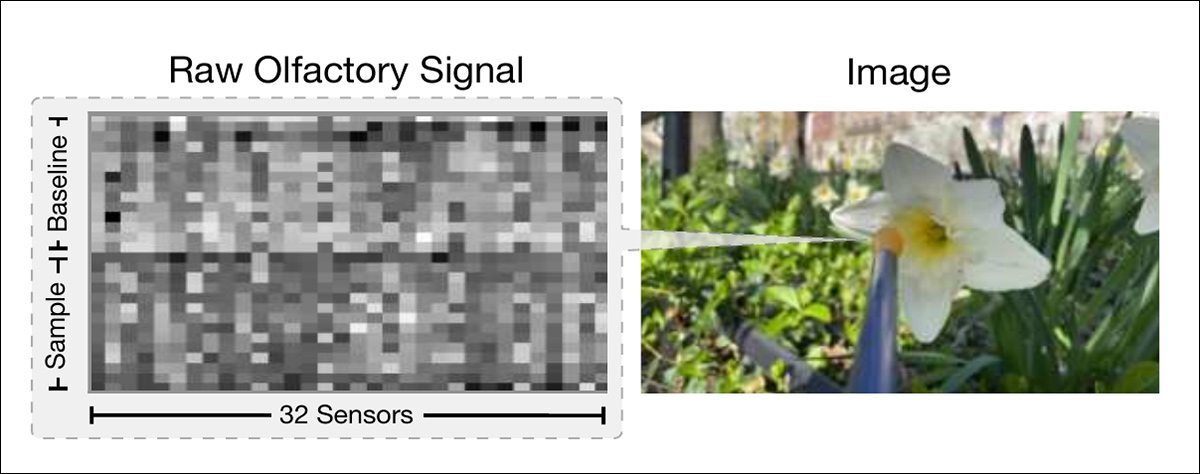

Deux échantillons ont été pris par la prise d’air principale du capteur, avec chaque enregistrement de dix secondes capturé à partir d’une position différente autour de l’objet, pour améliorer l’efficacité des données. Les échantillons ont ensuite été combinés avec l’odeur de référence ambiant pour former une matrice 28×32, représentant la mesure olfactive complète :

Cet exemple montre le signal et l’image correspondante pour une fleur. Le signal olfactif complet se compose d’une matrice 28×32, combinant une ligne de base ambiant de 14 cadres avec deux échantillons de 10 secondes pris à partir de différents angles autour de l’objet cible.

Données et tests

Des modèles de langage et de vision (VLM) ont été utilisés pour étiqueter automatiquement les objets et les matériaux capturés par l’iPhone dans le montage Cyranose, avec GPT-4o utilisé pour la tâche ; cependant, les catégories de scène ont été étiquetées manuellement :

Un petit échantillon d’une illustration étendue dans l’article source détaillant les sources et les environnements d’odeur variés capturés dans le projet.

Le jeu de données a été divisé en parties de formation et de validation splits, avec les deux échantillons de chaque objet attribués à la même partie pour éviter la contamination croisée. La collection finale comprend 7 000 paires olfactives-visuelles issues de 3 500 objets non étiquetés, ainsi que 70 heures de vidéo et 196 000 étapes temporelles de données olfactives brutes à la fois des phases de référence et d’échantillonnage.

Les données ont été collectées au cours de 60 sessions sur une période de deux mois, couvrant des parcs, des bâtiments universitaires, des bureaux, des rues, des bibliothèques, des appartements et des salles à manger, avec plusieurs sessions menées dans chaque emplacement. Le jeu de données résultant contient 41 % d’environnements extérieurs et 59 % d’environnements intérieurs.

Pour développer des représentations olfactives à usage général, les auteurs ont formé un modèle contrastif pour associer des paires d’images et d’odeurs synchronisées à partir du jeu de données. Cette approche, la COIP mentionnée ci-dessus, utilise une fonction de perte adaptée de CLIP pour aligner les incrustations de signaux visuels et olfactifs co-occurrents.

La formation a utilisé à la fois un encodeur visuel et un encodeur d’odeur, avec pour objectif d’enseigner au modèle à rapprocher les odeurs et les images correspondantes dans un espace de représentation partagé. Les représentations résultantes soutiennent une gamme de tâches en aval, notamment la récupération d’images à partir d’odeurs, la reconnaissance de scènes et d’objets, la classification de matériaux et la discrimination d’odeurs à grain fin.

Le modèle a été formé en utilisant deux types d’entrées olfactives : le signal olfactif brut et un résumé conçu à la main appelé empreintes d’odeur – des fonctionnalités largement utilisées dans la recherche olfactive qui compressent chaque réponse du capteur en un seul nombre en comparant la résistance de pointe pendant l’échantillonnage avec la résistance moyenne pendant la référence ambiante.

En revanche, l’entrée brute enregistrée dans toute la ville de New York se compose d’une série chronologique de 32 capteurs chimiques à l’intérieur de l’appareil Cyranose, capturant la façon dont chaque capteur a changé de résistance électrique au fil du temps lorsqu’il réagissait à l’odeur.

Pour la curation du jeu de données, ce signal non traité a été directement introduit dans un réseau de neurones, permettant un apprentissage de bout en bout avec soit un convolutionnel soit un transformer -based backbone. Les modèles ont été formés en utilisant à la fois des empreintes d’odeur et l’entrée brute collectée à partir de divers environnements de la ville de New York, avec les deux types d’entrée évalués en utilisant un apprentissage contrastif.

Récupération cross-modale

La récupération cross-modale a été évaluée en intégrant chaque échantillon d’odeur et son image appariée dans un espace de représentation partagé, et en testant si l’image correcte pouvait être récupérée en fonction uniquement de l’entrée olfactive.

Le classement a été déterminé par la proximité de chaque incrustation d’image dans cet espace, et la performance a été mesurée en utilisant le rang moyen, le rang médian et le rappel à plusieurs seuils :

Précision de la récupération cross-modale pour différents encodeurs d’odeur, montrant à quel point chaque modèle identifie correctement l’image à partir d’une requête d’odeur. Les résultats comparent les architectures formées sur des signaux olfactifs bruts avec celles utilisant des empreintes d’odeur.

À ce sujet, les auteurs déclarent :

‘La préformation contrastive en utilisant des empreintes d’odeur donne de meilleurs résultats que le hasard dans toutes les métriques. Cependant, la formation de l’encodeur olfactif sur le signal olfactif brut conduit à une amélioration significative par rapport à l’encodeur d’empreintes d’odeur, indépendamment de l’architecture.

‘Cela montre les informations plus riches présentes dans les données olfactives brutes, débloquant des associations cross-modales plus fortes entre la vue et l’odeur.’

Un détail de la septième illustration de l’article source, qui est trop condensé pour être reproduit de manière significative ici. Ici, des exemples de récupération cross-modale montrant comment le modèle relie les odeurs aux images correspondantes. Chaque ligne commence par une requête d’odeur, suivie des prédictions d’images les plus classées dans l’espace d’incrustation partagé. L’image correcte pour chaque requête est délimitée en vert, illustrant comment les odeurs de livres, de plantes, de maçonnerie et d’autres matériaux attirent le modèle vers des scènes visuellement et sémantiquement liées.

Les auteurs notent également que les résultats de récupération montrent des modèles sémantiques clairs :

‘Les récupérations de notre modèle montrent souvent des regroupements sémantiques. L’odeur d’un livre récupère des images d’autres livres, l’odeur des feuilles récupère des images de feuillage.

‘Ces résultats suggèrent que la représentation apprise capture une structure cross-modale significative.’

Reconnaissance de scène, d’objet et de matériau

La capacité du modèle à reconnaître les odeurs sans entrée visuelle a été évaluée en le formant pour identifier les scènes, les objets et les matériaux en fonction uniquement des données olfactives ; à cette fin, une sonde linéaire (un simple classificateur formé sur des représentations figées) a été utilisée pour évaluer la quantité d’informations encodées dans les incrustations d’odeur apprises.

Les étiquettes ont été dérivées des images appariées dans l’ensemble de formation en utilisant GPT-4o – mais seule l’odeur a été utilisée pendant la classification.

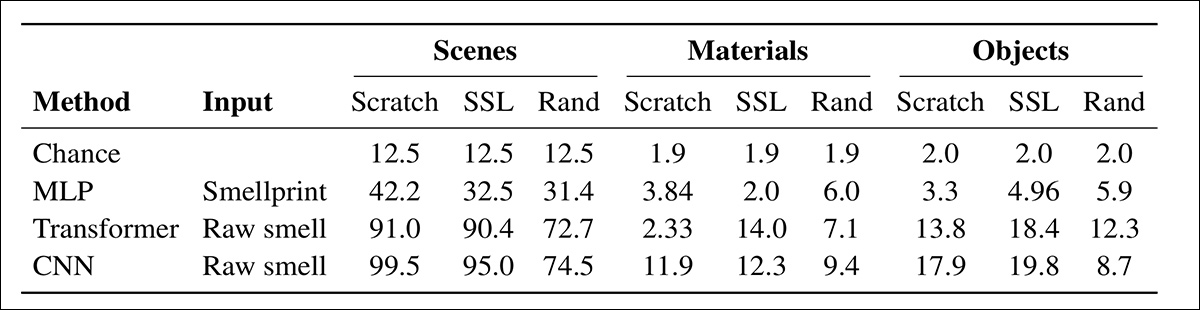

Plusieurs types d’encodeurs ont été testés : certains initialisés aléatoirement, certains formés à partir de zéro, et d’autres formés en utilisant un apprentissage contrastif pour aligner l’odeur et la vision dans un espace de représentation partagé, avec des données brutes et des empreintes d’odeur évaluées :

Précision de classification pour les scènes, les matériaux et les objets a été évaluée en utilisant des signaux olfactifs seuls. L’entrée de signal olfactif brut a surpassé les empreintes d’odeur, avec des CNN formés à partir de zéro donnant les résultats les plus élevés, notamment 99,5 % pour les scènes. La préformation SSL a aidé dans certains cas, mais a été généralement surpassée par la formation supervisée. Les bases de poids aléatoires indiquent que la capacité du modèle à lui seul s’avère insuffisante.

Une précision nettement plus élevée a été obtenue lorsque des données olfactives brutes ont été utilisées, en particulier dans les modèles formés avec une supervision cross-modale. Les auteurs commentent** :

‘Les modèles formés sur les entrées de signaux sensoriels bruts atteignent également une précision plus élevée que les modèles formés avec les fonctionnalités d’empreintes d’odeur conçues à la main. Ces résultats montrent que l’apprentissage profond à partir de signaux olfactifs bruts est nettement meilleur que les fonctionnalités conçues à la main.’

Discrimination fine

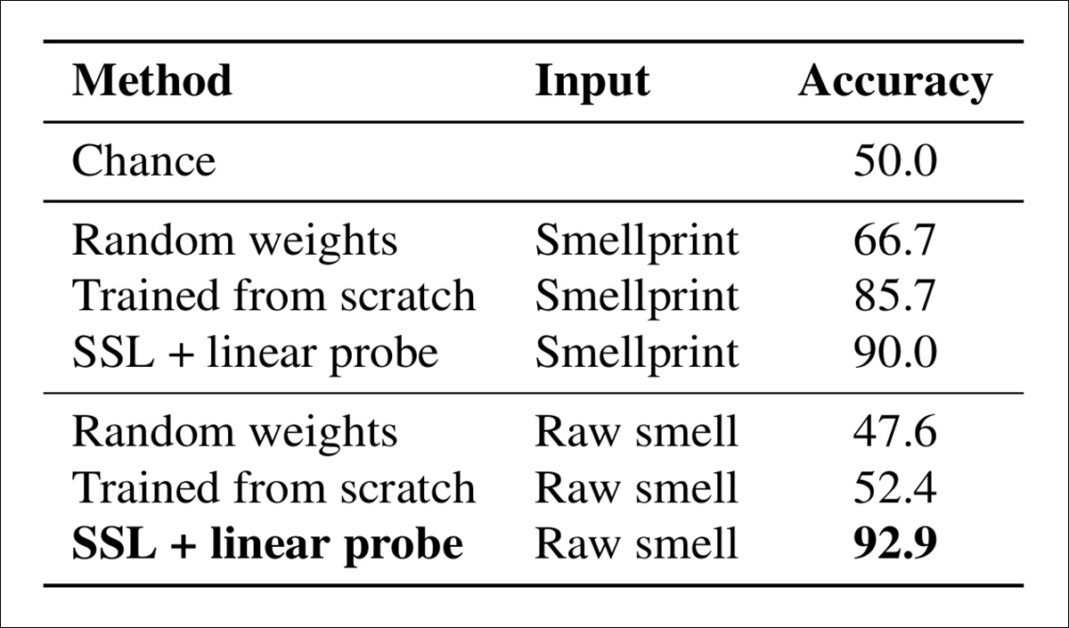

Pour évaluer si des distinctions olfactives à grain fin pouvaient être apprises, un référentiel a été construit à partir de deux espèces d’herbe coexistant sur le même terrain de campus. Des échantillons alternés ont été collectés au cours de six sessions de 30 minutes, donnant 256 exemples. Un classificateur linéaire a été formé sur des fonctionnalités issues de l’apprentissage olfactif-visuel contrastif, et évalué sur un ensemble de 42 échantillons mis de côté :

Précision de la classification des espèces d’herbe à partir de l’odeur seule. Les modèles ont été évalués pour leur capacité à distinguer entre deux types d’herbe visuellement similaires en utilisant uniquement l’entrée olfactive. Les performances ont été comparées à travers les empreintes d’odeur et les données de signal olfactif brut, avec des modèles soit initialisés aléatoirement, formés à partir de zéro, ou formés en utilisant un apprentissage auto-supervisé (SSL) suivi d’une sonde linéaire. La précision la plus élevée, 92,9 %, a été atteinte en utilisant des signaux olfactifs bruts avec SSL, indiquant que les différences d’odeur à grain fin sont mieux capturées par l’entrée brute et la formation guidée par la vision.

Ici, les chercheurs déclarent :

‘La formation sur le signal olfactif brut (au lieu des fonctionnalités conçues à la main) donne la précision la plus élevée – dépassant toutes les variantes basées sur les empreintes d’odeur.

‘Ces résultats suggèrent que l’apprentissage olfactif-visuel préserve plus d’informations à grain fin que l’apprentissage avec des empreintes d’odeur, et que la supervision visuelle fournit un signal pour exploiter ces informations.’

Conclusion

Bien que la synthèse d’odeur semble susceptible de rester un problème non résolu dans un avenir proche, un système d’analyse d’odeur efficace et abordable dans la nature a un potentiel énorme, non seulement pour les fins de police, de sécurité et médicales, mais également pour la surveillance de la qualité de vie et urbaine.

Actuellement, l’équipement impliqué est de niche et généralement assez coûteux ; par conséquent, les progrès réels dans l’« IA olfactive » pour la détection semblent probablement nécessiter un capteur visionnaire et abordable dans l’esprit de Raspberry PI.

* Ma conversion des citations en ligne des auteurs en liens hypertexte.

** Veuillez noter que d’autres illustrations (figure 8) sont disponibles dans l’article source, mais sont mieux vues dans ce contexte.

Publié pour la première fois le vendredi 28 novembre 2025