Intelligence artificielle

Un vérificateur de biais basé sur l’IA pour les articles de presse, disponible en Python

Les chercheurs au Canada, en Inde, en Chine et en Australie ont collaboré pour produire un package Python gratuit qui peut être utilisé efficacement pour détecter et remplacer le « langage injuste » dans les copies de presse.

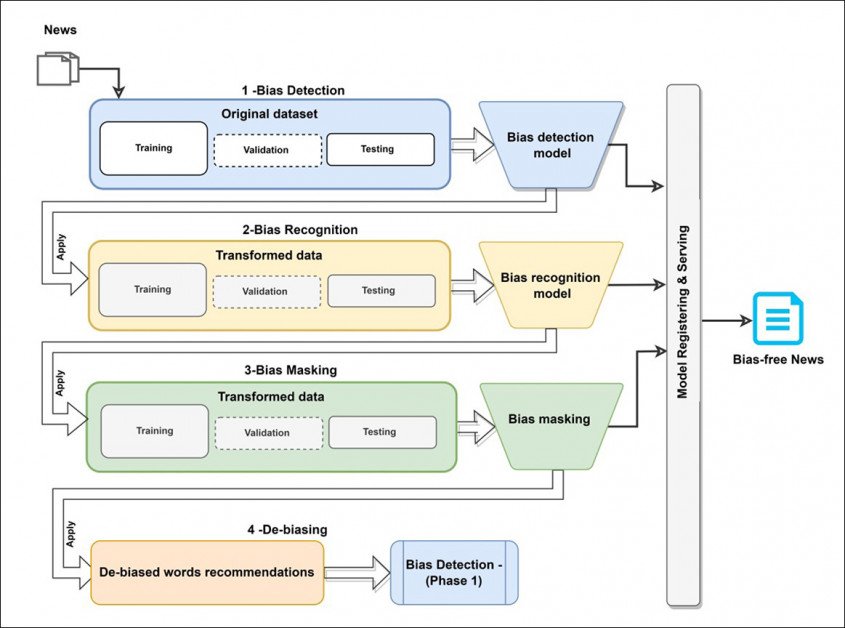

Le système, intitulé Dbias, utilise diverses technologies d’apprentissage automatique et des bases de données pour développer un flux de travail circulaire en trois étapes qui peut affiner le texte biaisé jusqu’à ce qu’il retourne une version non biaisée ou au moins plus neutre.

Le langage chargé dans un extrait de presse identifié comme « biaisé » est transformé en une version moins incendiaire par Dbias. Source : https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Le système représente un pipeline réutilisable et autonome qui peut être installé via Pip à partir de Hugging Face, et intégré dans des projets existants en tant qu’étape supplémentaire, module complémentaire ou plugin.

En avril, une fonctionnalité similaire implémentée dans Google Docs a fait l’objet de critiques, notamment en raison de son manque d’édition. Dbias, en revanche, peut être formé de manière plus sélective sur n’importe quel corpus de nouvelles que l’utilisateur final le souhaite, en conservant la capacité de développer des lignes directrices de fairness personnalisées.

La différence cruciale est que le pipeline Dbias est conçu pour transformer automatiquement le « langage chargé » (les mots qui ajoutent une couche critique à la communication factuelle) en langage neutre ou prosaïque, plutôt que de former l’utilisateur de manière continue. Essentiellement, l’utilisateur final définira des filtres éthiques et formera le système en conséquence ; dans l’approche Google Docs, le système est – à l’argumentation – en train de former l’utilisateur, de manière unilatérale.

Architecture conceptuelle du flux de travail Dbias.

Selon les chercheurs, Dbias est le premier package de détection de biais vraiment configurable, contrairement aux projets d’assemblage prêts à l’emploi qui ont caractérisé ce sous-secteur du traitement automatique des langues (NLP) à ce jour.

Le nouvel article est intitulé Une approche pour assurer l’équité dans les articles de presse, et provient de contributeurs de l’Université de Toronto, de l’Université métropolitaine de Toronto, de l’Environmental Resources Management à Bangalore, de l’Académie des sciences DeepBlue en Chine et de l’Université de Sydney.

Méthode

Le premier module de Dbias est Détection de biais, qui utilise le package DistilBERT – une version hautement optimisée du BERT de Google. Pour le projet, DistilBERT a été affiné sur le jeu de données Media Bias Annotation (MBIC).

MBIC se compose d’articles de presse provenant de diverses sources de médias, notamment The Huffington Post, USA Today et MSNBC. Les chercheurs ont utilisé la version étendue du jeu de données.

Bien que les données originales aient été annotées par des travailleurs crowdsourcés (une méthode qui a été critiquée à la fin de 2021), les chercheurs de l’article ont pu identifier des instances supplémentaires non étiquetées de biais dans le jeu de données et les ont ajoutées manuellement. Les incidents de biais identifiés concernaient la race, l’éducation, l’ethnicité, la langue, la religion et le sexe.

Le module suivant, Reconnaissance de biais, utilise Named Entity Recognition (NER) pour individualiser les mots biaisés du texte d’entrée. L’article indique :

‘Par exemple, l’actualité « Ne croyez pas l’hystérie pseudo-scientifique sur les tornades et le changement climatique » a été classée comme biaisée par le module de détection de biais précédent, et le module de reconnaissance de biais peut maintenant identifier le terme « pseudo-scientifique » comme un mot biaisé.’

NER n’est pas spécifiquement conçu pour cette tâche, mais a été utilisé auparavant pour l’identification de biais, notamment pour un projet 2021 de l’Université de Durham au Royaume-Uni.

Pour cette étape, les chercheurs ont utilisé RoBERTa combiné avec le pipeline NER SpaCy English Transformer.

La prochaine étape, Masquage de biais, implique un masquage multiple novateur des mots biaisés identifiés, qui fonctionne de manière séquentielle dans les cas de plusieurs mots biaisés identifiés.

Le langage chargé est remplacé par un langage pragmatique à la troisième étape de Dbias. Notez que « mouthing » et « using » équivalent à la même action, bien que le premier soit considéré comme dérisoire.

Si nécessaire, les commentaires de cette étape seront renvoyés au début du pipeline pour une évaluation ultérieure jusqu’à ce qu’un certain nombre de reformulations ou de mots alternatifs appropriés aient été générés. Cette étape utilise le modèle de langage masqué (MLM) le long des lignes établies par une collaboration 2021 menée par Facebook Research.

Normalement, la tâche MLM masquera 15 % des mots de manière aléatoire, mais le flux de travail Dbias indique au processus de prendre les mots biaisés identifiés comme entrée.

L’architecture a été mise en œuvre et formée sur Google Colab Pro sur un NVIDIA P100 avec 24 Go de VRAM à une taille de lot de 16, en utilisant seulement deux étiquettes (biaisé et non biaisé).

Tests

Les chercheurs ont testé Dbias contre cinq approches comparables : LG-TFIDF avec régression logistique et TfidfVectorizer (TFIDF) des embeddings de mots ; LG-ELMO ; MLP-ELMO (un réseau neuronal artificiel feed-forward contenant des embeddings ELMO) ; BERT ; et RoBERTa.

Les métriques utilisées pour les tests étaient la précision (ACC), la précision (PREC), le rappel (Rec) et un score F1. Comme les chercheurs n’avaient aucune connaissance d’un système existant capable de réaliser les trois tâches en un seul pipeline, une dispense a été faite pour les cadres concurrents, en évaluant uniquement les tâches principales de Dbias – la détection et la reconnaissance de biais.

Résultats des essais Dbias.

Dbias a réussi à surpasser les résultats de tous les cadres concurrents, y compris ceux avec une empreinte de traitement plus lourde

L’article indique :

‘Le résultat montre également que les embeddings de neurones profonds peuvent surpasser les méthodes d’embedding traditionnelles (par exemple TFIDF) dans la tâche de classification de biais. Cela est démontré par la meilleure performance des embeddings de neurones profonds (c’est-à-dire ELMO) par rapport à la vectorisation TFIDF lorsqu’ils sont utilisés avec LG.

‘C’est probablement parce que les embeddings de neurones profonds peuvent mieux capturer le contexte des mots dans le texte dans différents contextes. Les embeddings de neurones profonds et les méthodes de neurones profonds (MLP, BERT, RoBERTa) performent également mieux que les méthodes de ML traditionnelles (LG).’

Les chercheurs notent également que les méthodes basées sur les transformateurs surpassent les méthodes concurrentes dans la détection de biais.

Un test supplémentaire a consisté à comparer Dbias avec diverses saveurs de SpaCy Core Web, notamment core-sm (petit), core-md (moyen) et core-lg (grand). Dbias a également mené les essais :

Les chercheurs concluent en observant que les tâches de reconnaissance de biais montrent généralement une meilleure précision dans les modèles plus grands et plus coûteux, en raison – selon leur hypothèse – du nombre accru de paramètres et de points de données. Ils observent également que l’efficacité des travaux futurs dans ce domaine dépendra de plus grands efforts pour annoter des jeux de données de haute qualité.

La forêt et les arbres

Espérons que ce type de projet de reconnaissance de biais finement granulaire sera finalement intégré dans des cadres de recherche de biais capables de prendre une vue moins myope, et de prendre en compte que le choix de couvrir une histoire particulière est en soi un acte de biais qui est potentiellement motivé par plus que des statistiques de visionnage rapportées.

Publié pour la première fois le 14 juillet 2022.