Intelligence artificielle

Les limites d’Amazon Mechanical Turk pourraient menacer les systèmes de génération de langage naturel

Une nouvelle étude de l’Université du Massachusetts à Amherst a opposé des enseignants d’anglais à des travailleurs faisant appel à la foule sur Amazon Mechanical Turk pour évaluer les sorties des systèmes de génération de langage naturel (NLG), concluant que les normes laxistes et le « jeu » des tâches prisées parmi les travailleurs d’AMT pourraient entraver le développement du secteur.

Le rapport aboutit à un certain nombre de conclusions accablantes concernant la mesure dans laquelle la sous-traitance à bas coût à grande échelle des tâches d’évaluation de NLG ouvertes pourrait conduire à des résultats et des algorithmes inférieurs dans ce secteur.

Les chercheurs ont également compilé une liste de 45 articles sur la génération de texte ouvert où la recherche avait utilisé AMT, et ont constaté que « la grande majorité » n’a pas signalé des détails critiques sur l’utilisation du service de foule d’Amazon, rendant difficile la reproduction des résultats des articles.

Travail en sweat-shop

Le rapport critique à la fois la nature de sweat-shop d’Amazon Mechanical Turk et les projets universitaires (probablement contraints par le budget) qui prêtent une crédibilité supplémentaire à AMT en l’utilisant (et en le citant) comme une ressource de recherche valable et cohérente. Les auteurs notent :

‘Alors qu’AMT est une solution pratique et abordable, nous observons que la grande variance entre les travailleurs, la mauvaise calibration et les tâches exigeantes sur le plan cognitif peuvent amener les chercheurs à tirer des conclusions scientifiques trompeuses (par exemple, que le texte rédigé par l’homme est « pire » que celui de GPT-2).’

Le rapport blâme le système plutôt que les joueurs, les chercheurs observant :

‘Les travailleurs de la foule sont souvent sous-payés pour leur travail, ce qui nuit à la fois à la qualité de la recherche et, plus important encore, à la capacité de ces travailleurs de la foule à gagner un revenu décent.’

L’article publié, intitulé Les périls de l’utilisation de Mechanical Turk pour évaluer la génération de texte ouvert, conclut en outre que des « évaluateurs experts » tels que des enseignants de langues et des linguistes devraient être utilisés pour évaluer le contenu artificiel de NLG ouvert, même si AMT est moins cher.

Tâches de test

En comparant les performances d’AMT à celles de lecteurs experts moins contraints par le temps, les chercheurs ont dépensé 144 $ pour les services AMT réellement utilisés dans les tests de comparaison (bien que beaucoup plus aient été dépensés pour des résultats « non utilisables » – voir ci-dessous), obligeant des « Turcs » aléatoires à évaluer l’un des 200 textes, répartis entre le contenu textuel créé par l’homme et le texte généré artificiellement.

Le fait de confier aux enseignants professionnels le même travail a coûté 187,50 $, et a confirmé leur performance supérieure (par rapport aux travailleurs d’AMT) en embauchant des freelances Upwork pour reproduire les tâches à un coût supplémentaire de 262,50 $.

Chaque tâche consistait en quatre critères d’évaluation : grammaire (‘Quelle est la correction grammaticale du texte de l’extrait de l’histoire ?’); cohérence (‘Dans quelle mesure les phrases de l’extrait de l’histoire s’assemblent-elles ?’); agréabilité (‘À quel point trouvez-vous l’extrait de l’histoire agréable ?’); et pertinence (‘Quelle est la pertinence de l’extrait de l’histoire par rapport à l’invite ?’).

Génération de textes

Pour obtenir du matériel NLG pour les tests, les chercheurs ont utilisé le jeu de données Hiérarchique de génération de récits neuronaux de 2018 de Facebook AI Research, qui comprend 303 358 histoires en anglais rédigées par des utilisateurs du sous-reddit très populaire (15 millions d’utilisateurs) r/WritingPrompts, où les histoires des abonnés sont « semées » par des invites sous forme de phrases simples de manière similaire aux pratiques actuelles de génération d’image à partir de texte – et, bien sûr, dans les systèmes de génération de langage naturel ouverts systèmes.

200 invites ont été sélectionnées aléatoirement à partir du jeu de données et passées à travers un modèle GPT-2 de taille moyenne en utilisant la bibliothèque Hugging-Face Transformers bibliothèque. Ainsi, deux ensembles de résultats ont été obtenus à partir des mêmes invites : les essais discursifs rédigés par des utilisateurs de Reddit et les textes générés par GPT-2.

Afin d’éviter que les mêmes travailleurs d’AMT ne jugent la même histoire plusieurs fois, trois jugements de travailleurs d’AMT ont été sollicités par exemple. Avec des expériences concernant les capacités en anglais des travailleurs (voir la fin de l’article) et en décomptant les résultats des travailleurs à faible effort (voir « Court Temps » ci-dessous), cela a augmenté le coût total de l’AMT à environ 1 500 $ US.

Pour créer un terrain de jeu équitable, tous les tests ont été menés les jours ouvrables entre 11h00 et 11h30 du matin (heure du Pacifique).

Résultats et conclusions

L’étude exhaustive couvre beaucoup de terrain, mais les points clés sont les suivants :

Court Temps

L’article a constaté qu’un temps de tâche moyen rapporté par Amazon de 360 secondes se résumait à un temps de travail réel de seulement 22 secondes, et un temps de travail médian de seulement 13 secondes – un quart du temps pris par le plus rapide enseignant d’anglais reproduisant la tâche.

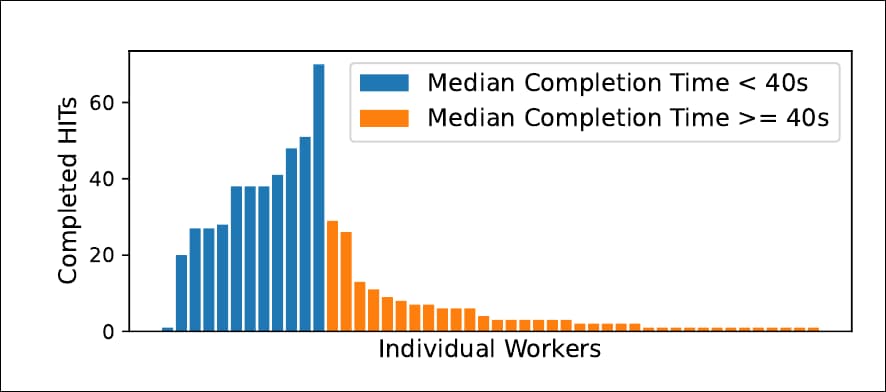

À partir du jour 2 de l’étude : les travailleurs individuels (en orange) ont passé nettement moins de temps à évaluer chaque tâche que les enseignants mieux payés, et (plus tard) les contractants Upwork encore mieux payés. Source : https://arxiv.org/pdf/2109.06835.pdf

Puisque AMT n’impose aucune limite au nombre de tâches d’intelligence humaine (HIT) que peut prendre un travailleur individuel, des « gros joueurs » d’AMT ont émergé, avec (des réputations lucratives) pour compléter un grand nombre de tâches par expérience. Afin de compenser les hits acceptés par le même travailleur, les chercheurs ont mesuré le temps entre les hits soumis consécutivement, en comparant l’heure de début et de fin de chaque hit. De cette façon, le déficit entre le WorkTimeInSeconds rapporté par AMT et le temps réellement passé sur la tâche est devenu clair.

Puisque un tel travail ne peut pas être accompli dans ces délais réduits, les chercheurs ont dû compenser :

‘Comme il est impossible de lire soigneusement un extrait de paragraphe et d’évaluer toutes les quatre propriétés en seulement 13 secondes, nous mesurons l’impact sur les notes moyennes lors du filtrage des travailleurs qui passent trop peu de temps par HIT… Plus précisément, nous supprimons les jugements des travailleurs dont le temps médian est inférieur à 40 s (ce qui est une barre basse), et constatons qu’en moyenne environ 42 % de nos notes sont supprimées (allant de 20 % à 72 % dans l’ensemble des expériences).’

L’article soutient que le temps de travail réel non signalé dans AMT est « un problème majeur » généralement négligé par les chercheurs utilisant les services.

Prise en main nécessaire

Les résultats suggèrent en outre que les travailleurs d’AMT ne peuvent pas de manière fiable distinguer entre le texte rédigé par un humain et le texte rédigé par une machine, à moins qu’ils ne voient les deux textes côte à côte, ce qui compromettrait effectivement un scénario d’évaluation typique (où le lecteur devrait être en mesure de porter un jugement sur un seul échantillon de texte, « réel » ou généré artificiellement).

Acceptation décontractée de texte artificiel de mauvaise qualité

Les travailleurs d’AMT ont systématiquement évalué le texte artificiel de mauvaise qualité basé sur GPT à égalité avec du texte de meilleure qualité, cohérent, rédigé par des humains, contrairement aux enseignants d’anglais, qui ont pu facilement distinguer la différence de qualité.

Pas de temps de préparation, zéro contexte

Entrer dans l’état d’esprit approprié pour une tâche abstraite telle que l’évaluation de l’authenticité ne vient pas naturellement ; les enseignants d’anglais ont nécessité 20 tâches pour calibrer leur sensibilité à l’environnement d’évaluation, tandis que les travailleurs d’AMT n’ont généralement aucune « période d’orientation » du tout, ce qui réduit la qualité de leur saisie.

Jeu du système

Le rapport soutient que le temps total que les travailleurs d’AMT passent sur des tâches individuelles est gonflé par les travailleurs qui acceptent plusieurs tâches simultanément et parcourent les tâches dans différents onglets de leur navigateur, au lieu de se concentrer sur une tâche pour la durée de la tâche enregistrée.

Pays d’origine important

Les paramètres par défaut d’AMT ne filtrent pas les travailleurs par pays d’origine, et le rapport note des travaux précédents indiquant que les travailleurs d’AMT utilisent des VPN pour contourner les restrictions géographiques, permettant aux non-locuteurs natifs de se présenter comme des locuteurs natifs anglais (dans un système qui, peut-être de manière plutôt naïve, équivaut la langue maternelle d’un travailleur à son emplacement géographique basé sur l’IP).

Ainsi, les chercheurs ont réexécuté les tests d’évaluation sur AMT avec des filtres limitant les preneurs potentiels à des non-pays anglophones, constatant que ‘les travailleurs de non-pays anglophones ont évalué la cohérence, la pertinence et la grammaire… nettement plus bas que les travailleurs identiquement qualifiés de pays anglophones’.

Le rapport conclut :

‘[Expert] évaluateurs tels que des linguistes ou des enseignants de langues devraient être utilisés chaque fois que possible car ils ont déjà été formés pour évaluer le texte écrit, et ce n’est pas beaucoup plus cher…’

Publié le 16 septembre 2021 – Mis à jour le 18 décembre 2021 : Ajout de balises