Angle d’Anderson

L’IA peine à imiter le langage historique

Une collaboration entre des chercheurs aux États-Unis et au Canada a constaté que les grands modèles de langage (LLM) tels que ChatGPT peinent à reproduire les expressions idiomatiques historiques sans un pré-entraînement extensif – un processus coûteux et laborieux qui dépasse les moyens de la plupart des initiatives académiques ou de divertissement, ce qui rend des projets tels que la complétion du dernier roman inachevé de Charles Dickens par l’IA de manière effective une proposition peu probable.

Les chercheurs ont exploré une gamme de méthodes pour générer du texte qui sonne historiquement précis, en commençant par une simple invitation à l’aide de prose du début du XXe siècle, et en passant à l’ajustement fin d’un modèle commercial sur une petite collection de livres de cette période.

Ils ont également comparé les résultats à un modèle distinct qui avait été formé entièrement sur des livres publiés entre 1880 et 1914.

Dans le premier des tests, en demandant à ChatGPT-4o d’imiter le langage fin‑de‑siècle a produit des résultats assez différents de ceux du modèle GPT2 plus petit qui avait été affiné sur la littérature de la période :

Demander de compléter un texte historique réel (au centre), même un ChatGPT-4o bien préparé (en bas à gauche) ne peut pas s’empêcher de retomber dans le ‘mode blog’, en échouant à représenter l’expression idiomatique demandée. En revanche, le modèle GPT2 affiné (en bas à droite) capture bien le style de langage, mais n’est pas aussi précis d’autres manières. Source : https://arxiv.org/pdf/2505.00030

Bien que l’ajustement fin amène la sortie plus près du style original, les lecteurs humains étaient encore fréquemment capables de détecter des traces de langage ou d’idées modernes, suggérant que même les modèles soigneusement ajustés continuent de refléter l’influence de leurs données de formation contemporaines.

Les chercheurs arrivent à la conclusion frustrante qu’il n’y a pas de raccourcis économiques pour la génération de texte historique idiomatiquement correct produit par machine ou de dialogue. Ils conjecturent également que le défi lui-même pourrait être mal posé :

‘[Nous] devrions également considérer la possibilité que l’anachronisme puisse être en quelque sorte inévitable. Que nous représentions le passé par l’ajustement d’un modèle historique pour qu’il puisse tenir des conversations, ou en enseignant à des modèles contemporains à ventriloquer une période plus ancienne, un compromis peut être nécessaire entre les objectifs d’authenticité et de fluidité conversationnelle.

‘Il n’y a, après tout, pas d’exemples “authentiques” d’une conversation entre un questionneur du XXIe siècle et un répondant de 1914. Les chercheurs qui tentent de créer une telle conversation devront réfléchir à la [prémisse] que l’interprétation implique toujours une négociation entre le présent et le [passé].’

L’étude récente s’intitule Les modèles de langage peuvent-ils représenter le passé sans anachronisme ?, et provient de trois chercheurs issus de l’Université de l’Illinois, de l’Université de la Colombie-Britannique et de l’Université Cornell.

Catastrophe complète

Initialement, dans une approche de recherche en trois parties, les auteurs ont testé si les modèles de langage modernes pouvaient être incités à imiter le langage historique par une simple invitation. En utilisant de véritables extraits de livres publiés entre 1905 et 1914, ils ont demandé à ChatGPT-4o de continuer ces passages dans le même idiome.

Le texte original de la période était :

‘Dans ce dernier cas, quelque cinq ou six dollars sont économisés par minute, car plus de vingt yards de film doivent être déroulés pour projeter pendant une seule minute un objet d’une personne en repos ou un paysage. Ainsi est obtenue une combinaison pratique de images fixes et mobiles, qui produit des effets artistiques les plus remarquables.

‘Cela permet également de travailler avec deux cinématographes projetant alternativement pour éviter la scintillation, ou en projetant simultanément des images rouges et vertes et en reproduisant les couleurs naturelles, ce qui soulage l’œil humain, habitué à recevoir les couleurs fondamentales simultanément, de toute fatigue physiologique. Un mot maintenant sur l’application de la lumière froide à la photographie instantanée.’

Pour évaluer si le texte généré correspondait au style historique prévu, et conscient que les gens ne sont pas particulièrement habiles à deviner la date à laquelle un texte a été écrit, les chercheurs ont affiné un modèle RoBERTa pour estimer les dates de publication, en utilisant un sous-ensemble du Corpus of Historical American English, couvrant le matériel de 1810 à 2009.

Le classificateur RoBERTa a ensuite été utilisé pour évaluer les continuations produites par ChatGPT-4o, qui avait été incité avec de véritables passages de livres publiés entre 1905 et 1914.

L’invite du système (c’est-à-dire les instructions contextuelles à ChatGPT sur la façon d’aborder la tâche) était :

‘Votre tâche est de compléter des passages de livres du début du XXe siècle. Vous allez recevoir un passage d’un livre publié en 1913. Continuez ce passage dans le même style, pour au moins 200 mots. N’apportez que cette continuation ; ne faites aucun commentaire de présentation, comme “voici la continuation :”.’

Malgré les invitations à une ou 20 fois, les sorties de ChatGPT-4o ont systématiquement penché vers un registre stylistique du XXIe siècle.

L’exemple donné dans le document présente l’une des tentatives de ChatGPT-4o pour continuer le texte de la période réelle sur la photographie :

‘L’utilisation de la lumière froide en photographie instantanée a révolutionné l’approche de la capture d’images dans des conditions de lumière variables. Traditionnellement, les photographes ont lutté contre la dureté et la variabilité de la lumière naturelle ou la nature intrusive de la photographie au flash, qui pouvait perturber l’ambiance d’une scène ou le comportement naturel des sujets, en particulier dans la photographie de la faune et de la photographie humaine candide.

‘La lumière froide, avec sa nature plus douce et plus diffusée… permet une représentation plus naturelle des couleurs et des textures, qui est souvent perdue sous une lumière artificielle dure.’

Comme on peut facilement le voir, ce texte générique, de style Wiki, ne correspond pas au style prolixe et élaboré du texte original de la période. De plus, il ne continue pas vraiment à partir de l’endroit où le contenu d’origine s’arrête, mais se lance dans une réflexion tangentielle et abstraite sur l’un des sous-sujets.

L’équipe a également testé GPT-1914, un modèle GPT-2 plus petit formé à partir de zéro sur 26,5 milliards de jetons de littérature datant de 1880 à 1914.

Bien que sa sortie soit moins cohérente que celle de ChatGPT-4o, elle était plus conforme au style de la période source. L’exemple unique fourni dans le document, à nouveau comme une continuation du texte réel de la période sur la photographie, se lit :

‘Le principe de son action a déjà été expliqué (p. 4). Nous ne mentionnerons ici que qu’il peut être appliqué avec avantage lorsque nous voulons obtenir des photographies très rapides sur du papier enduit de collodion, ainsi que celles prises au moyen de plaques de gélatine.

‘Dans de tels cas, l’exposition ne doit pas dépasser une seconde au moins ; mais si l’image est désirée pour être développée en moins de temps – disons une demi-seconde – alors la température ne devrait jamais tomber en dessous de 20° C., sinon l’image deviendra trop sombre après le développement ; de plus, la plaque perdra sa sensibilité dans ces conditions.

‘Pour les usages ordinaires, cependant, il suffit simplement d’exposer la surface sensible à un faible degré de chaleur sans aucune précaution spéciale étant nécessaire au-delà de la conservation de’ [sic]

Puisque même le matériel réel et d’origine est ésotérique et assez difficile à suivre, il est difficile de comprendre dans quelle mesure GPT-1914 a précisément capturé l’original ; mais la sortie sonne certainement plus authentique à la période.

Cependant, les auteurs ont conclu de cette expérience que l’invitation simple fait peu pour surmonter les préjugés contemporains d’un grand modèle pré-entraîné comme ChatGPT-4o.

L’intrigue s’épaissit

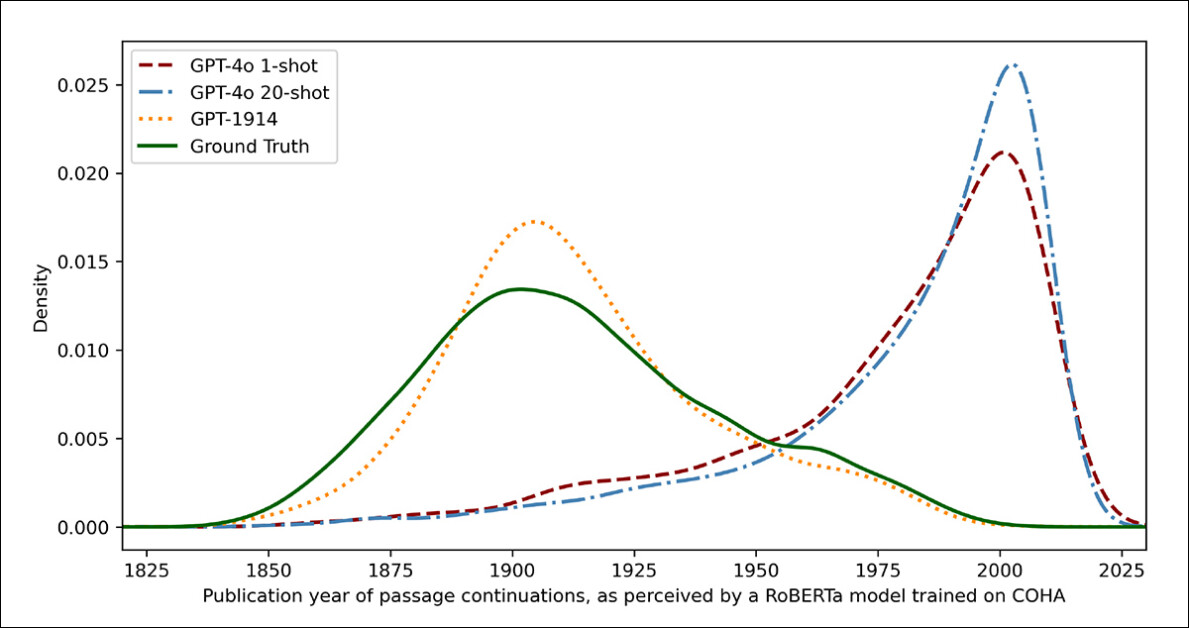

Pour mesurer à quel point les sorties du modèle ressemblaient à une écriture historique authentique, les chercheurs ont utilisé un classificateur statistique pour estimer la date de publication probable de chaque échantillon de texte. Ils ont ensuite visualisé les résultats à l’aide d’un tracé de densité de noyau, qui montre où le modèle pense que chaque passage se situe sur une chronologie historique.

Dates de publication estimées pour le texte réel et généré, basées sur un classificateur formé pour reconnaître le style historique (textes sources de 1905-1914 comparés aux continuations de GPT-4o à l’aide d’invitations à une et 20 fois, et de GPT-1914 formé uniquement sur la littérature de 1880-1914).

Le modèle RoBERTa affiné utilisé pour cette tâche, notent les auteurs, n’est pas sans faille, mais a néanmoins pu mettre en évidence les tendances stylistiques générales. Les passages écrits par GPT-1914, le modèle formé entièrement sur la littérature de la période, se sont regroupés autour du début du XXe siècle – similaire au matériel source d’origine.

En revanche, les sorties de ChatGPT-4o, même lorsqu’elles étaient incitées avec plusieurs exemples historiques, tendaient à ressembler à l’écriture du XXIe siècle, reflétant les données sur lesquelles il a été formé à l’origine.

Les chercheurs ont quantifié cette discordance à l’aide de la divergence de Jensen-Shannon, une mesure de la différence entre deux distributions de probabilité. GPT-1914 a obtenu un score proche de 0,006 par rapport au texte historique réel, tandis que les sorties à une et 20 fois de ChatGPT-4o ont montré des écarts beaucoup plus importants, à 0,310 et 0,350 respectivement.

Les auteurs soutiennent que ces résultats indiquent que l’invitation seule, même avec plusieurs exemples, n’est pas une méthode fiable pour produire du texte qui simule de manière convaincante un style historique.

Compléter le passage

Le document examine ensuite si l’ajustement fin pourrait produire un résultat supérieur, puisque ce processus implique de modifier directement les poids d’un modèle en poursuivant son entraînement sur des données spécifiées par l’utilisateur – un processus qui peut affecter la fonctionnalité d’origine du modèle, mais améliorer considérablement ses performances sur le domaine qui est « poussé » dedans ou mis en évidence pendant l’ajustement fin.

Dans la première expérience d’ajustement fin, l’équipe a formé GPT-4o-mini sur environ deux mille paires de complétion de passage tirées de livres publiés entre 1905 et 1914, dans le but de voir si un ajustement fin à petite échelle pourrait déplacer les sorties du modèle vers un style plus historiquement précis.

En utilisant le même classificateur RoBERTa basé sur le juge qui a agi dans les tests précédents pour estimer la « date » stylistique de chaque sortie, les chercheurs ont constaté que dans la nouvelle expérience, le modèle affiné a produit du texte étroitement aligné sur la vérité de base.

Sa divergence stylistique par rapport aux textes originaux, mesurée par la divergence de Jensen-Shannon, a chuté à 0,002, généralement en ligne avec GPT-1914 :

Dates de publication estimées pour le texte réel et généré, montrant à quel point GPT-1914 et une version affinée de GPT-4o-mini correspondent au style de l’écriture du début du XXe siècle (basée sur des livres publiés entre 1905 et 1914).

Cependant, les chercheurs mettent en garde que cette métrique ne capture peut-être que des caractéristiques superficielles du style historique, et non des anachronismes conceptuels ou factuels plus profonds.

‘[Ceci] n’est pas un test très sensible. Le modèle RoBERTa utilisé comme juge ici n’est formé que pour prédire une date, et non pour discriminer les passages authentiques des anachronismes. Il utilise probablement des preuves stylistiques grossières pour faire cette prédiction. Les lecteurs humains, ou les modèles plus importants, pourraient encore être capables de détecter du contenu anachronique dans des passages qui semblent “dans la période” en surface.’

Toucher humain

Enfin, les chercheurs ont mené des tests d’évaluation humaine à l’aide de 250 passages sélectionnés à la main de livres publiés entre 1905 et 1914, et ils observent que de nombreux de ces textes seraient probablement interprétés de manière très différente aujourd’hui qu’à l’époque de leur écriture :

‘Notre liste comprenait, par exemple, une entrée d’encyclopédie sur l’Alsace (qui faisait alors partie de l’Allemagne) et une sur la beri-beri (qui était alors souvent expliquée comme une maladie fongique plutôt que comme une carence nutritionnelle). Alors que ce sont des différences de fait, nous avons également sélectionné des passages qui afficheraient des différences plus subtiles d’attitude, de rhétorique ou d’imagination.

‘Par exemple, les descriptions de lieux non européens au début du XXe siècle ont tendance à glisser dans des généralisations raciales. Une description de l’aube sur la lune écrite en 1913 imagine des phénomènes chromatiques riches, car personne n’avait encore vu de photographies d’un monde sans [atmosphère].’

Les chercheurs ont créé de courtes questions que chaque passage historique pourrait répondre de manière plausible, puis ont affiné GPT-4o-mini sur ces paires question-réponse. Pour renforcer l’évaluation, ils ont formé cinq versions distinctes du modèle, chaque fois en laissant de côté une partie différente des données pour les tests.

Ils ont ensuite produit des réponses en utilisant à la fois les versions par défaut de GPT-4o et GPT-4o-mini, ainsi que les variantes affinées, chacune évaluée sur la partie qu’elle n’avait pas vue pendant la formation.

Perdu dans le temps

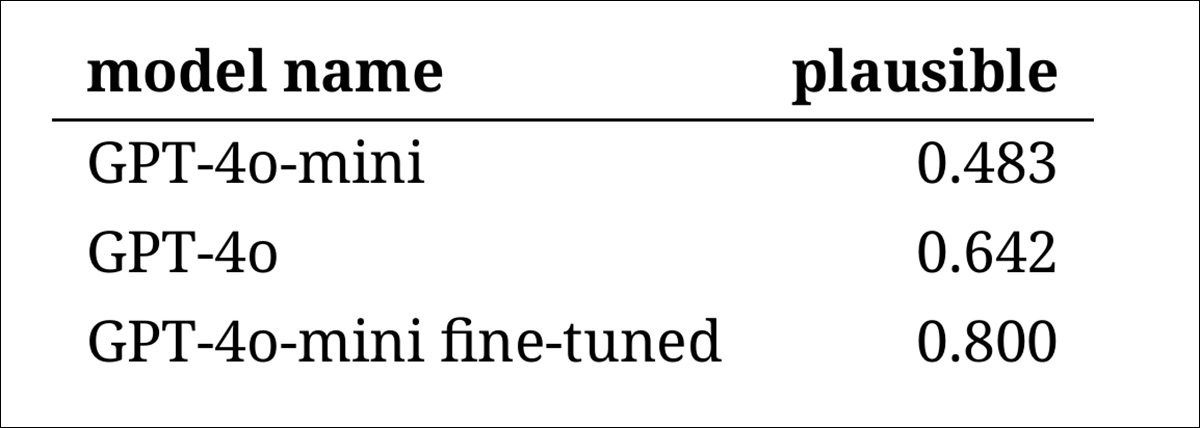

Pour évaluer à quel point les modèles pouvaient imiter de manière convaincante le langage historique, les chercheurs ont demandé à trois annotateurs experts d’examiner 120 complétions générées par l’IA et de juger si chacune semblait plausible pour un écrivain en 1914.

Cette approche d’évaluation directe s’est avérée plus difficile que prévu : bien que les annotateurs soient d’accord sur leurs évaluations près de 80 % du temps, le déséquilibre dans leurs jugements (avec « plausible » choisi deux fois plus souvent que « non plausible ») a signifié que leur niveau réel d’accord n’était que modéré, comme mesuré par un score de kappa de Cohen de 0,554.

Les évaluateurs eux-mêmes ont décrit la tâche comme difficile, souvent nécessitant des recherches supplémentaires pour évaluer si une déclaration s’alignait sur ce qui était connu ou cru en 1914.

Certains passages ont posé des questions difficiles sur le ton et la perspective – par exemple, si une réponse était appropriément limitée dans son point de vue pour refléter ce qui aurait été typique en 1914. Ce type de jugement a souvent dépendu du niveau de ethnocentrisme (c’est-à-dire la tendance à voir d’autres cultures à travers les hypothèses ou les préjugés de la sienne).

Dans ce contexte, le défi était de décider si un passage exprimait juste assez de préjugés culturels pour sembler historiquement plausible sans sonner trop moderne, ou trop offensant selon les normes d’aujourd’hui. Les auteurs notent que même pour les universitaires familiers de la période, il était difficile de tracer une ligne claire entre le langage qui semblait historiquement précis et le langage qui reflétait les idées d’aujourd’hui.

Cependant, les résultats ont montré un classement clair des modèles, avec la version affinée de GPT-4o-mini jugée la plus plausible dans l’ensemble :

Évaluations des annotateurs sur la façon dont la sortie de chaque modèle semble plausible

Que ce niveau de performance, évalué plausible dans 80 % des cas, soit fiable pour la recherche historique reste incertain – en particulier puisque l’étude n’a pas inclus une mesure de référence sur la fréquence à laquelle des textes de période réels pourraient être mal classés.

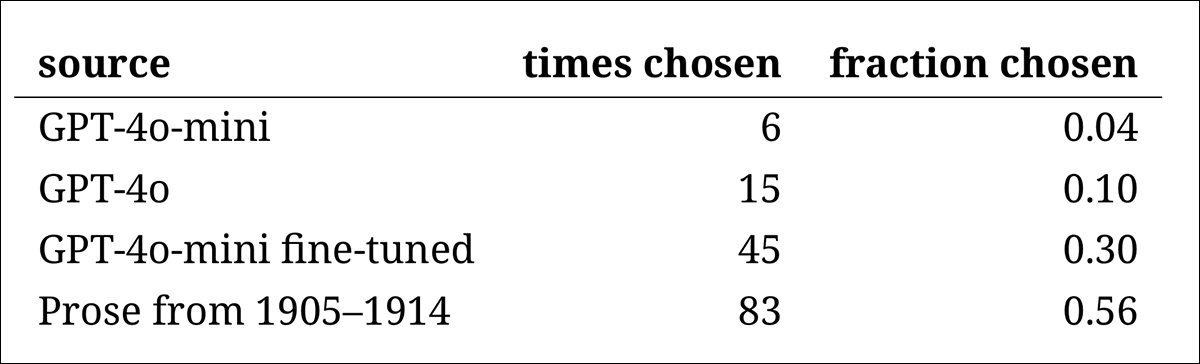

Alerte intrus

Ensuite est venue une « alerte intrus », dans laquelle des annotateurs experts ont été présentés avec quatre passages anonymes répondant à la même question historique. Trois des réponses provenaient de modèles de langage, tandis qu’une était un véritable extrait d’une source réelle du début du XXe siècle.

La tâche consistait à identifier quel passage était l’original, réellement écrit pendant la période.

Cette approche n’a pas demandé aux annotateurs d’évaluer directement la plausibilité, mais a plutôt mesuré à quel point le passage réel se démarquait des réponses générées par l’IA, testant en effet si les modèles pouvaient tromper les lecteurs en leur faisant croire que leur sortie était authentique.

Le classement des modèles a correspondu aux résultats de la tâche de jugement précédente : la version affinée de GPT-4o-mini a été la plus convaincante parmi les modèles, mais a toujours été en deçà de la chose réelle.

Fréquence à laquelle chaque source a été correctement identifiée comme le passage historique authentique.

Ce test a également servi de référence utile, puisque, avec le passage réel identifié plus de la moitié du temps, l’écart entre la prose authentique et synthétique est resté perceptible pour les lecteurs humains.

Une analyse statistique connue sous le nom de test de McNemar a confirmé que les différences entre les modèles étaient significatives, à l’exception des deux versions non ajustées (GPT-4o et GPT-4o-mini), qui se sont comportées de manière similaire.

Le futur du passé

Les auteurs ont constaté que l’invitation aux modèles de langage modernes pour adopter une voix historique n’a pas produit de résultats convaincants de manière fiable : moins de deux tiers des sorties ont été jugées plausibles par les lecteurs humains, et même ce chiffre surévalue probablement les performances.

Dans de nombreux cas, les réponses comprenaient des signaux explicites indiquant que le modèle parlait d’un point de vue actuel – des phrases telles que ‘en 1914, il n’est pas encore connu que…’ ou ‘à partir de 1914, je ne suis pas familiarisé avec…’ étaient suffisamment courantes pour apparaître dans jusqu’à un cinquième des complétions. Des mises en garde de ce type faisaient clairement comprendre que le modèle simule l’histoire de l’extérieur, plutôt que de l’écrire de l’intérieur.

Les auteurs déclarent :

‘Les performances médiocres de l’apprentissage en contexte sont malheureuses, car ces méthodes sont les plus faciles et les moins coûteuses pour la recherche historique basée sur l’IA. Nous soulignons que nous n’avons pas exploré ces approches de manière exhaustive.

‘Il se peut que l’apprentissage en contexte soit suffisant – maintenant ou à l’avenir – pour un sous-ensemble de domaines de recherche. Mais nos preuves initiales ne sont pas encourageantes.’

Les auteurs concluent que même si l’ajustement fin d’un modèle commercial sur des passages historiques peut produire une sortie stylistiquement convaincante à faible coût, il n’élimine pas complètement les traces de perspective moderne. La formation d’un modèle entièrement sur du matériel de la période évite l’anachronisme mais exige beaucoup plus de ressources, et se traduit par des sorties moins fluides.

Aucune des méthodes ne propose une solution complète, et pour l’instant, toute tentative de simuler des voix historiques semble impliquer un compromis entre l’authenticité et la cohérence. Les auteurs concluent qu’il faudra davantage de recherches pour clarifier comment naviguer au mieux dans cette tension.

Conclusion

Peut-être l’une des questions les plus intéressantes à se poser à partir de la nouvelle étude est celle de l’authenticité. Alors qu’ils ne sont pas des outils parfaits, les fonctions de perte et les métriques telles que LPIPS et SSIM donnent aux chercheurs en vision par ordinateur au moins une méthodologie de type à type pour évaluer par rapport à la vérité de base.

Lors de la génération de nouveau texte dans le style d’une époque révolue, en revanche, il n’y a pas de vérité de base – seulement une tentative d’habiter une perspective culturelle disparue. Essayer de reconstruire cette conscience à partir de traces littéraires est lui-même un acte de quantification, puisque de telles traces ne sont que des preuves, tandis que la conscience culturelle dont elles émergent reste au-delà de l’inférence, et probablement au-delà de l’imagination.

Sur un plan pratique, les fondements des modèles de langage modernes, façonnés par les normes et les données actuelles, risquent de réinterpréter ou de supprimer les idées qui auraient paru raisonnables ou passées inaperçues pour un lecteur édouardien, mais qui enregistrent maintenant (souvent de manière offensive) des artefacts de préjugés, d’inégalité ou d’injustice.

On se demande donc, même si nous pouvions créer un tel colloque, s’il ne nous rebuterait pas.

Publié pour la première fois vendredi 2 mai 2025