Etiikka

Tekoälytapahtumatietokannan tavoitteena on tehdä tekoälyalgoritmeista turvallisempia

Kaikissa riittävän suurissa järjestelmissä on virheitä, ja osa näiden virheiden korjaamista on tietokanta niistä, josta voidaan analysoida vaikutukset ja mahdolliset syyt. Aivan kuten FDA ylläpitää tietokantaa haittavaikutuksista tai National Transportation Safety Board ylläpitää tietokantaa lentoonnettomuuksista, tekoälyn tapaustietokanta on tietokanta tarkoituksena on luetteloida tekoälyjärjestelmien vikoja ja auttaa tekoälytutkijoita suunnittelemaan uusia menetelmiä näiden vikojen välttämiseksi. Tekoälytapahtumatietokannan (AIID) luojat toivovat, että se auttaa tekoälyyrityksiä kehittämään turvallisempaa ja eettisempää tekoälyä.

Mikä on AIID?

AIID on Partnership on AI (PAI) -organisaation tuote. PAI:n perustivat alun perin vuonna 2016 suurten teknologiayritysten, kuten Facebookin, Applen, Amazonin, Googlen, IBM:n ja Microsoftin, tekoälytutkimusryhmien jäsenet. Sittemmin organisaatio on rekrytoinut jäseniä monista muista organisaatioista, mukaan lukien useista voittoa tavoittelemattomista järjestöistä. Vuonna 2018 PAI päätti luoda yhtenäisen luokittelustandardin tekoälyvirheille. Ei kuitenkaan ollut kokoelma tekoälytapauksia, joiden perusteella tämä luokittelu olisi voitu perustaa. Tästä syystä PAI loi AIID:n.

TechTalksin mukaanAIID:n muoto selvisi Liikenneturvallisuuslautakunnan ylläpitämän lentoonnettomuuksien tietokannan rakenteesta. Siitä lähtien, kun ilmoituksia alettiin kerätä vuonna 1996, kaupallinen lentomatkustusjärjestelmä on onnistunut lisäämään ilmailualan turvallisuutta arkistoinnin ja poikkeamien analysoinnin avulla. Toiveena on, että samanlainen tekoälytapausten arkisto voi tehdä tekoälyjärjestelmistä turvallisempia, eettisempiä ja luotettavampia. AIID otti inspiraationsa myös Common Vulnerabilities and Exposures -tietokannasta, joka on tietokanta merkittävistä ohjelmistovioista, jotka kattavat useita eri toimialoja ja tieteenaloja.

Sean McGregor on IBM:n Watson AI XPRIZEn johtava tekninen konsultti. McGregor vastaa myös AIID:n varsinaisen tietokannan kehittämisen valvonnasta. McGregor selitti, että AIID:n tavoitteena on viime kädessä estää tekoälyjärjestelmiä aiheuttamasta haittaa tai ainakin vähentää haittatapahtumien vakavuutta. Kuten McGregor totesi, koneoppimisjärjestelmät ovat huomattavasti monimutkaisempia ja arvaamattomampia kuin perinteiset ohjelmistojärjestelmät, ja sen seurauksena niitä ei voida testata samalla tavalla kuin muita ohjelmistoja. Koneoppimisjärjestelmät voivat muuttaa käyttäytymistään odottamattomilla tavoilla. McGregor huomauttaa, että syväoppimisjärjestelmien kyky oppia voi tarkoittaa, että "häiriöt ovat todennäköisempiä, monimutkaisempia ja vaarallisempia", kun ne tulevat jäsentymättömään maailmaan.

Yli 1,000 tekoälyyn liittyvää tapausta kirjattu

AIID:n alunperin luomisesta lähtien tietokantaan on kirjautunut yli 1,000 XNUMX tekoälyyn liittyvää tapausta. Kaikista tietokannan tapauksista yleisin haittatapahtumien tyyppi oli tekoälyn oikeudenmukaisuuteen liittyvät ongelmat. Monet näistä oikeudenmukaisuustapauksista liittyvät valtion virastojen kasvojentunnistusalgoritmien käyttöön. McGregor huomauttaa myös, että tietokantaan lisätään yhä enemmän robotiikkaan liittyviä tapauksia.

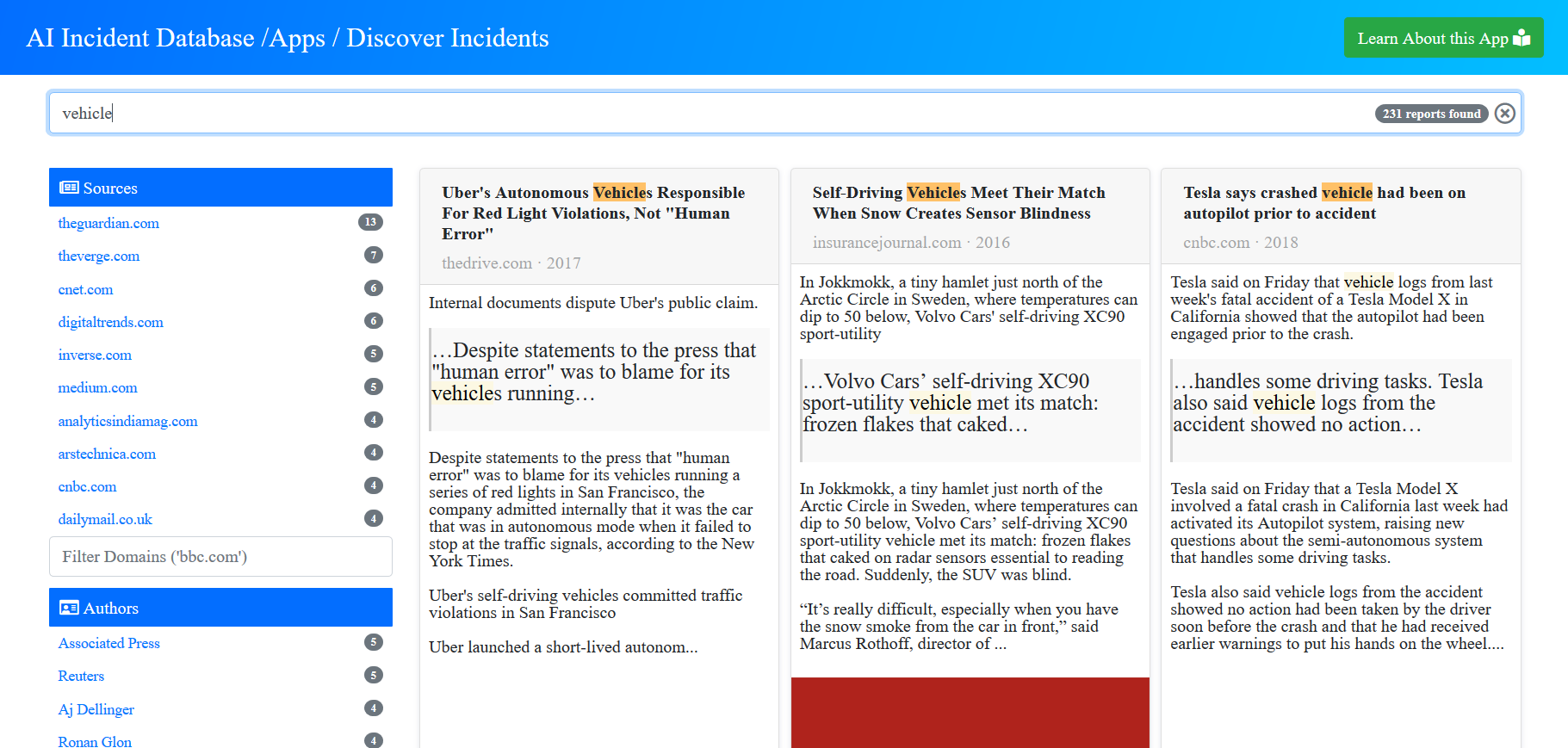

Tietokannan vierailijat voivat suorittaa kyselyitä ja etsiä tietokannasta tapauksia esimerkiksi avainsanojen, tapahtumatunnuksen, lähteen tai tekijän perusteella. Esimerkiksi haun "Deepfake" suorittaminen palauttaa 7 raporttia, kun taas haku "robotit" palauttaa 158 raporttia.

Keskitetty tietokanta tekoälyn toimintahäiriöistä ja odottamattomilla tavoilla tapahtuvista tapauksista voi auttaa tutkijoita, insinöörejä ja etiikkaa valvomaan tekoälyjärjestelmien kehitystä ja käyttöönottoa. Teknologiayritysten tuotepäälliköt voivat käyttää AIID:tä nähdäkseen mahdollisia ongelmia ennen tekoälysuositusjärjestelmien käyttöönottoa, tai tekoälyinsinööri voisi saada käsityksen mahdollisista harhoista, jotka on korjattava tekoälysovellusta luotaessa. Samoin riskipäälliköt voisivat käyttää tietokantaa määrittääkseen tekoälymalliin liittyvät mahdolliset negatiiviset sivuvaikutukset, jotta he voivat suunnitella etukäteen ja kehittää toimenpiteitä mahdollisten haittojen lieventämiseksi.

AIID:n taustalla olevan arkkitehtuurin on tarkoitus olla joustava, koska se mahdollistaa uusien työkalujen luomisen tietokannan kyselyihin ja merkityksellisten oivallusten poimimiseen. Tekoälyn kumppanuus ja McGregor tekevät yhteistyötä suunnitellakseen joustavan taksonomian, jota voidaan käyttää kaikenlaisten tekoälytapausten luokitteluun. Tiimi toivoo, että kun joustava taksonomia on luotu, se voidaan yhdistää automaattiseen järjestelmään, joka kirjaa automaattisesti tekoälytapaukset.

"Tekoälyyhteisö on alkanut jakaa tapahtumatietoja keskenään motivoidakseen muutoksia tuotteisiinsa, valvontamenetelmiinsä ja tutkimusohjelmiinsa." McGregor selitti TechTalksin kautta. "Sivusto julkaistiin julkisesti marraskuussa, joten olemme vasta alkamassa ymmärtää järjestelmän etuja."