Tekoäly

Meidän alitajuiset deepfake-havaitsemistaidot voivat mahdollistaa tulevaisuuden automaattiset järjestelmät

Uusi tutkimus Australiasta suggeroi, että aivomme on taitava tunnistamaan monimutkaiset deepfakes, jopa silloin, kun uskomme tietoisesti, että näkemämme kuvat ovat aitoja.

Tutkimuksen tulokset viittaavat siihen, että ihmisten hermostonvasteita voidaan käyttää koulutusaineistona automaattisille deepfake-havaitsemisjärjestelmille. Tällaiset järjestelmät voivat olla koulutettu kuvien deepfake-ominaisuuksilla, eikä niiden uskottavuuden arvioinnilla, joka perustuu hämmennyksiin.

‘[A]lthough the brain can ‘recognise’ the difference between real and realistic faces, observers cannot consciously tell them apart. Our findings of the dissociation between brain response and behaviour have implications for how we study fake face perception, the questions we pose when asking about fake image identification, and the possible ways in which we can establish protective standards against fake image misuse.’

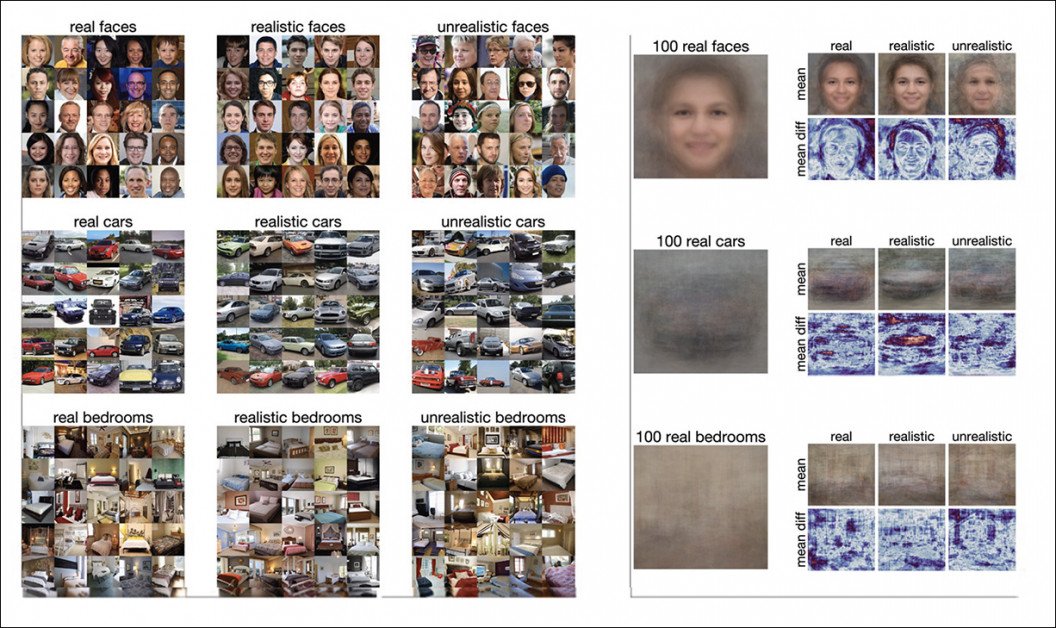

Tulokset saatiin testien kierroksista, jotka suunniteltiin arvioimaan, miten ihmiset reagoivat väärään kuvamateriaaliin, mukaan lukien kuvat, jotka esittävät selvästi väärennettyjä kasvoja, autoja, sisätiloja ja ylösalaisin käännettyjä kasvoja.

Various iterations and approaches for the experiments, which involved two groups of test subjects needing to classify a briefly-shown image as ‘fake’ or ‘real’. The first round took place on Amazon Mechanical Turk, with 200 volunteers, while the second round involved a smaller number of volunteers responding to the tests while hooked up to EEG machines. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

Tutkimusraportti toteaa:

‘Our results demonstrate that given only a brief glimpse, observers may be able to spot fake faces. However, they have a harder time discerning real faces from fake faces and, in some instances, believed fake faces to be more real than real faces.

‘However, using time-resolved EEG and multivariate pattern classification methods, we found that it was possible to decode both unrealistic and realistic faces from real faces using brain activity.

‘This dissociation between behaviour and neural responses for realistic faces yields important new evidence about fake face perception as well as implications involving the increasingly realistic class of GAN-generated faces.’

Tutkimus ehdottaa, että uusi työ voi olla sovellettavissa soveltuneeseen kyberTurvallisuuteen, ja että deepfake-oppimisen luokittelijoiden kehitystä tulisi ajaa alitajuisilla vasteilla, mitattuna EEG-lukemilla vastauksena väärennetyille kuville, eikä katsojan tietoisen arvion mukaan kuvan totuudenmukaisuudesta.

Tutkijat kommentoivat*:

‘This is reminiscent of findings that individuals with prosopagnosia who cannot behaviourally classify or recognise faces as familiar or unfamiliar nevertheless display stronger autonomic responses to familiar faces than unfamiliar faces.

‘Similarly, what we have shown in this study is that whilst we could accurately decode the difference between real and realistic faces from neural activity, that difference was not seen behaviourally. Instead, observers incorrectly identified 69% of the real faces as being fake.’

Uusi tutkimus on nimeltään Are you for real? Decoding realistic AI-generated faces from neural activity, ja se on tehty neljän tutkijan toimesta University of Sydneyssä, Macquarie Universityssä, Western Sydney Universityssä ja The University of Queenslandissa.

Data

Tulokset saatiin laajemmasta tutkimuksesta, jossa arvioitiin ihmisten kykyä erottaa toisistaan selvästi väärennettyjä, hyperrealistisia (mutta silti väärennettyjä) ja aitoja kuvia.

Tutkijat käyttivät kuvia, jotka oli luotu Generative Adversarial Networks (GANs) -menetelmällä, ja jotka NVIDIA oli jakanut.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Aineisto koostui 25 kasvoista, autoista ja makuuhuoneista, ja niiden renderöinti vaihteli “epärealistisesta” “realistiseen”. Kasvojen vertailuun (eli sopivan ei-väärennetyn aineiston) tutkijat käyttivät NVIDIA:n Flickr-Faces-HQ (FFHQ) -aineiston dataset:ia. Muiden skenaarioiden vertailuun he käyttivät LSUN-dataset:ia.

Kuvat esitettiin koehenkilölle joko oikein päin tai ylösalaisin, ja niiden taajuus vaihteli. Kaikki kuvat oli muunnettu 256×256 pikselin kokoon.

Kun kaikki aineisto oli koottu, 450 stimulaatiokuvaa valittiin testeihin.

Tests

Testit tehtiin aluksi verkossa, jsPsych:n avulla pavlovia.org:ssa, ja 200 osanottaista arvioi eri alijoukkoja kokoelmaan kuuluvasta testidatasta. Kuvat esitettiin 200 ms:n ajan, ja niiden jälkeen näytettiin tyhjä ruutu, joka pysyi näkyvissä, kunnes katsoja teki päätöksen siitä, oliko vilautettu kuva “väärennetty” vai “aito”. Kukin kuva esitettiin vain kerran, ja koko testi kesti 3-5 minuuttia.

Toinen, paljastavampi kierros käytti paikan päällä olevia koehenkilöitä, jotka oli kytketty EEG-laitteisiin, ja se esitettiin Psychopy2-alustalla. Jokainen 20:stä sekvenssistä sisälsi 40 kuvaa, ja 18 000 kuvaa esitettiin koko testidatan aikana.

Kerätty EEG-data dekoodattiin MATLAB:lla CoSMoMVPA-työkalupakilla, käyttäen leave-one-out-cross-validation-schemaa Lineaarisella DiskriminanttiAnalyysillä (LDA).

LDA-luokittelija oli komponentti, joka pystyi tekemään eron aivojen reaktion ja koehenkilön omien mielipiteiden välillä siitä, oliko kuva väärennetty.

Results

Tutkijat olivat kiinnostuneita siitä, voivatko EEG-testin koehenkilöt erottaa aitoja ja väärennettyjä kasvoja, ja he aggregoivat ja prosessoivat tulokset. He löysivät, että osanottajat pystyivät helposti erottamaan aitoja ja epärealistisia kasvoja, mutta näyttivät kamppailevan realististen, GAN:lla luotujen väärennettyjen kasvojen tunnistamisessa. Se, oliko kuva ylösalaisin, näytti tekevän vain vähän eroa.

Behavioral discrimination of real and synthetically-generated faces, in the second round.

Kuitenkin EEG-data kertoi toisenlaisen tarinan.

Raportti toteaa:

‘Although observers had trouble distinguishing real from fake faces and tended to overclassify fake faces, the EEG data contained signal information relevant to this distinction which meaningfully differed between realistic and unrealistic, and this signal appeared to be constrained to a relatively short stage of processing.’

Here the disparity between EEG accuracy and the reported opinion of the subjects (i.e. as to whether or not the face images were fake) are not identical, with the EEG captures getting nearer to the truth than the manifest perception of the people involved.

Tutkijat päättelevät, että vaikka havainnoitsijat voivat käydä vaikeuksissa tunnistamaan väärennettyjä kasvoja, nämä kasvot ovat “erityisiä edustajia ihmisen visuaalisessa järjestelmässä”.

Tutkijat spekuloi, että heidän tuloksensa voivat olla sovellettavissa tulevaisuuden turvallisuusmekanismeihin:

‘In an applied setting such as cyber security or Deepfakes, examining the detection ability for realistic faces might be best pursued using machine learning classifiers applied to neuroimaging data rather than targeting behavioural performance.’

He päättelevät:

‘Understanding the dissociation between brain and behaviour for fake face detection will have practical implications for the way we tackle the potentially detrimental and universal spread of artificially generated information.’

* Minun muunnokseni sisäisiin viitteisiin hyperlinkeiksi.

Julkaistu ensimmäisen kerran 11. heinäkuuta 2022.