Kyberturvallisuus

Antropinen paljastaa ensimmäisen suuren mittakaavan kyberhyökkäyksen, jota ohjataan AI-automatiolla

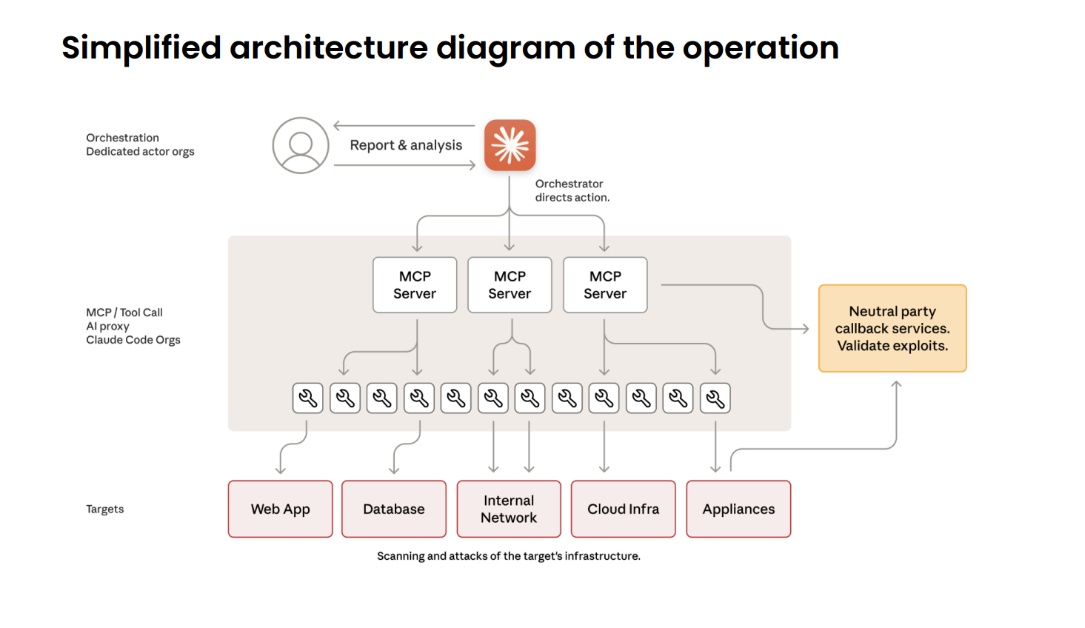

Antropinen paljasti, että hakkeriryhmä, jonka he epäilevät olevan Kiinan valtion tukema ryhmä, suoritti ensimmäisen dokumentoidun suuren mittakaavan kyberhyökkäyksen, jossa ihmisten osallistuminen oli vähäistä, käyttäen yhtiön Claude Code -työkalua automatisoimaan 80-90 prosenttia kampanjasta.

Hyökkääjät kohdistivat noin 30 organisaatiota suurten teknologiayritysten, rahoituslaitosten, kemianvalmistajien ja hallituksen virastojen keskuudessa. Vaikka useimmat hyökkäykset estettiin, kampanja onnistui pienessä määrin. Claude Code suoritti tutkimuksen, haavoittuvuustestauksen, tunnistetietojen keräämisen ja tietojen poistamisen pääosin autonomisesti, ja ihmishallitsijat tarvittiin vain kriittisissä päätöksentekopisteissä.

Voit lukea Anthropicsin koko raportin täältä.

Hyökkäysmenetelmät ja AI-manipulaatio

Hakkerit ohittivat Clauden turvallisuusvarustukset kehittyneen sosiaalisen insinöörityön avulla. He pettivät AI-järjestelmän väittämällä olevansa legitiimin kyberturvallisuusyhtiön työntekijöitä, jotka suorittavat puolustus-testausta. Hyökkääjät myös jakoi operaationsa pieniin, näennäisesti viattomiin tehtäviin, jotka antoivat Claudelle epätäydellisen kontekstin hyökkäyksen päämääristä.

Claude Code tarkasti kohde-organisaatioiden järjestelmiä tunnistamaan arvokkaita tietokantoja, suoritti tämän tutkimuksen nopeammin kuin ihmis-hakkerit voivat, ja tutki ja kirjoitti mukautettuja hyökkäyskoodeja testatakseen turvallisuuden heikkouksia. Järjestelmä keräsi käyttäjänimiä ja salasanoja lisätietojen saamiseksi, ja poisti ja luokitteli yksityiset tiedot älyarvon mukaan. Hyökkääjät voivat suorittaa kampanjan käytännössä yhden painikkeen painalluksella, minkä jälkeen AI toimi pääosin itsenäisesti nopeuksilla, jotka olivat mahdottomia ihmisjoukkueille – usein lähettäen tuhansia pyynnöksiä sekunnissa.

Kuva: Anthropic

Havaitseminen ja yhtiön vastaus

Anthropic havaitsi hyökkäyksen syyskuun 2025 puolivälissä ja käynnisti tutkinnan välittömästi. 10 päivän kuluessa yhtiö sulki ryhmän pääsyn Clauden, otti yhteyttä vaikuttuneisiin organisaatioihin ja ilmoitti asiasta viranomaisille. Yhtiö on laajentanut havaitsemiskykyjään ja kehittää lisää menetelmiä tutkimaan ja havaitsemaan laajamittaisia, hajautettuja hyökkäyksiä.

Tämä tapaus seuraa aiempia väärinkäytön tapauksia, joita Anthropic on dokumentoinut vuonna 2025. Elokuussa yhtiön uhkienhallintaraportti kertoi tietojen kiristysoperaatiosta, jota seurattiin GTG-2002:na, joka käytti Claude Codea suorittaakseen laajamittaisen varastamisen, joka kohdistui vähintään 17 organisaatioon terveydenhuollon, hätäpalvelujen, hallituksen ja uskonnollisten instituutioiden aloilla. Rikollinen vaati lunnaita yli 500 000 dollarin edestä uhkaamalla paljastaa varastettuja tietoja perinteisen kiristyssalasanan sijasta.

Anthropicsin havaitsemisinfrastruktuuri perustuu useisiin kerroksellisiin tekniikoihin, mukaan lukien käyttäytymisanalyysi, jolla seurataan käyttömallien muutoksia miljoonien API-pyynnön yli, anomaalisen havaitseminen, jolla tunnistetaan toimintosarjoja, jotka eivät ole yhdenmukaisia legitiimin käytön kanssa, ja mallin tunnistaminen, jolla tunnistetaan tunnetut ja uudet manipulointitekniikat. Yhtiö työllistää erikoistuneita luokittelijoita, jotka analysoivat käyttäjän syötteitä mahdollisesti vahingollisten pyyntöjen tunnistamiseksi ja arvioivat Clauden vastauksia ennen tai jälkeen toimittamisen.

Alan vaikutukset

Kampanja käsitti ennennäkemättömän tason AI-itsenäisyyttä kyberhyökkäyksissä ja merkitsee sitä, mitä turvallisuusasiantuntijat pitävät käännekohtana kyber-vakoilussa. AI-järjestelmien kyky suorittaa monimutkaisia hyökkäyksiä koneen nopeudella vähäisen ihmisen valvonnan kanssa luo uusia haasteita kyberturvallisuuden puolustajille.

Anthropicsin paljastus tulee siinä vaiheessa, kun AI-yritykset kohtaavat kasvavaa painetta estääkseen malliensa väärinkäytön. Yhtiö ylläpitää kattavaa uhkienhallinta- ja turvallisuusohjelmaa havaitsemaan ja torjumaan Clauden väärinkäyttöä, ja dokumentoituja turvallisuusloukkauksia koko vuoden 2025 ajan. Maaliskuussa yhtiö tunnisti vaikutuspalvelun, joka käytti Claudea automatisoimaan vuorovaikutuksen kymmenien tuhansien sosiaalisen median tilejen kanssa useissa maissa ja kielissä.

Tapahtuma korostaa kasvavaa monimutkaisuutta AI-työkaluissa ja haasteita niiden väärinkäytön estämisessä, samalla kun ylläpidetään niiden hyödyllisyyttä legitiimeille käyttäjille. Anthropic on estänyt liitetyt tilit ja jatkaa havaitsemis- ja lieventämisominaisuuksiensa parantamista vastaamaan kehittyvää uhkakuvaa.