Inteligencia artificial

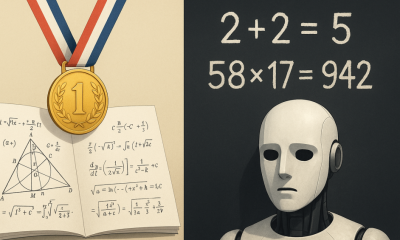

Por qué las competiciones están convirtiéndose en el nuevo estándar para probar la IA

Durante muchos años, las referencias como ImageNet para la visión por computadora y GLUE para el procesamiento del lenguaje natural han sido las principales herramientas para evaluar la IA. Ofrecían una forma sencilla de rastrear el progreso y comparar diferentes modelos. Pero a medida que los sistemas de IA han avanzado, muchas de estas referencias han sido saturadas, con modelos que igualan o incluso superan el rendimiento humano. Este desafío ha planteado la necesidad de nuevos métodos que puedan probar mejor las capacidades de la IA. En respuesta a este desafío, los investigadores ahora están recurriendo a las competiciones como una forma alternativa de evaluar la IA. En lugar de confiar en conjuntos de datos fijos, los modelos de IA ahora se evalúan a través de juegos de mesa, competiciones de codificación, olimpiadas de matemáticas, deportes electrónicos y desafíos de robótica. En estos entornos, los modelos deben adaptarse, razonar y crear estrategias para enfrentar nuevos problemas y oponentes. Este artículo examina las limitaciones de las referencias tradicionales y destaca cómo las competiciones están surgiendo como un nuevo estándar para evaluar la IA.

Por qué las referencias tradicionales no son suficientes

Las referencias tradicionales han guiado el desarrollo de la IA durante décadas. Ofrecen una forma estandarizada de comparar el rendimiento de los modelos de IA. Estos conjuntos de datos contenían entradas fijas con objetivos claros que permitían a los investigadores comparar diferentes enfoques de una manera sencilla. Un modelo que funcionaba mejor se consideraba más capaz.

Sin embargo, a medida que los sistemas de IA han crecido en poder, estas referencias han revelado limitaciones fundamentales. El problema más obvio es la saturación de la referencia. Cuando los modelos alcanzan puntuaciones perfectas o casi perfectas, la prueba pierde su capacidad para distinguir entre modelos más fuertes y más débiles. Estudios muestran que muchas referencias alcanzan la saturación rápidamente, y esta tendencia se ha vuelto aún más común en los últimos años.

La contaminación de los datos presenta otro desafío. Muchas instancias de referencia están disponibles en línea y pueden haber sido incluidas en los conjuntos de datos de entrenamiento. Cuando un modelo resuelve un problema, puede estar recordando una respuesta que ya ha visto durante el entrenamiento. Esto crea una ilusión de inteligencia sin demostrar una capacidad de razonamiento real.

Algunos investigadores han intentado solucionar esto mediante la evaluación humana. Si bien agrega matices, la evaluación humana también aporta subjetividad y sesgo. Estas evaluaciones también son tediosas, costosas y difíciles de escalar en varios modelos. Estas limitaciones han creado una necesidad urgente de métodos de evaluación que puedan seguir el ritmo de las capacidades de IA en constante evolución.

Por qué las competiciones ofrecen un enfoque mejor

Las competiciones proporcionan un entorno de prueba dinámico que aborda muchas de las limitaciones de las referencias tradicionales. Ofrecen reglas claras, objetivos definidos y resultados medibles que no dependen de la interpretación subjetiva. El éxito se determina por resultados transparentes que cualquier persona puede verificar.

La ventaja más significativa de las competiciones es su capacidad natural para escalar la dificultad. A medida que la IA mejora, los desafíos se vuelven automáticamente más difíciles. En los juegos, los modelos más fuertes se enfrentan a oponentes más sofisticados. En las competiciones matemáticas, los problemas aumentan en complejidad. En las competiciones de codificación, los desafíos algorítmicos se vuelven más exigentes. Esta propiedad de autoescalado garantiza que la evaluación siga siendo relevante a medida que avanza la tecnología.

Las competiciones también exigen habilidades cognitivas diversas. Los juegos estratégicos requieren planificación a largo plazo y modelado de oponentes. Las olimpiadas matemáticas prueban la resolución creativa de problemas y el razonamiento riguroso. Las competiciones de codificación evalúan el pensamiento algorítmico y las habilidades de implementación. Los desafíos del mundo real, como las competiciones de Kaggle, evalúan las habilidades prácticas de resolución de problemas en varios dominios.

Lo más importante es que las competiciones permiten una comparación directa con el rendimiento humano. Esta característica proporciona un punto de referencia significativo que las referencias estáticas no pueden ofrecer. Cuando un sistema de IA compite en la Olimpiada Matemática Internacional o juega ajedrez contra grandes maestros, obtenemos información sobre cómo se compara la inteligencia de la máquina con las capacidades humanas.

La transparencia de la evaluación competitiva también permite un análisis más profundo. Cada movimiento en un juego, cada paso en una prueba matemática y cada línea de código pueden examinarse para entender cómo los sistemas de IA abordan los problemas. Esta apertura transforma la evaluación de una simple puntuación en una ventana para comprender los procesos de toma de decisiones.

Ejemplos de IA en competiciones

Evaluar la IA a través de competiciones no es una idea nueva. En 2016, AlphaGo de DeepMind derrotó al campeón mundial de Go Lee Sedol, y su sucesor, AlphaZero, derrotó al campeón reinante Stockfish al enseñarse a sí mismo el juego del ajedrez. En los deportes electrónicos, el sistema de Dota 2 de OpenAI (OpenAI Five) derrotó al equipo campeón del mundo en 2019, mientras que AlphaStar de DeepMind alcanzó el estatus de Gran Maestro en StarCraft II. Estas victorias mostraron que los sistemas de IA pueden adaptarse y tener éxito en entornos estratégicos y en tiempo real altamente competitivos.

Más recientemente, los investigadores han desarrollado modelos de IA para competiciones académicas. De hecho, Google DeepMind y los sistemas de OpenAI alcanzaron una puntuación de medalla de oro en la Olimpiada Matemática Internacional. En programación, AlphaCode abordó problemas frescos de Codeforces y se clasificó alrededor de la mediana de los competidores humanos. Estos resultados destacaron que los sistemas de IA pueden realizar competiciones en pruebas de razonamiento estilo olimpiada.

La competencia en robótica sigue un enfoque similar. Eventos como RoboCup, desafíos de DARPA y tareas de XPrize requieren que los equipos construyan agentes que operen en entornos del mundo real, desde robots que juegan fútbol hasta vehículos autónomos. Estos formatos competitivos hacen que el progreso sea medible y permiten la comparación directa entre sistemas.

Qué revela la prueba basada en competiciones

Las competiciones revelan aspectos de la inteligencia que las referencias tradicionales a menudo pasan por alto. La capacidad de generalización se vuelve inmediatamente aparente cuando la IA se enfrenta a desafíos nuevos que nunca ha encontrado. A diferencia de las referencias que favorecen la memorización, las competiciones presentan constantemente nuevos escenarios que requieren habilidades de resolución de problemas genuinas.

La capacidad de razonamiento creativo emerge como un factor crucial, particularmente en competiciones matemáticas y científicas. La IA debe generar ideas originales y construir argumentos novedosos para resolver un problema que nunca ha visto antes. Esta creatividad no se puede medir a través del emparejamiento de patrones en conjuntos de datos fijos.

La adaptabilidad es un aspecto esencial de todos los dominios competitivos. La IA que juega juegos debe ajustar sus estrategias en función del comportamiento del oponente. La IA que resuelve competiciones debe modificar sus enfoques cuando los intentos iniciales fallan. Esta flexibilidad refleja los requisitos del mundo real, donde las respuestas rígidas a menudo fallan.

La robustez ante la novedad es otro factor clave de la prueba basada en competiciones. El entorno competitivo cambia constantemente, lo que obliga a la IA a lidiar con nuevas situaciones y movimientos inesperados. Un modelo que funciona bien en estas condiciones es más probable que sea confiable y eficaz en aplicaciones del mundo real.

Finalmente, las competiciones proporcionan una forma directa de comparar el razonamiento humano con la inteligencia de la máquina. Al competir contra expertos humanos en un juego o una competición de resolución de problemas, los sistemas de IA se someten al estándar más alto. Esta característica proporciona un objetivo claro y aspiracional para el campo, en lugar de métricas de rendimiento abstractas.

Desafíos en la evaluación basada en competiciones

Si bien la evaluación basada en competiciones ofrece muchos beneficios, también enfrenta varios desafíos. Una preocupación es la especificidad del dominio. Un campeón de ajedrez puede no ser capaz de resolver un problema matemático complejo. El éxito en una competición específica no garantiza la inteligencia general. El campo debe encontrar formas de combinar los resultados de múltiples competiciones para obtener una comprensión más completa de las capacidades generales de la IA.

La estandarización es otro problema. Si bien los registros de victorias y derrotas son claros dentro de un juego, comparar resultados a través de diferentes tipos de competiciones es difícil. Por ejemplo, ¿cómo comparar el rendimiento de un modelo en un desafío de robótica con su rendimiento en una competición de codificación? Los investigadores están trabajando para crear marcos que puedan unificar estos diferentes tipos de resultados en una evaluación justa.

Finalmente, está el problema de la accesibilidad. Si bien muchas competiciones están abiertas, algunas requieren recursos computacionales significativos o experiencia que puede no estar disponible para todos los investigadores, especialmente aquellos de instituciones más pequeñas. Garantizar que estos nuevos métodos de evaluación sean inclusivos es esencial para la salud y la diversidad del campo.

Impacto más amplio en la investigación de IA

El auge de la evaluación basada en competiciones ya está teniendo un impacto significativo en cómo se desarrolla la IA. Alienta a los investigadores a alejarse de la simple capacitación de modelos en referencias hacia la construcción de sistemas que puedan planificar, razonar y adaptarse a nuevas situaciones. Este cambio es crucial para hacer progresos reales hacia formas más generales de inteligencia.

Las plataformas competitivas también democratizan la evaluación. Al hacer que los juegos y las competiciones estén abiertas a todos, los pequeños grupos de investigación y los desarrolladores individuales pueden competir con las grandes empresas tecnológicas. Esta democratización fomenta la innovación desde una gama más amplia de personas e instituciones. Plataformas como Kaggle, la Olimpiada Matemática Internacional y los sitios de competiciones de programación proporcionan lugares accesibles para probar las capacidades de la IA.

Finalmente, las lecciones de las pruebas competitivas están influyendo directamente en aplicaciones del mundo real. La capacidad de planificar, adaptarse y mantenerse robusto bajo presión es muy valiosa en campos como las finanzas, el transporte, la atención médica y la defensa. Estos dominios requieren IA que pueda manejar la incertidumbre, adaptarse a condiciones cambiantes y ofrecer un rendimiento confiable.

En resumen

La evaluación basada en competiciones está redefiniendo cómo medimos el progreso de la IA. A diferencia de las referencias estáticas, las competiciones prueban la adaptabilidad, la creatividad y la resolución de problemas reales en condiciones dinámicas. Si bien desafíos como la estandarización y la accesibilidad persisten, este cambio impulsa a la IA hacia una inteligencia más robusta, versátil y comparable a la humana. No solo agudiza la investigación, sino que también acelera el desarrollo de sistemas de IA listos para tener un impacto en el mundo real.