El ángulo de Anderson

Hacia el control total en la generación de vídeo con IA

Modelos de base de vídeo como Hunyuán y Wan 2.1Si bien son potentes, no ofrecen a los usuarios el tipo de control granular que exige la producción de cine y televisión (en particular, la producción de efectos visuales).

En los estudios profesionales de efectos visuales, los modelos de código abierto como estos, junto con los modelos anteriores basados en imágenes (en lugar de vídeo) como Difusión estable, Kandinsky y Flujo, se suelen utilizar junto con una gama de herramientas de apoyo que adaptan su producción original para satisfacer necesidades creativas específicas. Cuando un director dice: “Eso se ve genial, pero ¿podemos hacerlo un poco más [n]?” No se puede responder diciendo que el modelo no es lo suficientemente preciso para manejar tales solicitudes.

En su lugar, un equipo de efectos visuales de IA utilizará una variedad de métodos tradicionales. CGI y técnicas de composición, combinadas con procedimientos y flujos de trabajo personalizados desarrollados a lo largo del tiempo, con el fin de intentar empujar los límites de la síntesis de video un poco más allá.

Entonces, por analogía, un modelo de video base es muy parecido a una instalación predeterminada de un navegador web como Chrome: hace muchas cosas de manera predeterminada, pero si desea que se adapte a sus necesidades, en lugar de lo contrario, necesitará algunos complementos.

Fanáticos del control

En el mundo de la síntesis de imágenes basada en la difusión, el sistema de terceros más importante es Red de control.

ControlNet es una técnica para agregar control estructurado a modelos generativos basados en difusión, lo que permite a los usuarios guiar la generación de imágenes o videos con entradas adicionales como mapas de bordes, mapas de profundidad o información de pose.

Los diversos métodos de ControlNet permiten profundidad>imagen (fila superior), segmentación semántica>imagen (fila inferior izquierda) y generación de imágenes guiadas por pose de humanos y animales (fila inferior izquierda).

En lugar de depender únicamente de indicaciones de texto, ControlNet introduce ramas de red neuronal independientes, o adaptadores, que procesan estas señales de acondicionamiento preservando las capacidades generativas del modelo base.

Esto permite obtener resultados ajustados que se ajustan más estrechamente a las especificaciones del usuario, lo que lo hace particularmente útil en aplicaciones donde se requiere una composición, estructura o control de movimiento precisos:

Con una pose guía, se pueden obtener una variedad de tipos de salida precisos a través de ControlNet. Fuente: https://arxiv.org/pdf/2302.05543

Sin embargo, este tipo de marcos basados en adaptadores operan externamente sobre un conjunto de procesos neuronales con un enfoque muy interno. Estos enfoques presentan varias desventajas.

En primer lugar, los adaptadores se entrenan de forma independiente, lo que conduce a conflictos de ramas cuando se combinan varios adaptadores, lo que puede implicar una calidad de generación degradada.

En segundo lugar, introducen redundancia de parámetros, lo que requiere computación y memoria adicionales para cada adaptador, lo que hace que el escalamiento sea ineficiente.

En tercer lugar, a pesar de su flexibilidad, los adaptadores a menudo producen subóptimo Resultados en comparación con los modelos que están completamente afinado Para la generación de múltiples condiciones. Estos problemas hacen que los métodos basados en adaptadores sean menos eficaces para tareas que requieren la integración fluida de múltiples señales de control.

Lo ideal sería capacitar las capacidades de ControlNet. nativamente en el modelo, de manera modular que pudiera acomodar innovaciones obvias posteriores y muy esperadas, como la generación simultánea de video y audio, o capacidades nativas de sincronización de labios (para audio externo).

Tal como están las cosas, cada pieza adicional de funcionalidad representa una tarea de posproducción o un procedimiento no nativo que tiene que navegar por los pesos estrictamente sensibles y limitados del modelo de base en el que está operando.

FullDiT

En medio de este enfrentamiento surge una nueva propuesta de China que propone un sistema en el que las medidas de estilo ControlNet se integran directamente en un modelo de video generativo en el momento del entrenamiento, en lugar de quedar relegadas a un segundo plano.

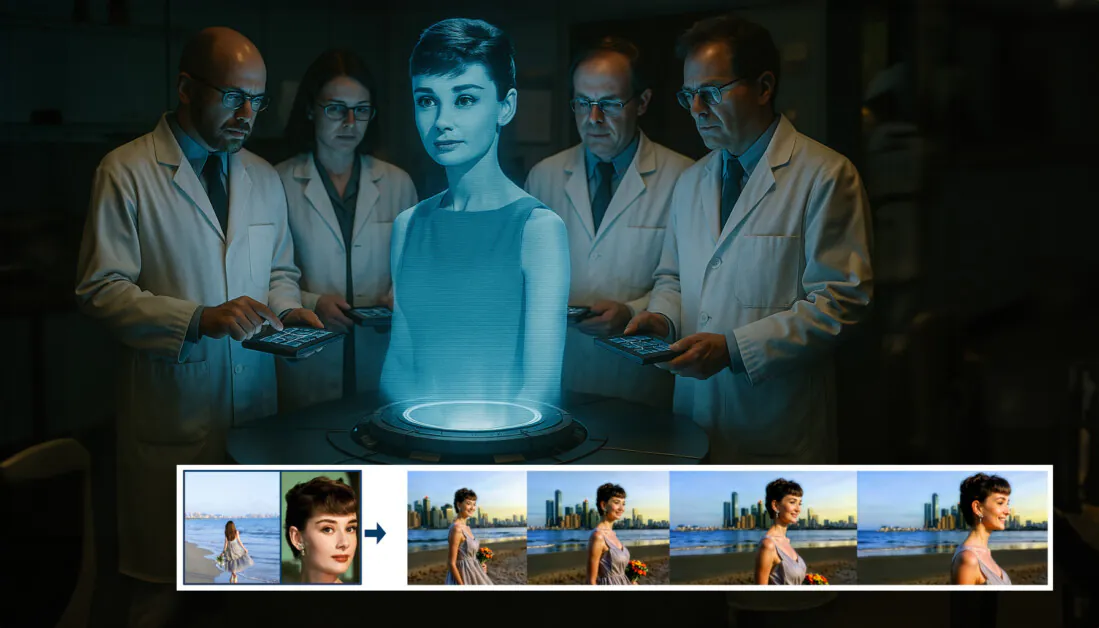

Del nuevo artículo: el enfoque FullDiT puede incorporar imposición de identidad, profundidad y movimiento de cámara en una generación nativa, y puede convocar cualquier combinación de estos a la vez.. Fuente: https://arxiv.org/pdf/2503.19907

Bajo el título FullDiTEl nuevo enfoque fusiona condiciones multitarea como transferencia de identidad, mapeo de profundidad y movimiento de cámara en una parte integrada de un modelo de video generativo entrenado, para el cual los autores han producido un prototipo de modelo entrenado y videoclips que lo acompañan. Sitio del proyecto.

En el siguiente ejemplo, vemos generaciones que incorporan movimiento de cámara, información de identidad e información de texto (es decir, indicaciones de texto que guían al usuario):

Dele "click" para jugar. Ejemplos de imposición de usuarios al estilo ControlNet con solo un modelo de base entrenado de forma nativa. Fuente: https://fulldit.github.io/

Cabe señalar que los autores no proponen su modelo experimental entrenado como un modelo de base funcional, sino más bien como una prueba de concepto para modelos nativos de texto a video (T2V) e imagen a video (I2V) que ofrecen a los usuarios más control que solo un mensaje de imagen o un mensaje de texto.

Como aún no existen modelos similares de este tipo, los investigadores crearon un nuevo punto de referencia denominado Banco completoPara la evaluación de videos multitarea, afirman un rendimiento de vanguardia en las pruebas comparables que diseñaron con enfoques anteriores. Sin embargo, dado que FullBench fue diseñado por los propios autores, su objetividad no ha sido probada, y su conjunto de datos de 1,400 casos podría ser demasiado limitado para extraer conclusiones más generales.

Quizás el aspecto más interesante de la arquitectura que presenta el artículo es su potencial para incorporar nuevos tipos de control. Los autores afirman:

En este trabajo, solo exploramos las condiciones de control de la cámara, las identidades y la información de profundidad. No investigamos otras condiciones y modalidades como audio, voz, nube de puntos, cuadros delimitadores de objetos, flujo óptico, etc. Si bien el diseño de FullDiT puede integrar a la perfección otras modalidades con mínimas modificaciones de la arquitectura, la adaptación rápida y rentable de los modelos existentes a las nuevas condiciones y modalidades sigue siendo una cuestión importante que requiere mayor investigación.

Aunque los investigadores presentan FullDiT como un paso adelante en la generación de vídeo multitarea, se debe considerar que este nuevo trabajo se basa en arquitecturas existentes en lugar de introducir un paradigma fundamentalmente nuevo.

No obstante, FullDiT actualmente se sostiene solo (hasta donde yo sé) como un modelo de base de video con funciones de estilo ControlNet "codificadas" y es bueno ver que la arquitectura propuesta también puede adaptarse a innovaciones posteriores.

Dele "click" para jugar. Ejemplos de movimientos de cámara controlados por el usuario, del sitio del proyecto.

La nuevo documento se titula FullDiT: Modelo de base generativa de vídeo multitarea con atención plena, y proviene de nueve investigadores de Kuaishou Technology y la Universidad China de Hong Kong. La página del proyecto es aqui y los nuevos datos de referencia son en Hugging Face.

Método

Los autores sostienen que el mecanismo de atención unificada de FullDiT permite un aprendizaje de representación intermodal más fuerte al capturar relaciones espaciales y temporales en todas las condiciones:

Según el nuevo artículo, FullDiT integra múltiples condiciones de entrada mediante autoatención completa, convirtiéndolas en una secuencia unificada. Por el contrario, los modelos basados en adaptadores (arriba a la izquierda) utilizan módulos separados para cada entrada, lo que genera redundancia, conflictos y un rendimiento inferior.

A diferencia de las configuraciones basadas en adaptadores que procesan cada flujo de entrada por separado, esta estructura de atención compartida evita conflictos de ramificación y reduce la sobrecarga de parámetros. También afirman que la arquitectura puede escalar a nuevos tipos de entrada sin necesidad de un rediseño importante, y que el esquema del modelo muestra indicios de generalización a combinaciones de condiciones no observadas durante el entrenamiento, como la vinculación del movimiento de la cámara con la identidad del personaje.

Dele "click" para jugar. Ejemplos de generación de identidad desde el sitio del proyecto.

En la arquitectura de FullDiT, todas las entradas de condicionamiento, como texto, movimiento de cámara, identidad y profundidad, se convierten primero a un formato de token unificado. Estos tokens se concatenan posteriormente en una única secuencia larga, que se procesa mediante una pila de transformador capas utilizando plena autoatención. Este enfoque sigue trabajos previos como Plan Open-Sora y Movie Gen.

Este diseño permite que el modelo aprenda relaciones temporales y espaciales conjuntamente en todas las condiciones. Cada bloque de transformador opera a lo largo de toda la secuencia, lo que permite interacciones dinámicas entre modalidades sin depender de módulos separados para cada entrada. Además, como ya hemos mencionado, la arquitectura está diseñada para ser extensible, lo que facilita enormemente la incorporación de señales de control adicionales en el futuro, sin grandes cambios estructurales.

El poder de los tres

FullDiT convierte cada señal de control a un formato de token estandarizado para que todas las condiciones puedan procesarse conjuntamente en un marco de atención unificado. Para el movimiento de la cámara, el modelo codifica una secuencia de parámetros extrínsecos, como la posición y la orientación, para cada fotograma. Estos parámetros se marcan con la fecha y hora y se proyectan en vectores de incrustación que reflejan la naturaleza temporal de la señal.

La información de identidad se trata de forma diferente, ya que es inherentemente espacial y no temporal. El modelo utiliza mapas de identidad que indican qué caracteres están presentes en qué partes de cada fotograma. Estos mapas se dividen en parches, con cada parche proyectado en un incrustación que captura señales de identidad espacial, lo que permite que el modelo asocie regiones específicas del marco con entidades específicas.

La profundidad es una señal espaciotemporal, y el modelo la gestiona dividiendo los vídeos de profundidad en segmentos 3D que abarcan tanto el espacio como el tiempo. Estos segmentos se integran de forma que conservan su estructura a lo largo de los fotogramas.

Una vez integrados, todos estos tokens de condición (cámara, identidad y profundidad) se concatenan en una única secuencia larga, lo que permite a FullDiT procesarlos juntos utilizando auto-atenciónEsta representación compartida permite que el modelo aprenda interacciones entre modalidades y a lo largo del tiempo sin depender de flujos de procesamiento aislados.

Datos y Pruebas

El enfoque de entrenamiento de FullDiT se basó en conjuntos de datos anotados selectivamente y adaptados a cada tipo de condicionamiento, en lugar de requerir que todas las condiciones estuvieran presentes simultáneamente.

Para las condiciones textuales, la iniciativa sigue el enfoque de subtitulado estructurado descrito en el MiraData proyecto.

Canal de recopilación y anotación de vídeos del proyecto MiraData. Fuente: https://arxiv.org/pdf/2407.06358

Para el movimiento de la cámara, el Bienes Raíces10K El conjunto de datos fue la principal fuente de datos, debido a sus anotaciones de verdad fundamental de alta calidad de los parámetros de la cámara.

Sin embargo, los autores observaron que entrenar exclusivamente con conjuntos de datos de cámaras de escenas estáticas, como RealEstate10K, tendía a reducir los movimientos dinámicos de objetos y personas en los vídeos generados. Para contrarrestar esto, realizaron ajustes adicionales utilizando conjuntos de datos internos que incluían movimientos de cámara más dinámicos.

Las anotaciones de identidad se generaron utilizando la canalización desarrollada para el Maestro de conceptos proyecto, que permitió el filtrado y la extracción eficiente de información de identidad de grano fino.

El marco ConceptMaster está diseñado para abordar problemas de disociación de identidad y al mismo tiempo preservar la fidelidad del concepto en videos personalizados. Fuente: https://arxiv.org/pdf/2501.04698

Las anotaciones de profundidad se obtuvieron de la Panda-70M conjunto de datos usando Profundidad Cualquier cosa.

Optimización mediante el ordenamiento de datos

Los autores también implementaron un programa de entrenamiento progresivo, introduciendo condiciones más desafiantes. Más temprano en el entrenamiento Para asegurar que el modelo adquiriera representaciones robustas antes de agregar tareas más simples. El orden de entrenamiento procedió de texto a cámara condiciones, entonces identidades, y finalmente profundidad, con tareas más sencillas generalmente introducidas más tarde y con menos ejemplos.

Los autores destacan el valor de ordenar la carga de trabajo de esta manera:

Durante la fase de preentrenamiento, observamos que las tareas más desafiantes requieren un mayor tiempo de entrenamiento y deberían introducirse en una etapa más temprana del proceso de aprendizaje. Estas tareas desafiantes implican distribuciones de datos complejas que difieren significativamente del video de salida, lo que requiere que el modelo tenga la capacidad suficiente para capturarlas y representarlas con precisión.

'Por el contrario, introducir tareas más fáciles demasiado pronto puede hacer que el modelo priorice aprenderlas primero, ya que proporcionan una retroalimentación de optimización más inmediata, lo que dificulta la convergencia de tareas más desafiantes.'

Una ilustración del orden de entrenamiento de datos adoptado por los investigadores, donde el rojo indica un mayor volumen de datos.

Tras el preentrenamiento inicial, una etapa final de ajuste perfeccionó aún más el modelo para mejorar la calidad visual y la dinámica de movimiento. Posteriormente, el entrenamiento siguió el de un marco de difusión estándar*: se añadió ruido a las latentes de vídeo y el modelo... Aprendiendo a predecirlo y eliminarlo, utilizando los tokens de condición integrados como guía.

Para evaluar eficazmente FullDiT y proporcionar una comparación justa con los métodos existentes, y en ausencia de la disponibilidad de cualquier otro punto de referencia apropiado, los autores introdujeron Banco completo, un conjunto de pruebas comparativas cuidadosamente seleccionadas que consta de 1,400 casos de prueba distintos.

Una instancia de explorador de datos para el nuevo punto de referencia FullBench. Fuente: https://huggingface.co/datasets/KwaiVGI/FullBench

Cada punto de datos proporcionó anotaciones de verdad fundamental para varias señales de condicionamiento, incluidas movimiento de cámara, identidad y profundidad.

Métrica

Los autores evaluaron FullDiT utilizando diez métricas que cubren cinco aspectos principales del rendimiento: alineación de texto, control de la cámara, similitud de identidad, precisión de profundidad y calidad general del video.

La alineación del texto se midió utilizando Similitud de CLIP, mientras que el control de la cámara se evaluó a través de error de rotación (RotErr), error de traducción (TransErr), o consistencia del movimiento de la cámara (CamMC), siguiendo el enfoque de CamI2V (en el Control de cámara proyecto).

La similitud de identidad se evaluó utilizando DINO-I y CLIP-I, y la precisión del control de profundidad se cuantificó utilizando Error absoluto medio (MAE).

La calidad del video se evaluó con tres métricas de MiraData: similitud CLIP a nivel de cuadro para suavidad; distancia de movimiento basada en flujo óptico para dinámica; y Puntuaciones estéticas de LAION para atractivo visual.

Cursos

Los autores entrenaron FullDiT utilizando un modelo interno (no revelado) de difusión de texto a vídeo que contiene aproximadamente mil millones de parámetros. Eligieron intencionalmente un tamaño de parámetro moderado para mantener la imparcialidad en las comparaciones con métodos anteriores y garantizar la reproducibilidad.

Dado que los videos de capacitación diferían en duración y resolución, los autores estandarizaron cada uno. lote redimensionando y rellenando videos a una resolución común, muestreando 77 cuadros por secuencia y utilizando atención aplicada y máscaras de pérdida para optimizar la eficacia del entrenamiento.

La Adam Se utilizó un optimizador en un tasa de aprendizaje de 1 × 10-5 en un clúster de 64 GPU NVIDIA H800, para un total combinado de 5,120 GB de VRAM (considere que en las comunidades de síntesis de entusiastas, 24GB En una RTX 3090 todavía se considera un estándar de lujo).

El modelo fue entrenado durante aproximadamente 32,000 pasos, incorporando hasta tres identidades por video, junto con 20 cuadros de condiciones de cámara y 21 cuadros de condiciones de profundidad, ambos muestreados de manera uniforme del total de 77 cuadros.

Para la inferencia, el modelo generó videos con una resolución de 384×672 píxeles (aproximadamente cinco segundos a 15 cuadros por segundo) con 50 pasos de inferencia de difusión y una escala de guía sin clasificador de cinco.

Métodos previos

Para la evaluación de cámara a video, los autores compararon FullDiT con Control de movimiento, CameraCtrl y CamI2V, con todos los modelos entrenados utilizando el conjunto de datos RealEstate10k para garantizar la coherencia y la imparcialidad.

En la generación condicionada por identidad, dado que no había modelos multiidentidad de código abierto comparables, el modelo se comparó con el modelo ConceptMaster de 1B parámetros, utilizando los mismos datos de entrenamiento y arquitectura.

Para las tareas de profundidad a video, se realizaron comparaciones con Adaptador Ctrl y ControlVideo.

Resultados cuantitativos de la generación de video de una sola tarea. FullDiT se comparó con MotionCtrl, CameraCtrl y CamI2V para la generación de video a cámara; ConceptMaster (versión de parámetro 1B) para la generación de video a identidad; y Ctrl-Adapter y ControlVideo para la generación de video a profundidad. Todos los modelos se evaluaron con su configuración predeterminada. Para garantizar la consistencia, se muestrearon uniformemente 16 fotogramas de cada método, coincidiendo con la duración de salida de los modelos anteriores.

Los resultados indican que FullDiT, a pesar de manejar múltiples señales de acondicionamiento simultáneamente, logró un rendimiento de última generación en métricas relacionadas con texto, movimiento de cámara, identidad y controles de profundidad.

En cuanto a las métricas de calidad general, el sistema, en general, superó a otros métodos, aunque su fluidez fue ligeramente inferior a la de ConceptMaster. Los autores comentan lo siguiente:

La suavidad de FullDiT es ligeramente inferior a la de ConceptMaster, ya que su cálculo se basa en la similitud CLIP entre fotogramas adyacentes. Dado que FullDiT presenta una dinámica significativamente mayor que ConceptMaster, la métrica de suavidad se ve afectada por las grandes variaciones entre fotogramas adyacentes.

'En cuanto a la puntuación estética, dado que el modelo de calificación favorece las imágenes en estilo de pintura y ControlVideo normalmente genera vídeos en este estilo, logra una puntuación alta en estética.'

Respecto de la comparación cualitativa, quizá sea preferible consultar los vídeos de muestra en el sitio del proyecto FullDiT, ya que los ejemplos en PDF son inevitablemente estáticos (y también demasiado grandes para reproducirlos íntegramente aquí).

La primera sección de los resultados cualitativos está en el PDF. Consulte el artículo original para obtener ejemplos adicionales, ya que son demasiado extensos para reproducirlos aquí.

Los autores comentan:

FullDiT demuestra una preservación de identidad superior y genera videos con mejor dinámica y calidad visual en comparación con ConceptMaster. Dado que ConceptMaster y FullDiT se entrenan en la misma estructura, esto resalta la efectividad de la inyección de condiciones con atención completa.

'…Los [otros] resultados demuestran la capacidad de control superior y la calidad de generación de FullDiT en comparación con los métodos de profundidad a video y de cámara a video existentes.'

Una sección de ejemplos del PDF de la salida de FullDiT con múltiples señales. Consulte el documento original y el sitio web del proyecto para obtener más ejemplos.

Conclusión

Aunque FullDiT es una incursión interesante en un tipo de modelo de base de video con más funciones, uno se pregunta si la demanda de instrumentos de estilo ControlNet alguna vez justificará la implementación de dichas funciones a escala, al menos para proyectos FOSS, que tendrían dificultades para obtener la enorme cantidad de potencia de procesamiento de GPU necesaria, sin respaldo comercial.

El principal desafío radica en que el uso de sistemas como Depth y Pose generalmente requiere un conocimiento considerable de interfaces de usuario relativamente complejas como ComfyUI. Por lo tanto, parece que un modelo FOSS funcional de este tipo probablemente será desarrollado por un grupo de pequeñas empresas de efectos visuales que carecen del presupuesto (o la voluntad, dado que estos sistemas se vuelven obsoletos rápidamente con las actualizaciones del modelo) para desarrollar y entrenar dicho modelo a puerta cerrada.

Por otra parte, los sistemas de “alquiler de IA” basados en API pueden estar bien motivados para desarrollar métodos interpretativos más simples y fáciles de usar para modelos en los que se han entrenado directamente sistemas de control auxiliares.

Dele "click" para jugar. Controles de profundidad + texto impuestos en una generación de video mediante FullDiT.

* Los autores no especifican ningún modelo base conocido (es decir, SDXL, etc.)

Primera publicación: jueves 27 de marzo de 2025